-

AI 重要概念科普与热门技术解析

AI时代已经扑面而来,普通人如果对相关概念还不甚了解的话,未来可能要活在与AI竞争的世界里。举个简单例子,AI会把人类的优秀诗歌直接吸收再给出一个至少80到90分输出,这直接拉高了此类文字输出的水平下限,其他行业同样如此。庆幸的是,人类还是拥有感知世界的能力(未来的具身智能也将是这个方向),这是AI目前所不具备的。人类要掌握自己的命运,就要掌握AI的技术应用及其原理,让AI服务于人,而不是被AI反…- 7

- 0

-

我对于AI领域商业模式的思考

上个月,华为发布了自家首款纯原生的鸿蒙折叠屏手机Pura X,并搭载了基于全新心理大模型的鸿蒙AI。这款鸿蒙AI会根据用户的语音输入感知情绪,并自适应调整输出的语音,让它更拟人。 在我看来,这种拟人的AI产品,是接下来AI产品的一个迭代方向。为什么这么说呢,主要基于下面几个事件:1、最初各家公司的大模型,本质上都是Chatbot,即聊天机器人,区别仅在于性能和参数量的不同。至于其他方面,…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

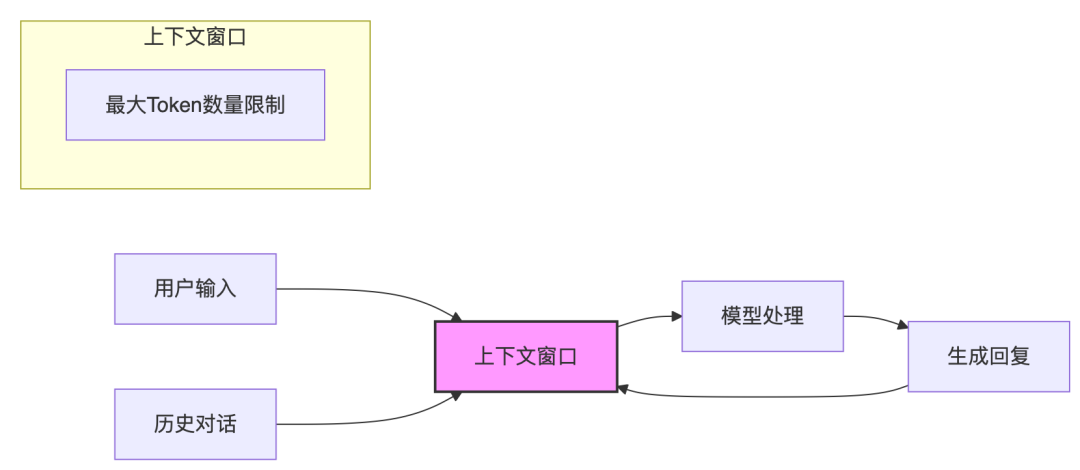

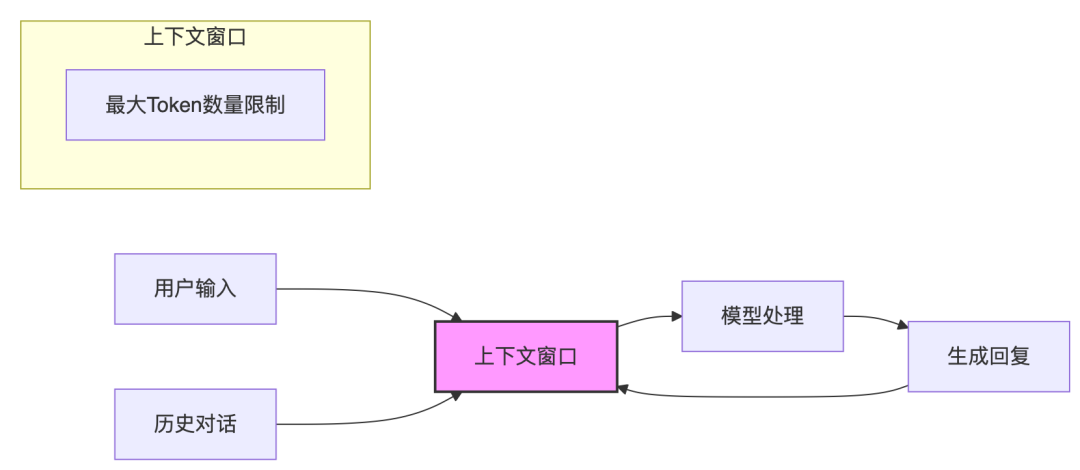

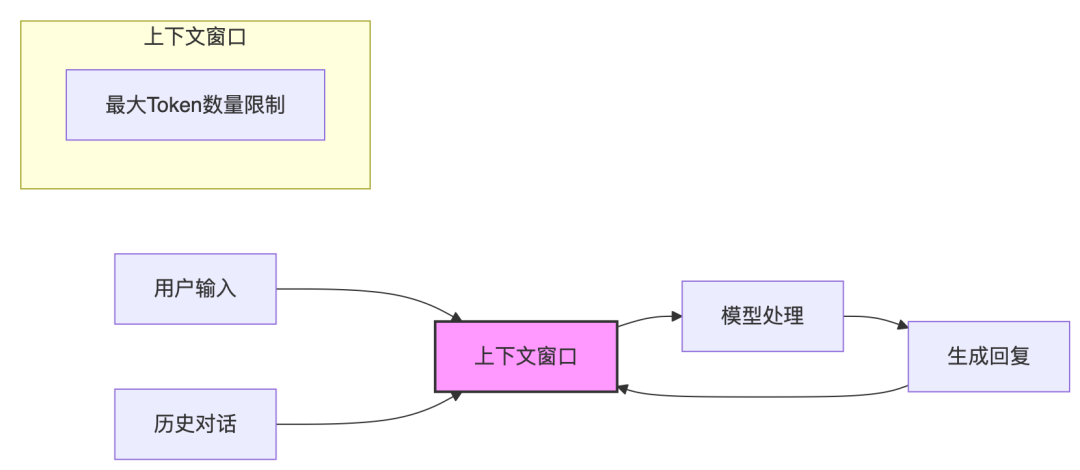

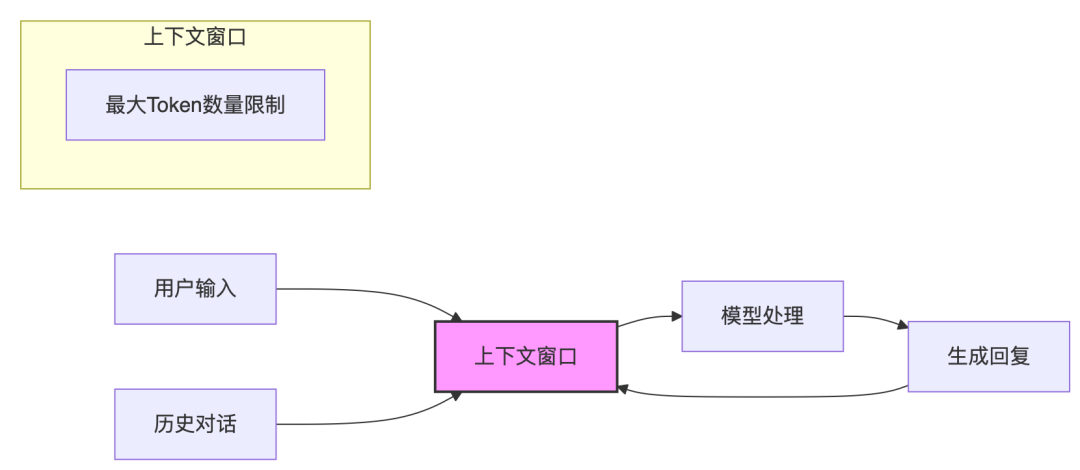

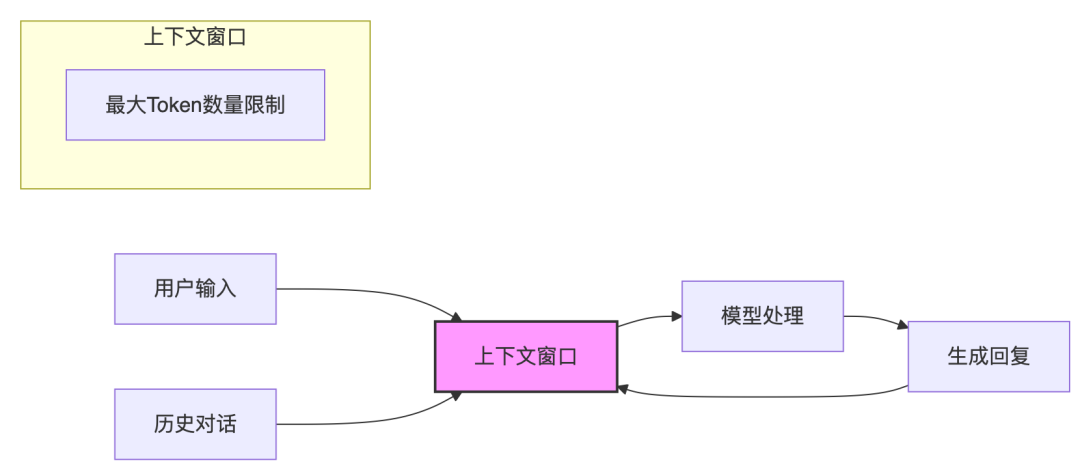

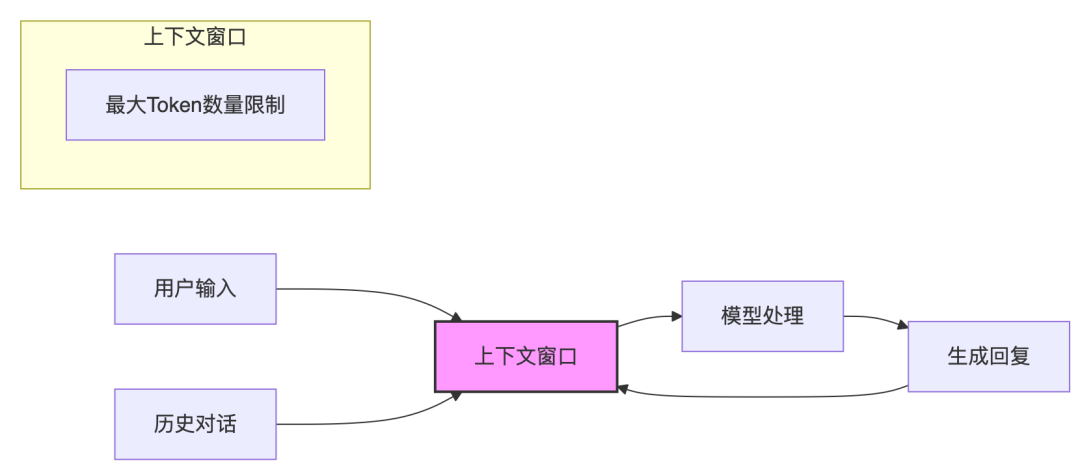

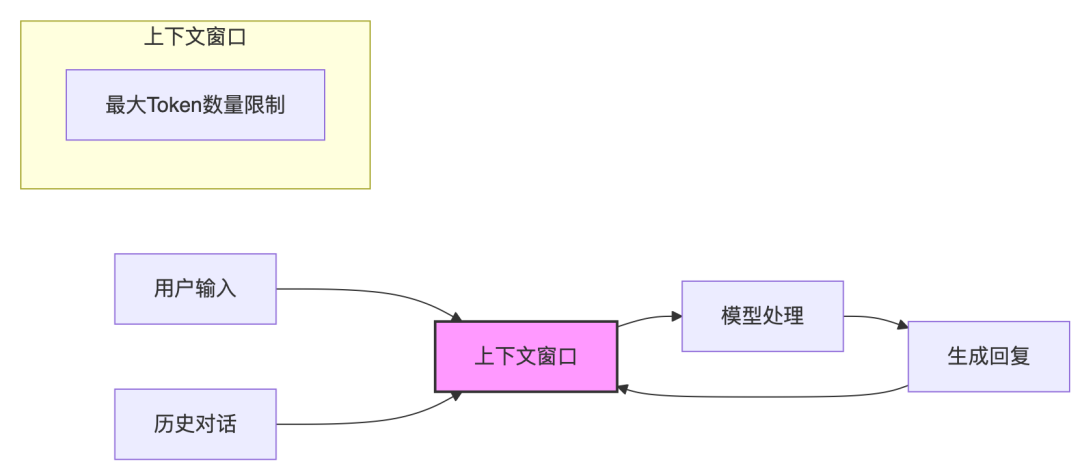

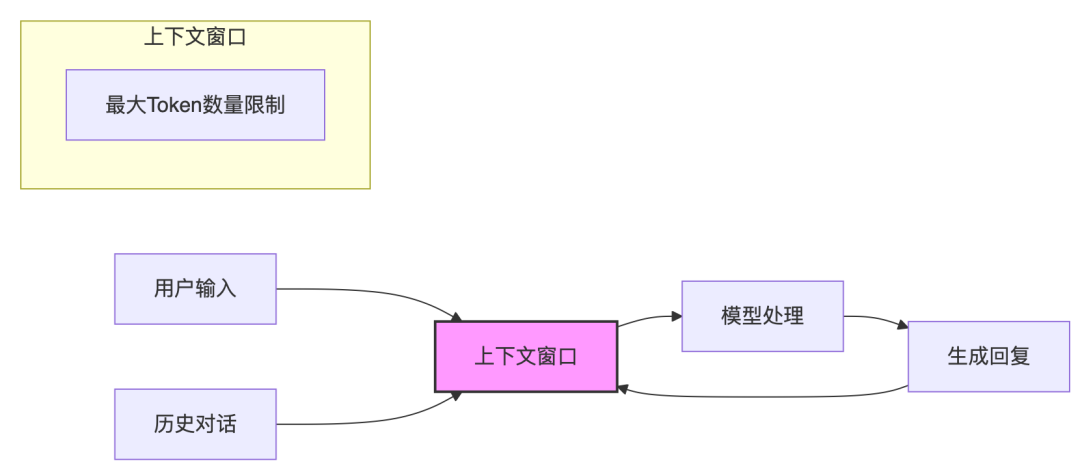

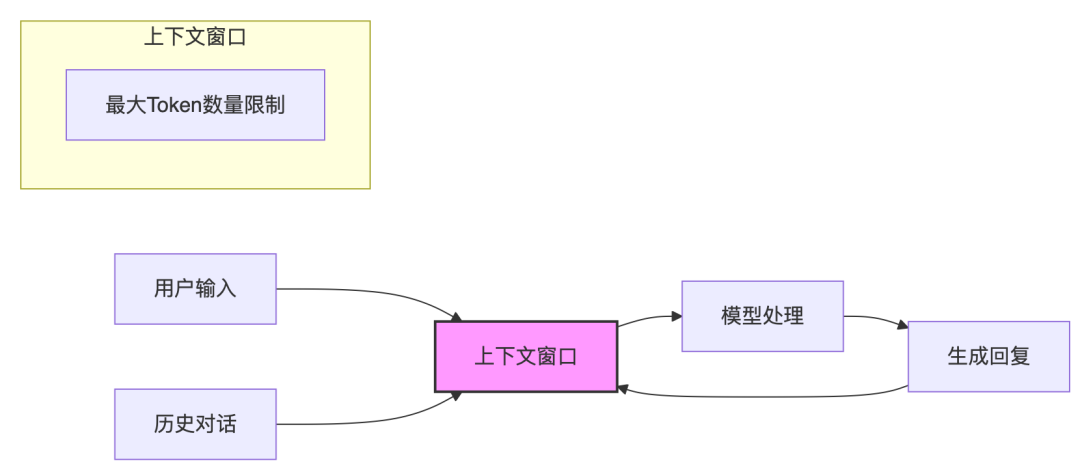

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

大模型落地的六大核心模式总览

01 为什么需要重新定义大模型落地范式? 1.1 行业痛点:大模型落地的三重困境 1.1.1 成本黑洞:算力军备竞赛的不可持续性 千亿参数模型的训练需要数千张GPU并行运算,单次训练成本超千万美元(如GPT-4训练成本约1.3亿美元) 中小企业部署成本过高:某零售企业自建客服大模型需投入200万GPU资源,最终因ROI不足放弃项目 1.1.2 场景迷雾:通用模型与垂直需求的鸿沟 医疗领域需要诊断级…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

Agent 要被吃进大模型了

OpenAI 做 Agent,得天独厚。作者丨郑佳美 编辑丨马晓宁 今天凌晨,奥特曼突然发文宣布推出自家最新的 o 系列模型:满血版 o3 和 o4-mini,同时表示这两款模型都可以自由调用 ChatGPT 里的各种工具,包括但不限于图像生成、图像分析、文件解释、网络搜索、Python。 总的来说,就是比前一代的性能更强而且价格更低。 消息一出,马上就有网友晒出了两个模型的“小球测试”结果,并配…- 5

- 0

-

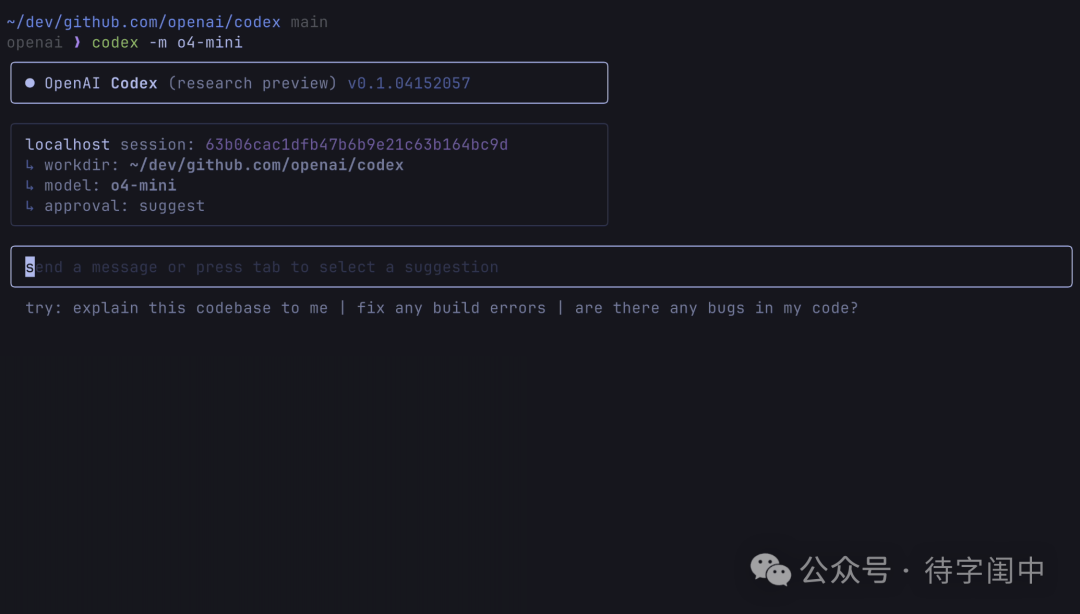

OpenAI:发布 Codex 与收购 Windsurf

OpenAI 发布了 Codex——一个基于终端的 AI 编程 Agent,大多数人没法儿用,即使你已经掌握了 Cursor/Windsurf。收购 Windsurf 据说是一个谣传,但不能说 OpenAI 不想。TA 很想,但是也要面子。OpenAI 是很矛盾的,自己作为一个价值的创造者,但价值却被别人攫走了——多郁闷。AI Coding 是非常重要的,甚至是通向 AGI 最确定的路…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

布局“记忆”:AI厂商暗战个性化赛道

北京时间2025年4月17日,OpenAI推出了功能强大的推理模型o3和轻量级但高效的o4-mini 。 值得注意的是,此次模型发布与ChatGPT记忆和搜索策略的更新同步进行,旨在利用用户对话历史,实现更个性化和实用的搜索查询 。 这种同步发布并非偶然,它体现了OpenAI致力于通过结合先进的推理能力和个性化的上下文理解来提升整体用户体验的战略意图 。 OpenAI此举的背景是,大型语言模型…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

一口气讲清楚:LLM、MCP、EMB

在很多介绍AI的文章中,会频繁出现一些名词,比如LLM、MCP、EMB。这些专业术语是什么意思,有什么作用,背后的技术原理又是什么,对普通人来说有点难以理解。 这篇文章,我会尽量用通俗易懂的语言,讲清楚这些名词到底是什么意思,作用是什么,帮助大家更好地理解AI。 一、LLM:大型语言模型 LLM的全称为(Large Language Model),即大型语言模型。它指的是一种基于深度学习技术的人工…- 2

- 0

-

不是 GPT-5,却可能更关键的一步

会聊天的 AI,我们已经见多了。能干实事的 AI,才刚刚开始登场。 昨晚,OpenAI 一口气发布两款新模型:o3 和 o4-mini,没有等 GPT-5,没有开发布会,更没有宣传大模型参数。它们的重点不是“更强”,而是“更能干”。 这次更新的信号很明确:AI,不再只是回答你,而是能理解问题 → 分析路径 → 自选工具 → 自己动手。AI 正在从“陪聊型选手”,转向“动手型搭子”。 GPT-5 没…- 3

- 0

-

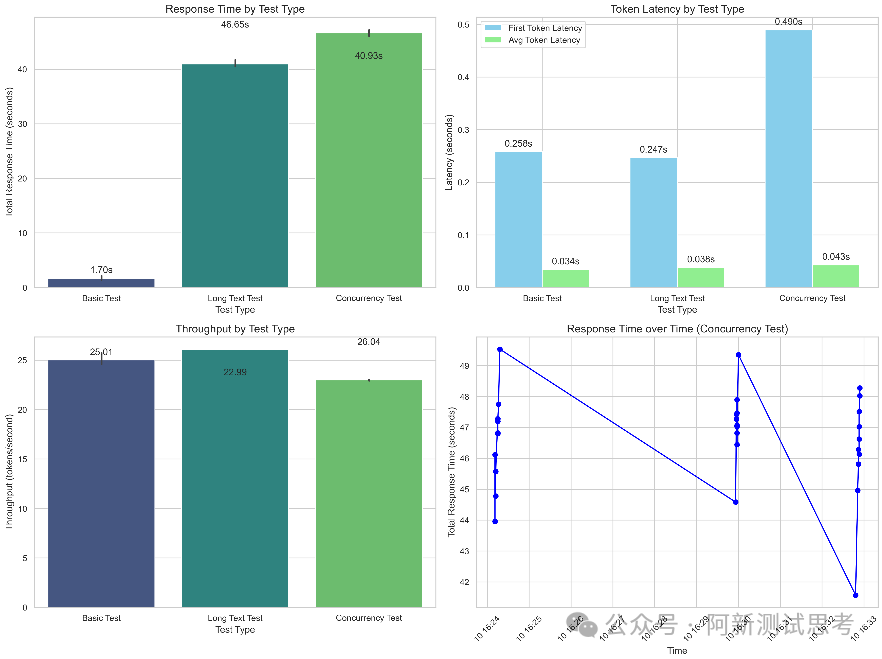

AIGC: 性能透视黑科技:一键解析,图文全呈现

性能分析工具代码解析报告 背景 • 上次实现了 通过编写脚本的功能来测试 大模型脚本,基于前脚本的完善,读取Excel的数据来生成分析图表 • 该工具主要实现了性能数据的加载、分析、可视化和报告生成等核心功能 • 核心目标是帮助评估和分析大语言模型在不同测试场景下的性能表现 第1部分:工具架构设计 核心类设计 采用面向对象方式,通过 性能分析脚本 类封装所有功能 实现数据加载、指标计算、可视化…- 6

- 0

-

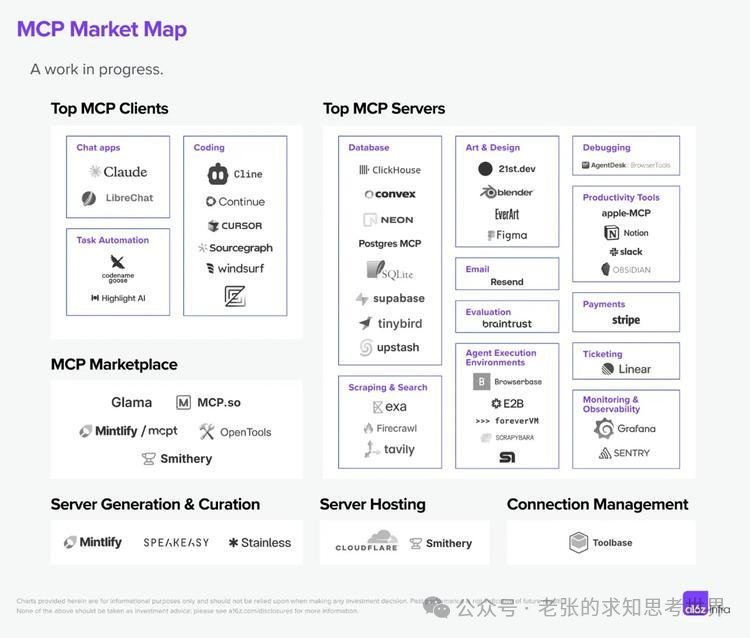

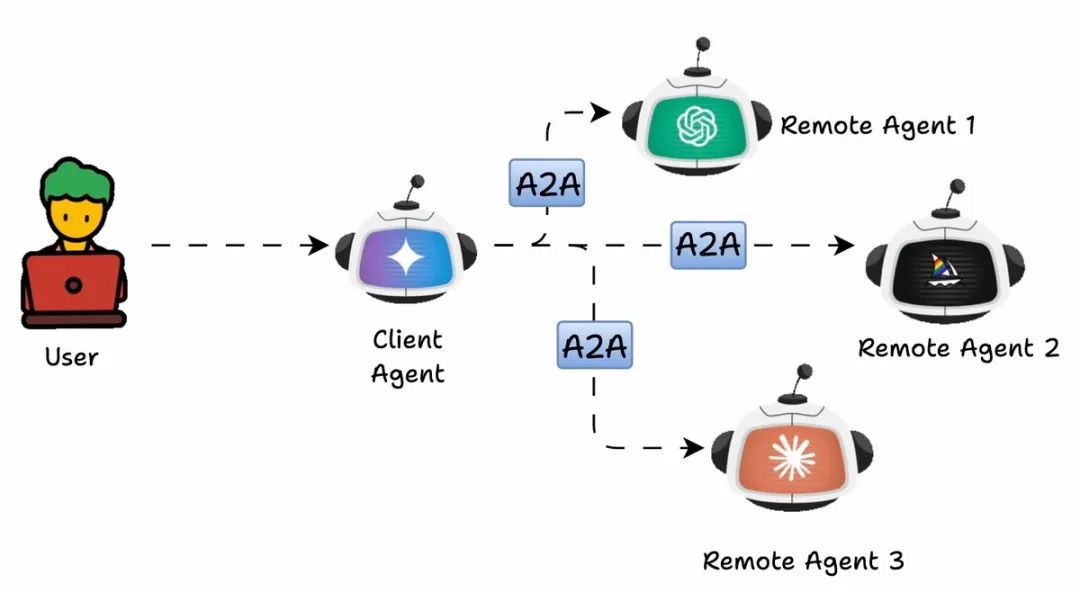

MCP vs Agent2Agent – 用最直观的图表 + 最简单的概念解释读懂这两个重要的智能体协议

MCP(Model Context Protocol):让 AI 成为你的“超级大脑” MCP 是由 Anthropic 开发的开放标准,全称为“模型上下文协议”(Model Context Protocol)。它的主要目的是将 AI 助手与外部数据源(如内容存储库、业务工具和开发环境)连接起来,帮助 AI 模型生成更高质量、更相关的响应。MCP 通过提供通用、开放的接口标准,取代了以往分散的集成…- 4

- 0

-

OpenAI深夜发布满血o3和o4mini: 两个没想到

OpenAI刚刚宣布推出其最新的o系列模型:o3和o4-mini,与以往模型不同,o3和o4-mini被设计为真正的AI系统,模型甚至能连续调用超过600次工具来完成一项艰巨任务,它们在理解和导航大型代码库(比如OpenAI自己的代码库)方面,超越了人类工程师,极大地提高了开发效率 这次发布会我有两个没想到:一是没想到o系列模型变成了一个融合的模型,另外一个是引入图像推理“Thinking w…- 5

- 0

-

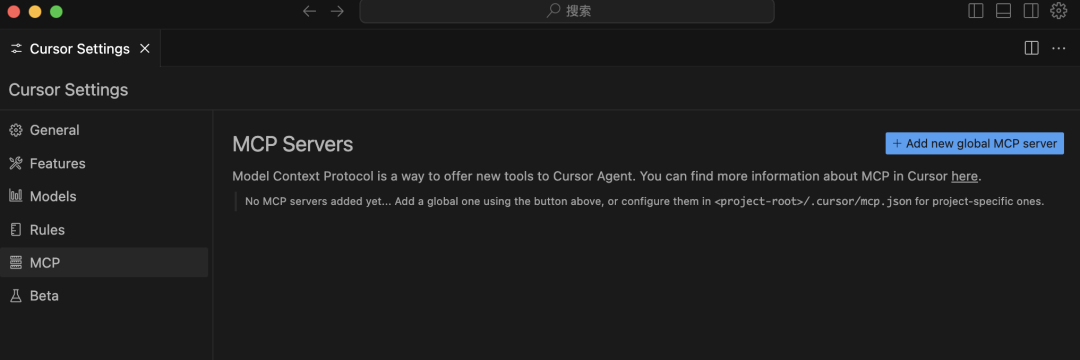

一个使用MCP最简单的方式

之前写过几篇文章分享过 MCP,最近一直在研究将 MCP 用于Agent开发中。目前支持 MCP 的客户端如 Windsurf、Cursor,都需要做一些稍微复杂的配置,申请一堆API Key,导致好多朋友都卡在了这一步。不过现在已经有一些类似一键部署使用的平台,可以让你快速上手,体验MCP,比如:魔搭社区里面有个“实验场”,点进去后,平台预制了3个MCP,可以直接体验以“高德MCP”为例,用它规…- 7

- 0

-

100行代码讲透MCP原理

阿里妹导读本文通过100行代码看到MCP的核心原理并不复杂,但它的设计巧妙深入理解使我们能够超越简单的SDK使用,创建更强大、更灵活的AI应用集成方案。当我开始研究 Model Context Protocol (MCP)接入的时候,发现一个问题,绝大多数的文档都是以 @mcp.tool 这样注解的方式注入。但如果当前有很多异步的业务流程,接入会非常麻烦,它并没有一个代码实体的存在可以加注解。难道…- 7

- 0

-

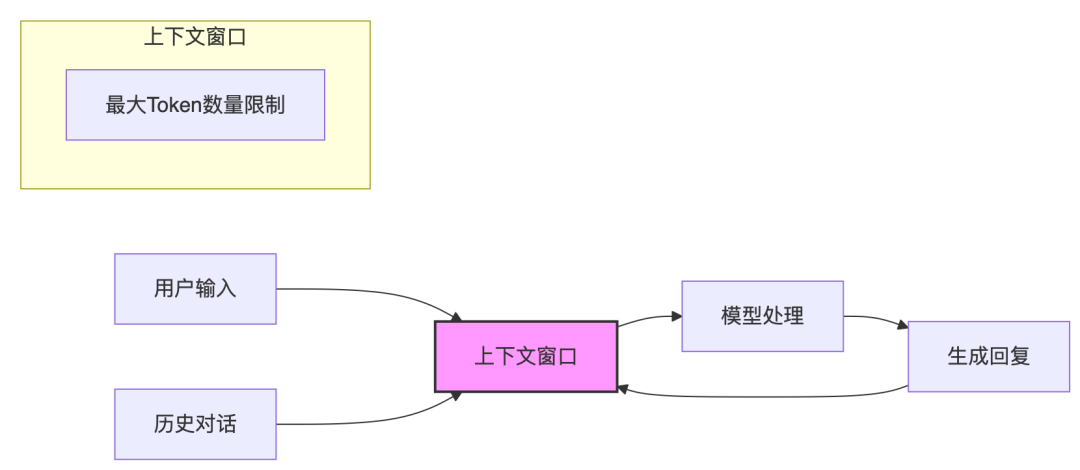

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!