-

微软掀桌,干翻Cursor。。。

关注飞总聊IT,了解IT行业的方方面面。 最近微软对Cursor出手了,直接禁了Cursor用一些插件,让Cursor的用户非常难受。 这事情说起来,要从微软这些年做的事情说起。 微软从一个对开源无比讨厌,让开源社区无比痛恨的公司,到对开源社区有巨大影响力的公司,也就几年时间。 这些年里,微软开源了Visual Studio Code,收购了GitHub,为Visual Studiocode提供了…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

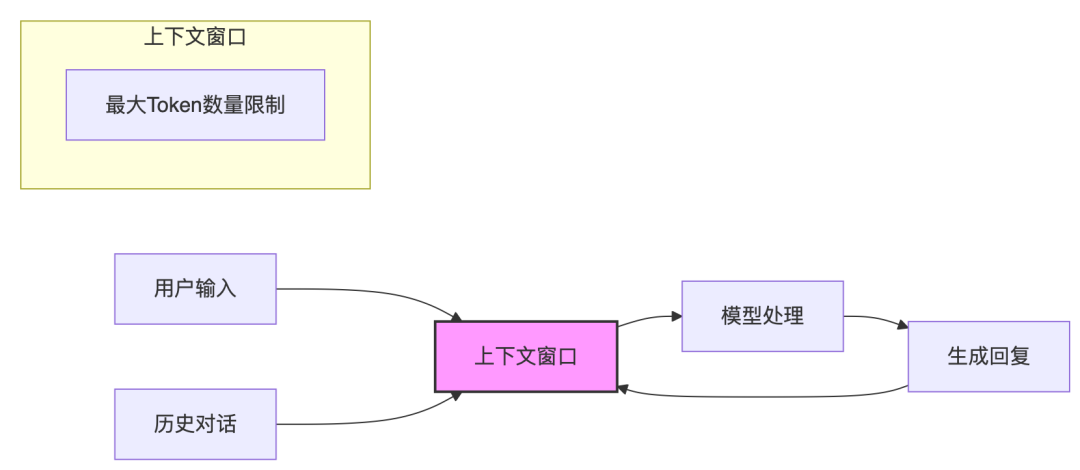

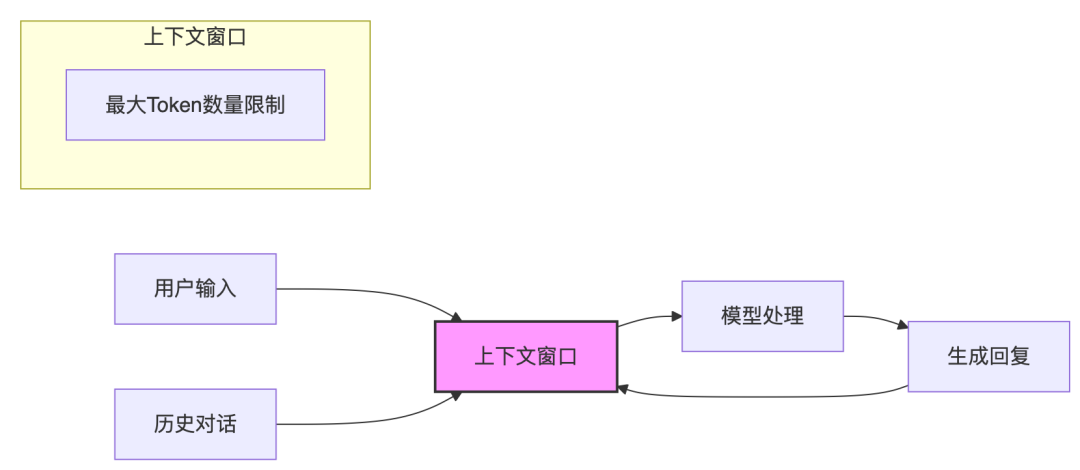

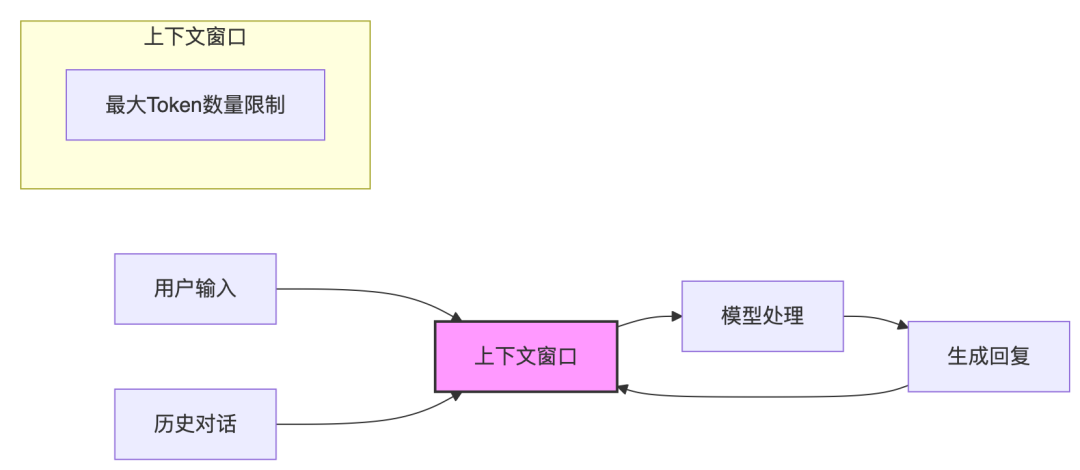

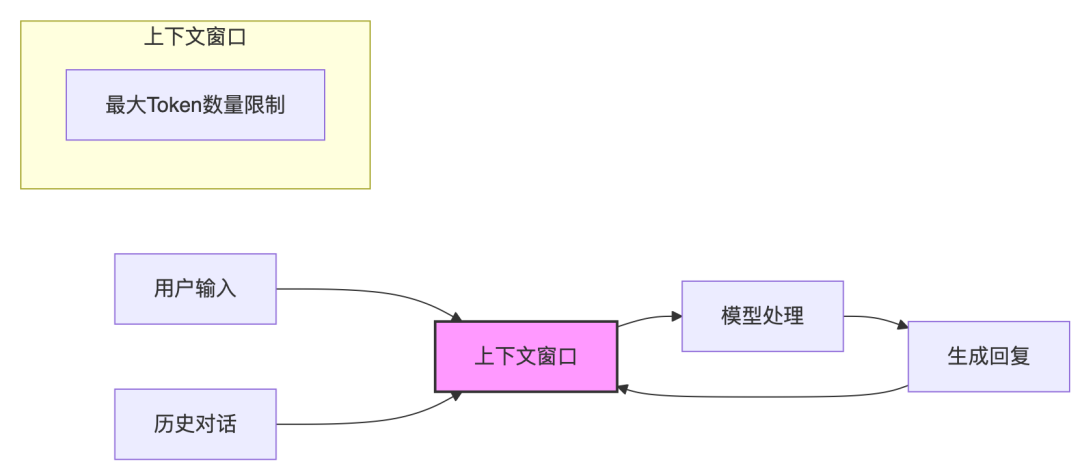

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 2

- 0

-

混合专家系统(MoE)图解指南

相关文章 大模型量化技术(Quantization)可视化指南 一文了解思维链(Chain-of-Thought, CoT) 大模型时代,智能体崛起:从技术解构到工程落地的全栈指南 ——《大模型技术30讲》 什么是大模型的幻觉?用户如何应对呢? 万字长文深入浅出文本嵌入(Text-Embedding)技术 解密大语言模型中的 Tokens 原文:https://newsletter.maarten…- 13

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

豆包,让有独立显卡的电脑都能部署本地大模型,语料库就是电脑里的文件

课件老师今天出差了一天,室友说自己睡得挺晚,在床上躺着玩一会儿手机,不一会儿,就鼾声如雷。今天真的很累,但依然坚持准备写完公众号再休息,但打开电脑,开始寻找写作素材,内容写好了,让DS生成封面提示词。打开豆包,发现它今天又更新了一个功能。本地文件问答系统给出了一行红色的小字:推荐系统配置:8GB及以上显存的 RTX GPU,i5处理器,16G内存。当前的系统配置过低,无法使用该功能很遗憾,课件老师…- 212

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 9

- 0

-

Claude3.7:六大价值场景与实践原则

在这次 AI 应用研讨会中,深入探讨了 Claude 大模型的应用场景和实用原则。 image 六大高价值应用场景 image 1. 超长文本处理与信息提取 具体场景: 会议转录稿处理:一位参与者提到,他将长达数万字的线下课程转录稿输入 Claude,让 AI 提取关键内容并生成教程。 将 AI 工作流的五种模型和示例从文档中提取,重新组织成完整教程。 对客户会议的录音转录进行分析,提取关键痛点和…- 3

- 0

-

OpenAI姚顺雨:欢迎来到AI下半场!

作者:Shunyu yao (OpenAI)原文:https://ysymyth.github.io/The-Second-Half>> 加入青稞AI技术交流群,与青年AI研究员/开发者交流最新AI技术 摘要:我们正处于人工智能的中场。 数十年来,人工智能主要致力于开发新的训练方法和模型。这一策略成效显著:从国际象棋和围棋击败世界冠军,到在 SAT 和律师资格考试中超越大多…- 4

- 0

-

为了让大魔听懂 MCP是什么,我写了MCP的前世今生

?MCP的本质是为了让模型“看得见世界,动得了手脚”。之前假期我们用MCP做了聚会规划,我觉得体验还蛮不错的,我去和大魔、相柳聊对MCP的看法;洋洋洒洒的说了一堆之后,大魔问我:什么是MCP?有什么用,说点小白能听懂的。 后边也有几个小伙伴问我类似的问题,并且有的上手用了之后也会很困惑,这个MCP到底有点啥用,这些功能看起来不用MCP也能搞定呀。 因此写了这篇文章,希望跟大家聊聊MCP是怎么发展出…- 3

- 0

-

o3来了,非常出色!

速览 1. 代理性能强大o3可以自动串联使用多种工具(如网络搜索、代码解释器、提醒功能),能独立完成复杂任务,设置后可在短时间内返回全面答案。 2. 速度惊人测试表明o3的响应速度优于Anthropic的3.7 Sonnet和Google的Gemini 2.5 Pro等竞争模型,提供流畅的用户体验。 3. 推理能力出色能轻松解决专家级数独等复杂问题,显示出卓越的逻辑推理能力。 4. 突破ChatG…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

LLM中的Token和Embedding到底是啥?

点击蓝字关注我们 01 引言 GPT4 Turbo 的上下文长度为 128K 个Tokens。 Claude 2.1 的上下文长度为 200K 个Tokens。 那么问题就来了。。。 上文中的Tokens到底是什么? 我们来看个简单的示例:输入句子 “It’s over 9000!” 我们可以将其表示为 ["It's", "over", "…- 7

- 0

-

12项Agent智能体开发框架入门与选型丨工具对比分析与选型建议!

本文由九天老师公开课内容整理而成,根据老师的详细讲解中可以看出,当前大模型Agent开发框架生态非常丰富,主要分为以下几类: 一、Agent开发框架分类与技术深度解析1. 低代码框架:敏捷开发的入口 代表工具:Coze(字节跳动)、dify(国内开源)、LangFlow(LangChain生态) 技术特点: 可视化编排:支持拖拽式工作流设计(如Coze的节点式编辑器),内置预置模板(客…- 5

- 0

-

OpenAI姚顺雨:AI 的后半场,将从解决问题转向定义问题

AI 的分数在榜单上节节攀升,却未必真正转化为现实世界的效率提升与广泛效用。 2025 年的焦点,不再是“模型能考几分”,而是“能做多少事”。 这也日渐成为共识。 就在 o3 新模型即将发布之际,OpenAI 研究员、ReAct 框架提出者姚顺雨发表了文章《The Second Half》,从底层范式的角度,深刻反思了现有测评方式的局限。 (原文链接:https://ysymyth.github.…- 3

- 0

-

揭秘大模型的魔法:从零开始你的AI冒险

你好,我是写代码的中年人!你有没有想过,那些能写诗、答题、甚至帮你 debug 代码的 AI 到底是怎么回事? 它们其实是“大型语言模型”(Large Language Models,简称 LLM)的产物。今天,我要带你踏上一场从零开始的 AI 冒险,揭开大模型的神秘面纱,看看它们是怎么从一堆代码和数据变成“聪明大脑”的。 这篇文章不仅会让你get到大模型的硬核原理,还会点燃你自己动手打造一个的热…- 3

- 0

-

为DeepSeek提供“联网搜索”功能的这家公司,把价格打到了Bing的1/3

腾讯科技《AI未来指北》特约作者 晓静编辑 郑可君 在当下所有通用AI对话产品的界面上,"联网搜索"已成为标配功能。 这个看似简单的按钮背后,隐藏着大模型连接现实世界的密钥——没有实时信息获取能力,再强大的AI模型也只能是知识停留在训练截止日的"数字化石"。 鲜为人知的是,目前国内超过60%的AI应用,包括DeepSeek的C端应用,联网搜索能力是通过集成博…- 4

- 0

-

详解 MCP 核心架构

MCP 协议核心架构 MCP 协议遵循互联网常见的 C / S 架构,即客户端(Client)- 服务器(Server)架构。 MCP 协议引入了主机(Host)的概念,组成了基本的主机(Host)- 客户端(Client)- 服务器(Server)架构。 接下来,我们详细解析架构中的每一部分及其功能。 1. 主机MCP 协议里的主机就是大模型应用,类似 Claude 桌面客户端、Cursor 编…- 13

- 0

-

从模型原理到代码实践,深入浅出上手Transformer,叩开大模型世界的大门

序言作为非算法同学,最近被Cursor、DeepSeek搞的有点焦虑,同时也非常好奇这里的原理,所以花了大量业余时间自学了Transformer并做了完整的工程实践。希望自己心得和理解可以帮到大家~如有错漏,欢迎指出~本文都会以用Transformer做中英翻译的具体实例进行阐述。 从宏观逻辑看Transformer让我们先从宏观角度解释一下这个架构。首先 Transformer也是一个…- 8

- 0

-

Reranker模型应用场景、技术实现与性能对比

一、主流Reranker模型分类与特点1. 商业在线模型(如Cohere Rerank、Jina Reranker)核心场景:适用于多语言搜索、快速集成且无需本地部署的场景(如电商搜索、跨语言问答)。技术架构:Cohere基于API调用,支持长上下文和混合检索(向量+关键词);Jina Reranker v2采用交叉编码器架构,推理速度比BGE-Reranker快15倍,支持函数调用和代…- 12

- 0

-

大模型应用开发入门分享

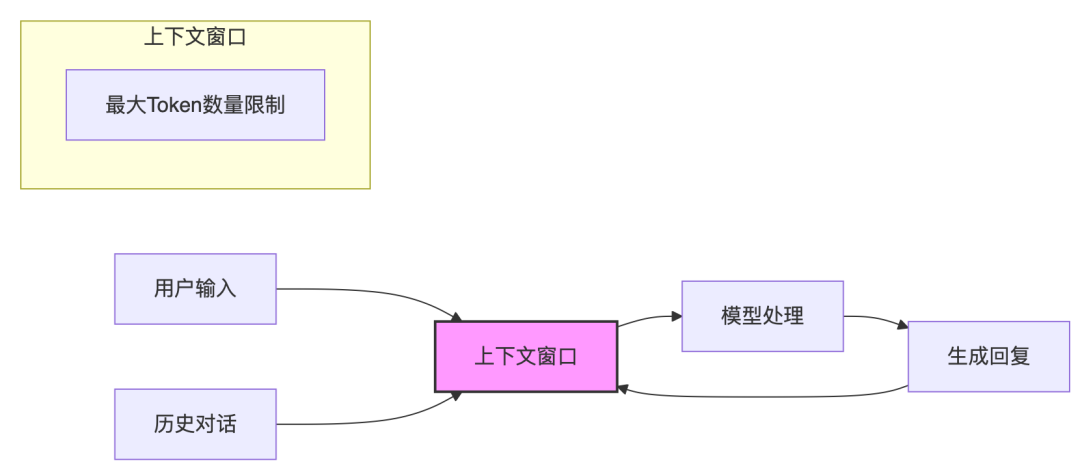

阿里妹导读本文是作者给兄弟团队做的大模型入门分享,介绍了基本大模型模式,分享出来希望帮助更多的同学参与到LLM应用建设。前言大模型作为新兴领域,不断地冒出来新的专有术语和新的概念,让大家觉得很神秘,捉摸不透。但是大部分复杂性的背后都会有一个极其简单便于理解的模型,本次分享最主要就是大模型的基本范式,通过范式将这些神秘感去除。 大模型虽然很厉害,很神秘,但作为使用人员,门槛是非常非常非常低的。 模型…- 7

- 0

-

让大模型可以轻松读取代码仓库:MCP-Repo2LLM

MCP-Repo2LLM下载地址https://github.com/crisschan/mcp-repo2llm概览mcp-repo2llm 是一个 MCP 服务器,专门将代码仓库转化为适合大语言模型(LLM)处理的高效格式。它是一个强大的工具,能够无缝连接传统代码库与现代 AI 语言模型,帮助开发者更好地利用人工智能技术。这款工具是在 RepoToTextForLLMs 的…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

Altman 正在悄悄打造“AI版X”?ChatGPT社交功能曝光

ChatGPT,不满足只做你的 AI 工具,它还想成为你刷信息流的地方。 OpenAI 内测社交信息流功能,“yeet”发布内容,或将改写我们使用 AI 的方式。一边是热度爆棚的图片生成功能,一边是持久记忆的新能力,这次的野心不小。▍发生了什么?据多位知情人士爆料,OpenAI 内部正在测试一项类似 X(原 Twitter)的社交信息流功能,原型已经上线,用户可以像发帖一样在 ChatGPT 里发…- 7

- 0

-

微软AI核心战略解密:让OpenAI冲锋陷阵当炮灰,采用跟随者策略坐收技术红利

微软人工智能首席执行官穆斯塔法·苏莱曼(Mustafa Suleyman)近日在电视采访中阐述了"跟随者策略"的经济效益。这位曾共同创立DeepMind(2014年被谷歌收购)、后短暂担任Inflection AI CEO的技术领袖,现为微软制定AI发展路线。图 | 穆斯塔法·苏莱曼(Mustafa Suleyman)(来源:《麻省理工科技评论》) 在CNBC上周五播出的专访中…- 5

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!