-

热门 MCP Server一键部署

全球 AI 开发者们热议“MCP”(Model Context Protocol)。尽管这一协议在2024年由Anthropic发布时并未引起广泛关注,但2025年初,Cursor宣布集成MCP迅速将其带入开发者的视野,3月Manus的爆发更是加速了MCP的普及。而就在3月27日,OpenAI正式宣布其Agent SDK全面支持MCP协议,这一举措标志着MCP将会成为该领域的实施标准,必将重塑AI…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

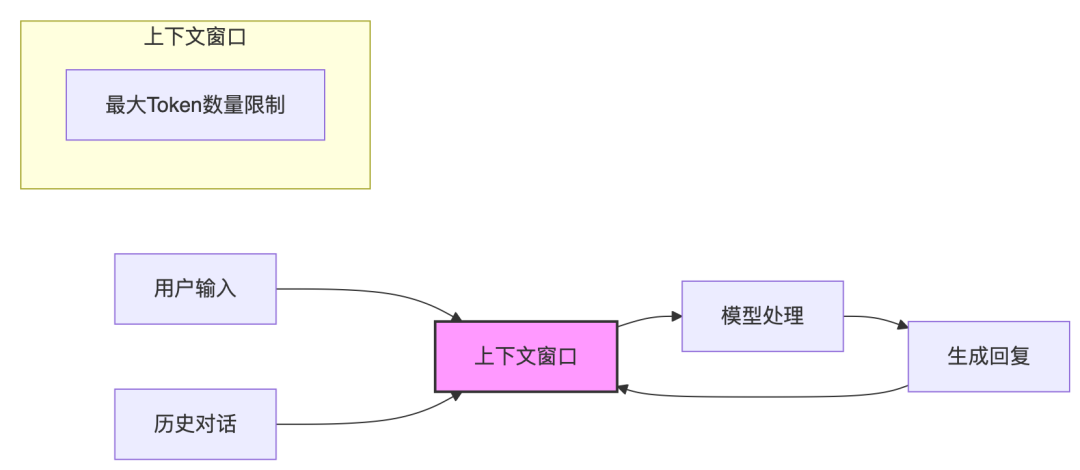

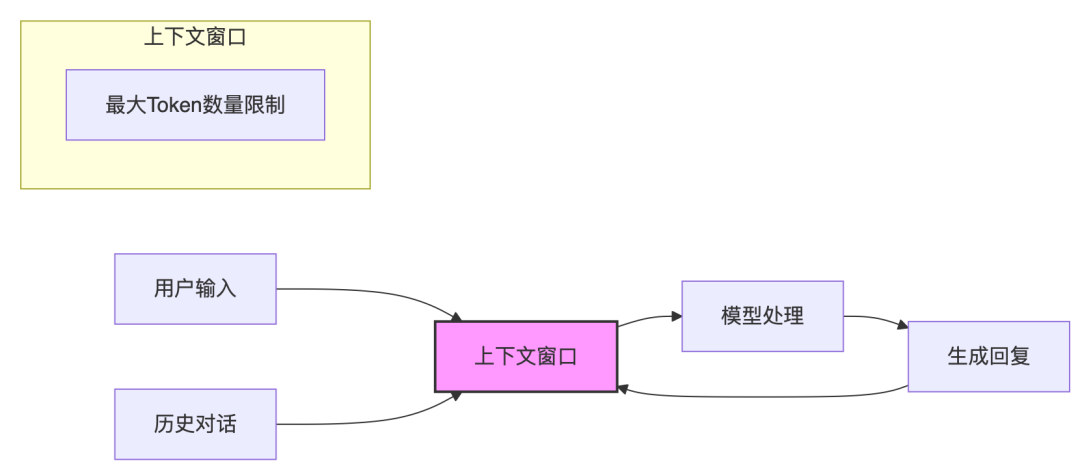

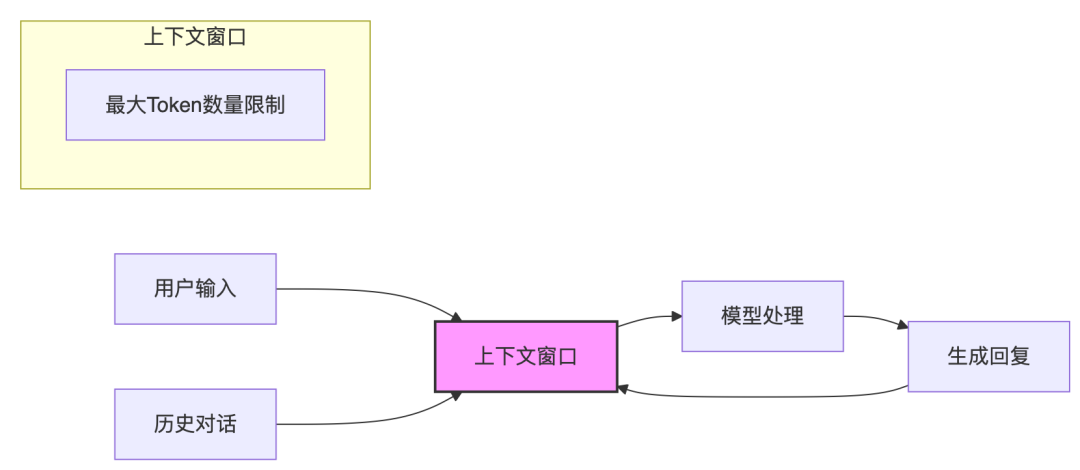

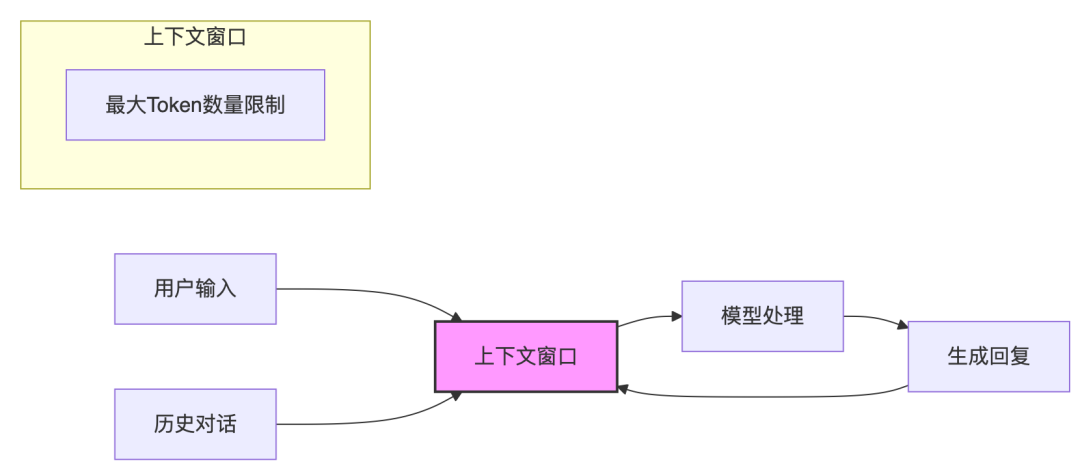

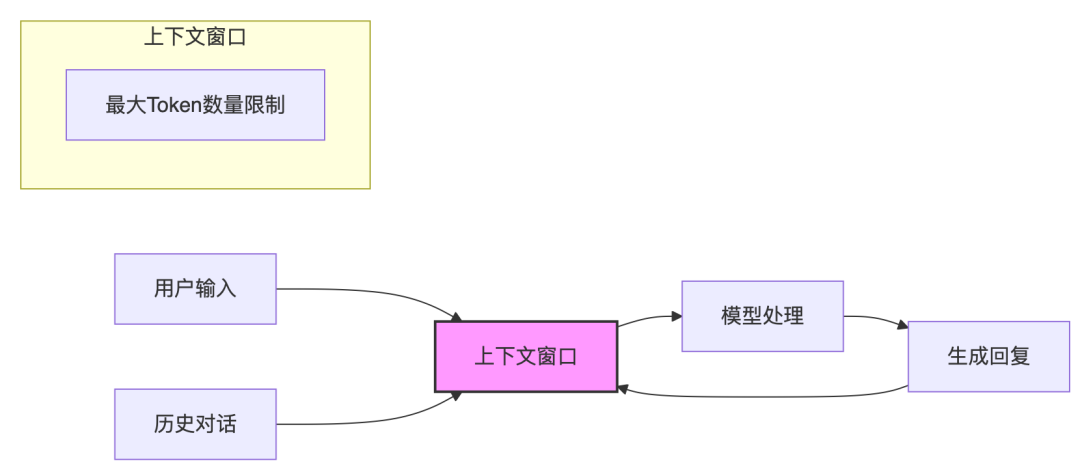

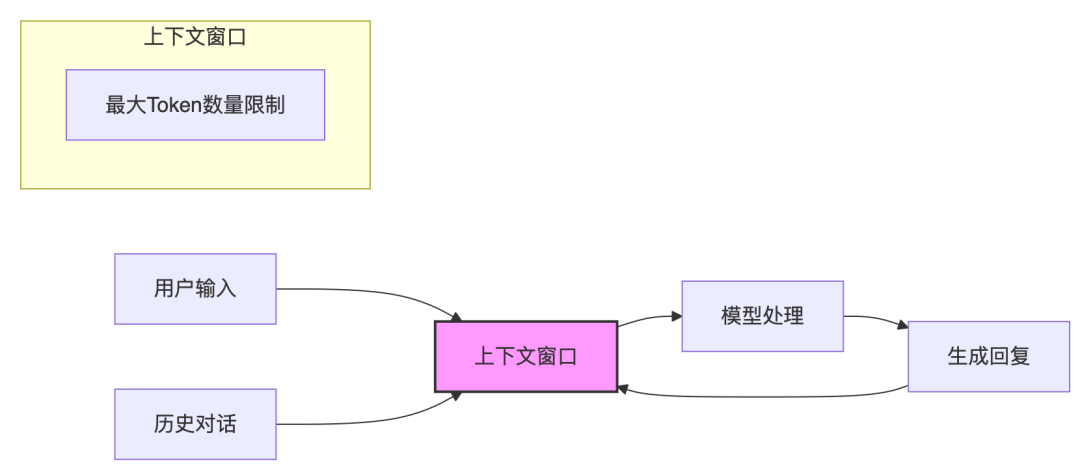

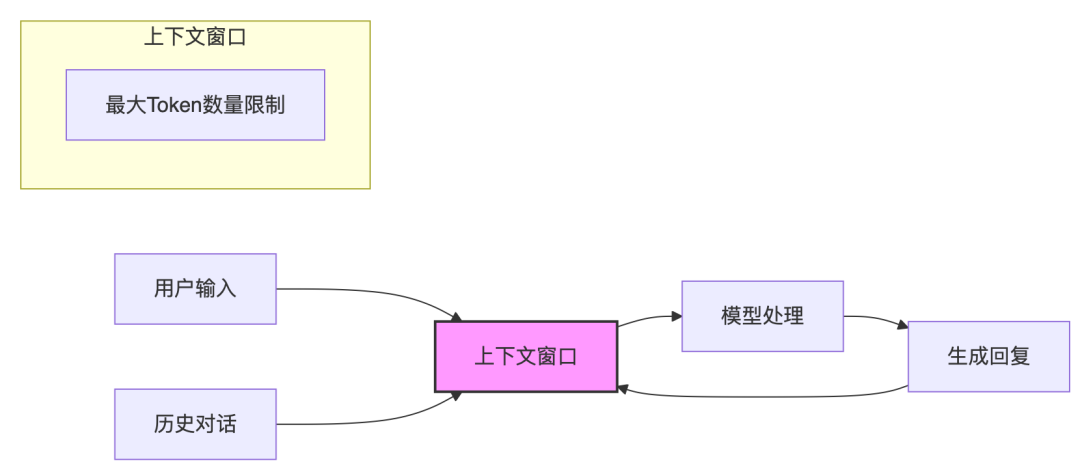

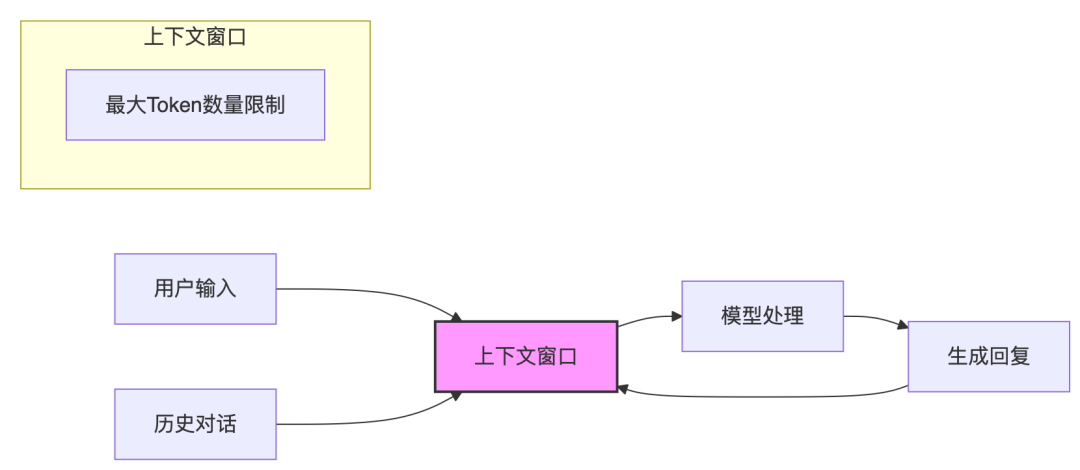

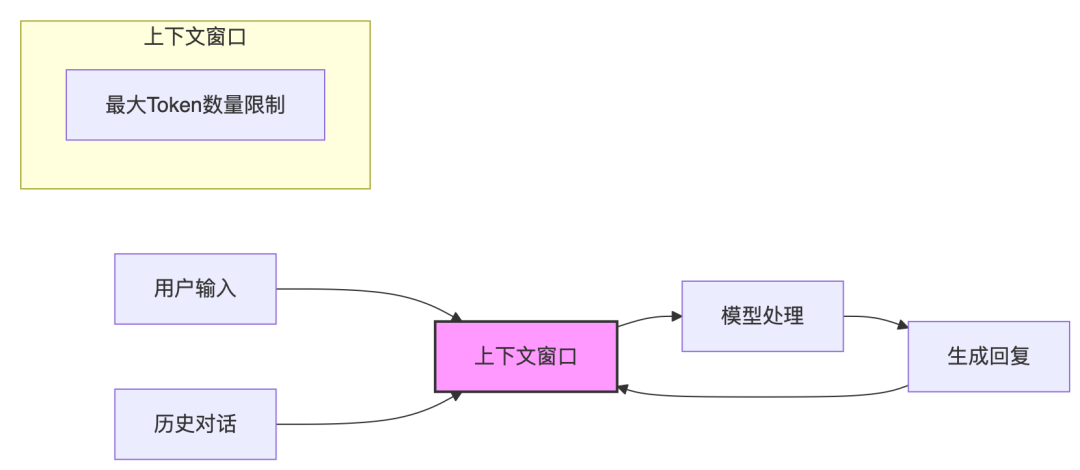

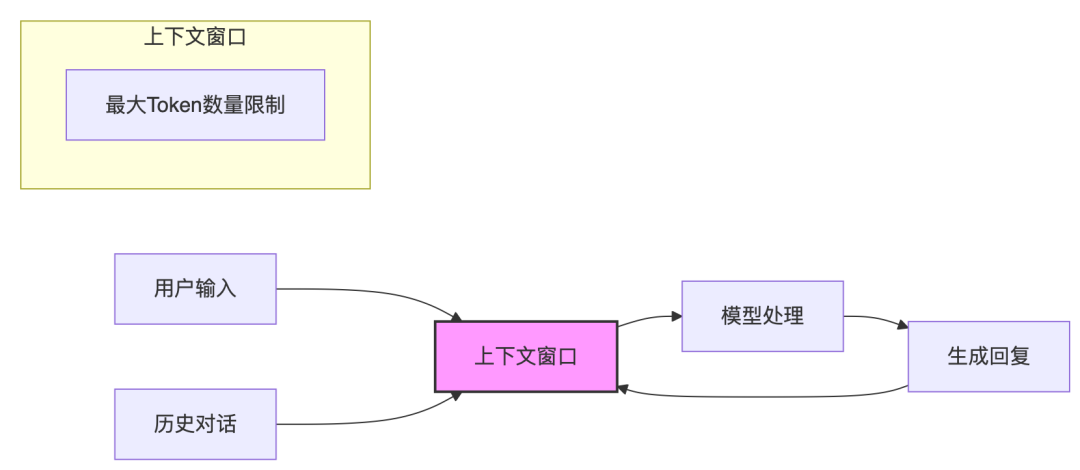

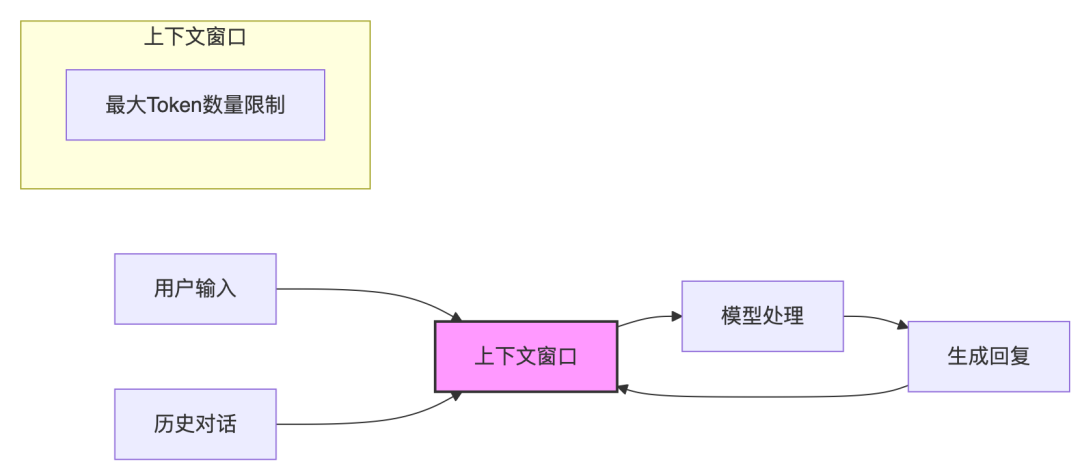

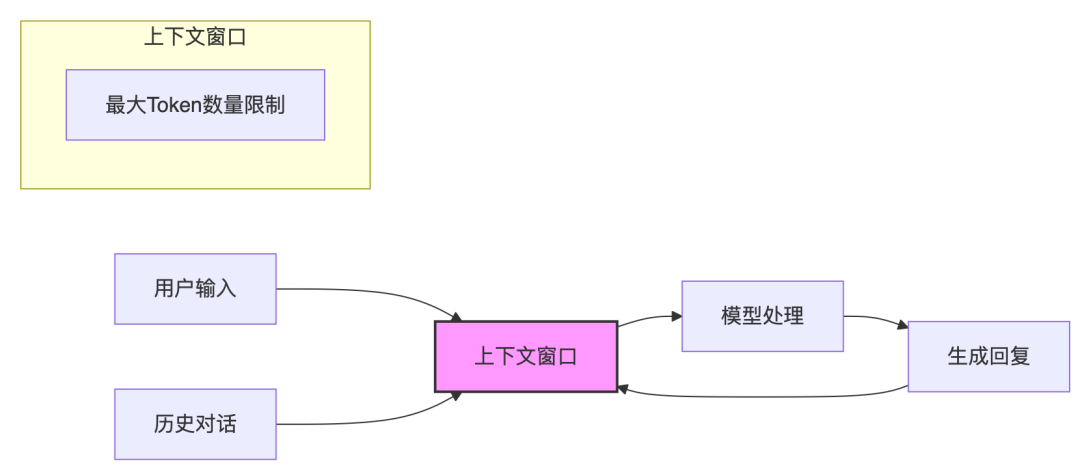

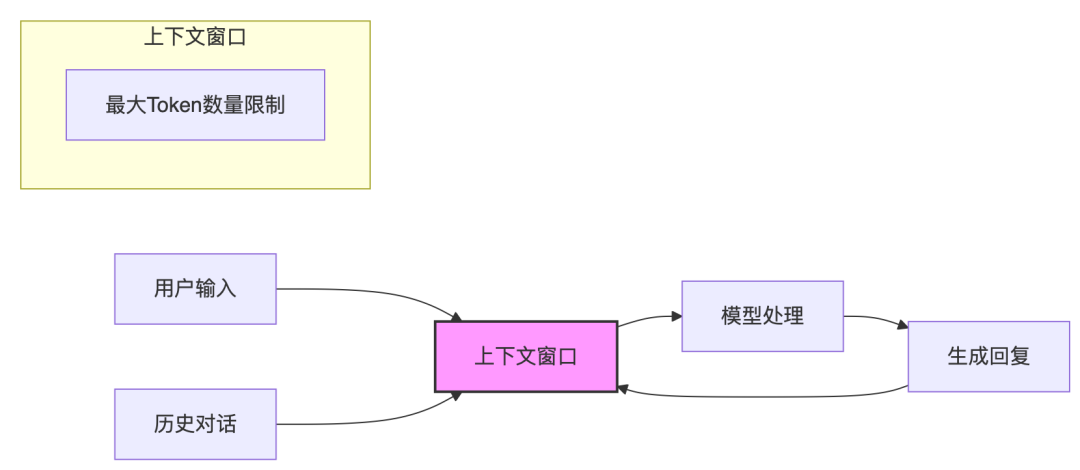

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

一文读懂AI 智能体中MCP、API与Function Call

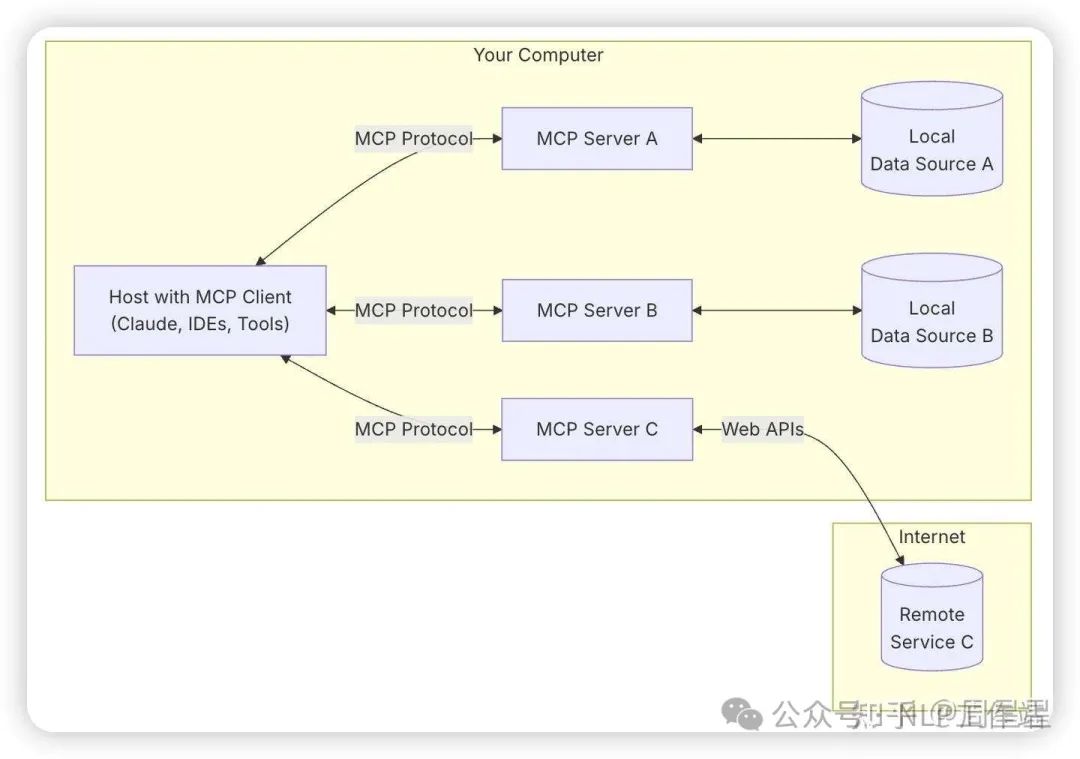

引言 随着人工智能技术的快速发展,大语言模型(LLM)与外部系统交互的需求日益增长。在这一背景下,API、Function Call和MCP(Model Context Protocol)作为关键交互机制,各自扮演着不同的角色。本文将深入探讨这三种技术的概念、特点、应用场景以及在AI Agent中的作用,通过具体例子帮助读者全面理解它们之间的异同。 基本概念与定义 API (Application…- 7

- 0

-

一文汇总大模型推理框架!

大型语言模型(LLM)已成为驱动智能客服、内容创作、代码生成等领域变革的核心力量。推理框架作为LLM高效部署的关键组件,直接关系到应用的性能、成本和开发效率。本文罗列常用大模型框架的特点,以供实际应用需要!一、高性能推理框架选型1. vLLM核心优势PagedAttention技术:突破传统KV缓存机制,实现显存分页管理,支持超长序列生成(如10万token对话)吞吐量领先:在A100 …- 8

- 0

-

智谱CEO张鹏:模型仍是核心,工程化只是权宜之计

3月31日,智谱宣布发布最新Agent产品AutoGLM沉思。AutoGLM沉思能一边进行复杂思考,一边执行操作,像人类一样打开并浏览网页,完成从数据检索、分析到生成报告。此前,Manus开放给部分用户内测,把通用Agent概念推向高潮,甚至有超百万人排队等待。近日,Manus上线了海外版APP,并公布了两种收费方案:每月39美元/199美元。而智谱AutoGLM沉思上线后,免费不限量。智谱CEO…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

All in 医疗,百川胜算几何?

一、战略聚焦:医疗AI突围01发布儿科大模型 2025年3月20日,百川智能与北京儿童医院、小儿方健康合作,发布了全球首个儿科大模型“福棠·百川”。 该模型覆盖儿童常见病和疑难病症,具备强大的临床推理能力,并首创儿科“循证模式”,能像专业儿科医生一样整合最佳医学证据,为患儿制定科学、个性化的诊疗方案。 此外,基于该模型,百川智能推出了“福棠·百川”AI儿科医生专家版和基层版,计划在国家区域医疗中心…- 29

- 0

-

数势科技黎科峰:CEO们极度焦虑,怕错过AI时代

该图片由AI绘制而成 腾讯新闻《海拔7950》 特约作者 徐昙 “我们知道将迎来一个AI变革时代,但我们不知道现在该干什么。”这或许是很多公司面临的困惑。 2025年春节之后,现象级技术突破DeepSeek横空出世,各种AI概念满天飞,各种AI海量信息持续轰炸,很多CEO怀疑,公司内部是不是过于平静了,是不是内部人员的思路没有跟上时代。外面的讨论热火朝天,为什么技术岗们还没有行动? 数势科技的创始…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

奇点降临,Manus 诞生背后丨青源Workshop观点集锦

第32期青源Workshop以《迈向Super Agent,从Manus谈起》为主题,活动邀请到MetaGPT作者诸葛鸣晨、浙江大学软件学院百人计划研究员张圣宇、西湖大学AGI实验室研究员蒋文嘉、开源社联合创始人林旅强、人工智能研究员&创业者史业民以及智源社区白羽中共同参与。这场技术浪潮不仅点燃了Agent领域的热情,更引发了关于落地应用与未来方向的思考。当通用智能体从概念走向现实,我们究…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

Copilot:您的AI伴侣-微软50周年系列更新

回顾微软五十年来持续创新带来的深远影响,比尔·盖茨当年"让每张办公桌、每个家庭都拥有电脑"的宏伟愿景至今仍激励着我们。微软AI团队正秉承同样的精神,打造属于每个人的AI伙伴——Copilot。 这意味着什么?它是什么模样?有何功能?事实上,答案因人而异。 真正的AI伙伴是完全个性化的,围绕个人需求、价值观和期待构建。因此最终会有多少用户,就会有多少种独特的Copilot。如今,…- 6

- 0

-

基于Flow-matching的扩散模型原理解读

作为一种新的商品表现形态,内容几乎存在于手淘用户动线全流程,例如信息流种草内容、搜索消费决策内容、详情页种草内容等。过去一年,我们通过在视频生成、图文联合生成等核心技术上的持续攻关,AIGC内容生成在手淘多个场景取得了规模化落地价值。本专题《淘宝的AIGC内容生成技术总结》是我们摸索出的一部分实践经验,我们将开启一段时间的内容AI专题连载,欢迎大家一起交流进步。 第一篇《淘宝内容AI团队2024年…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

如何看待MCP?大模型工具调用的解耦!

知乎:https://zhuanlan.zhihu.com/p/1891971357694219896 (已授权) 最近,Agent特别火,而Anthropic提出的MCP(Model Context Protocol)更是被部分文章吹得神乎其神。但我发现市面上关于MCP的资料要么太浅,只是说"这是个像USB一样的通用协议",让人一头雾水;要么太深,直接扎进源码里,看得头晕眼花…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

如何理解政务大模型?

从去年开始,政务大模型就受到了大家的关注,本号也发了几篇相关的文章。由于DeepSeek的横空出世,使大家对大模型的热情空前高涨,各地区也都陆续推出了基于DeepSeek的很多应用。这是好事,但如果不正确理解认识政务大模型,有可能将来会适得其反。为此,本期就聊一下这个话题,希望能为大家能提供一些参考。 一、政务大模型现状 经过一年多的发展,政务大模型得到了一定认可,且热度一直不减。但从政务服务行业…- 6

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!