-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

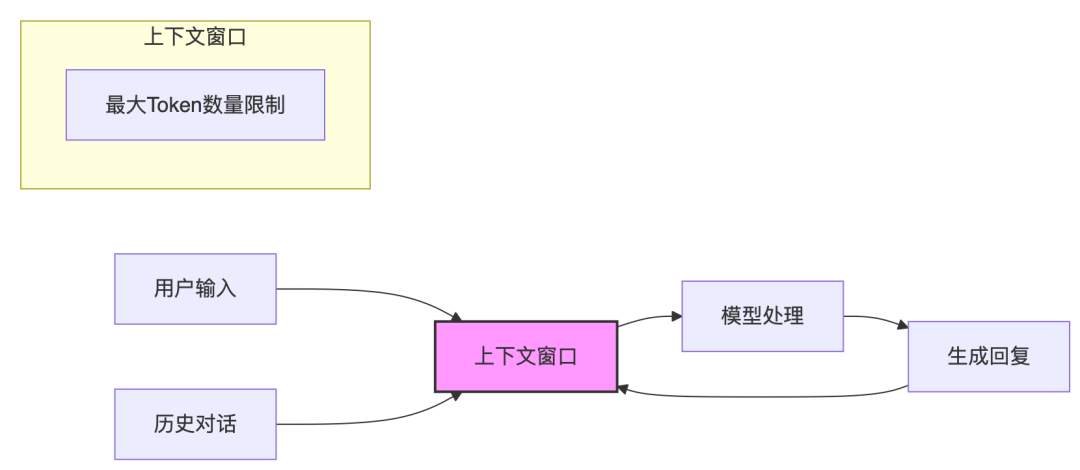

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

高德、腾讯、百度地图布局 MCP Server 对比分析

高德、腾讯、百度地图,三家地图服务商都已经布局MCP Server,为AI大模型与地图服务的结合提供了便捷的接口。以下是根据三家公司公开文档,给出的功能对比,开发者可以根据自身需求、技术架构和已有的地图服务集成经验选择适合的 MCP Server。 MCP协议概述 MCP(Model Context Protocol)协议是为了解决AI大模型与外部工具交互的统一规范,使得一个工具无需额外适…- 5

- 0

-

大模型的分类及技术指标

一、大模型的分类 1. 按应用领域划分 通用型大模型:适用于多种任务(如GPT系列、PaLM),具备跨领域的语言理解与生成能力。 垂直型大模型:针对特定领域优化(如医疗、金融、法律),例如百川智能的医疗大模型。 多模态大模型:融合文本、图像、语音等多种输入形式(如DeepSeek的多模态版本)。 2. 按模型架构划分 密集模型(Dense Models):全连接参数结构,如G…- 4

- 0

-

警惕“技术名词崇拜”,回归实际需求–伪AI产品盘点

真正的AI技术需同时满足自主决策、多模态交互、持续进化三大核心能力,并与硬件、场景深度耦合。识别伪AI时可重点验证其是否具备动态优化能力(如仅依赖预设规则则为伪AI)。 1.自主决策与动态优化能力 核心表现:AI系统无需人工干预即可根据环境和数据动态调整策略。 技术支撑:依赖强化学习和深度神经网络实现端到端决策闭环。 2.多模态自然交互能力 交互形式:支持文本、语音、图像等多模态…- 2

- 0

-

伯克利最新研究:为什么多 Agent 系统总是“高期待、低表现”?

最近在捣鼓多 Agent 系统,但是遇到了好多坑……看了一篇伯克利的研究后非常有感触,分享给大家。 伯克利的研究者们近期对多智能体系统(Multi-Agent Systems, MAS)“高期待,低表现”的问题进行了系统研究,找到了问题的原因所在,并探索了对应的改进措施。这篇文章对于我们进行多 Agent系统实践非常有指导意义,既可以定位问题所在,也会对解决相应问题有一定的启发。这一篇,我将会带来…- 6

- 0

-

可观测性成为ML和LLM应用的最大挑战

生产环境 ML 模型面临可观测性挑战!定制工具成主流,仅7%关注ML安全。企业纷纷试水 GenAI 和 LLM,预测分析、计算机视觉应用激增。MLOps、LLMOps、GenAIOps 崛起,LLM 可观测性至关重要!OpenAI、AzureAI、Amazon Bedrock 受青睐。 译自:ML and LLM Adoption Challenged Most Often by Observ…- 4

- 0

-

刚刚,DeepSeek公布推理时Scaling新论文,R2要来了?

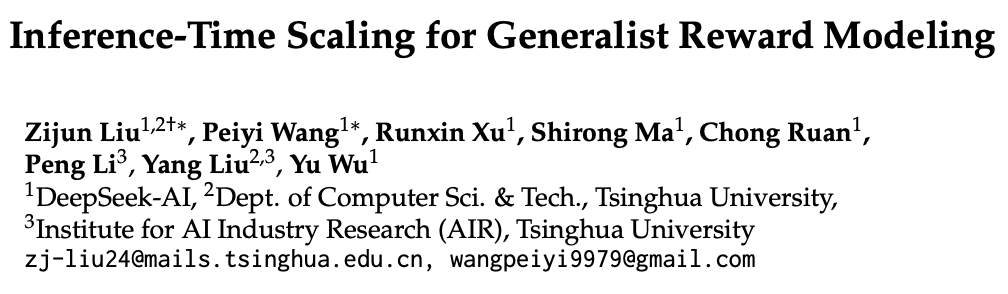

机器之心报道 机器之心编辑部一种全新的学习方法。 这会是 DeepSeek R2 的雏形吗?本周五,DeepSeek 提交到 arXiv 上的最新论文正在 AI 社区逐渐升温。 当前,强化学习(RL)已广泛应用于大语言模型(LLM)的后期训练。最近 RL 对 LLM 推理能力的激励表明,适当的学习方法可以实现有效的推理时间可扩展性。RL 的一个关键挑战是在可验证问题或人工规则之外的各个领域获得 L…- 4

- 0

-

【AI知识点】什么是 Agentic Workflows?

最近在weaviate的博客看到一篇介绍Agentic Workflows的文章,写得非常好,介绍给大家。 如果说 Agent 是行动的智能体,那 Workflows 就是它完成任务的路径。今天就来聊聊这个组合背后的逻辑、能力,以及我觉得它很有潜力的原因 ✨。 What Are Agentic Workflows? Patterns, Use Cases, Examples, and More ?…- 5

- 0

-

谷歌随OpenAI强势入局,劈柴4天闪电部署Gemini+MCP!

新智元报道 编辑:NJ【新智元导读】3月31日,谷歌CEO劈柴哥抛出一句「To MCP or not to MCP」,引发热议。4天后,Gemini更新API文档,正式宣布接入MCP。至此,OpenAI、谷歌、Anthropic等AI巨头全部投入「Agent协议」MCP的怀抱。3月31日,谷歌CEO Sundar Pichai(劈柴哥)发出灵魂一问:To MCP or not to MCP…- 4

- 0

-

AutoGLM 发布之后,如今国产大模型终于长出了手。

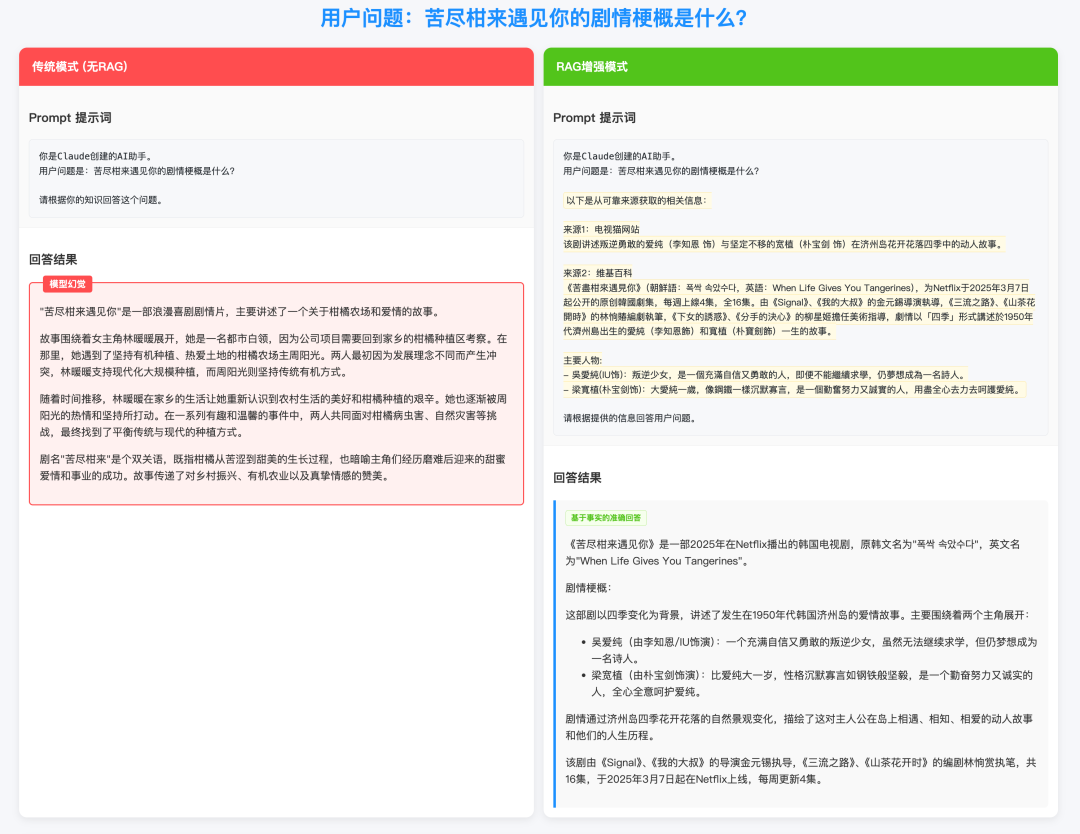

本文将深入讨论:大模型深度挖掘资料的产品方案,以及作为用户,怎样用好大模型的深度挖掘能力,满足日常工作使用需求。全文阅读预计 12 分钟。主要内容:1、介绍 AI 深度研究产品的主要瓶颈 2、大模型具备执行工具能力(MCP)意味着什么 3、怎样用好大模型深度研究的能力在过去的两年里,ChatBot 是最常见的形态,在写作、常规问答,资料总结等越来越多的方面实实在在帮助到我们。 但大模型在专业领域比…- 5

- 0

-

Llama4:最多2万亿参数,原生FP8的教师模型,不支持FP8的智算中心再次被暴击!!!

3个基本结论:1.llama 4 跟deepseek一样,采用原生FP8训练,不支持FP8的算力中心再次被暴击,更加坚信了我们认为下一代算力中心是FP4的技术判断《下一代智算中心,一定要选FP8、FP6、FP4的AI芯》,还是那个结论:不支持FP8的算力中心已经淘汰,转入残值处理阶段!《智算中心不会过剩,但会过时!!!》 2.llama4 最高2万亿参数的教师模型再次领先全球,教师模型竞争加速sc…- 6

- 0

-

咱QwQ 32B就够了?Llama4还要2000B?!

首先结论:参数越大,模型能力越强,这个结论持续有用,scaling law 并没有失效,堆参数依然可以提高模型能力。 在AI领域,模型参数的“军备竞赛”似乎永无止境,你追我赶,马上会有,R2、GPT-5、Qwen3 、文心-5卷起来,重点卷多模态,多模态计算量更大,低精度混训更加重要... 关于选择什么模型和多少参数,现在越来越有意思,我们认为moe适合聊天类场景,微调还是…- 8

- 0

-

阿里巴巴MNN在端侧大模型高效部署上的技术创新与实践

导读 在人工智能飞速发展的时代,端侧大模型因其在隐私保护、个性化服务和成本控制等方面的优势,受到了越来越多的关注。随着端侧设备(如手机、PC、平板等)的算力、内存和磁盘空间不断提升,将大模型部署到移动端已从理想逐渐变为现实。AI 手机、AI PC,甚至 AI 汽车等创新产品正逐步进入大众视野,成为技术发展的新趋势。 作为专注于端侧 AI 推理的引擎,MNN 近期在大模型的端侧部署领域进行了深入的探…- 4

- 0

-

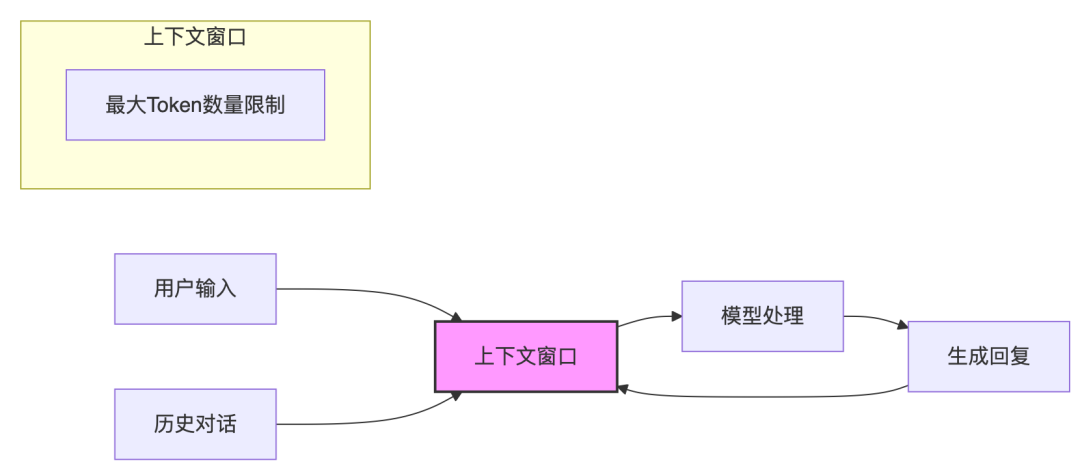

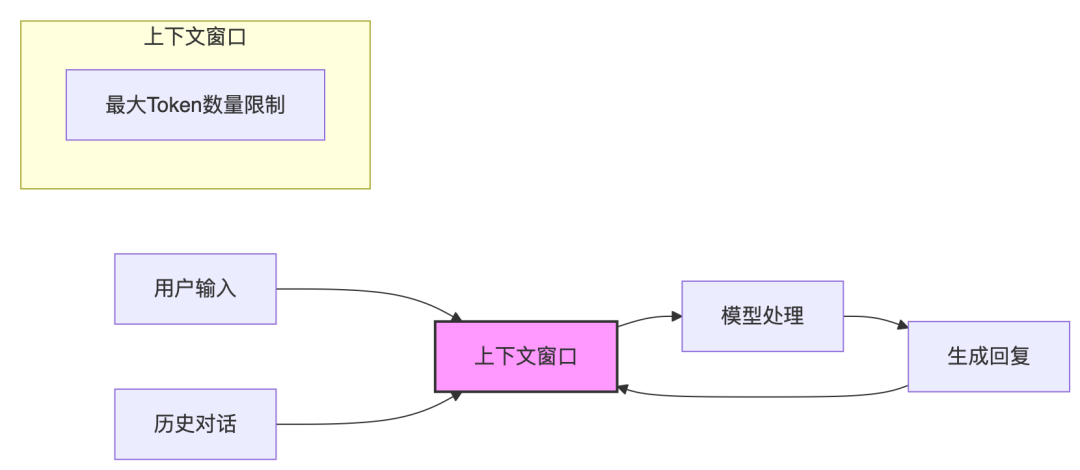

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 9

- 0

-

VSCode发布Agent+MCP,Cursor劲敌又回来了?

近日,微软旗下的 Visual Studio Code(简称VS Code)发布了3月更新(1.99版本),正式将 Agent Mode 功能引入稳定版,这一消息引起了开发者社区的广泛关注。 重磅功能:Agent Mode 正式登陆 Agent Mode 是什么?简单来说,它是 VS Code 内置的智能助手模式,能让 AI 自动执行各种编程任务。之前,这项功能只在预览版中提供,现在已正式进入稳定…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

Llama 4 发布:我看到了 DeepSeek 的影子

Llama 4 发布了。 https://huggingface.co/meta-llama Llama 4 的三款模型 但这次,它没有高调宣称参数量“遥遥领先“,而是通过三款模型来重新布局: • Scout:109B 参数,17B 激活,16 专家 MoE,可部署在单张 H100 上,10M token 长上下文,适用于文档分析、多轮对话、代码等任务 • Maverick:400B 参数…- 7

- 0

-

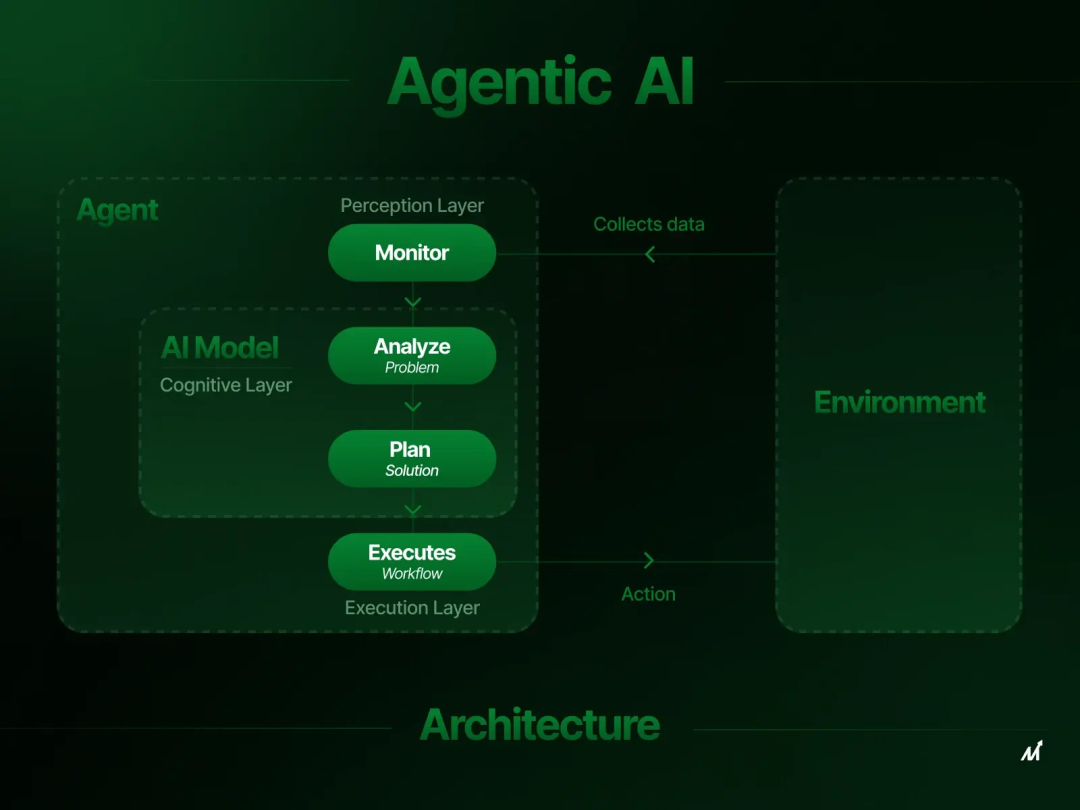

深入解析Agentic AI架构:如何打造自主决策的智能体?

在人工智能的浪潮中,Agentic AI架构正悄然崛起,成为推动智能体(AI Agents)实现自主决策和复杂任务执行的核心技术框架。与传统的AI模型不同,Agentic AI架构更像是一个“智能大脑”,能够模仿人类的认知能力,自主感知环境、制定计划、执行决策,并在动态变化的环境中不断学习和进化。 今天,我们将深入探讨Agentic AI架构的核心组件、工作原理以及它在各行业中的广泛应用。无论你…- 2

- 0

-

大语言模型是如何推理的?

不管是写点日常文案,还是解决复杂问题,大模型都展现出了让人惊叹的实力。 但话说回来,当我们说到“推理”这个词时,它真的像人一样,会自己“思考”、有逻辑地推导出答案吗? 什么是推理Reasoning? 要讨论推理,我们首先要定义它的含义,并达成共识。推理的基本过程可以概括为:你接收到某些信息,经过思考后得出结论。 举个例子: “标普 500 指数在三个月内下跌了 15%。” 当你听到这条信息时,…- 9

- 0

-

一文读懂英伟达世界模型平台 Cosmos

在当今人工智能飞速发展的时代,新的技术和平台如雨后春笋般不断涌现。英伟达作为科技领域的巨头,于 2025 年1月份的CES上重磅推出了 Cosmos 世界基础模型平台,一经亮相便吸引了全球的目光,在人工智能领域掀起了新的波澜。 || Cosmos 平台的诞生背景 随着人工智能从理论研究逐步走向实际应用,物理 AI 系统,如机器人和自动驾驶汽车等,面临着巨大的发展挑战。训练这些物理 AI 系统需要…- 4

- 0

-

一起聊聊Nvidia Hopper新特性之WGMMA

本文翻译自外网资料,译者:企鹅? 原文链接见文末 上次为大家带来了Hopper上的新特性之TMA,这次我们来一起看看Hopper上的新矩阵乘法操作WGMMA。 引子 如果一个 CUDA 教程没有关于通用矩阵乘法(GEMM)的章节,那么就是不完整的。可以说,GEMM 是现代 GPU 上最重要的例程,它在神经网络、大型语言模型和许多图形应用程序中构成了大部分计算。尽管 GEMM 无处不在,但它以难以有…- 4

- 0

-

又刷屏了,昆仑万维奇袭音乐大模型

文 | 阑夕出道即巅峰,又一款纯正中国血统的大模型,跑出了SOTA(当前最佳水平)的分数。昆仑万维发布的音乐大模型Mureka O1,在音乐生成品质的评测上,全面超越作为行业领头羊的Suno——相当于ChatGPT在文本大模型的优势地位——成了又一个空降而来的「新王」。当然,和普通大模型通常通过做题的准确率来对比能力差异不同,音乐内容的好坏缺少完全客观的评判标准,所以昆仑万维也做到了力所能及的公平…- 4

- 0

-

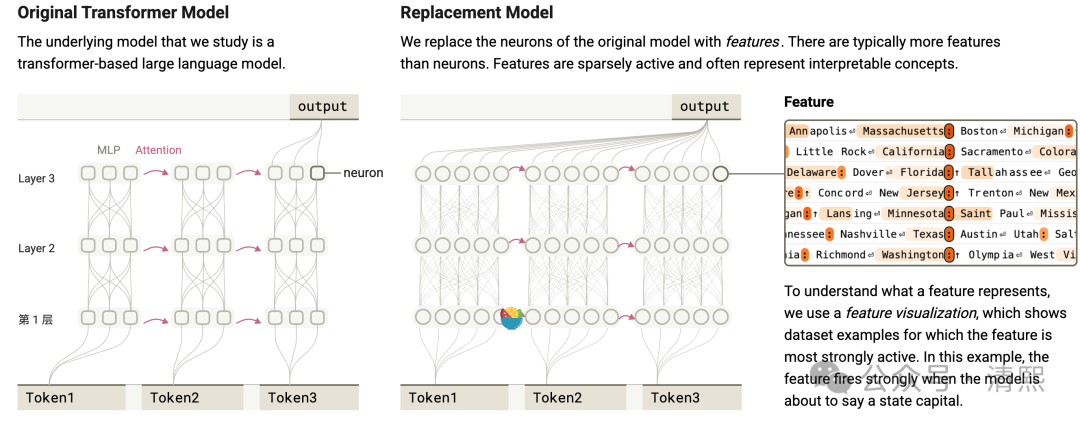

揭秘AI内部机制:AI理解的重大突破

Anthropic本周连发两篇相互关联的大模型内部机制研究报告【文献1、文献2】:构建了AI“显微镜”,并用它追踪了大模型思维,这是继去年揭秘大模型黑盒之后的重大进展。【文献1】构建了替代模型(replacement model)作为AI“显微镜”通过这个替代模型,亦步亦趋的捕获针对每一个提示语的归因图(attribution graph) 归因图用于描述模型在特定输入提示下生成目标词元输出时所经…- 4

- 0

-

64张图,看懂AI Agent的核心技术与未来

嘿,大家好!这里是一个专注于前沿AI和智能体的频道~ 原文:A Visual Guide to LLM Agents 作者:Maarten Grootendorst 翻译:猕猴桃 & Claude Sonnet 3.7 LLM Agents指南 LLM Agents正变得越来越普及,似乎正在取代我们熟悉的对话式LLM。但是Agents本身其实并不容易,它往往需要多个组件协同工作。 img在…- 2

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!