-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

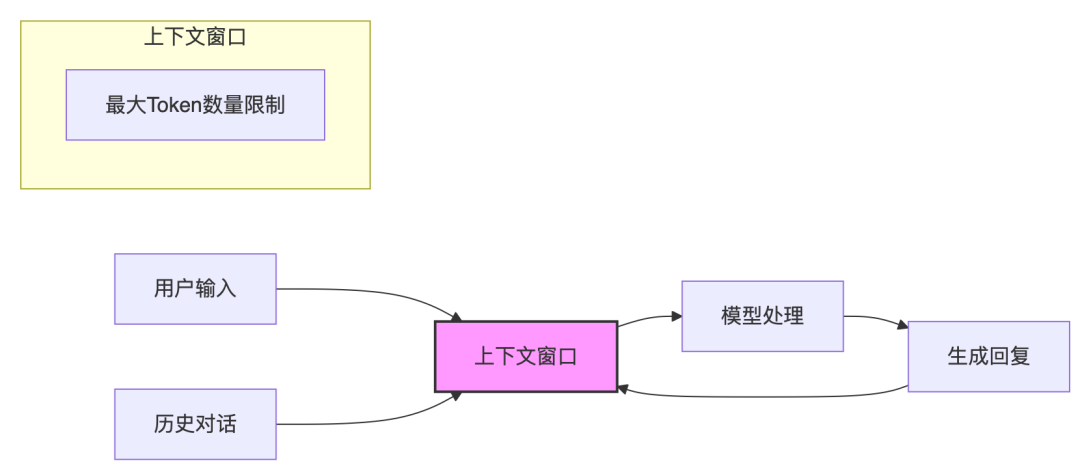

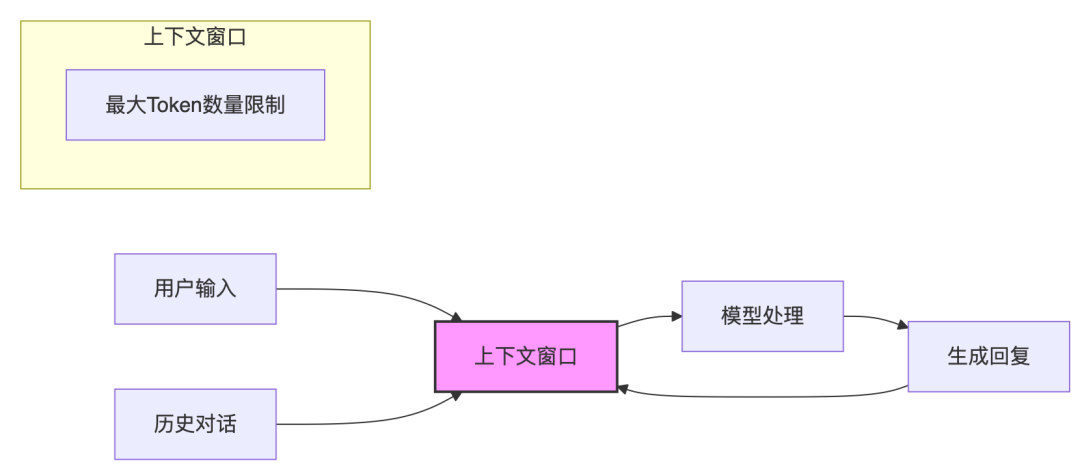

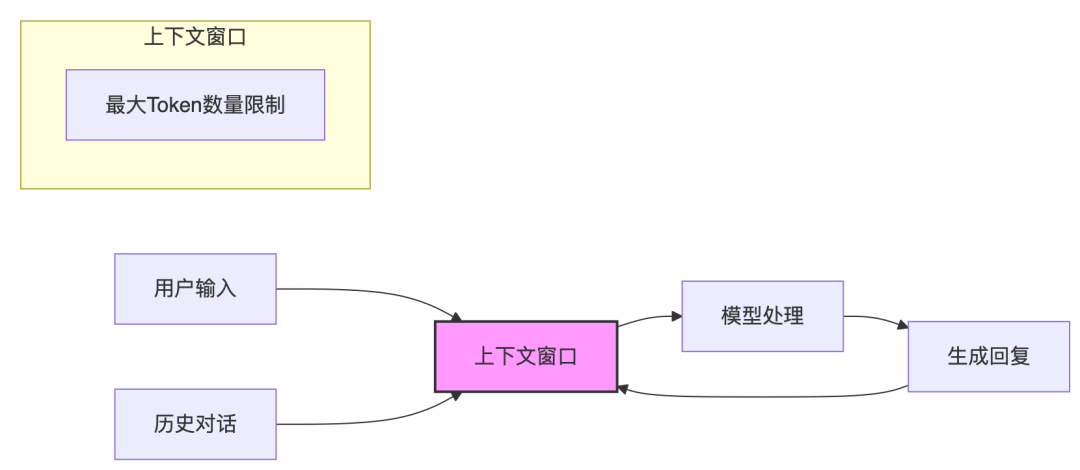

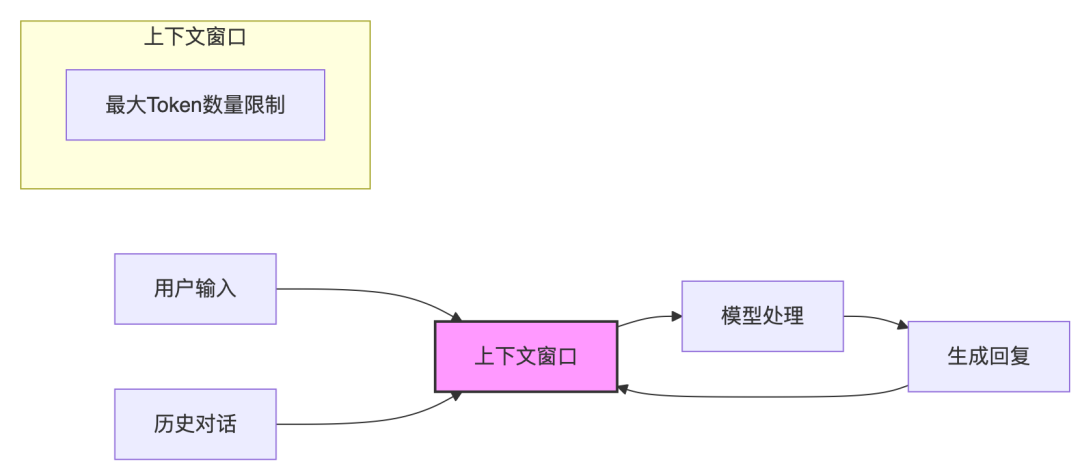

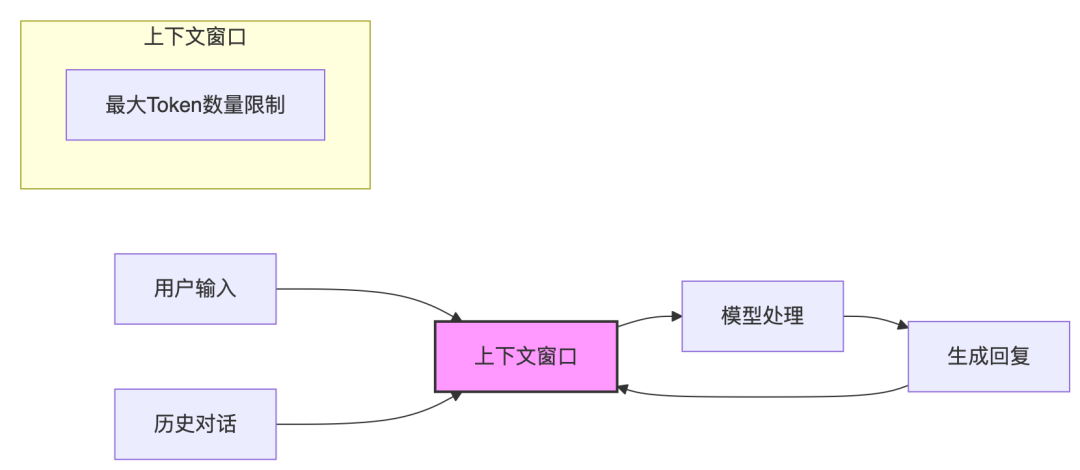

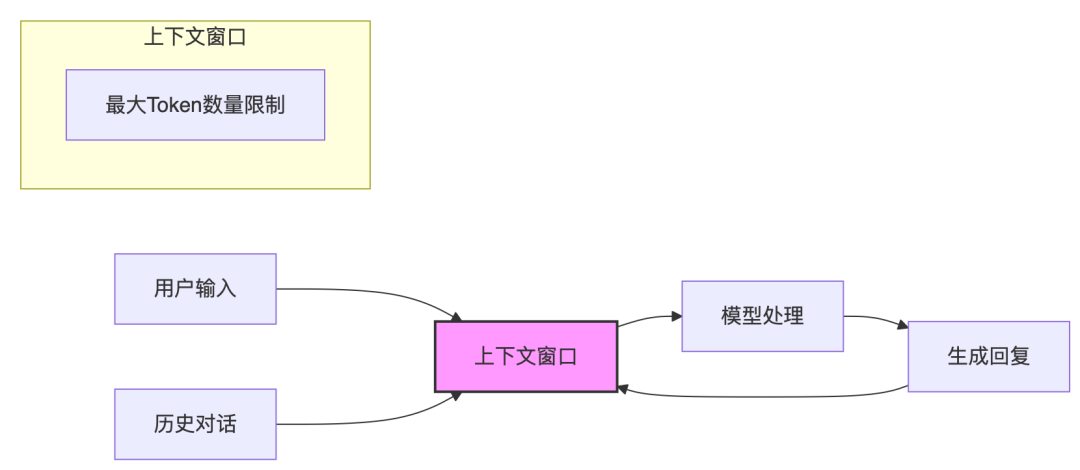

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

人工智能:AI大模型在金融应用实践的业务场景汇总【二】

1.1 数智尽调平台(银行公司业务尽职调查场景) 1.1.1 应用背景 银行授信业务的尽职调查作为信贷业务开展的核心环节,对于评估企业风险、保障资金安全以及制定合理的金融服务策略起着至关重要的作用。然而,传统的人工尽调方式在数据获取、处理效率、风险识别等方面存在着诸多不足,已难以满足现代银行业务快速发展的需求。近年来,生成式人工智能的迅速发展正在重塑银行未来业态,银行业已开启数字化转型“加速跑…- 7

- 0

-

人类的考试,考验不了AI了

撰文 | 李信马题图 | 豆包AI2017年5月,当时世界围棋排名第一的柯洁惨败于AlphaGo,在机器是否会比人类更聪明这个事关全人类尊严的问题上,我们第一次有了一个确定性的答案。一年前尚且能赢一局的李世石,成为人类棋手在AI面前最后的夕阳。 不过,人类善于寻找理由,比如将智力转换为更复杂且难以解释的“智慧”,那就显得我们还在赢,还有是更“高级的”赢法。而且作为在智慧这条路径上的先行者,人类可以…- 4

- 0

-

多智能体协作+企业know-How,Agent云重构AI应用落地新范式

AI技术的突破性进展正以前所未有的速度重塑着商业世界的底层逻辑。 从政策层面的"十四五"数字经济发展规划到资本市场的AI赛道热捧,从科技巨头的千亿级研发投入到中小企业对"AI+"转型的迫切期待,AI应用落地早已成为最热的话题。 然而,真正将AI深度融入业务流程、实现降本增效甚至模式创新的企业却寥寥无几。AI到底怎么在企业里真正落地成为业务引擎?而不是空喊口号…- 6

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

下一代智能协作的雏形:字节跳动AIME框架如何推动AI多智能体系统演化

我们正见证一种新的融合力量逐渐成形——大型语言模型(LLMs)与多智能体系统(Multi-Agent Systems,简称 MAS)的深度整合。 过去智能体往往孤立运作,受限于静态规则和单一任务定义。而如今,随着语言模型的语义理解和推理能力的跃升,智能体不再只是执行者,更成为能够协同、规划、适应环境的“认知单元”。 在这一背景下,MAS 不再是简单的多代理并行处理系统,而演变为一个语言驱动、反馈自…- 9

- 0

-

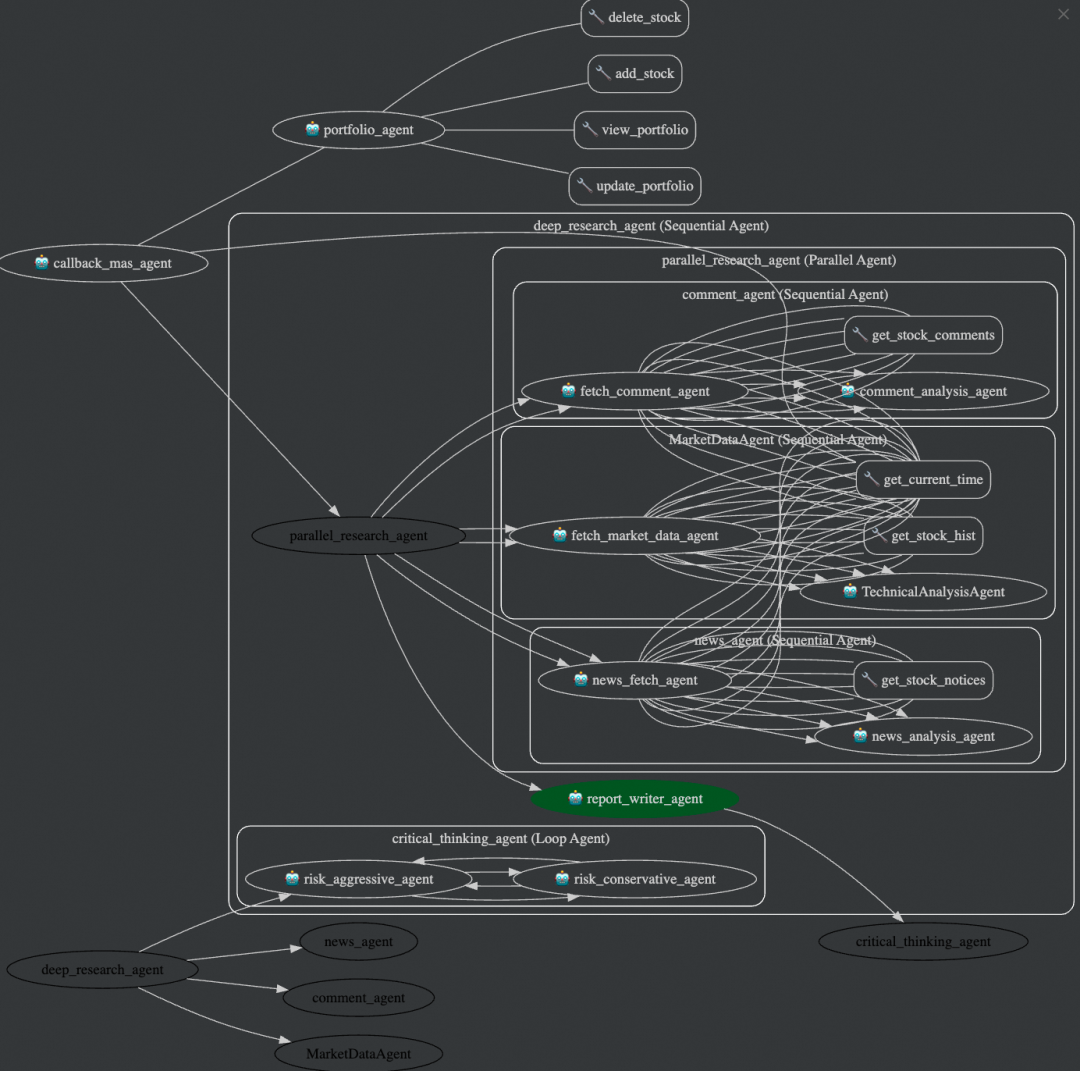

全球首个A股金融智能体?

TL;DR 最近一段时间写了一个关于Agent的专题, 主线任务是基于A股量化交易为背景来构建多智能体系统, 然后顺便介绍MCP/Google ADK以及未来还有Agent2Agent(A2A)的相关介绍. 《Agent101》 昨天看到某个App号称全球首个A股智能体, 渣B就有点意见了, 其实圈内很多机构早就在做这些事情了... 这段时间借着介绍Agent我也来公开些这方面的东西吧, 从专业性…- 4

- 0

-

你需要了解的 AI 智能体设计模式

点击“蓝字” 关注我们人工智能领域正围绕“智能体(Agents)”这一概念蓬勃发展——这些自主的 AI 系统能够推理、规划,并与环境交互以实现目标。但如何构建高效且可靠的智能体呢?答案就在于智能体设计模式(agentic design patterns)。这些可复用的蓝图为构建复杂的 AI 智能体提供了框架。本文将详细介绍四种基本模式,并通过不同框架下的简单实现示例,助你入门。 一、反思模式:促进…- 5

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 8

- 0

-

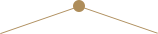

MCP 协议完全指南:架构设计

Host 就像是一个作战大厅,大厅里主要有三种角色: - LLM Client 扮演者将军的角色,负责作战计划的制定。 - Orchestrator 扮演者作战参谋的角色,负责协调各个 MCP Client 的行动。 - MCP Client 扮演着通信兵的角色,负责与外部 MCP Server 进行通信。 从另一个层面看,Host 是 Client 容器,也负责协调、编排任务的执行,确保任务能够…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

入局AI Infra:程序员必须了解的AI系统设计与挑战知识

AI Infra 和传统 Infra 有什么区别?程序员积累的技术栈和方法论,如何复用到 AI 系统架构设计上?随着大模型技术的爆发,AI Infra 已成为基础设施领域的核心战场。过去1年多的时间,我们QQ基础架构算法工程团队落地了多个大模型应用,包括语音合成大模型、内容理解多模态大模型、生成式推荐大模型,跑通大模型训练到推理的全链路。踩了很多坑,也积累了不少经验。本文将分享传统后台工程师积累的…- 8

- 0

-

AI Agent 深度剖析:现状、价值、局限与未来

深入剖析 AI Agent 在各行业的应用现状、价值体现、面临的短板,以及对未来可能产生显著影响的领域,对于把握人工智能的发展趋势、推动产业升级具有重要意义。一、引言 自人工智能概念诞生以来,其发展历经波折,而近年来 AI Agent 的出现,为人工智能的应用带来了全新的变革。AI Agent,简单理解,是一种能够在特定环境中自主感知、决策并执行任务以实现目…- 4

- 0

-

新手必看!百度智能体商品挂载全攻略,流量变现快人一步

点击蓝字 关注我们 01商品挂载百度文心智能体平台为开发者打通了京东、淘宝、拼多多、度好货四大平台超7亿商品库,可以通过智能体挂载相关商品进行售卖,并得到相应的商品销售佣金。 商品挂载方式: AI自动挂载: 系统会自动为您挂载相关商品。 手动挂载: 您也可以手动选择商品进行挂载。 商品快捷指令: 可进一步提升挂载效率。 建议: 为了获得最佳效果,建议开发者选择同时启用【AI自动挂载】(并勾选全部平…- 19

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 6

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 8

- 0

-

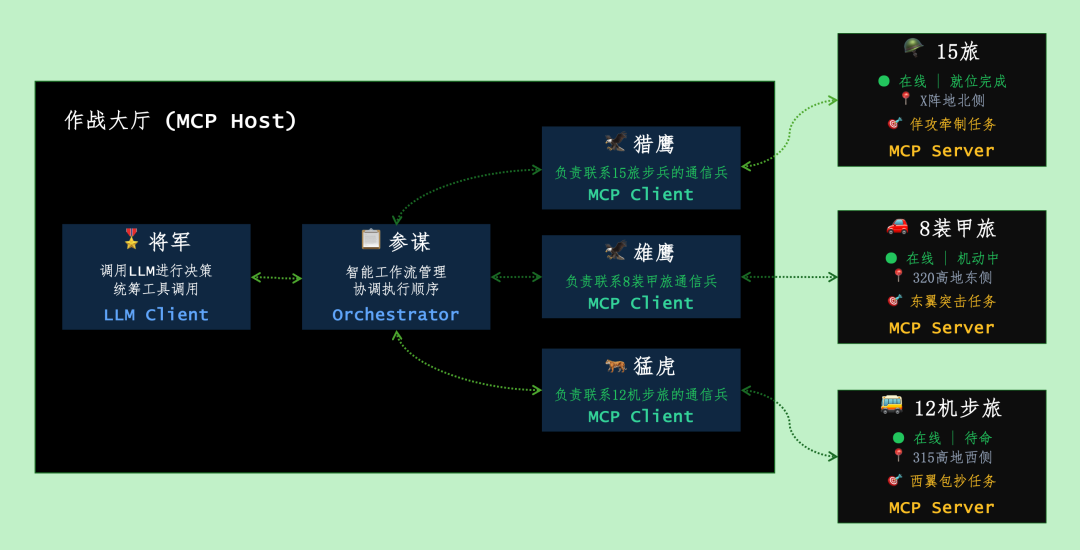

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 2

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

3个月,上百家企业交流,和大家聊聊AI应用的落地实践(开篇)

开篇 Cloud Native 4 月初,我和大家分享了阿里云云原生团队在MCP 范式构建新一代 AI 应用架构" data-itemshowtype="0" linktype="text" data-linktype="2">基于 MCP 范式构建新一代 AI 应用架构的整体思路,这段时间我们与很多客户进行了交流,也一直…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

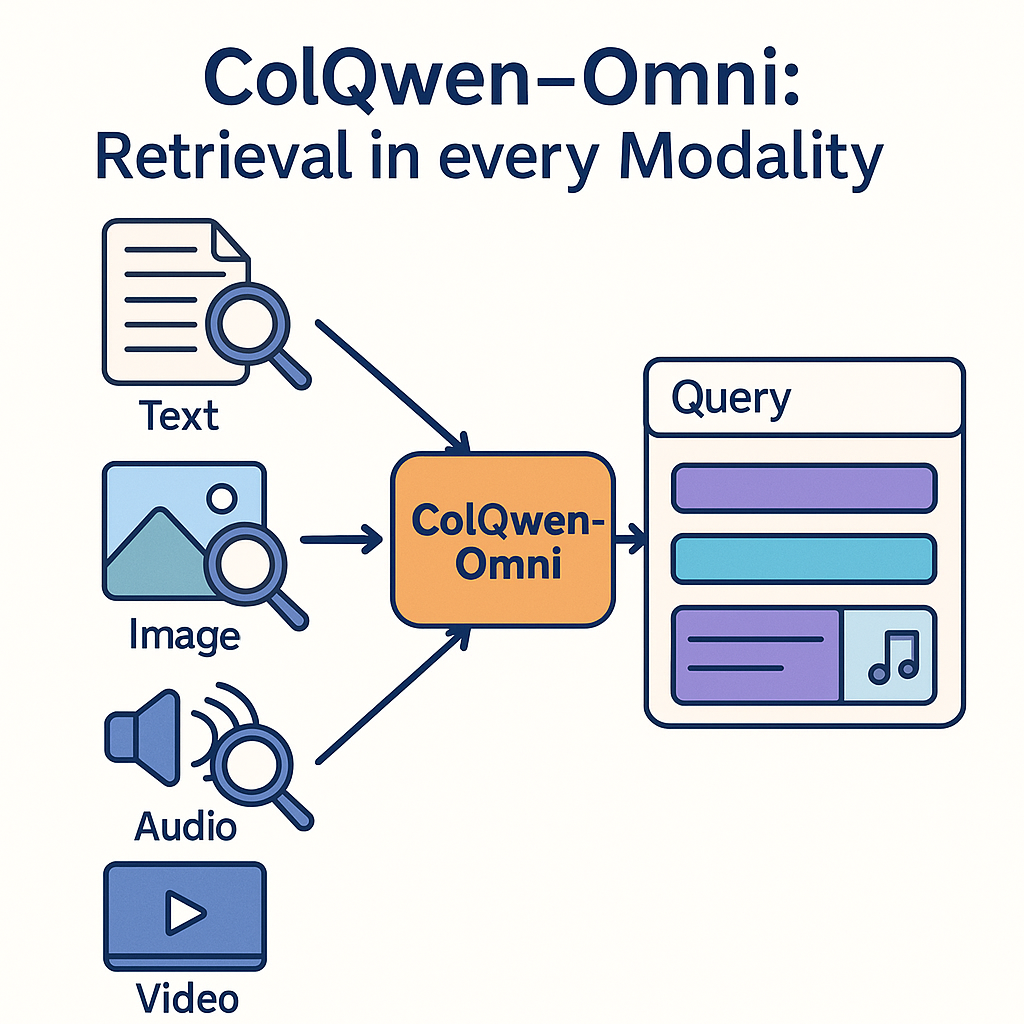

ColQwen-Omni:RAG全模态检索来了,支持【文本|图像|视频|音频】四种模态!

还记得 ColPali、ColQwen 和 DSE 吗?这些模型开创了视觉文档检索的新范式:无需费力地从文档中提取文本进行处理,只需将文档页面视为一系列图像(屏幕截图),然后训练视觉语言模型(VLM)直接将其内容表示为向量。ColPali 的实践表明,这种策略通常比其他替代方法更快、更简单,并且能带来更好的检索性能。 自发布一年以来,ColPali 和 ColQwen 系列模型已被下载数百万次,被…- 5

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 3

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!