-

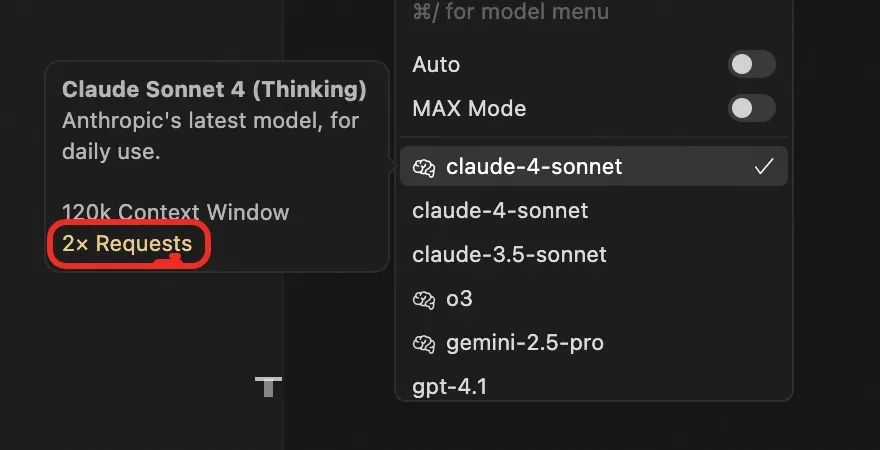

Cursor 0.50 版本升级后如何省钱又高效?一份给开发者的避坑指南

在 AI 编程辅助工具飞速发展的今天,Cursor 凭借其强大的交互能力、深度集成的 Agent 模式以及对代码理解的精准度,迅速成为开发者手中的“新宠”。然而,随着使用人数的增加和功能复杂度的提升,大家逐渐发现:Cursor 并不是“无限免费”的神器,而是一个需要精心规划与高效利用的智能助手。尤其是在 0.50 版本更新后,Cursor 统一了计费机制,引入了 MAX 模式等新特性,让…- 1

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

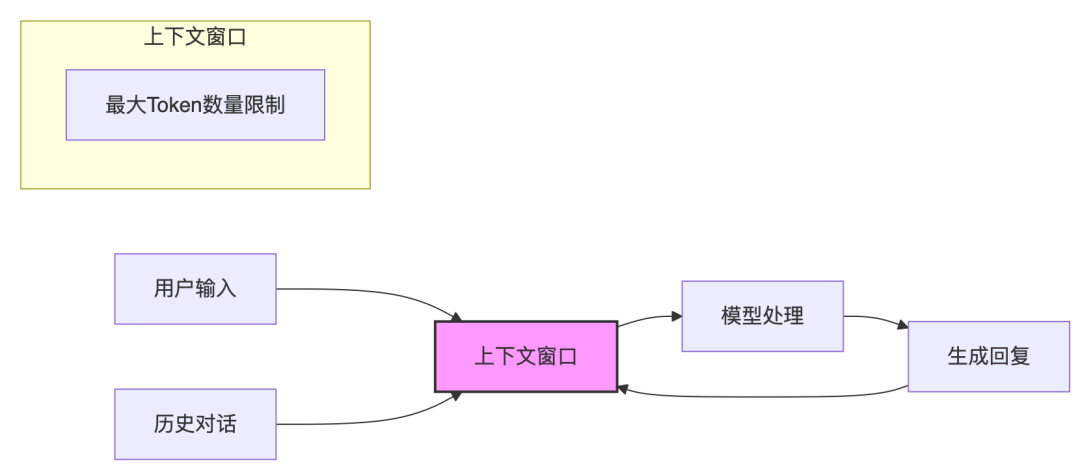

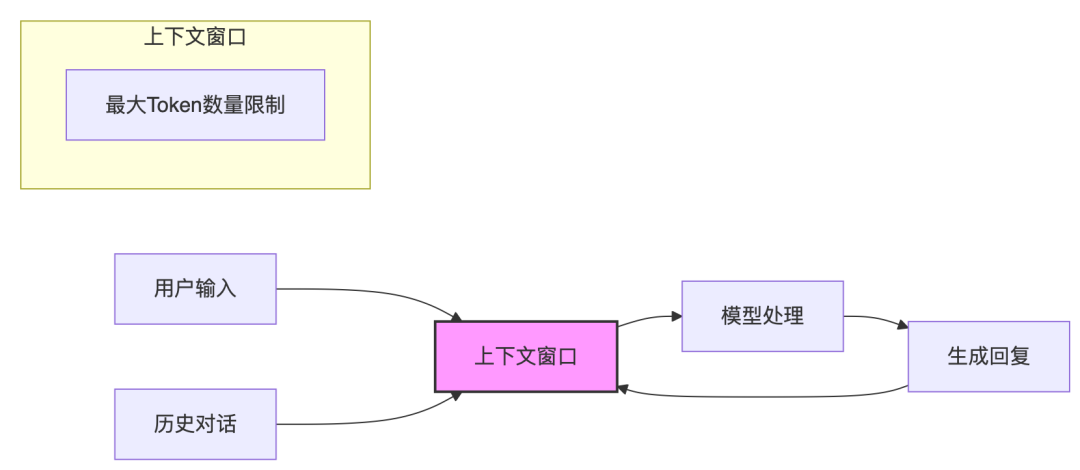

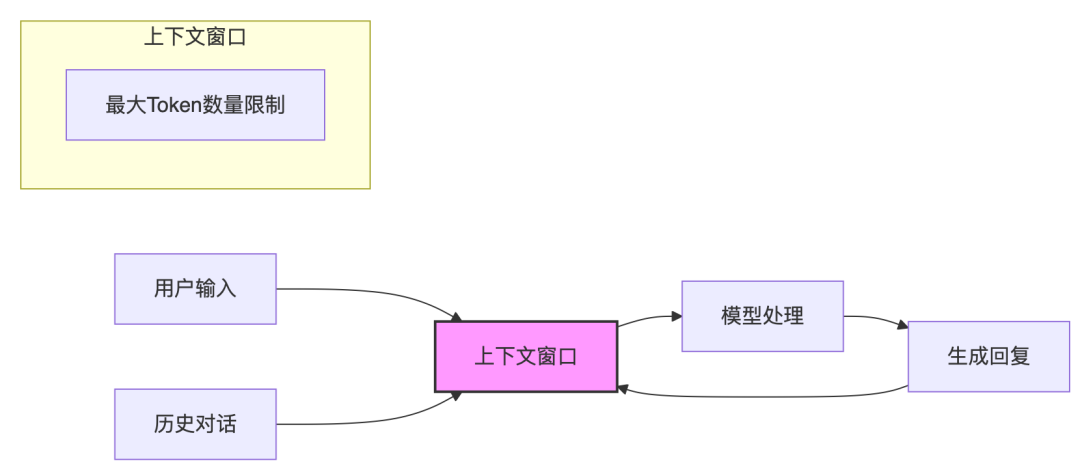

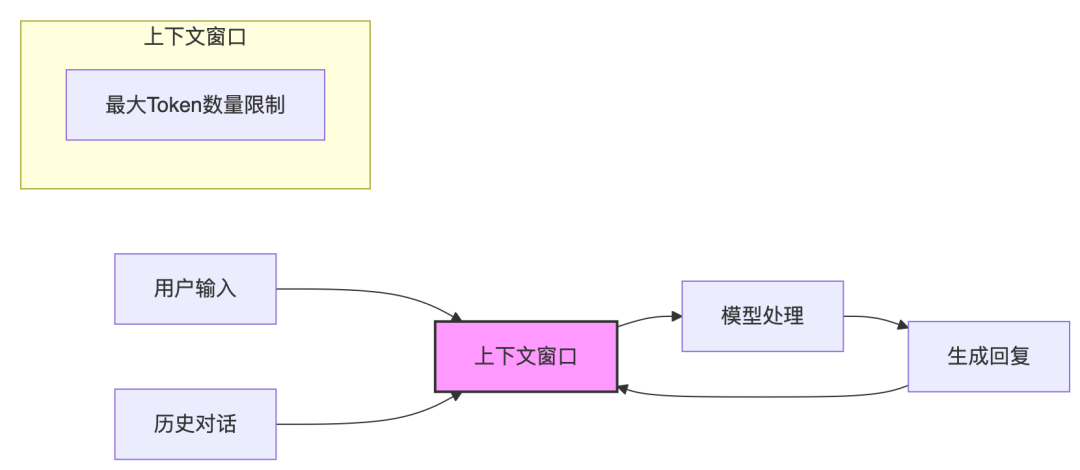

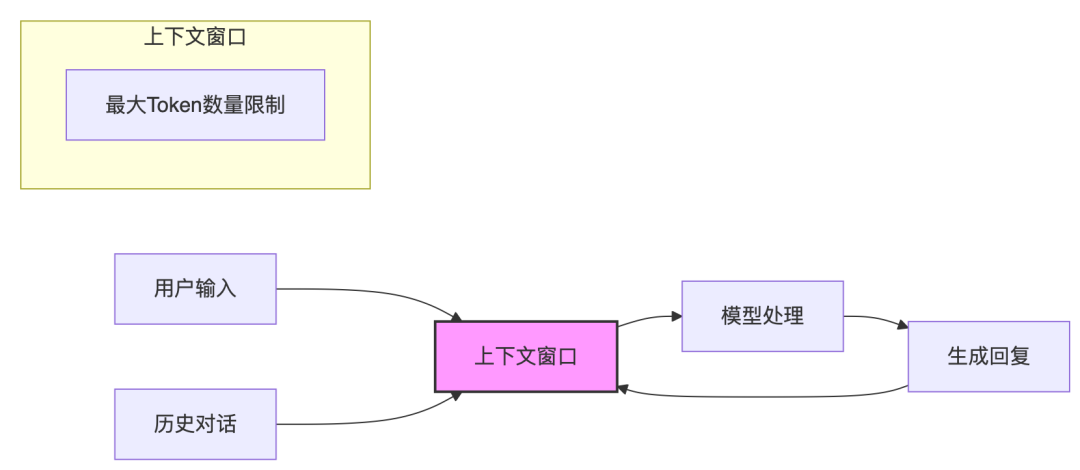

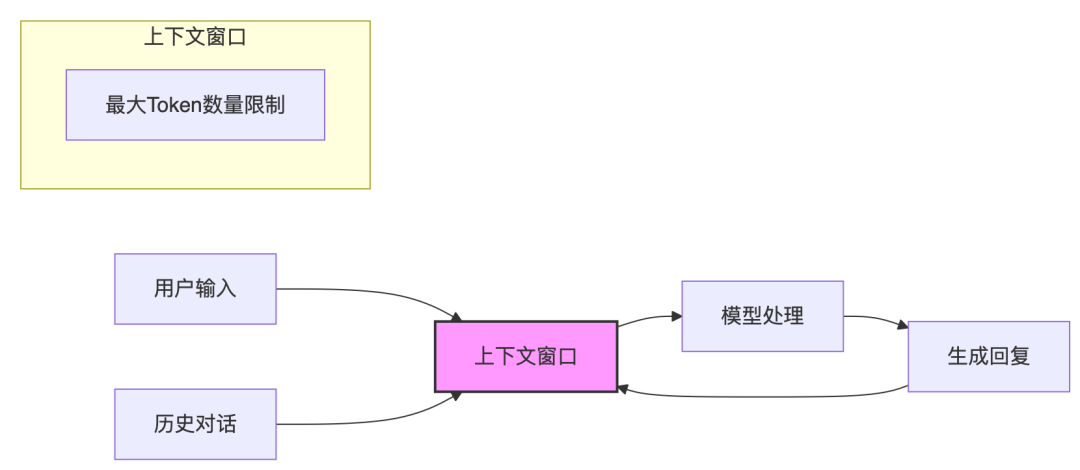

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 0

- 0

-

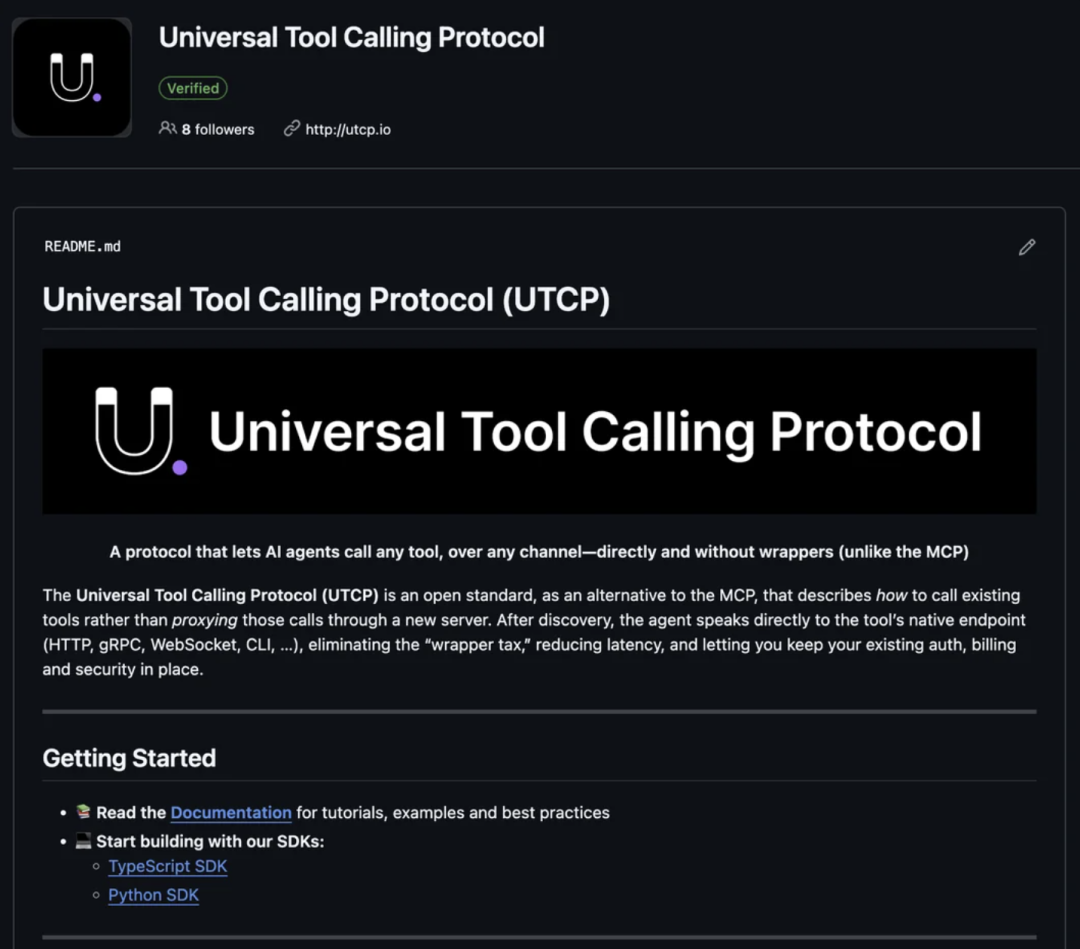

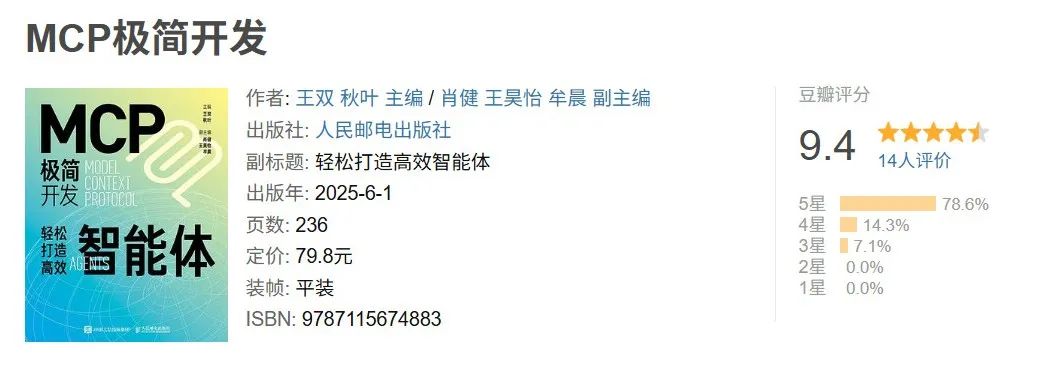

MCP 未兴,UTCP 又来

Universal Tool Calling Protocol(UTCP) 是一种开放标准,用于描述如何调用已有的工具,而不是将调用流量转发到一个新的中间服务器。作为 MCP(Multimodal Communication Protocol)的替代方案之一,UTCP 的核心理念是描述工具如何被调用,而不是强制接管调用过程。 在服务发现(discovery)之后,调用方(通常是 Agent)会直接…- 1

- 0

-

MiniMax推出Agent全栈开发功能!一句话聊出演唱会选座系统,可锁座可支付

30分钟构建、0代码生成。作者 | 王涵编辑 | 漠影智东西7月16日消息,今日午间,国产大模型“六小虎”之一的MiniMax,正式发布Agent(智能体)全栈开发功能。该功能可以一键构建完整的全栈应用,不只局限于前端展示页面。构建出的系统支持Supabase后端托管、Stripe支付集成、cron job定时任务和长链接维持等技术特性,可实现API调用、实时数据处理、支付功能、LLM集成、定…- 1

- 0

-

MCP与传统API有什么区别?

🤖 下一代 API 设计范式?MCP 协议正重塑 AI Agent 与工具的连接方式! 随着大型语言模型(LLM)加速落地,我们越来越多地看到 AI Agent 在企业场景中扮演主导角色:自动问答、智能运维、个性化推荐、财务分析……这些 Agent 的核心能力,离不开与外部数据、系统、工具的深度交互。 传统的 API(REST、GraphQL、gRPC)还够用吗? 这就是本文主角——Model C…- 0

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 0

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 0

- 0

-

Prompt工程实战第三篇:AI驱动的性能与并发测试

近日我们连续发布了两篇 Prompt 工程系列教程:本篇聚焦性能测试与并发场景,演示如何借助 Prompt 工程和 Playwright 自动化压力测试 saucedemo.com。一、前言在电商高峰期,页面吞吐量与并发用户体验至关重要。传统性能测试脚本编写复杂、难与功能测试统一,团队常面临:1. 📊 指标难产:手工编写并发脚本耗时长,数据汇总麻烦;2. 🚦 环境搭…- 0

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 0

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 0

- 0

-

Deepseek模型蒸馏:大模型如何实现传帮带?

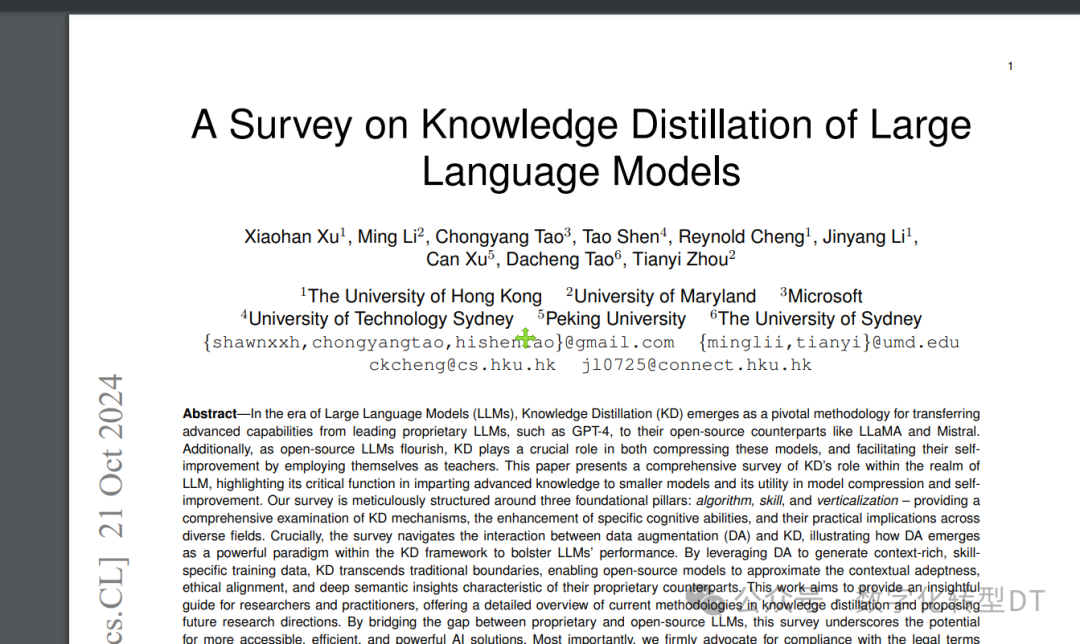

DeepSeek话题在外网很火的一个原因是他可能蒸馏了其他大模型。实际上知识蒸馏是一个AI届的常规操作,去arxiv上去搜索相关的文献,非常多。包括如何去蒸馏闭源模型。 类似GPT-4o、Claude这些顶尖模型往往是闭源的,就像一座座"黑盒",只能远观却难以窥其内部奥秘。那么,其他大模型如何从这些"老师"那里学习经验呢?今天,让我们一起深入探讨AI界的&q…- 2

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 0

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 0

- 0

-

何小鹏再谈组织进化:每个部门都要使用AI

今年初,小鹏汽车CEO何小鹏在内部做了一次复盘,他指出,所有部门都要拥抱AI。去年11月新车P7+上市时,小鹏首次提出了“AI汽车”概念。但有员工表示,何小鹏对AI的关注不限于汽车产品、辅助驾驶大模型等,他还研究,内部30多个一级中心部门哪些部门拥抱了AI,员工通过AI学习了多少知识。“AI能让一个更大、更强的企业在群体效率、群体复利上变得更强大。”何小鹏近日在飞书未来无限大会上谈及组织能力时强调…- 1

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 2

- 0

-

大模型是怎么“用工具”的:一文讲透 Function Calling 策略

当用户说“帮我算一下33加77”,大模型为啥能准确调用函数来算? 这背后用的就是 —— Function Calling 策略。 今天我们就把这个机制讲明白。 第一步:注册工具 开发者需要先把工具“挂到菜单上”,供大模型选择使用: { "name": "add", "description": "执行加法运算", …- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 2

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

大模型时代,微软为什么还是跑在最前?

徐一平 腾讯研究院高级研究员 在所有巨头高调“炼”大模型的喧嚣中——谷歌一年烧掉 500 亿美元训练 Gemini,英伟达靠 GPU 直冲全球市值第一——跑得最快的却是一家几乎不自己造基础模型的公司:微软。把押注 OpenAI 的能力迅速封装进微软云与办公软件,三年间市值从 2 万亿跳到 3 万亿,华尔街甚至喊出 2026 年冲6万亿。这条“不炼模、快变现”的反常路线让人不禁思考:一个不做基座大模…- 5

- 0

-

运维领域智能体实战案例2

↑↑↑ 点击关注,分享IT技术|职场晋升技巧|AI工具在运维领域,智能体(AI Agent)正逐步从概念走向实战,通过自动化、智能化的手段解决传统运维中的效率瓶颈和复杂性问题。继上一篇运维领域智能体实战案例,今天再跟大家介绍4个类似案例: 案例1:边缘设备智能运维(某智能制造工厂) 场景:千级工业物联网设备(PLC/传感器)分散在产线,故障定位依赖人工巡检,平均修复耗时2小时。 智能体方案: 1…- 2

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

2025年下半年,AI技术将何去何从?

当AI的概念热度慢慢褪去,留下的是一地鸡毛还是美好的期望?可以说当前的AI技术已经处在追捧热度与深度应用的十字路口,显然随着时间的流逝对于概念的热度与盲目追捧已经在逐步降温,企业领导对于AI的期望与焦虑也在趋于理智,现在已经不是AI是什么、能做什么的概念混沌期,而是AI在企业怎么做、如何产生价值的应用深水区。如果用一句话来形容2025年上半年的AI应用市场,那就是:舆论很热闹、期望很美好,落地很骨…- 2

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!