-

不用AI,可能永远造不出新一代动力电池|甲子光年

这并不是危言耸听。 作者|张麟 编辑|王博 和电动汽车体量的增长速度相比,动力电池性能的提升则十分缓慢,甚至即将停滞不前。 2020年-2024年的5年期间,中国市场的新能源汽车保有量从492万辆猛增至3140万辆,占国内汽车总量的比值从1.75%跃升到8.90%。此外,同时期国内动力电池装机量也从63.6GWh提升至548.4GWh。 与此相对的是,同时期纯电新能源汽车的平均续航仅从378公里,…- 6

- 0

-

MCP客户端智能体的开发实践

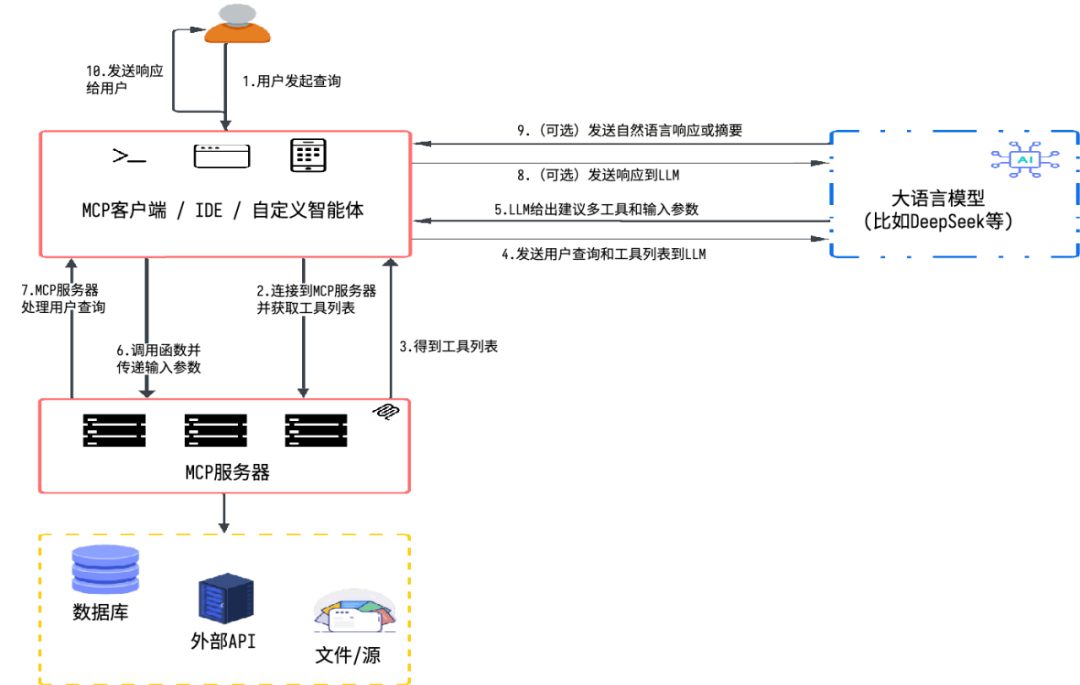

1 引言本文旨在深入剖析模型上下文协议(MCP)架构及其客户端流程,并实现一个 MCP 客户端智能体。我们将明确当向由大语言模型(LLM)支持的 MCP 提出请求时,幕后究竟发生了什么,以期让整个过程更加清晰易懂。目前,关于构建 MCP 服务器的文章已有很多,例如 MCP 官方网站 上的教程,详细介绍了如何构建一个简单的 MCP 天气服务器并将其连接到主机(如 Claude D…- 6

- 0

-

AI浏览器是AI产品破局关键?| Perplexity 创始人YC圆桌实录

7月11日,YC发布了Perplexity 创始人兼 CEO Aravind Srinivas 6月在 AI Startup School 的圆桌对话,本次对话聚焦于AI时代下搜索与信息交互的未来形态,对话核心议题包括Perplexity 的最新发展、其未来十倍增长的基础设施挑战、公司押注重注的浏览器产品“Comet”的战略构想,以及在与谷歌、OpenAI等科技巨头的激烈竞争中,创业公司如何寻找…- 6

- 0

-

2万行代码,Claude Code完成95%!一位独立开发者发布APP的实录

家人们,先来开个脑洞:一款功能贼复杂、UI 巨精美的 macOS 应用,从一个空文件夹到上架 App Store,只花了一周。这个项目总代码量超过 2 万行,95% 是 AI 写的。这是不是听起来像某书上哪个人编的爽文?但这确实是来自一位资深 Mac 开发者的亲身经历,刷新了我们对 AI 编程能力的上限。这位开发者名叫 Indragie Karunaratne,从 2008 年开始就开始搞 Mac…- 6

- 0

-

AI原生的创业公司是什么样的?Lovable员工分享

这是一份以采访的角度,提问Mixlab关注的几个问题,材料基于Lovable 员工 Elena的文章整理而成。 M: 大家好,欢迎来到 Mixlab 今天的特别采访。我们非常荣幸邀请到 Lovable 的员工 Elena,来和我们分享她在 Lovable 的工作体验和对 AI 驱动开发未来的看法。Elena,欢迎您! Elena: 大家好,Mixlab 的观众朋友们,非常高兴能来到这里。 M: E…- 7

- 0

-

Grok 4 数学推理吊打 o3,OpenAI 奥特曼本轮输麻了

AI圈真是刺激。马斯克又一次冲上热榜,这次他发布的Grok 4,号称是世界上最强的模型,马斯克还计划把它送上太空! 相比 GPT-4o、Claude 4、Gemini 2.5 Pro 等一众明星模型,Grok 4 来势汹汹,不仅性能碾压,还在推理、编程、长文本处理上全面发力,甚至直接对标 AGI(通用人工智能)标准。 今天,我们不吹不黑,带你实战测试 Grok 4 数学推理强在哪,又值不值得你掏钱…- 8

- 0

-

AI coding的雄心、困局与终局 | 峰瑞研究所

这个5月,AI coding(AI 编程)领域发生了不少标志性事件。5月3日,苹果与初创公司Anthropic联手开发由AI驱动的Vibe Coding(氛围编程)平台;三天后,OpenAI被曝将以30亿美元收购AI编程新锐Windsurf;5月17日,OpenAI又推出集成于ChatGPT的Codex智能体,实现自动生成、调试和优化代码;美团在5月20日宣布将上线一款AI编程类工具“NoCode…- 6

- 0

-

月暗工程师谈K2:AI交互正在从markdown变成html

K2模型发布后(见今日测评文),月之暗面工程师@Justin Wong 写了一篇技术博客,分享了K2的一些研发细节,并回应了年初的投流争议。他认为,底层模型依然是当前最关键的东西。 部分精彩观点,摘录如下: 1.从Claude 3.5 Sonnet开始,AI写前端到达了可以实用的程度,之后几乎所有新出的模型都会秀一下自己的前端能力。 2.没有人规定文本AI必须输出markdown,如果“前端编程”…- 5

- 0

-

作业安全浏览器:作为“业务应用终端容器”的架构、技术与实践深度解析

1. 引言:新业务边界的崛起 随着远程办公、自带设备(BYOD)和SaaS应用的普及,传统的企业网络边界已经瓦解。工作负载和数据交互的重心已从封闭的内网转移到开放的云端。浏览器作为访问这些服务的主要入口,已明确成为业务运营的全新事实安全边界。 至关重要的是,我们需要明确定义企业安全浏览器(ESB)是什么——以及它不是什么。与为安全研究或网络渗透测试设计的浏览器不同,企业安全浏览器的核心目的是作…- 4

- 0

-

AI虚拟细胞:数字化生命的探索 | 峰瑞报告

细胞是构成生命的基础单元,人体内的细胞时时刻刻在发生变化。根据《自然-医学》2021年发布的研究,一个人每天更新的细胞量为60~100克,约3300亿个细胞。也就是说,每过1秒,就有约380万个细胞在体内更新上线。从微观视角看,细胞内部与外部之间,无时无刻不在进行着复杂的物质交换、能量流动和信号传递。这些动态而有序的过程,驱动着我们的生长、发育、衰老乃至疾病的发生。理解细胞的状态变化,能够帮助我们…- 2

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 1

- 0

-

从机器人三定律说起:当AI遇上道德难题,我们该如何选择?

特斯拉的Robotaxi真正上路了,机器人离我们越来越近了,于是情不自禁总有人会问:"你说如果有一天机器人真的像电影里那样普及了,它们会不会反过来伤害人类?"这个问题让龙叔想起了"机器人三定律"。今天,就让我们从这个经典话题说起,聊聊当AI遇上道德难题时,我们该如何思考。机器人三定律:一个科幻作家的预言说到机器人三定律,就不得不提到艾萨克·阿西莫夫这位科幻大…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

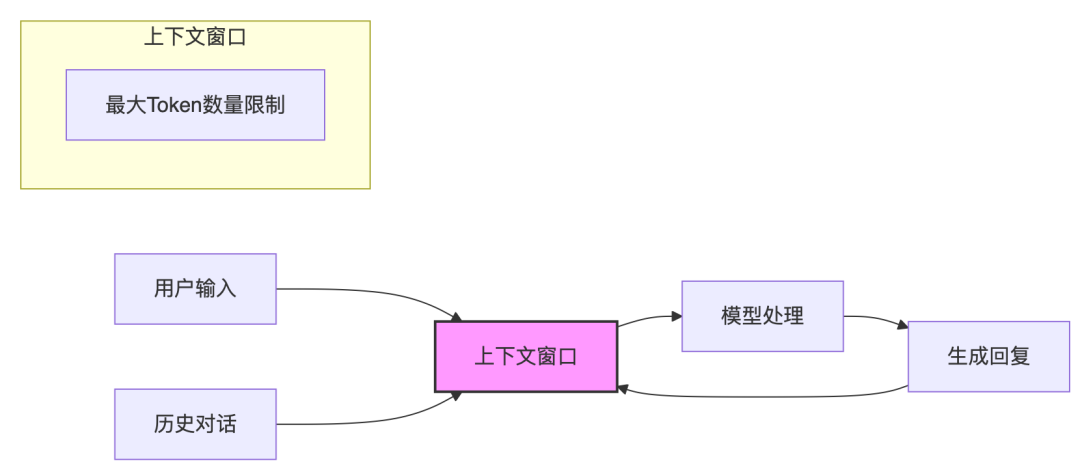

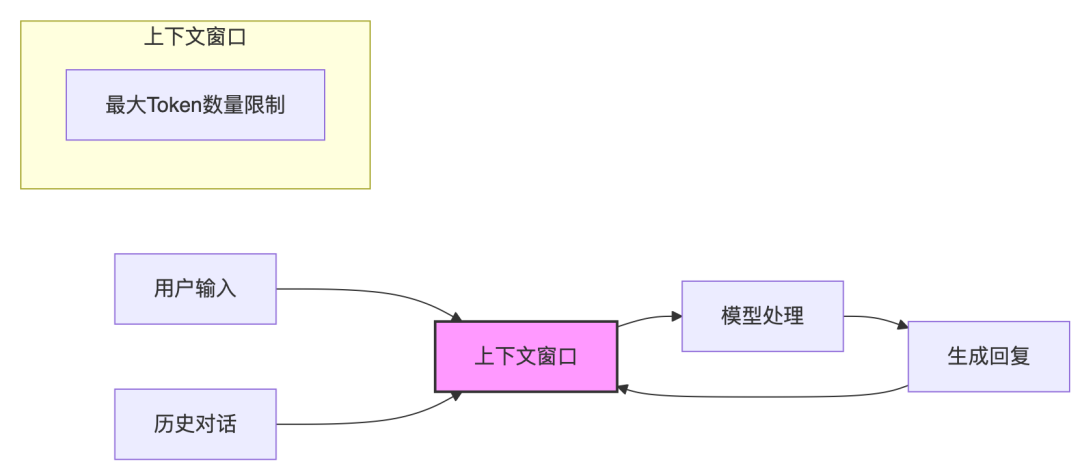

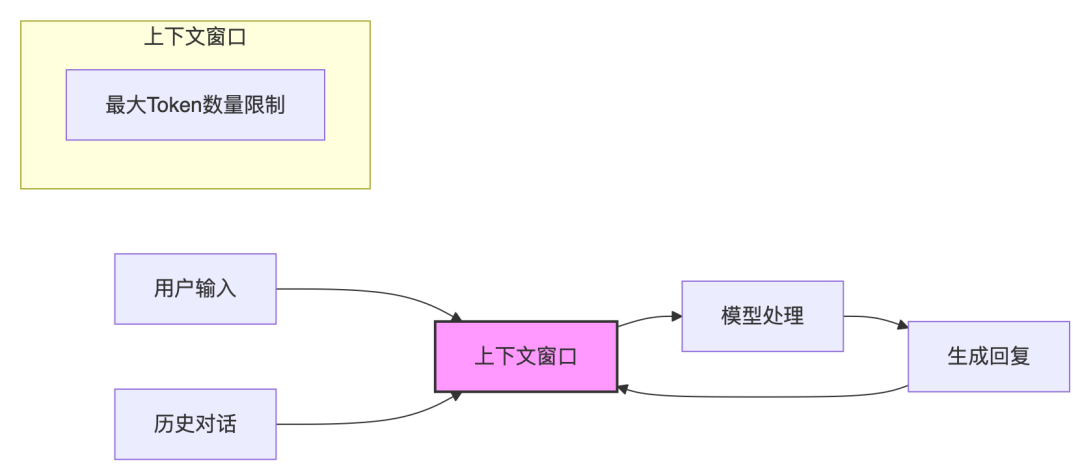

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

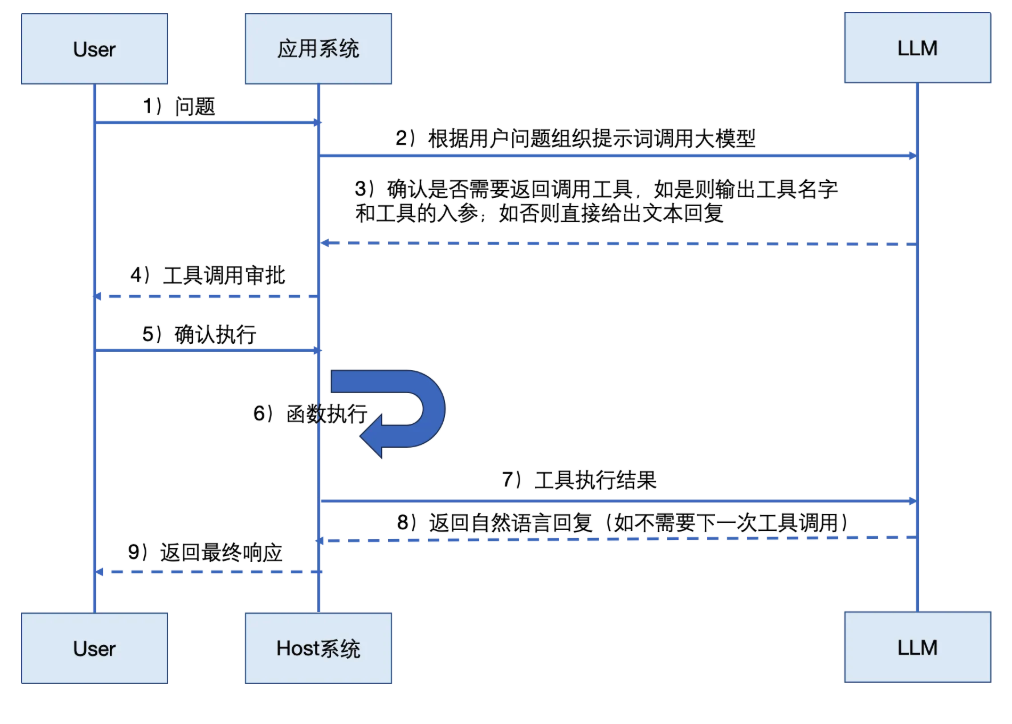

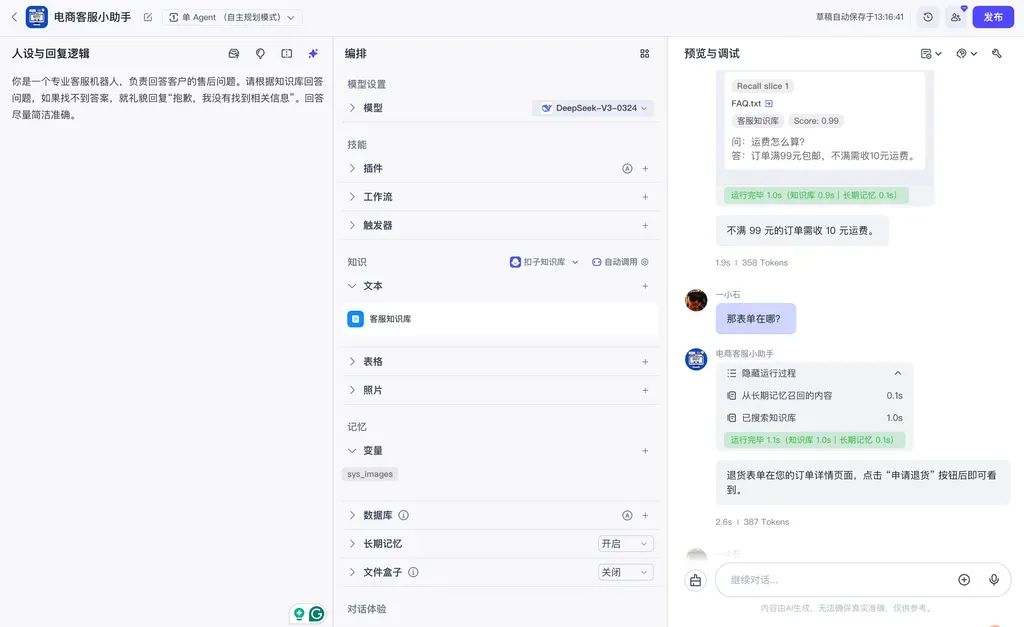

初次上手如何快速开发基于大模型+function call的agent应用?

初次上手如何快速开发基于大模型+function call的Agent应用?最近主导了一款ai agent系统的开发,在定架构的时候选择了MCP协议,在期间遇到不少坑点,记录顺分享一下相关内容。此篇是系列的第四篇:读完预计能对怎么快速搭建一个基于大模型和function call能力下的agent应用有初步的认知~此前介绍过基于MCP协议…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

企业如何建设AI应用开发平台

1 引言人工智能在过去几年中迅猛发展,助力开发者将AI模型投入生产的工具与平台也随之演进。无论您正在构建聊天机器人、图像生成器还是推荐引擎,选择合适的AI平台都将对性能、可扩展性和开发效率产生决定性影响。AI开发平台强调一站式开发流程,包括数据处理、训练、部署和运维等,如华为的ModelArts或阿里云的PAI平台。本文将深入解析现代AI开发平台的核心功能,以及它们如何简化大语言模型(LLMs)和…- 4

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 3

- 0

-

八仙过海,各显神通-各大智能体平台横评

过去一段时间,我先后在 FastGPT、dify、Coze、n8n、Make上搭了一些个智能体项目,自己还是有一些感触和心得在的,期间最大的体会是:大多数人花很多时间纠结“哪个平台最强”,却很少想清楚**“我需要解决的核心问题是什么”**。就像建房子:你是要一顶帐篷,还是一座别墅?是一个人住,还是一群人用?目的不同,路径不同,结果也不同。其实,没有通吃一切的万能平台。从各大AI自媒体的博主的选题也…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

探究MCP协议导致数据库敏感数据泄露的风险场景

前言模型上下文协议(MCP)已成为大语言模型(LLMs)与外部工具交互的一种标准方式。虽然这开启了新的功能,但也带来了新的风险点。在本文中,我们将通过模拟一个业务场景的方式,展示攻击者如何利用MCP协议窃取系统管理员的私有数据。 大语言模型(LLMs)通常用于根据预先定义的指令处理数据。这些指令可以分为系统指令、用户指令和数据上下文(如下图所示)。大语言模型与工具交互的核心问题在于,它们无法区分指…- 5

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 4

- 0

-

RAG&KG&LLM&文档智能持续跟进:老刘说NLP技术社区持续对外纳新

围绕大模型&RAG&文档智能&知识图谱四个主题,展开每日早报、社区讨论、月度不定时分享等多种形式,以期达到一个较好的技术分享。1、每日大模型&文档智能&知识图谱&RAG技术前沿、论文、项目、落地、代码拆解技术答疑等话题讨论2、每日大模型早报推送总结,160+日记录13、40+知识密集型干货线上主题分享我们已经陆续…- 6

- 0

-

ROLL:面向大规模语言模型的高效强化学习框架

阿里妹导读本文主要介绍了一个名为 ROLL(Reinforcement Learning Optimization for Large-scale Learning) 的高效强化学习框架,专为大规模语言模型(LLM)的训练和优化而设计。文章从多个角度详细阐述了 ROLL 的设计理念、核心特性、技术架构、应用场景及实验效果。作者:亚里、惟昕、淼平、明念、星霂 Q:是什么? A:Reinforceme…- 9

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!