-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

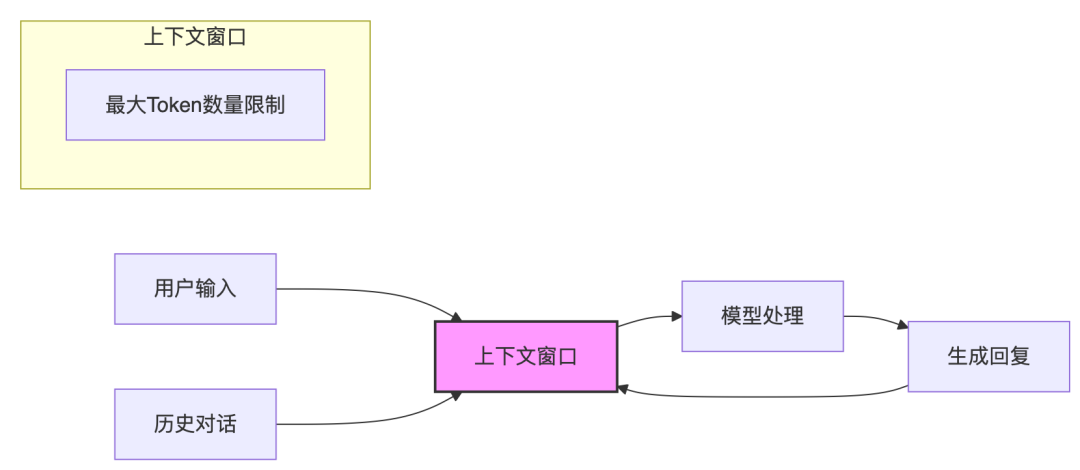

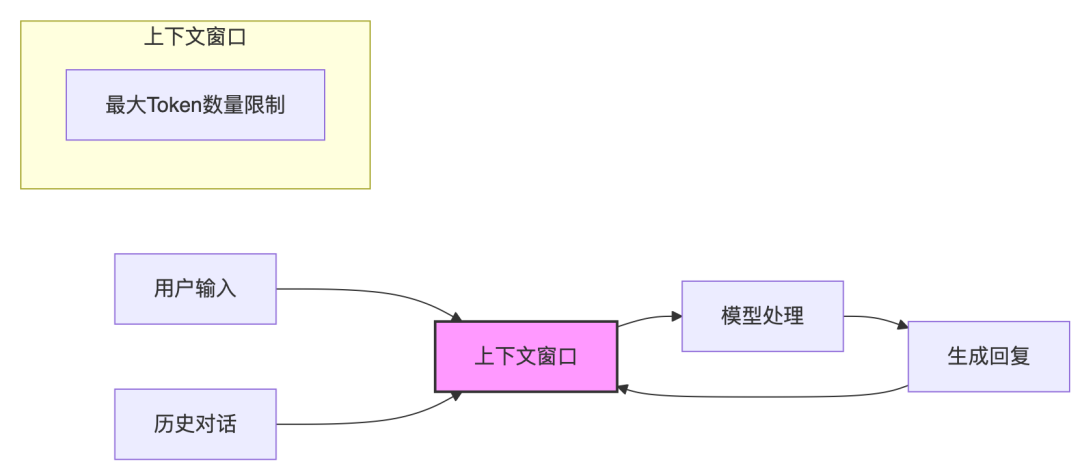

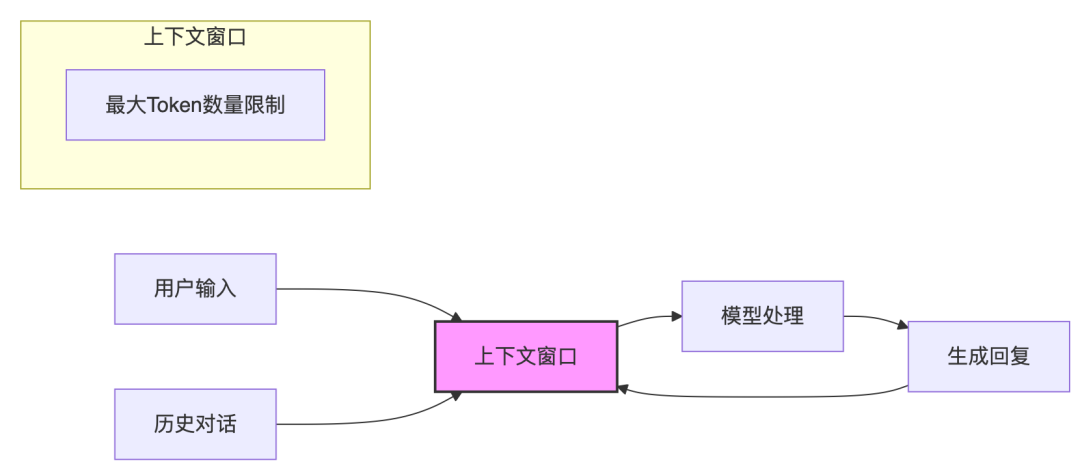

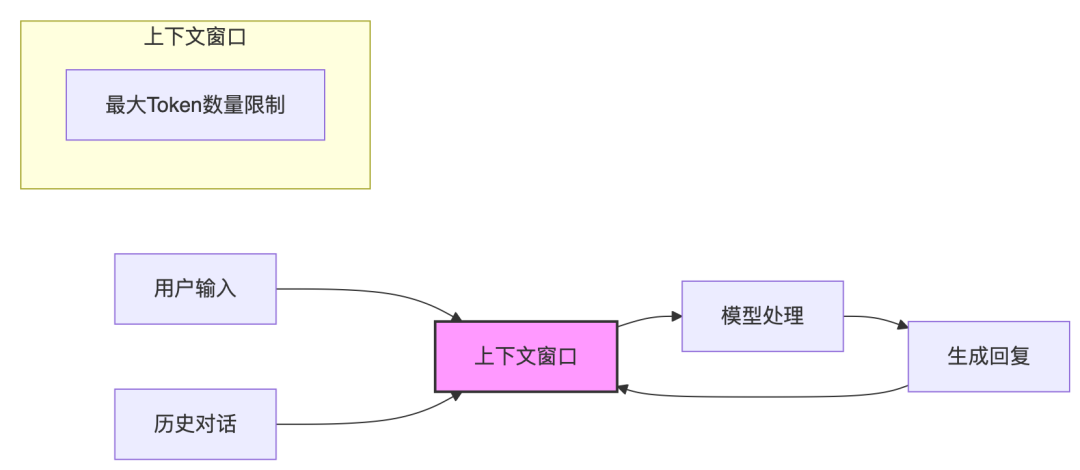

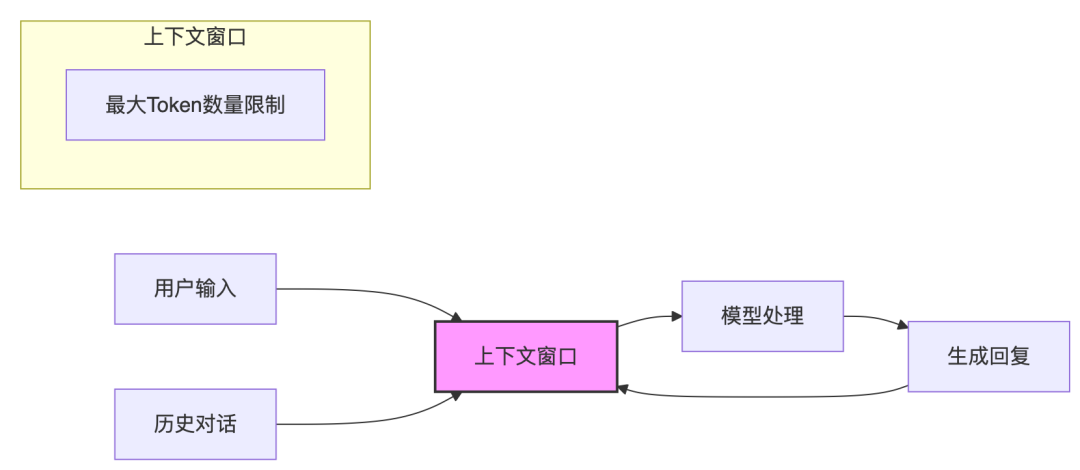

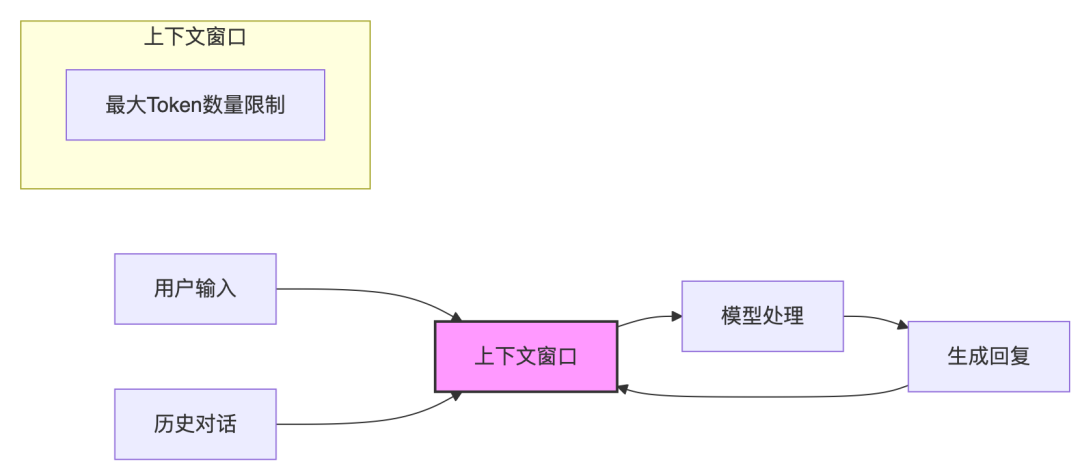

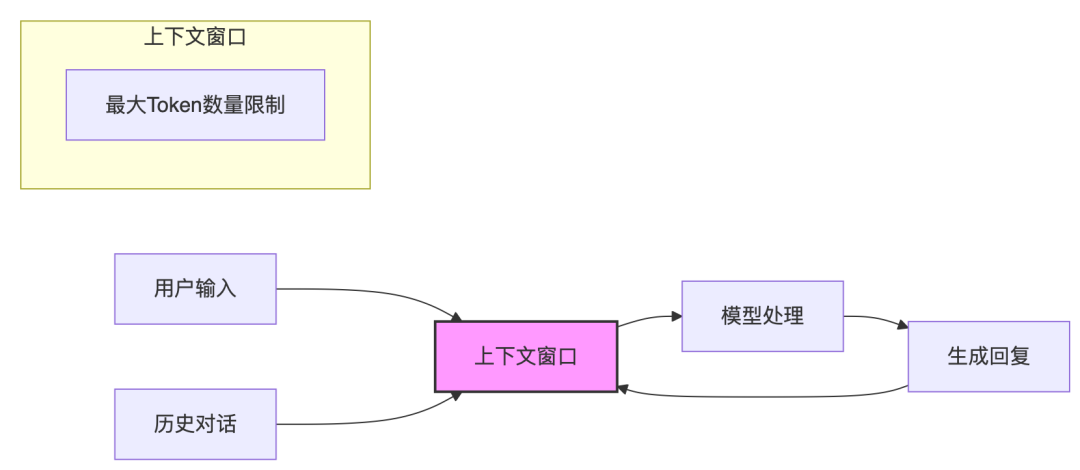

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 10

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 8

- 0

-

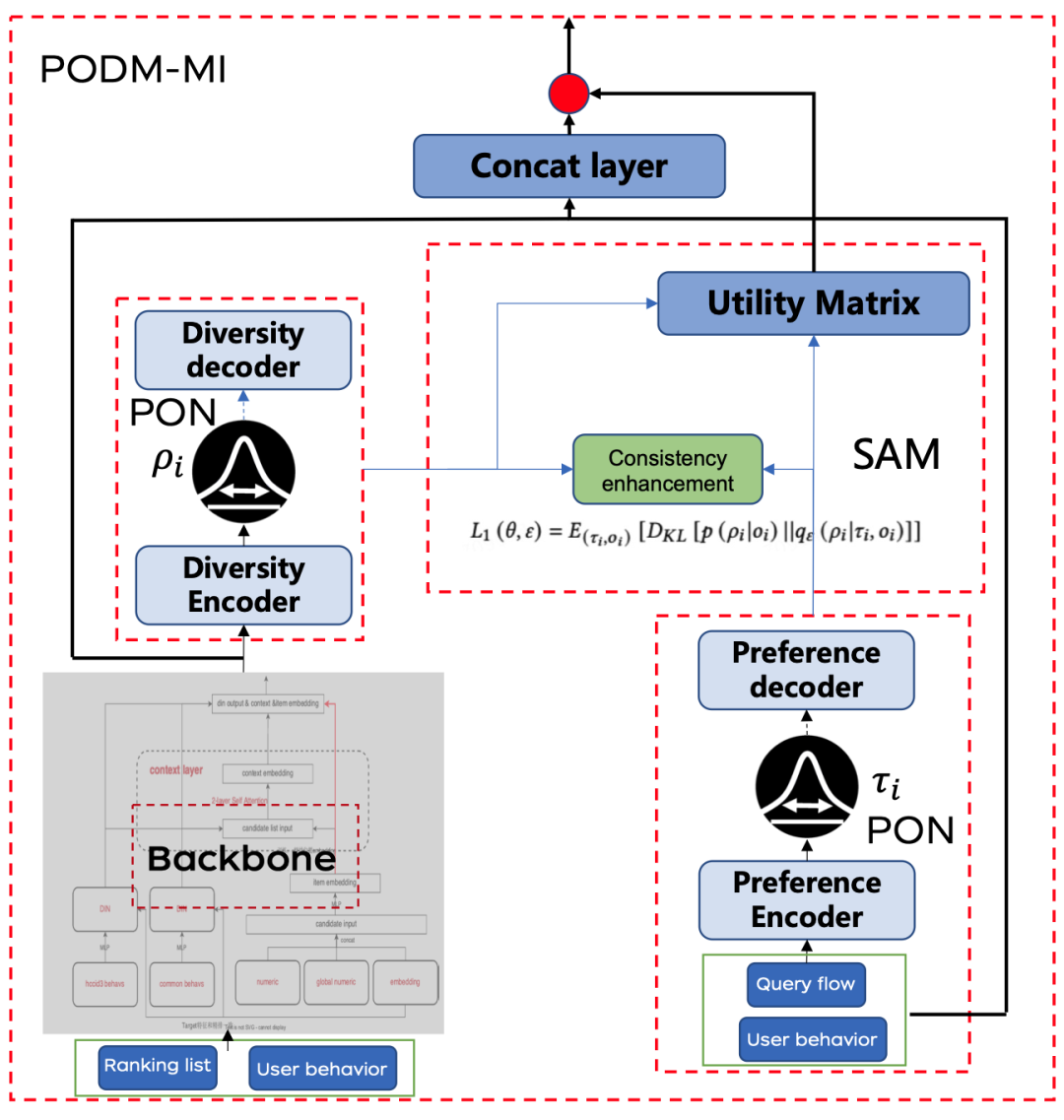

让大模型更懂你,京东零售的算法工程师做了这些事

在京东,技术从不是冰冷的代码,而是连接消费者与美好生活的桥梁。算法工程师慧沐用大模型赋能智能导购、搜索、推荐等电商场景,工作期间发表4篇顶会论文,提交专利8篇,并入选北京亦麒麟优秀人才。这些写进顶会论文的技术突破、藏在专利证书里的创新方案,都化作了消费者指尖上的流畅体验。这位博士毕业就加入京东零售的年轻人,让代码听懂生活的细语,让购物有超越期待的温度。以下是他的自述——从校园步入职场后,我深刻体会…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

如何让AI帮你做前端自动化测试?我们这样落地了

阿里妹导读本文介绍了一个基于AI的UI自动化测试框架在专有云质量保障中的工程化实践。 引言随着AI大模型技术的快速发展并在各行业/场景下的爆发式应用,如何利用AI技术提高测试效率也成为了热门话题。具体到我们团队的日常工作中,一个痛点就是前端测试很耗费人力,体现在: 1. 前端用例自动化率低/无自动化,每个版本、每轮测试依赖手工执行,在多版本、快速迭代的背景下就会导致覆盖不足,漏到客户现场的前端缺陷…- 7

- 0

-

企业构建Agentic AI应用当前4个难点和基础模块

_25S0212.png没想到现在“Agent”这个词已经开始区分为 AI Agent 和 Agentic AI 两个概念了。我原本以为只是普通 agent 和 multi-agent 的区别,事实上也确实有这种理解方式,比如我在上一篇文章提到的,单线程的 agent 和需要协调多个 agent 的系统。 这篇文章分为两个部分:01 部分简单介绍这两个概念,以及目前实现上的一些难点;02 部分梳理…- 5

- 0

-

Agent革命前夜,中国移动“九天”如何落地

在通信人的日常工作中,一半是海水,一半是火焰。火焰,是AI技术浪潮带来的兴奋与想象,几乎每周都有新的模型和概念涌现;海水,则是作为大型通信运营商,在面对新技术时,固有的组织惯性与现实的经营压力。近期中国移动成立九天人工智能公司,引发了我对于未来方向的深度思考。本文将结合AI Agent技术演进的观察,剖析中国移动在这场革命中的可行路径。PART 01从APP孤岛到智能体当前以智能手机为中心的“AP…- 6

- 0

-

用了它之后,我明白了Manus的困境

这两天很多人聊 Manus 裁员跑路新加坡的新闻。要我说,这是早晚的事,用过的都知道,它那些花里胡哨的能力,根本落不了地。而中国用户恰好是全球最卷、最实用主义的用户群。看起来酷炫,用起来全废?二话不说,直接被淘汰,更别说付费了。那中国 Agent 的出路到底在哪里?有一款最近悄悄上线的国产 Agent,我觉得,真正代表了中国 AI 走出的另一条路:不是炫技,而是真·可用。这是百度文库新出的通用智能…- 6

- 0

-

AI 将如何改变我们构建产品的途径

从千篇一律到千人千面的产品革命当我们打开一款应用时,如果界面能够根据使用习惯、当前情境和个人偏好实时调整,当产品团队测试新功能时,不再需要等待6-8周的A/B测试周期,而是在几分钟内通过AI模拟器预测用户反应,这样的产品开发模式正在从理想变为现实。传统产品开发面临的核心挑战目前数字产品普遍采用静态的"一刀切"界面设计,这种方式假设所有用户都有相同的需求和行为模式。然而,技术呈现…- 7

- 0

-

如何利用企业架构构建可扩展的数据和人工智能战略

概述随着数据和人工智能的爆炸式增长,以及通用人工智能(GenAI)的持续发展势头,企业正竞相确定自身的战略基点。制定稳健的战略、治理模式和任责结构的压力空前巨大。这不仅关乎数据和人工智能战略应该是什么,更关乎如何制定战略、由谁来领导,以及如何在整个企业范围内进行治理。遗憾的是,制定数据或人工智能战略的参考资料通常要么过于笼统,要么不够完整,很少适用于构建稳健的企业级战略。在光鲜亮丽、快速发展的人工…- 3

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

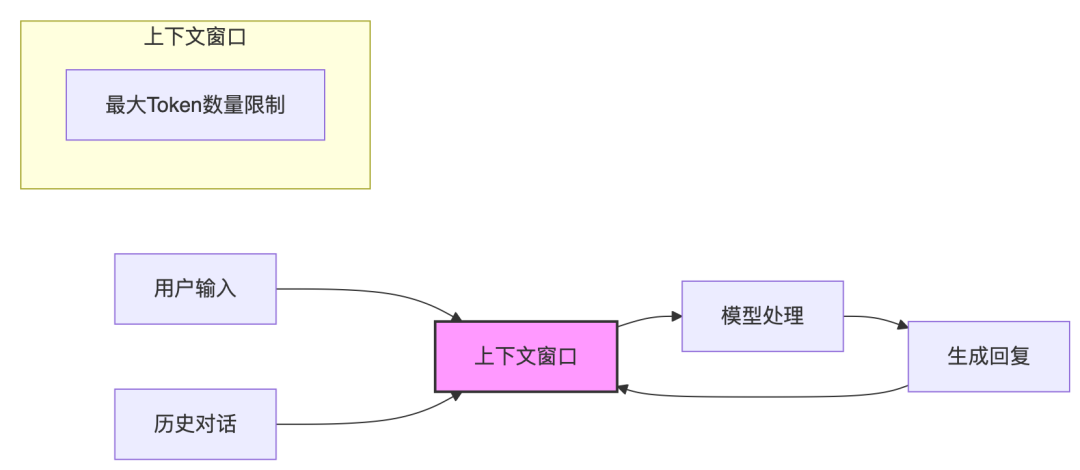

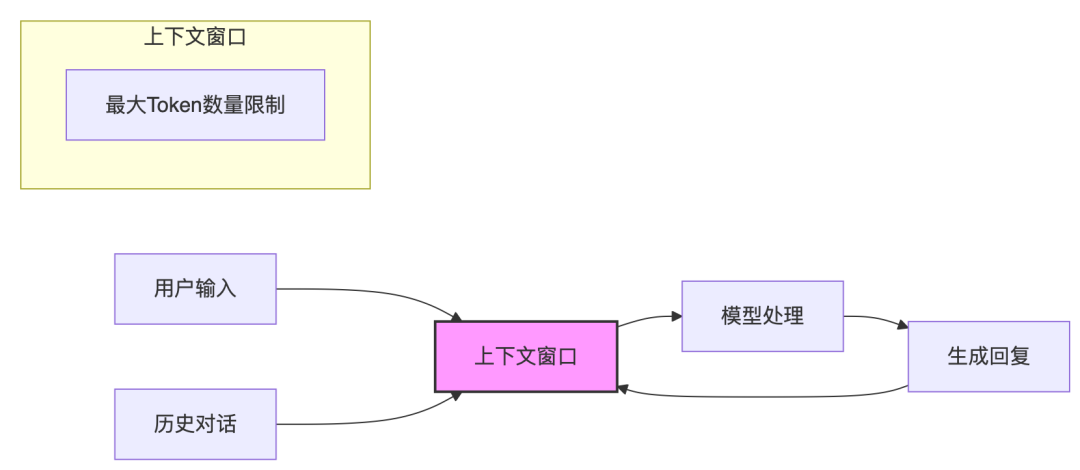

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

实战、通俗、落地:大模型浪潮指南

文:董指导 本期要点#大模型#人工智能#疯狂星期四读点好文字 前段时间,一位朋友家的天才孩子,在纠结保送复旦、还是冲一下北大人工智能。我当时建议是首先遵循孩子兴趣,其次尽量不要选人工智能。 理由有二:一是人工智能一直是波浪中前行,有周期性,等孩子读完、再就业的时候,可能就不是那么热门了; 二是,不热门的原因是,人工智能会非常普及,成为基础设施,专于人工智能、可能不如基于人工智能开发各种东西。就像电…- 10

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!