-

企业级Agent是AI创业唯一的大机会

之前我锐评了AI创业的各个方向,把当前热门的AI方向都质疑了一圈,现在我再多得罪一个,就是ToC的Agent不管出不出海是不是全球市场都没有什么大机会。点对点的批判意义不大,也很得罪人,我先完整论述一下我的逻辑,在这个框架下稍微延伸一点对ToC的质疑,足够委婉、含蓄,只叫醒想醒的人,不得罪装睡的人。我们讲过去的全球SaaS或者说未来的Agent,他们的价值来源到底是什么。没有价值是肯定没有创业机会…- 7

- 0

-

Anthropic多智能体如何破解企业级任务并行处理瓶颈?

点击卡片 关注我们虎嗅智库荐语:前不久,Anthropic公司正式推出多智能体Claude研究系统。 在内部评估中,该系统性能较单智能体有多项显著提升。其核心架构包含哪三个关键层级?各层级的主要功能是什么?相较单智能体系统效率提升的关键技术因素是什么? 本文带您了解该技术体系为复杂场景下的如何智能决策提供可量化的解决方案。 来源丨爱冲浪头图丨AI生成Anthropic于2025年6月正式披露其多智…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

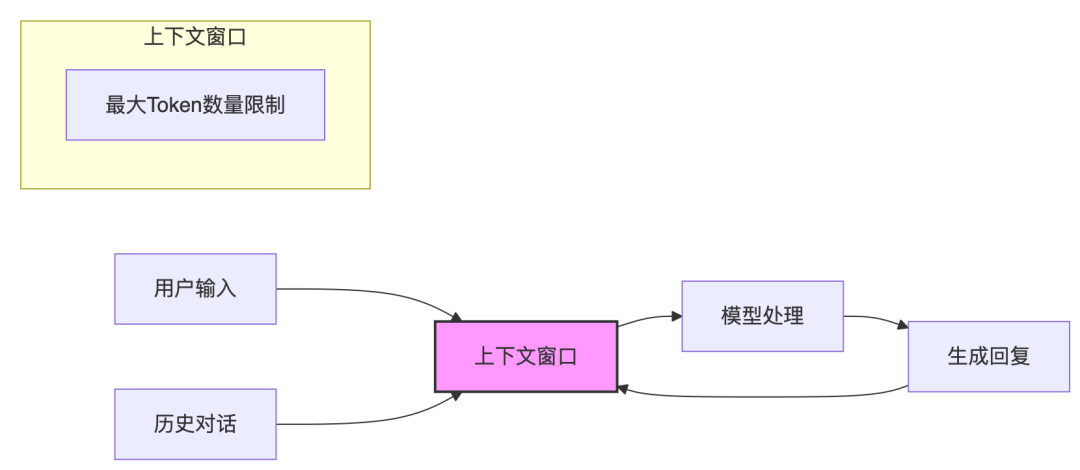

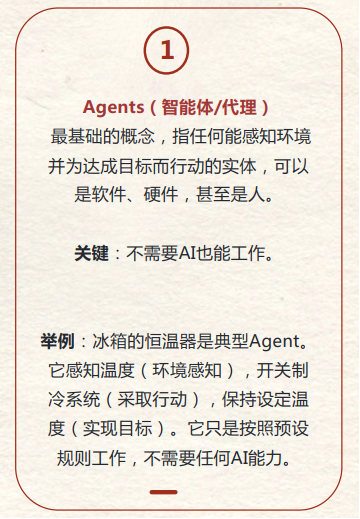

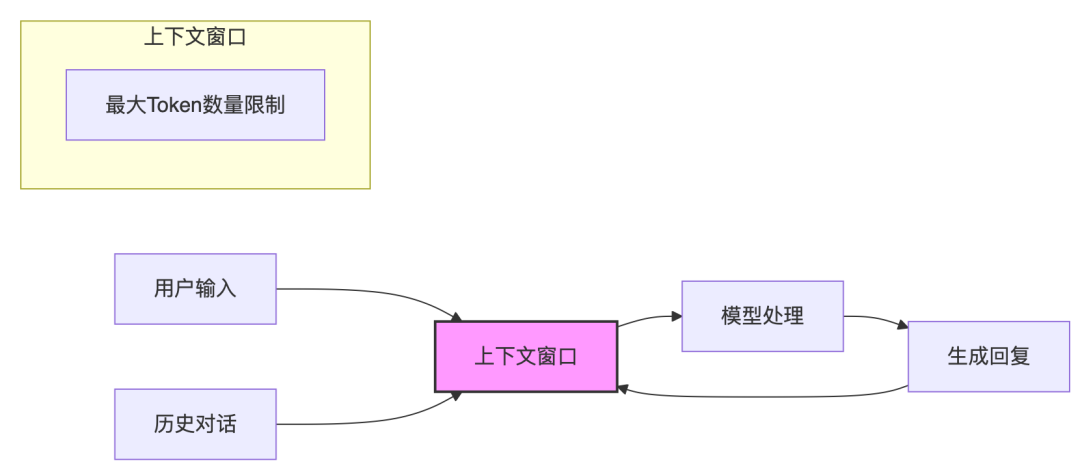

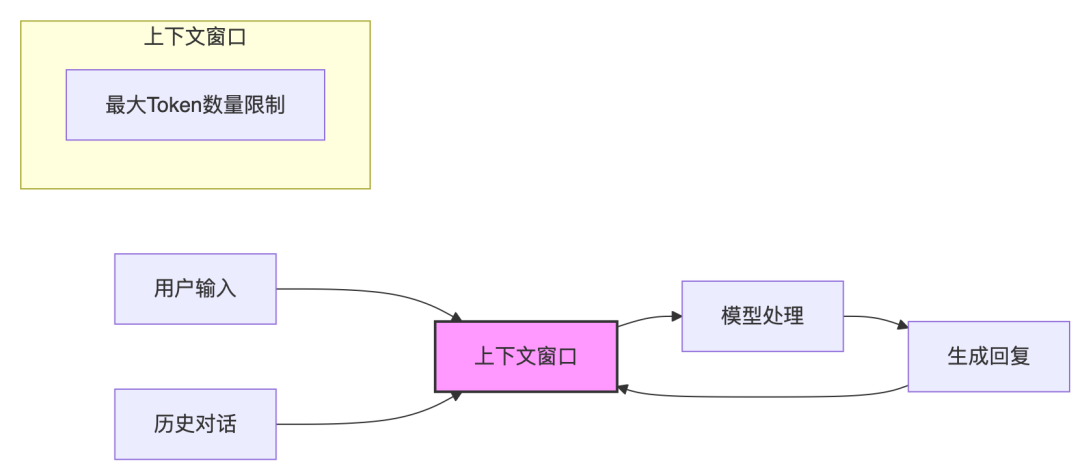

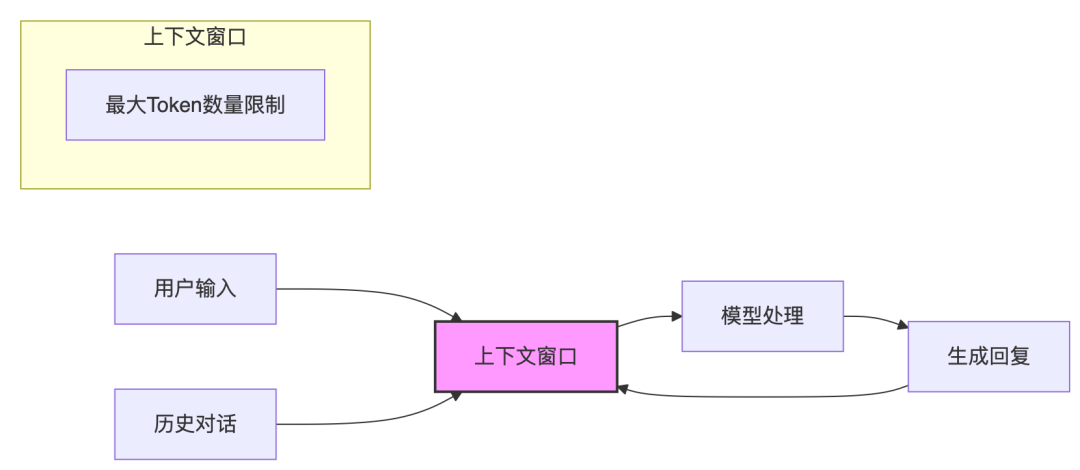

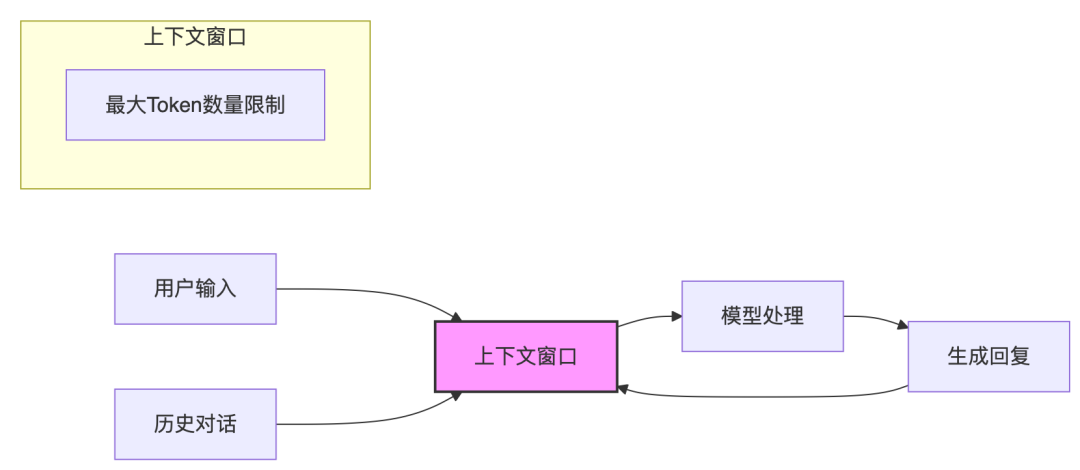

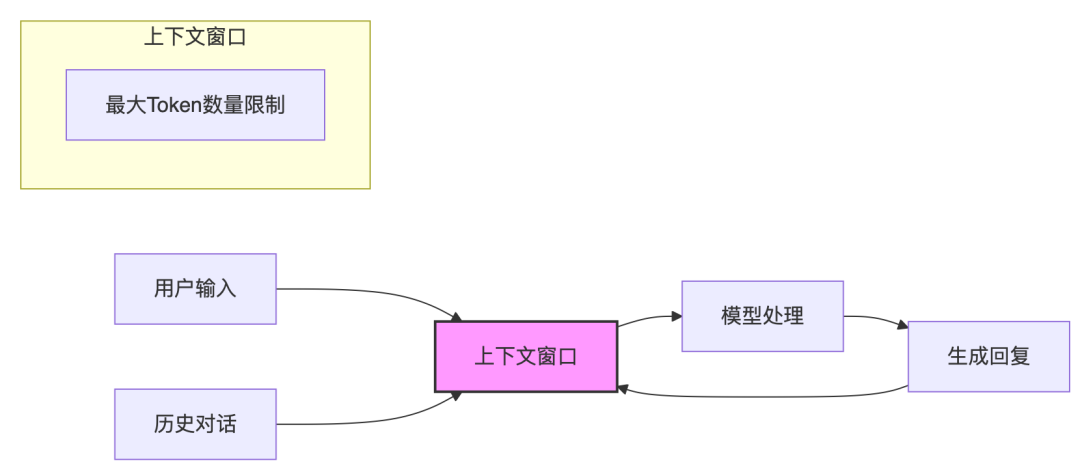

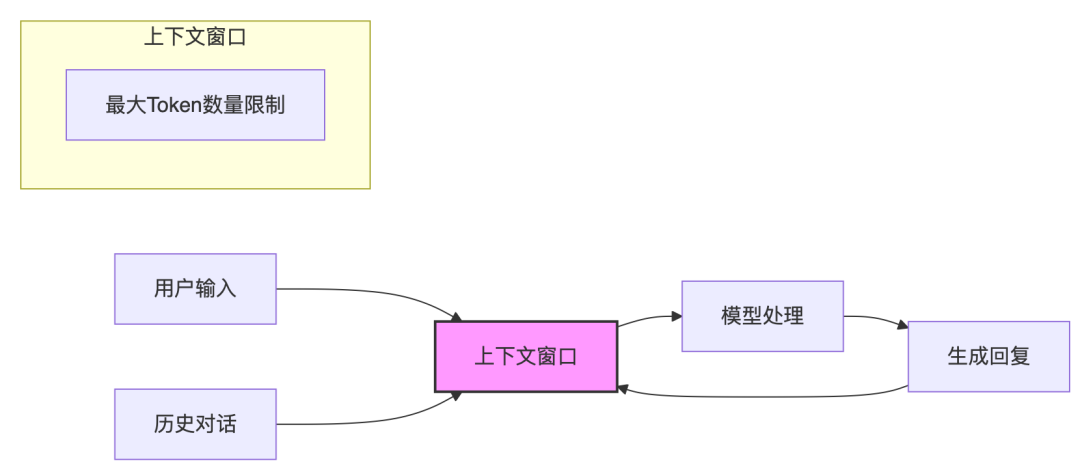

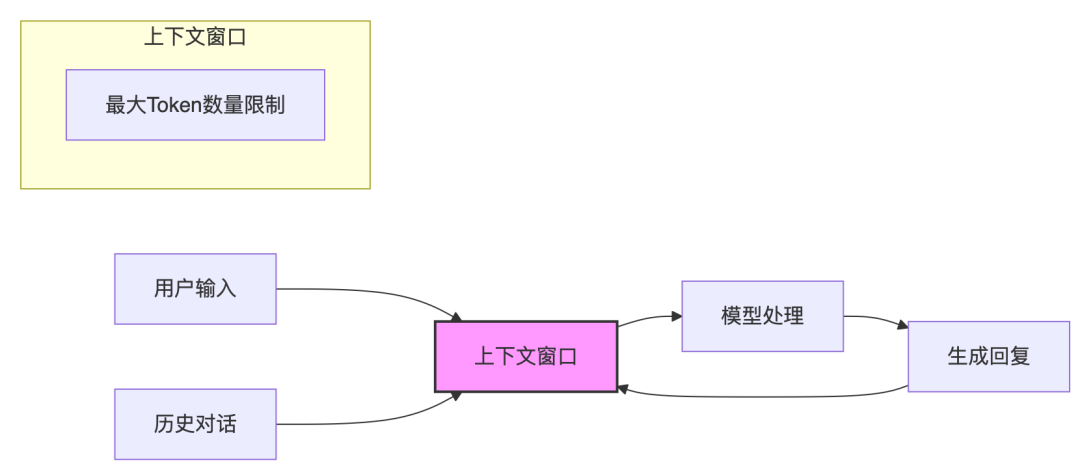

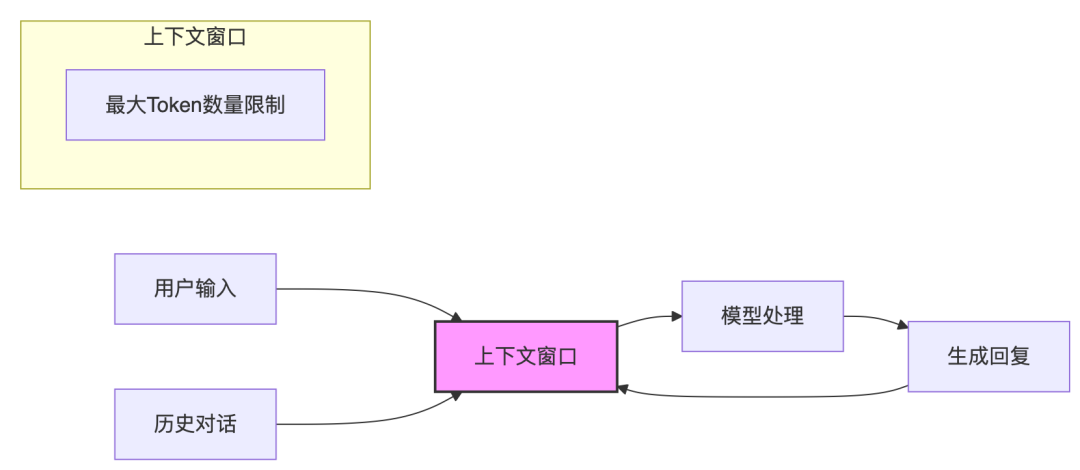

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

RAGFlow vs FastGPT,做RAG系统谁更牛逼

RAGFlow和FastGPT都是当前非常活跃且功能强大的开源 RAG(Retrieval-Augmented Generation)框架,旨在帮助企业或个人更高效地构建基于私有知识库的智能问答、文档分析等应用。RAGFlow核心定位RAGFlow 的核心目标是打造一个面向复杂、专业文档(特别是结构化/半结构化文档)的高性能、高精度、企业级 RAG 引擎。它特别强调深度文档理解能力,能够精准地解析…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

迈富时零售AI创新解决方案:AI Agent+智能体中台重构零售消费增长新引擎

在刚刚落幕的“第11届中国消费品行业CIO大会暨中国第3届AI大模型应用大会”上,Marketingforce迈富时凭借企业级AI-Agentforce智能体中台赋能零售消费增长的创新实践,荣获「年度零售AI解决方案创新奖」。集团合伙人·CMO尹思源在大会上发表《零售消费‘智变’加速:AI Agent+智能体中台,重构企业增长新引擎》主题分享,深度解析 AI 技术如何从底层逻辑重塑企业营销销售与运…- 6

- 0

-

调研了300家企业,ICONIQ 发布《开发者手册:2025年AI现状报告》,揭秘企业AI落地的全景路线

自2022年年底ChatGPT 3.5发布以来,AI的发展貌似进入了一个快车道。如果说各种模型层出不穷的2024年是AI技术突破的一年,那2025年一定是AI应用落地的一年。大量的企业从要不要用AI的纠结,开始转变为了怎么才能更好的使用AI…半年过去了,企业的AI应用落地进展如何?AI到底是一场“泡沫”,还是通过AI确实搞到了钱?仅仅是工具的转换,还是工作方式的一场变革?…最近,知名的投资机构IC…- 6

- 0

-

一表辨析AI Agent vs. Agentic AI

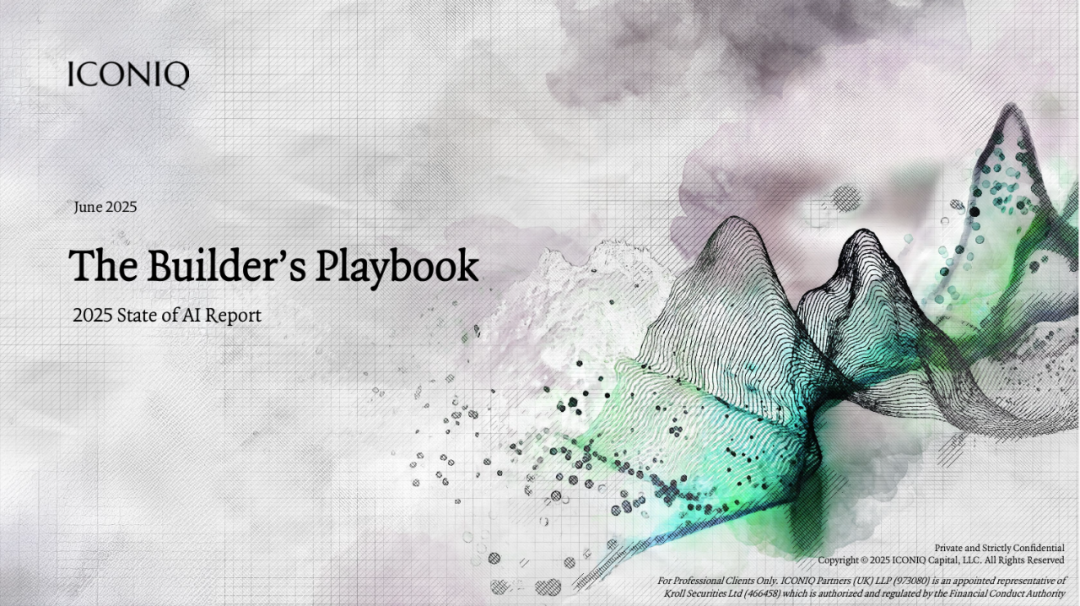

在人工智能领域,“Agent(智能体)”与“Agentic AI(智能体人工智能)”代表了两种不同层级的技术范式,它们在架构、能力和应用场景上存在显著差异。AI Agent定义: “任何能够通过传感器 (Sensors) 感知其环境 (Environment),并通过执行器 (Actuators) 对其环境产生行动 (Action) 的事物。” —————— 罗素和诺维格《人工智能:现代方法》 A…- 11

- 0

-

AI时代的五重叩问:工具 · 连接 · 权力 · 未来 · 自我

写给这个时代每一位在自问“我们要走向何方”的探索者。AI 将探讨内容提炼出如下问题。 在一个信息无限扩张、注意力不断稀释、焦虑弥漫其上的时代,我们是否都感受到一种共同的低频震荡——意义的稀薄与连接的断裂? 而AI的降临,是加剧了这种人类之痛,还是悄然开启了一道朝向“重构”的缝隙? 我们不试图回答任何问题。我们只在废墟上刻下问题本身。 Ⅰ|“工具”:AI是认知的延伸,还是思想的牢笼? 当AI日益承担…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 16

- 0

-

AI狂潮下:大公司如何破解”创新者窘境”?

撰 文 | 伍晖 《中欧商业评论》特约作者,创新与人才独立研究者 公司越大,越容易陷入“创新者窘境”在AI技术带来的颠覆性浪潮中,传统大公司正面临前所未有的两难抉择:既要维持现有业务的运营效率,又要捕捉分散多变的新机遇。集中化创新模式——如小米造车、华为芯片研发采用的"压强原则"——在目标明确、资源密集的领域依然有效。但当战场转向AI应用层时,这种模式的局限性开始显…- 3

- 0

-

模型知识库在工业场景中的实战经验分享:从“纸上谈兵”到“现场可用”

作为一名大模型知识库产品经理,最近在工业装备领域做了一个非常有意思的知识库RAG(检索增强生成)项目。从最初的“纸上谈兵”到最终的“现场可用”,这个过程充满了挑战与突破。今天就来和大家分享一下我的实战经验,希望能给正在探索工业场景AI应用的小伙伴一些启发。问题一:工业文档“又大又复杂”,知识库到底怎么建?工业装备的使用手册、维护手册动辄几百页甚至上千页,内容涉及大量的专业术语、技术参数和图表。传统…- 5

- 0

-

从Rax+DX到React,一次跨端组件重写的AI提效探索

阿里妹导读本文基于M站首页重构项目中的一个真实需求,讲述如何借助 AI编程工具 Cursor + 结构化 Prompt 设计,完成从 Rax 到 React 的组件迁移、DX 到 React 的跨端重写,并实现业务逻辑优化与工程规范落地的全过程。 一、背景最近在进行M站(WAP)首页项目重构时,遇到了一个颇为头疼的问题:需要将原有的Rax框架工厂推荐瀑布流组件迁移到新的React框架项目中,同时还…- 6

- 0

-

一文了解智能体协议 MCP . A2A . ANP . AGORA

智能体通信协议的兴起 智能体(AIAgent)是基于大型语言模型(LLM)构建的系统,具备自主决策、长期记忆、任务规划和工具调用能力。与传统的单一模型不同,智能体需要在复杂任务中与其他智能体或外部工具协作,例如跨企业的供应链优化、医疗数据共享或智能家居设备协同。然而,不同供应商和框架开发的智能体往往形成“孤岛”,缺乏统一的通信标准,导致协作效率低下。 为解决这一问题,MCP、A2A、ANP和AGO…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

豆包又在偷偷进步!超能创意2.0内测,语意理解能力追平FLUX Kontext

大家好,这里是#AIGC创意猎人 我是与大家一起玩转AI的何先森Kevin技术架构全面升级突破 豆包,真的是见过的“最努力”的AI了,几乎每次打开电脑客户端,都会提示版本更新!而且各种功能上新的也很快! 这不,豆包的文生图“超能创意1.0”,都还怎么用, “超能创意2.0”Agent就来了! 不知道是不是来自FLUX Kontext的压力,多模态图像编辑领域,最近可是热闹极了~~说白话就是:太卷了…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

用cherry studio+mcp访问本地数据库

MCP的功能实在是太强大了,目前很多工具也支持mcp,通过mcp,我们可以用自然语言去调用API、去访问数据库。 今天大瑜就分享用最简单工具来访问本地数据库sqlite。 步骤一:软件安装与配置 这里推荐的软件是cherry studio,国产工具,配置好就可以直接和AI大模型对话。 安装方式也很简单,直接下载即可。官方地址: https://www.cherry-ai.com/ 傻瓜式安装即…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 2

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!