-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

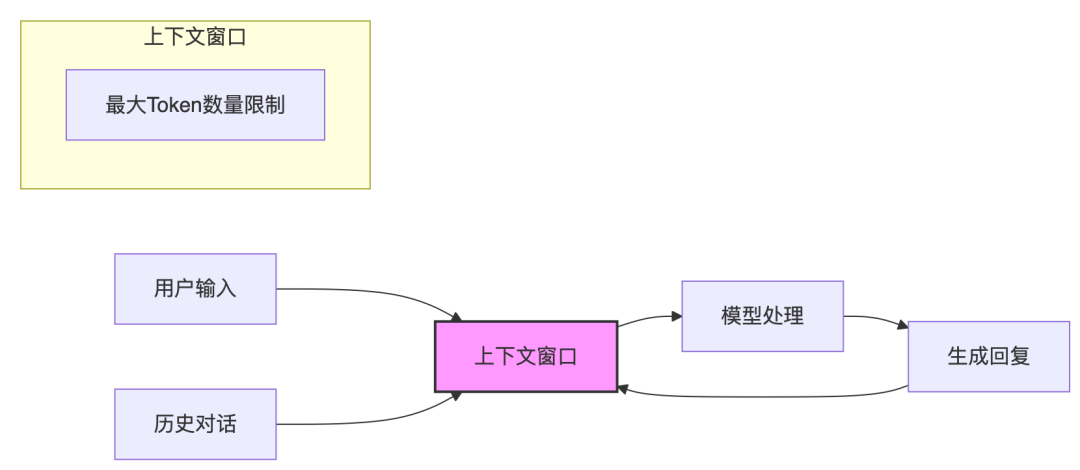

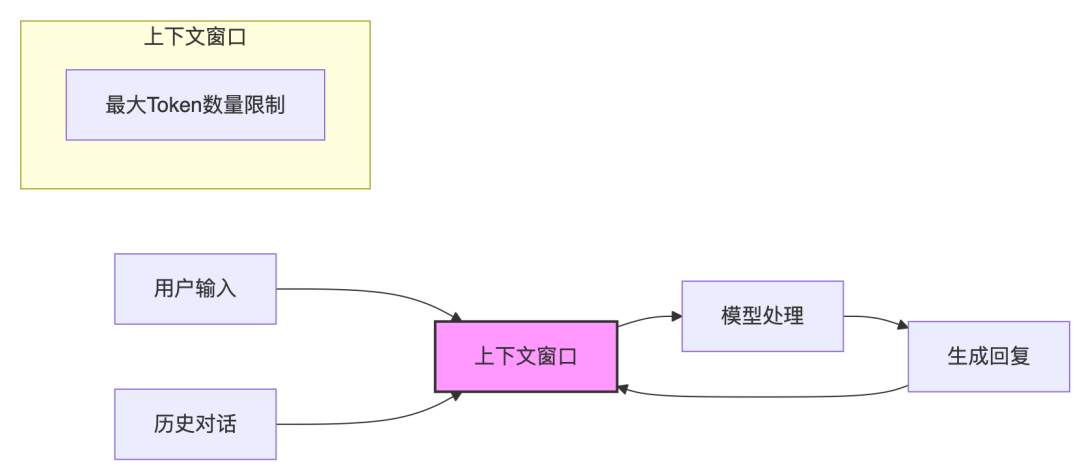

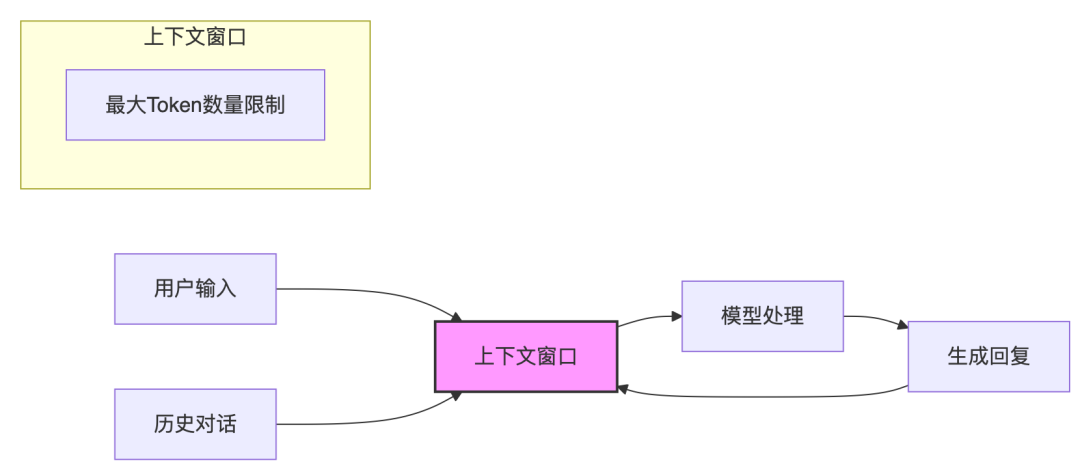

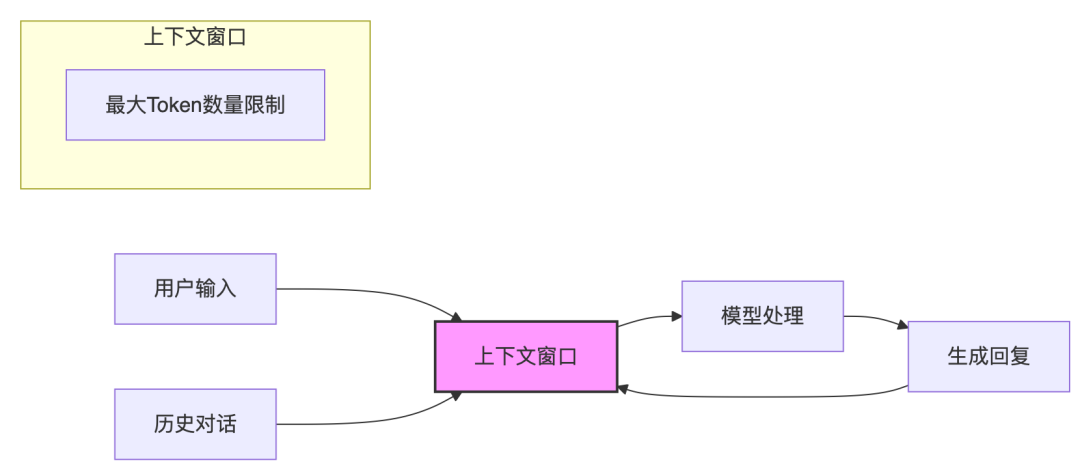

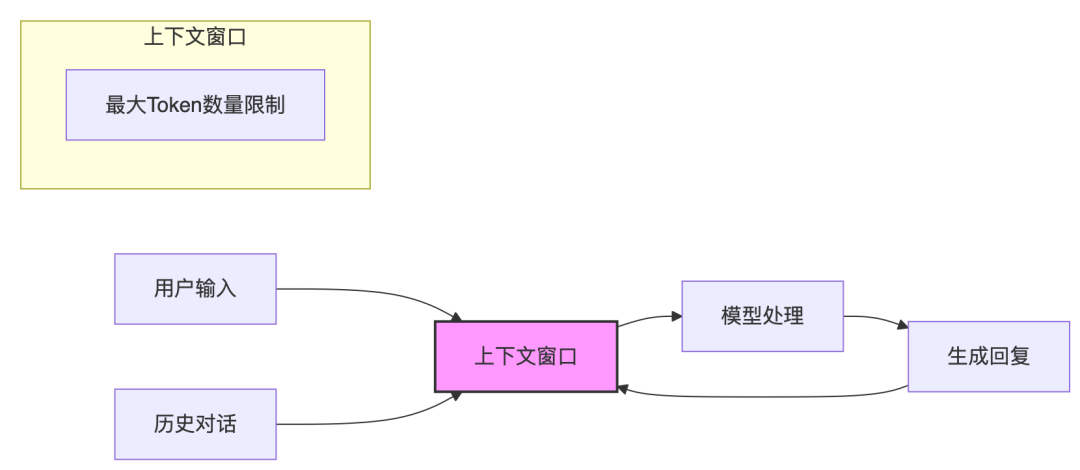

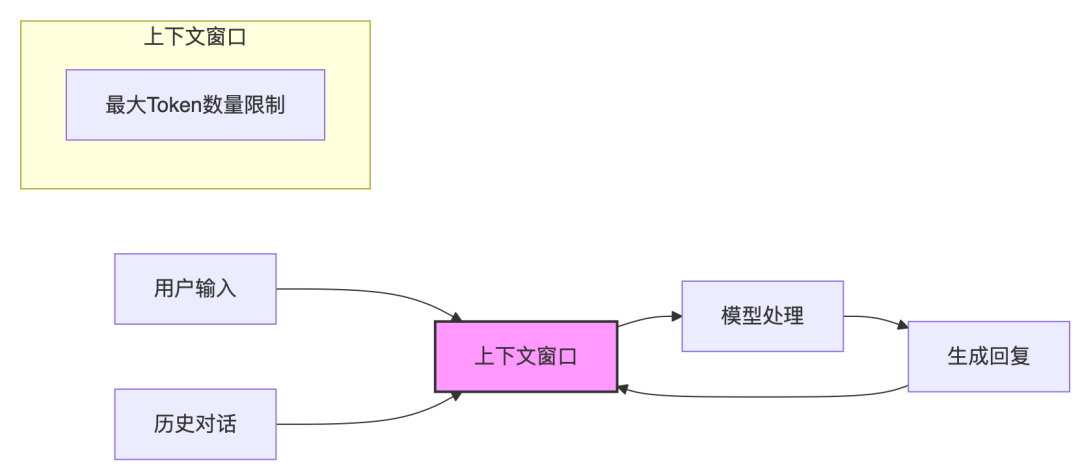

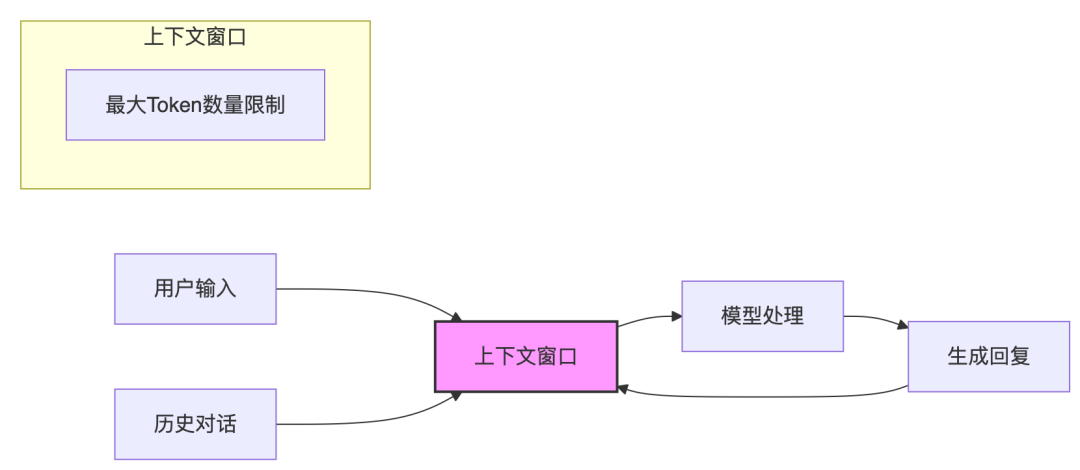

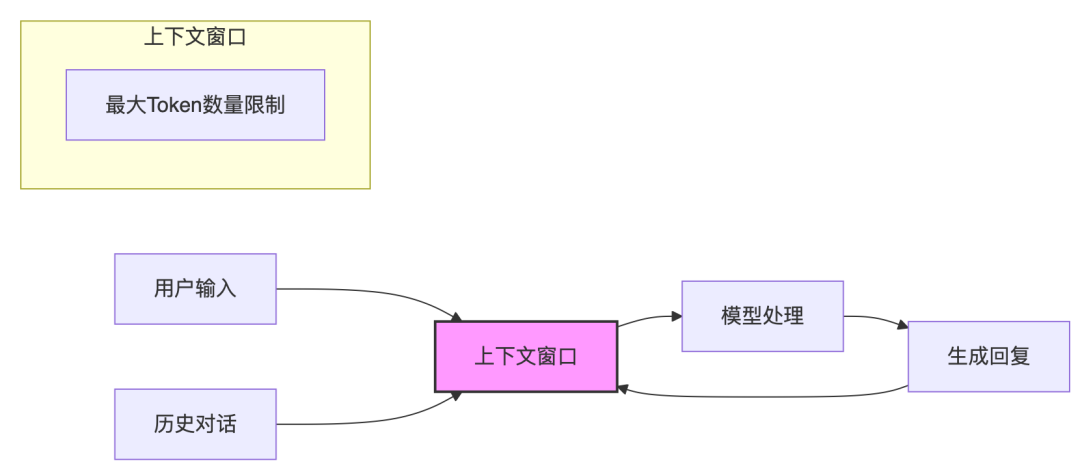

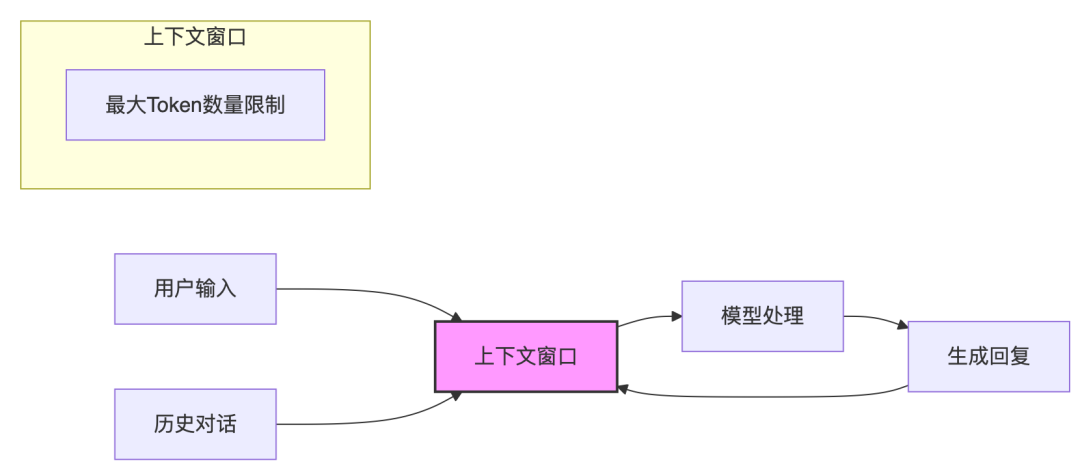

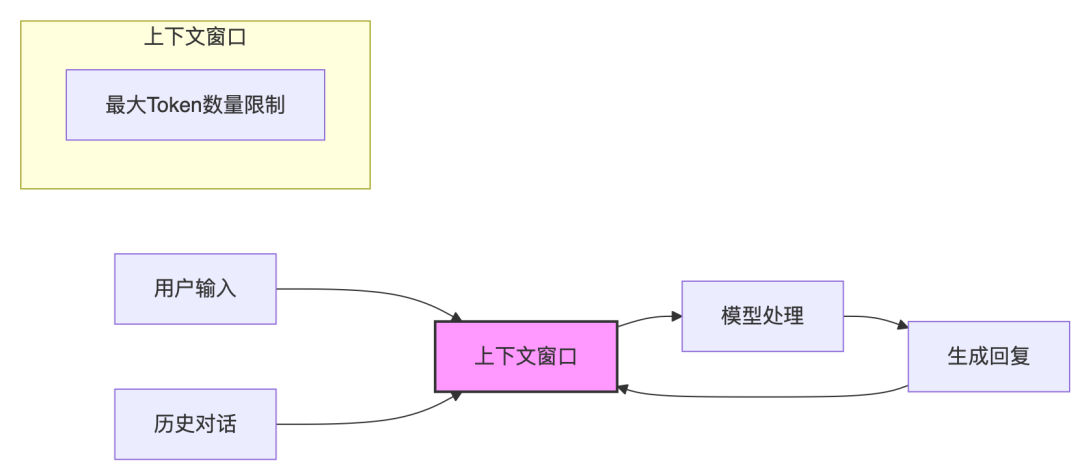

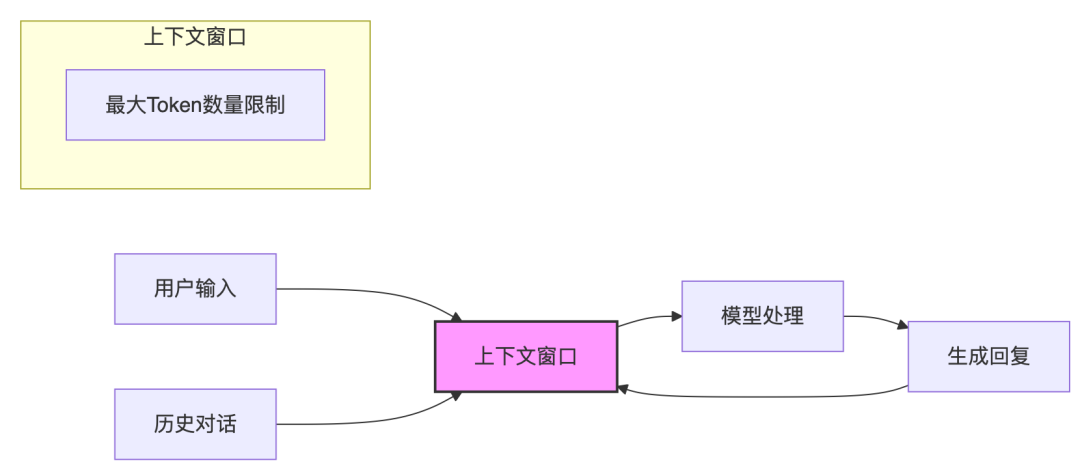

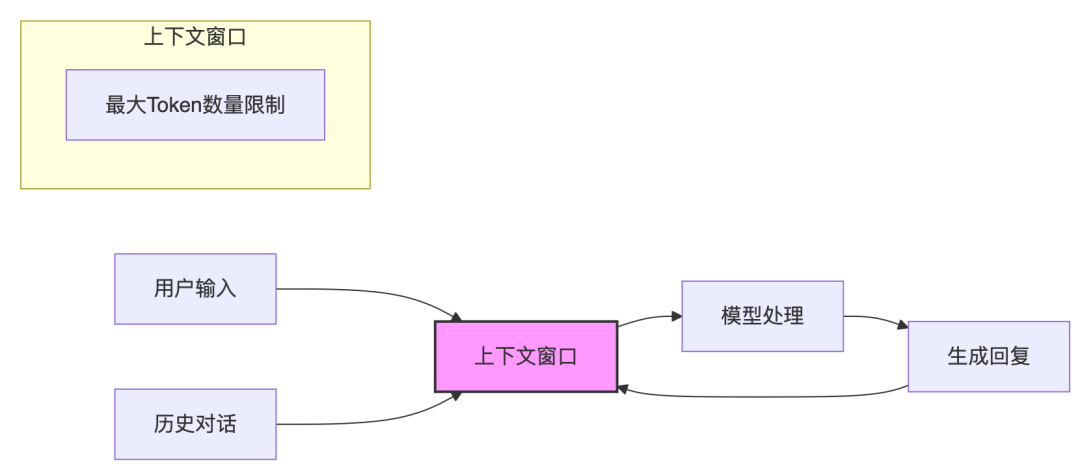

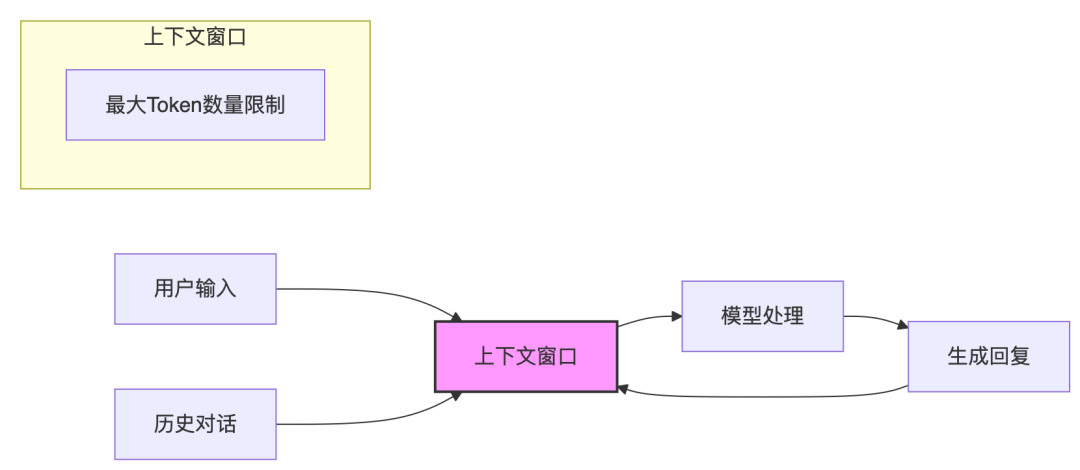

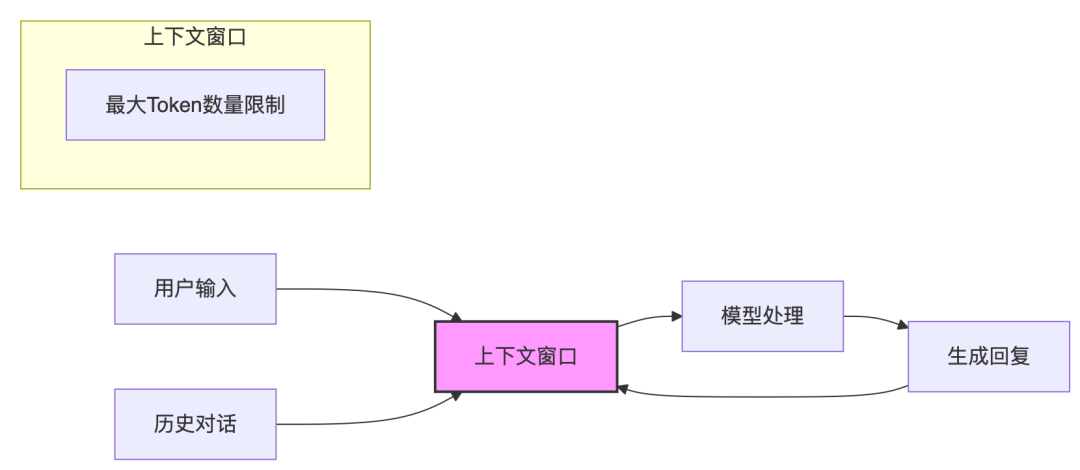

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

AI Agent的记忆体系与架构设计

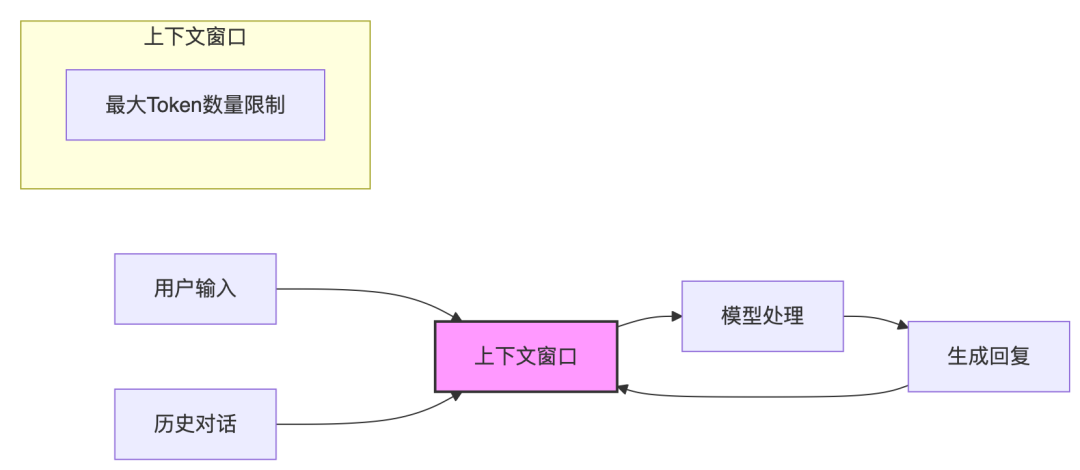

LLM本质上是无状态的模型,每次调用都像一次“短暂失忆”。为了让 AI Agent真正理解上下文、具备个性化交互和任务持续性,引入记忆系统至关重要。本文将从技术与架构角度出发,介绍构建短期和长期记忆的方法和最佳实践。一、AI Agent中的记忆类型1. 短期记忆(Short-Term Memory)• 主要通过上下文窗口或滚动缓存维持;• 适用于保持当前会话连贯性;• 依赖于 LLM 的 toke…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

Ilya 最新演讲:AI 将递归构建更强大的自己

AI自我进化的时代正在到来! 刚刚,Ilya Sutskever 在以色列开放大学的演讲中抛出了一个让人细思极恐的观点:AI将开始递归地构建更强大的AI。 这不是科幻小说,而是正在发生的现实。 在视频中,Sutskever分享了他从俄罗斯移民到以色列,再到成为AI领域顶尖研究者的传奇经历。但更重要的是,他对AI未来的深刻洞察。 从开放大学到AI巅峰 Sutskever的故事始于一个偶然。 五岁时随…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

AI Agent 大爆发背后,YC发现了 90% 都跑不通的真问题

「人人都在做“聪明的Agent”, 真正的稀缺, 是能落地的笨办法。」 读完本文,你将了解: 2025 YC AI Startup School 的核心动向与隐性信号 马斯克、奥特曼、Karpathy、纳德拉等巨头的底层思维 下一波 AI 创业的真正护城河,不在模型,而在结构化思维与执行 为什么“可评估的 agent”比“更强的模型”更值钱? 如何在 GPU 紧缺和监管前置的时代活下来、卷出来 我…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 13

- 0

-

聊过 200 个团队后的暴论:不要拿 AI 造工具,要建设「新关系」

本文根据极客公园创始人&总裁张鹏在 Founder Park AGI Playground 2025 上的演讲整理而成。 今天团队给我的任务是「你这几年聊了所有 AI 领域的先锋创业者,能不能分享一下你的观察和收获」。 我先说说自己的感受吧,过去三年真的很「酸爽」。技术的进步和产品的创新,一开始是赏心悦目,转眼就成了应接不暇。跟上时代不被「拉爆」,需要加倍努力,其实每个人都很辛苦。 但这又…- 15

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

开发Agent,有哪些值得做的脏活累活?

做Agent,并不只是在那里摆弄大模型,有很多吃力但能显著改善用户体验的部分,才是我们应该重点关注的对象。最近吴恩达与LangChain 联合创始人的对话,聊到了目前最需要的Agent开发技能。我摘抄、总结、注解成文章。 https://www.youtube.com/watch?v=4pYzYmSdSH4 一、自动化已有业务流程的能力 把现实流程(如查询、审核、数据检索)拆成清晰、有序的子任务并…- 7

- 0

-

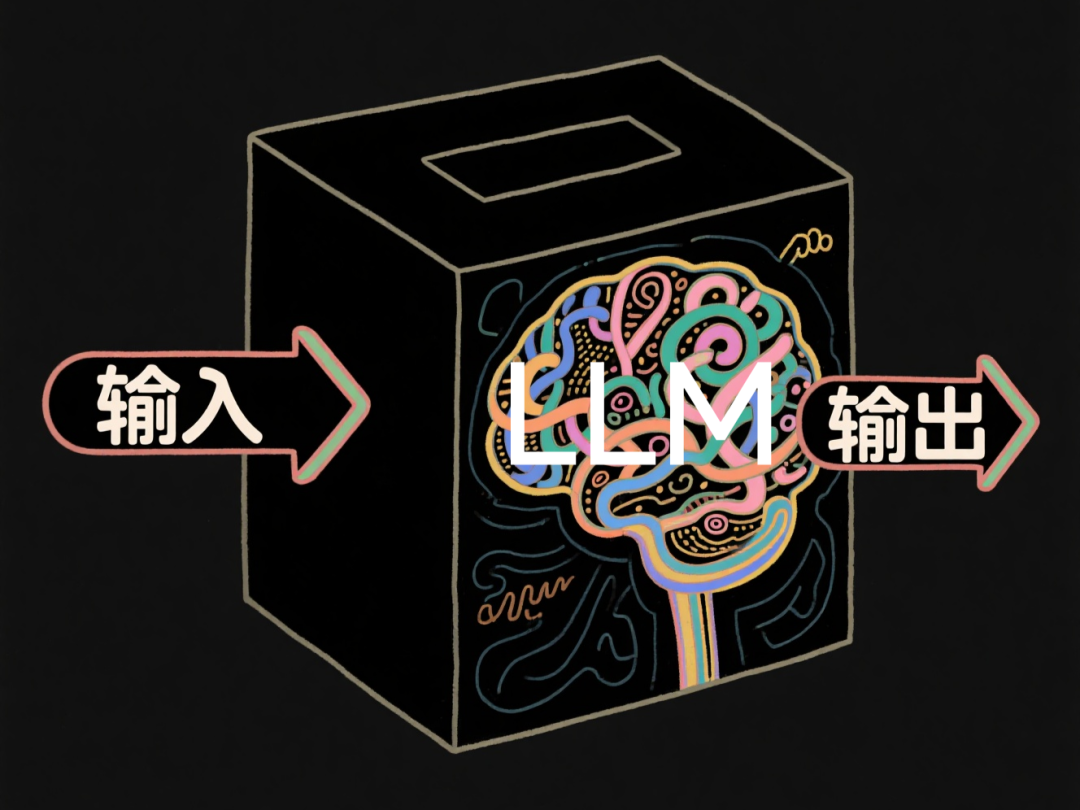

从“一问一答”了解大语言模型的工作原理

你是否有过这样的疑惑: 当你问AI一个问题,它会思考片刻,然后开始逐字逐句往外“蹦出”答案。 AI这个“黑盒子”后面,到底发生了什么? 它真的在“思考”问题吗? 这个数字大脑是如何工作的? 让我们从一个简单的问答过程出发,来揭开大语言模型技术的神秘面纱。 第一步: 理解“输入” 想象一下,当模型看到你输入的文字,第一步不是像人一样直接理解语义,而是像处理一道复杂的数学题,需要先拆解、编码。 它把你…- 6

- 0

-

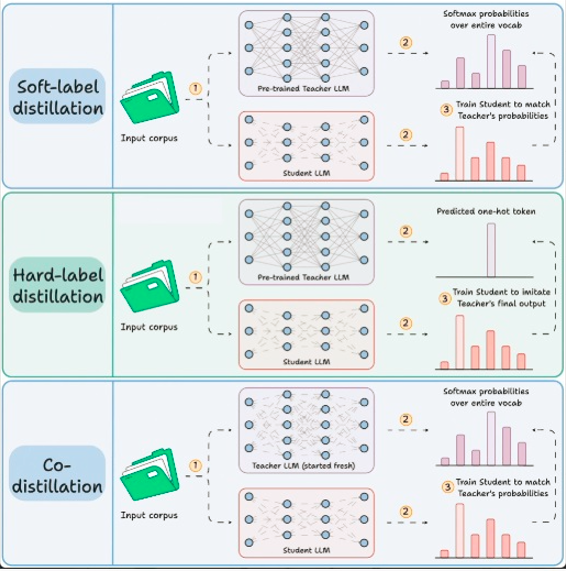

小模型也能“偷师”顶尖水准?详解三种蒸馏术,效果不输本尊!

你知道吗?大型语言模型(LLM)不仅能从海量的文本数据中学习,还能从其他LLM那里“偷师”!比如,Llama 4 Scout 和 Maverick 就是通过 Llama 4 Behemoth 这个更强大的模型训练出来的。谷歌的 Gemma 2 和 Gemma 3 也利用了自家 Gemini 模型的“经验”。这种模型之间的互相学习,靠的是一种叫做“知识蒸馏”的技术。今天,我们就来聊聊三种流行的知识蒸…- 8

- 0

-

两小时给公司开发个新官网,来自 MiniMax 的震撼

说起官网就发愁 我们公司一直很“低调”,尤其是官网。其简陋程度,和公司在安全验证赛道的地位,形成了较大落差,以至于 Gartner 分析师一度以为这是个骗子公司。 于是,很多朋友私下提醒,你们该换换官网啦 看你们新的产品(陆吾),在官网都查不到 发布会都开完了,官网也没看到任何信息更新 你们也不做 SEO,搜索有效性验证都找不到知其安 官网好比人的脸,这看起来给人感觉不正规 用的商业图片,小心侵权…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

Doc2Agent“爬”了所有API文档,一键API,MCP简单了

我想问您一个问题:上次为了让AI代理调用某个第三方API,您花了多长时间写包装代码?一天?三天?还是一周?不过现在,Brandeis大学的研究者们带来了一个让人眼前一亮的解决方案——Doc2Agent,它能从API文档直接生成可执行,MCP可调用的Python工具,而且成功率还挺不错。 链接:https://github.com/coolkillercat/Doc2Agent [1] 真实世界的A…- 4

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!