-

Anthropic 新研究:人们如何使用 Claude 寻求支持、建议和陪伴

我们投入大量时间研究 Claude 的 IQ——也就是它在编程、推理、常识等测试中的能力。但它的 EQ 又如何呢?换言之,Claude 的情绪智力表现怎样? IQ/EQ 之问带有些许玩笑的成分,但它引出了一个严肃的议题。人们越来越多地将 AI 模型当作随传随到的教练、顾问、咨询师,甚至是浪漫角色扮演的伙伴。这意味着我们需要更深入地了解它们的情感影响——即它们如何塑造人们的情感体验和幸福感。 研…- 6

- 0

-

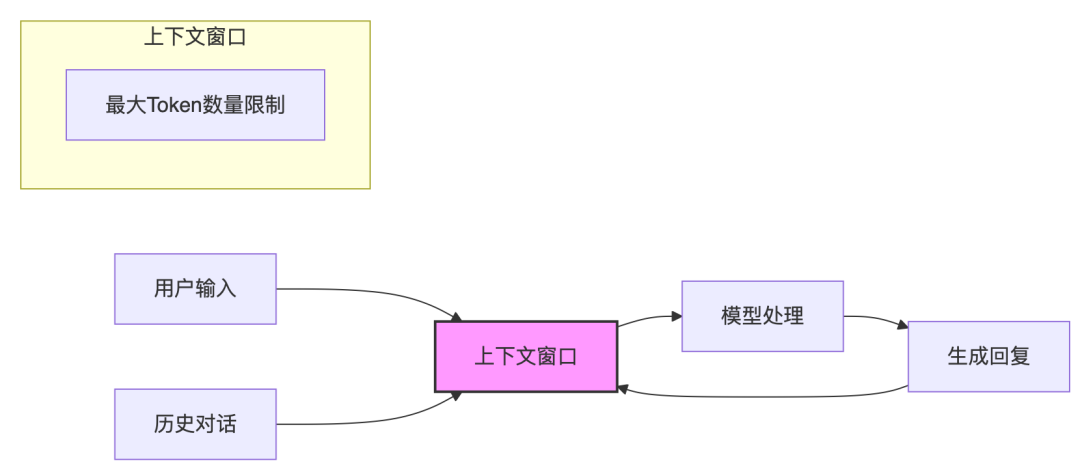

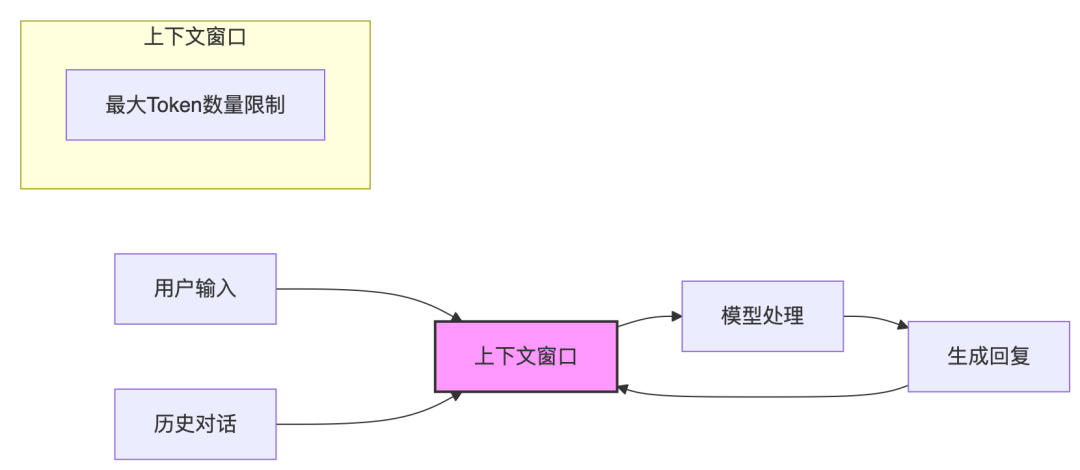

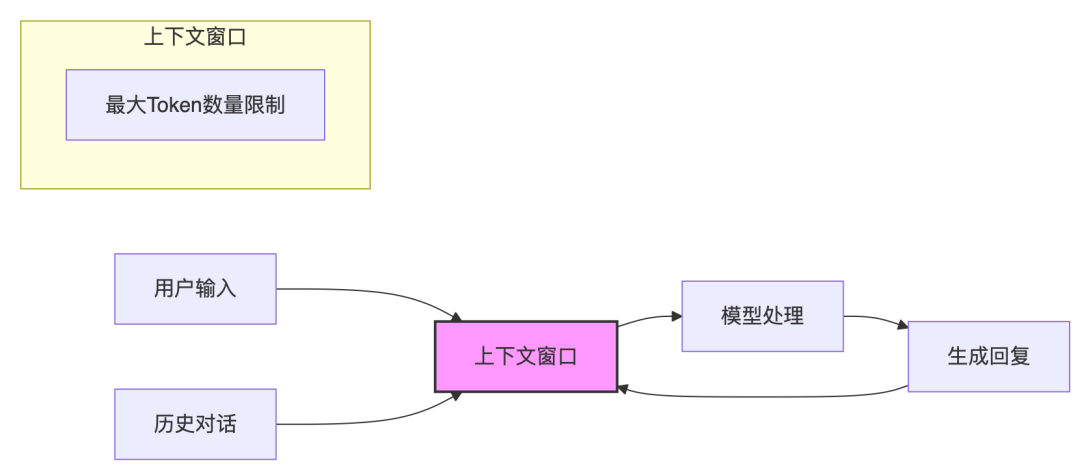

🧠 解码大语言模型的记忆力:上下文长度的前世今生

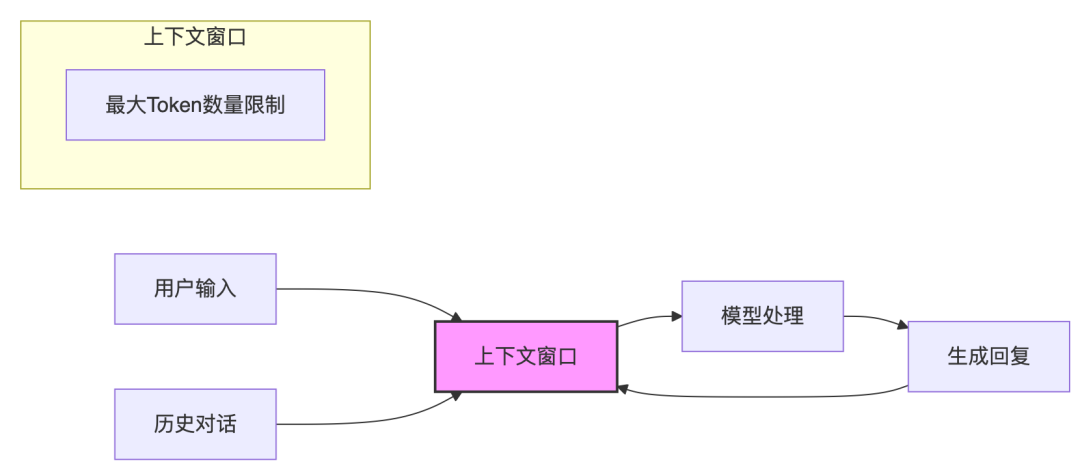

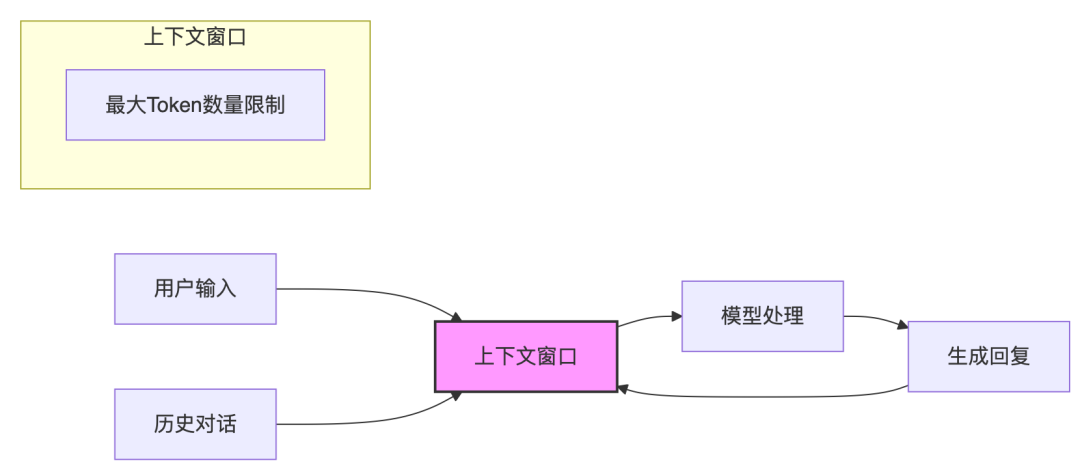

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

A16z最新观察:速度只是入场券,AI应用真正赢在这4条护城河

OpenAI声称其技术已渗透全球10%的系统,许多《财富》500强企业也都启动了CEO挂帅的AI整合工程。人工智能,已不再是“试水项目”,而是几乎所有企业的战略重点。 这也催生了AI应用的黄金窗口——创业者们正迎来前所未有的需求红利。但与此同时,AI创业的“玩法”与传统SaaS大相径庭,过去那套关于产品商品化、ARR增长、PMF验证的经验,正在被彻底重写。 a16z在与大量AI创始人的对话中,反复…- 5

- 0

-

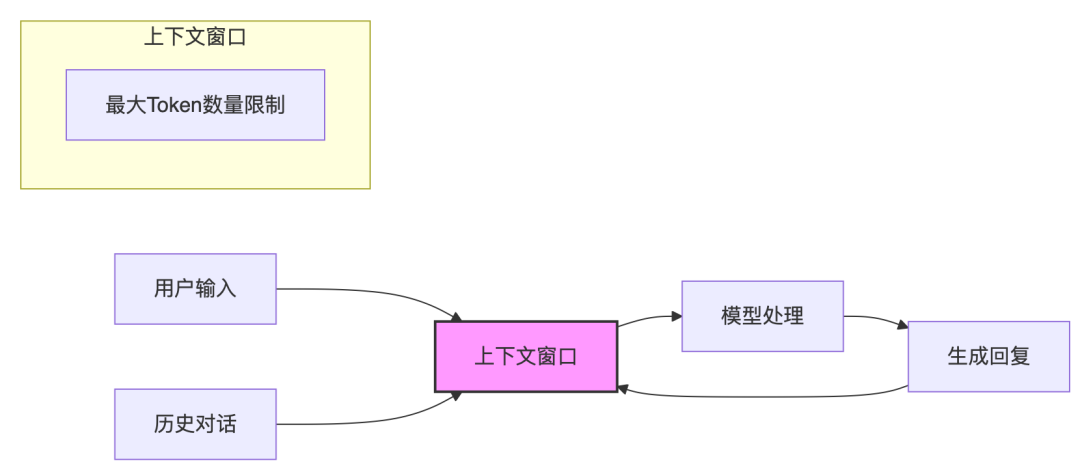

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

实战|TRAE+Milvus MCP,现在用自然语言就能搞定向量数据库部署了!

Vibe coding正在重塑开发者的工作方式。 不久前,继Cursor和Claude Desktop在海外市场掀起智能编程浪潮后,字节跳动TRAE海外版也进入了付费模式。 相较前两款海外产品,TRAE集成了代码补全、智能问答和Agent模式之外,还可以为中文开发者带来本土化的智能编程体验。 恰逢其时,Milvus MCP服务器新增了SSE(Server-Sent Events)支持。 相比传统的…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

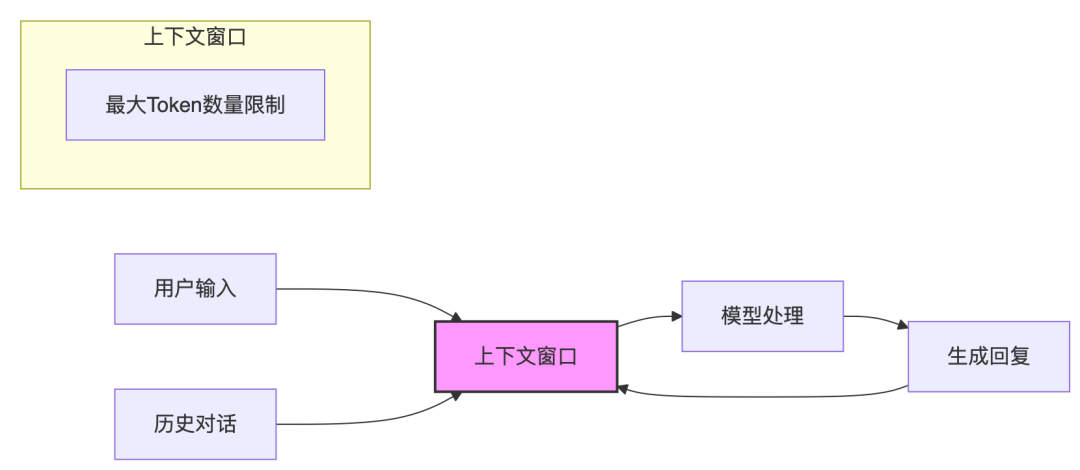

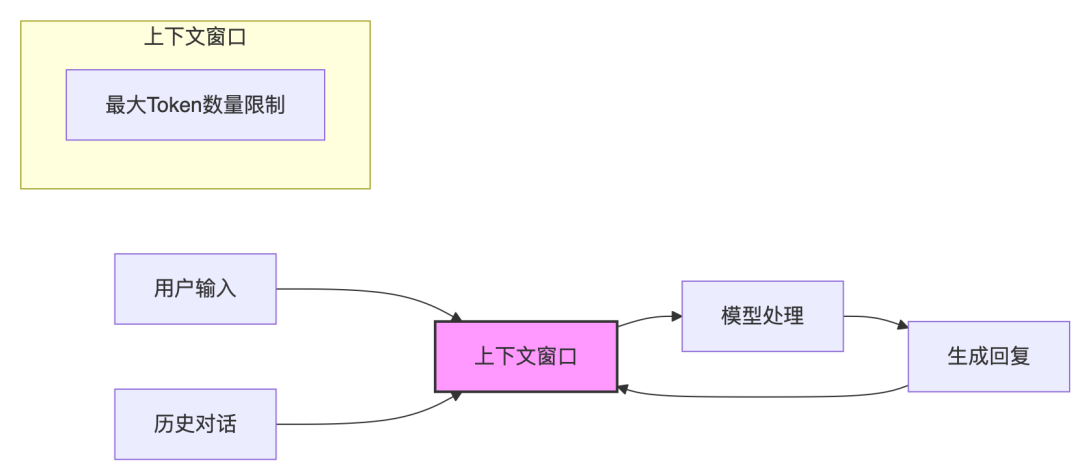

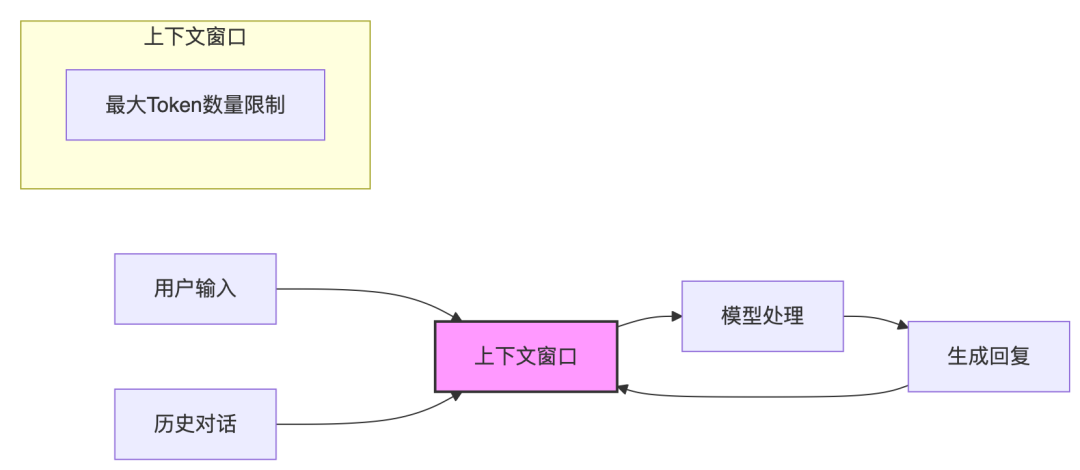

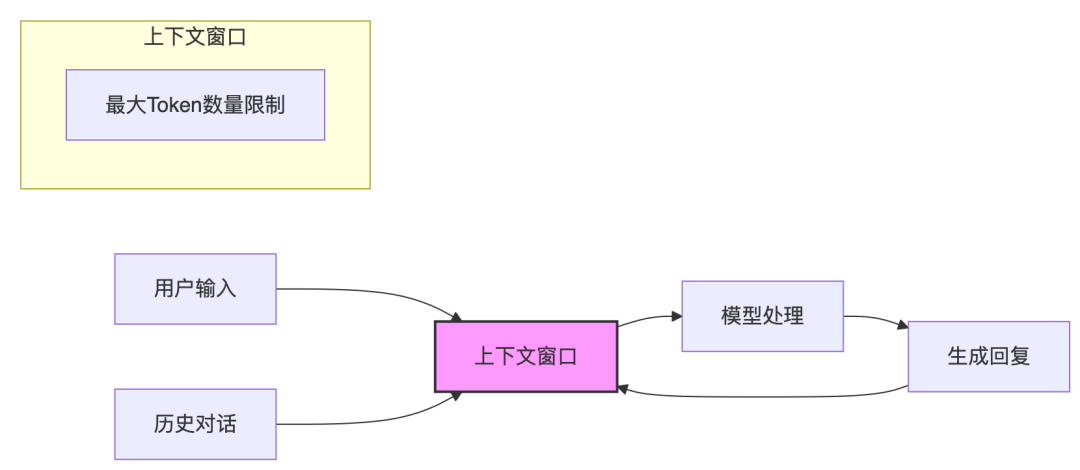

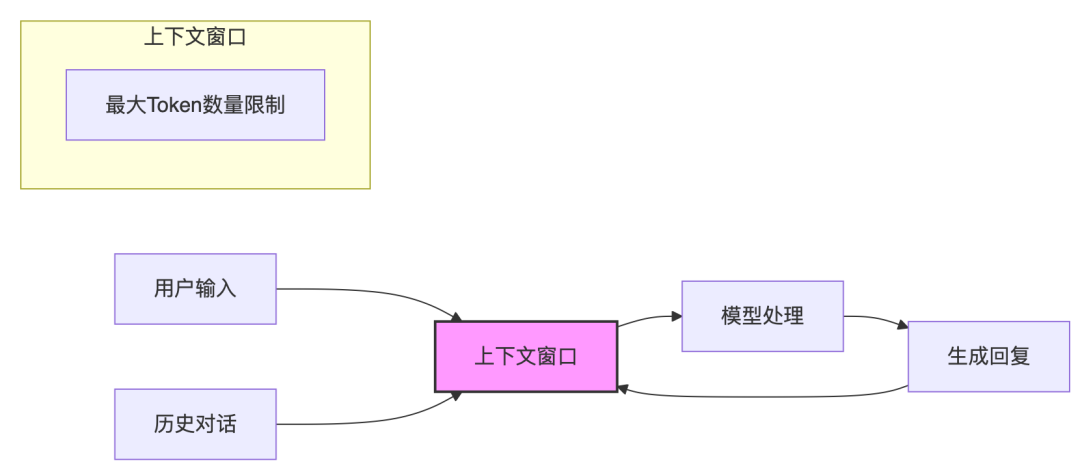

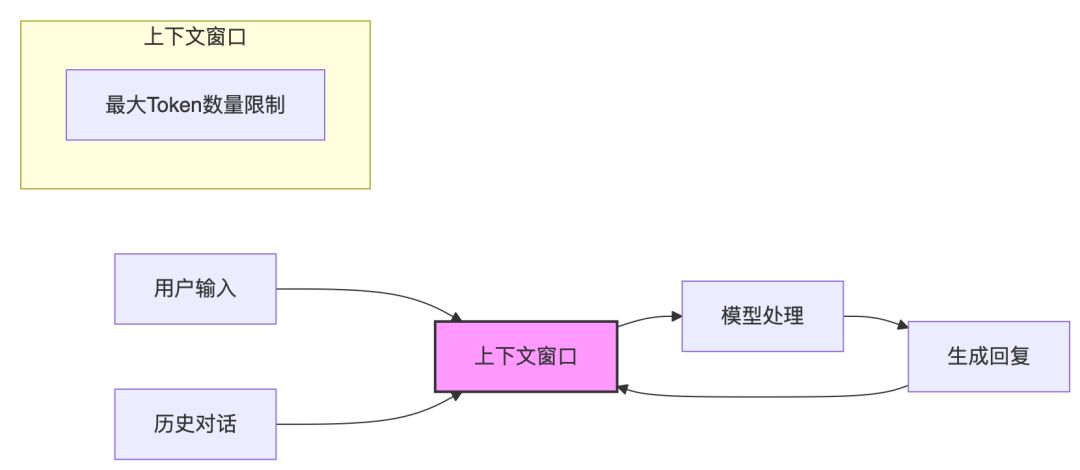

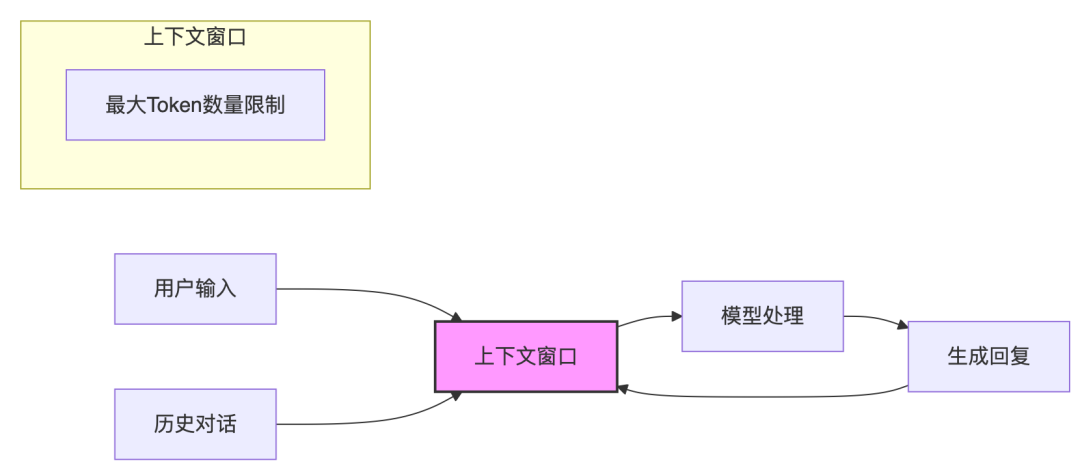

“上下文工程”比“提示工程”更能用好大模型

你们平时可能都听过“提示工程(prompt engineering)”这个词,觉得它就是写几句话给AI让它完成任务。但今天我要告诉你们,这个词有点“过时”了,我们现在更喜欢叫它“上下文工程(context engineering)”! 这是来自AI大佬Andrej Karpathy观点: 为什么改名为“上下文工程”?你们可以把AI想象成一个超级聪明的同学,它要完成一项任务,光告诉它任务是什么还不够…- 7

- 0

-

AI时代的领导力变革,可能会比以往的革命来得更猛烈些丨文末赠书

文 包季鸣 徐晓亮 复旦大学管理学院教授 复星国际联席CEO 复旦大学管理学院EMBA校友 2025年,全球企业正经历一场由AI驱动的"领导力大考"。 微软凭借Copilot重构生产力生态,华为在算力封锁下逆势突破万亿营收,字节跳动以算法领导力颠覆内容产业。 当DeepSeek等大模型成为员工的"第一顾问",当Z世代管理者天然拥抱人机协作——传统领导力的…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

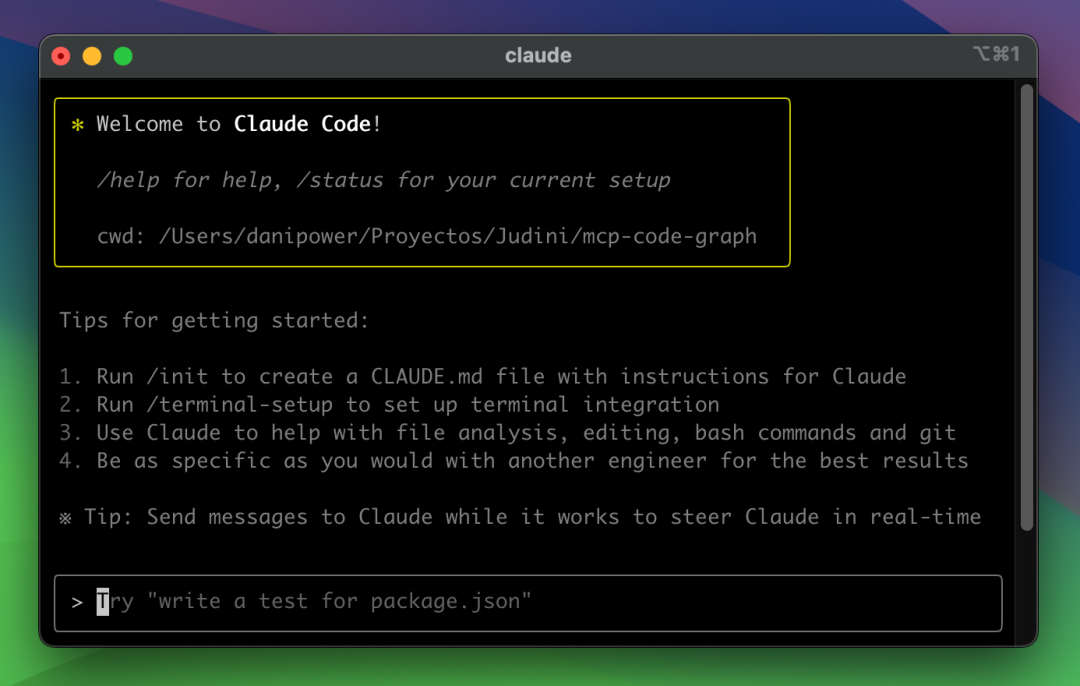

Claude Code 基础

什么是Claude Code? Claude Code是一个AI驱动的编码助手,它存在于您的终端中,通过自然语言理解您的代码库并加速开发。它直接集成到您的工作流程中,提供了一种灵活且安全的方式来利用AI进行编码任务。 为什么要使用Claude Code? Claude Code提供以下几个主要优势: 代码库理解: 快速理解项目架构和逻辑。 代码编辑和错误修复: 使用自然语言编辑文件和修复错误。 测…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

那啥,企业智能体开发范式?要我说,都是“上下文工程”!

#AI智能体 #企业AI智能体 #人工智能 #DataAgent #数据分析师 #NL2SQL #提示词工程 #CPO #首席范式官by 雅逐智能- 4

- 0

-

李志飞的 AI 实验:1 个人,2 天做出 AI 时代的「飞书」,重拾 AGI 信仰

上市公司老板的亲身实践,预演了未来的工作方式。作者|苏子华编辑|靖宇作为一家上市公司的老板,出门问问创始人、CEO 李志飞在最近的新品发布会上并未亲自讲解产品,而是分享了一场个人的「行为艺术」——一场「一人公司」的实验。 他给自己设定了一个看似不切实际的目标:在几天内,用 AI 工具开发出一个专为 AI 组织设计的「飞书」。 作为上一波 AI 浪潮的实践者,每一次他都走在最前面。2012 年,他离…- 5

- 0

-

Doc2X:文档解析与翻译转换的AI全方位解决方案

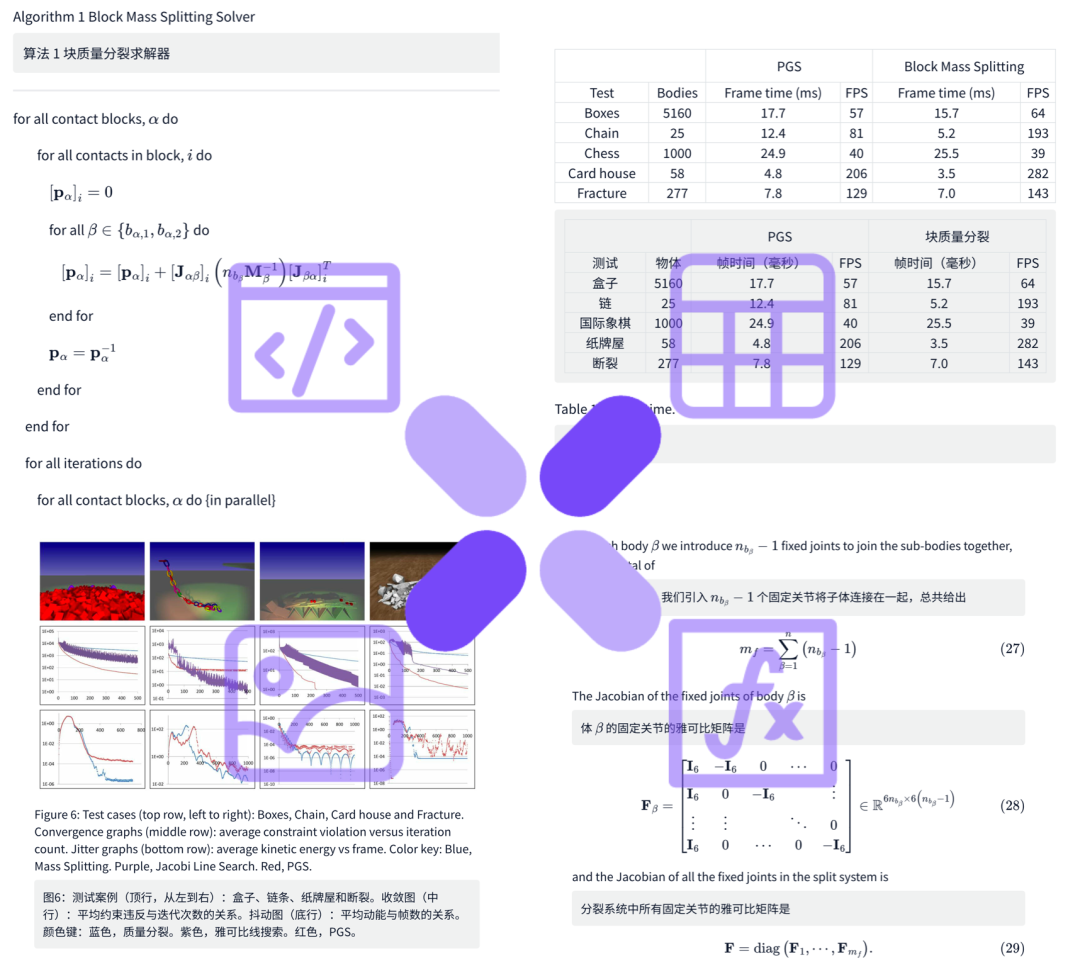

Doc2X 产品简介 Doc2X 是一款专为开发者设计的强大文档解析产品,能够将PDF、图片等多种格式的文档精准转换为 Markdown、LaTeX、HTML、Word等结构化或半结构化格式。 Doc2X 有以下核心优势: 全方位格式支持:从PDF快速转化为Word、Docx、LaTeX、HTML、Markdown多种格式,灵活满足不同场景的需求。 对照编辑与校对:支持在转换前对照PDF原文,快速…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 10

- 0

-

AI 原生的信息获取和分发——思考与实践|深言科技岂凡超

: AI 技术极大地丰富了人类获取信息的渠道,显著提升了信息分发与获取的效率。随着大语言模型(LLM)能力的持续提升,用户获取信息的方式是否正面临又一次革命性变革? 在奇绩 2022 年春季创业营校友深言科技创始人岂凡超看来,如今 AI 的生成与理解能力使内容朝着 “按需生产、个性定制、动态交互、多种模态” 的方向演进;信息获取也不再只是依靠点击与关键词搜索,而开始转向通过自然语言与系统 “提出…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

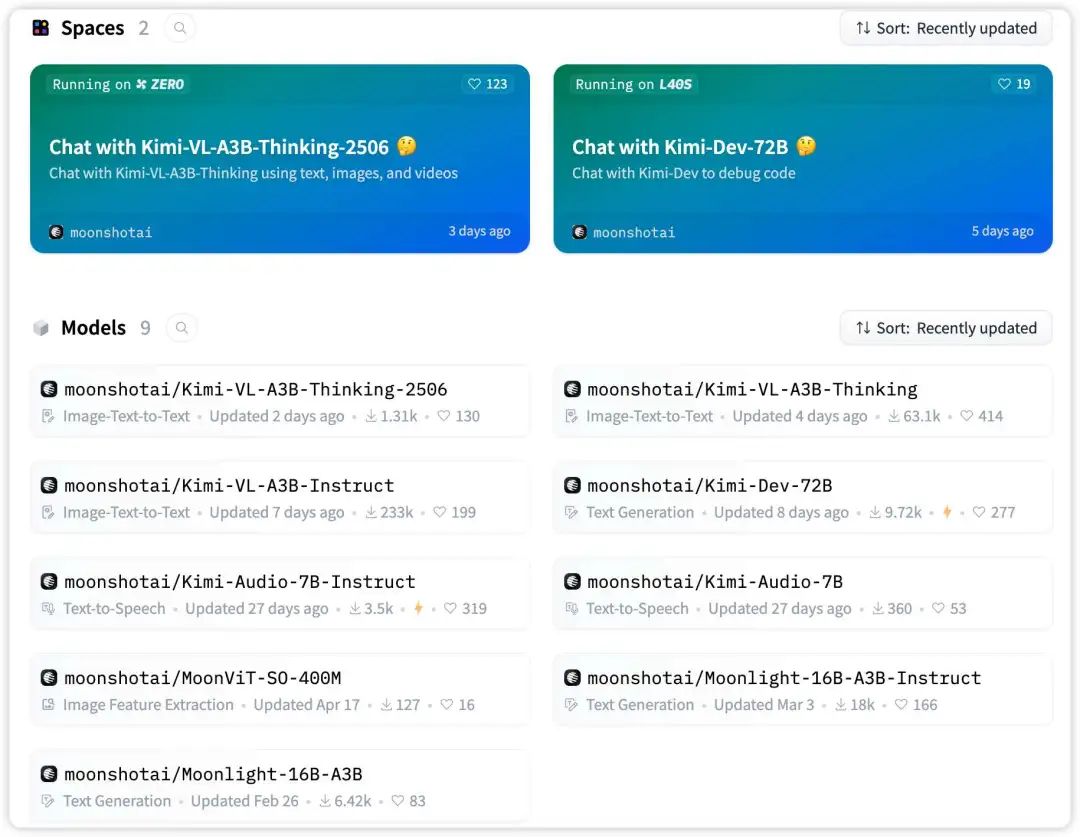

Kimi-Researcher首发实测:它凭什么在AI“高考”中超越Claude和Gemini?

很多小伙伴说,Kimi最近一段时间没有声音:似乎突然不卷了,其它AI厂商你追我赶的一直发布新产品,而Kimi迟迟没有动静... 但其实Kimi这段时间一直在深耕技术,在HuggingFace上很活跃! huggingface上的Kimi仓库而就在前几天,悄咪咪地放出了一个“大招”—— Kimi-Researcher (深度研究)。 Kimi官网内测申请通过后就能看到上面的界面~我们也第一时间拿到了…- 9

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!