-

腾讯、阿里和字节都在布局AI浏览器,它会是PC端超级入口吗?|AI浏览器(上)

记者:吴一凡 编辑:吴洋洋 Key PointsQQ浏览器、Genspark和Perplexity都在转向AI浏览器,豆包、ima也越长越像浏览器;聊天、搜索、办公、网页管理、网页操作……AI浏览器在集成一切;抢占PC端这件事上,腾讯比阿里步子更大,字节也在通过豆包的浏览器化抢占PC,而自诩专注生产力的Kimi,目前在桌面端还没有多少作为;AItoC产品在PC端的产品形态可能会走向all in o…- 9

- 0

-

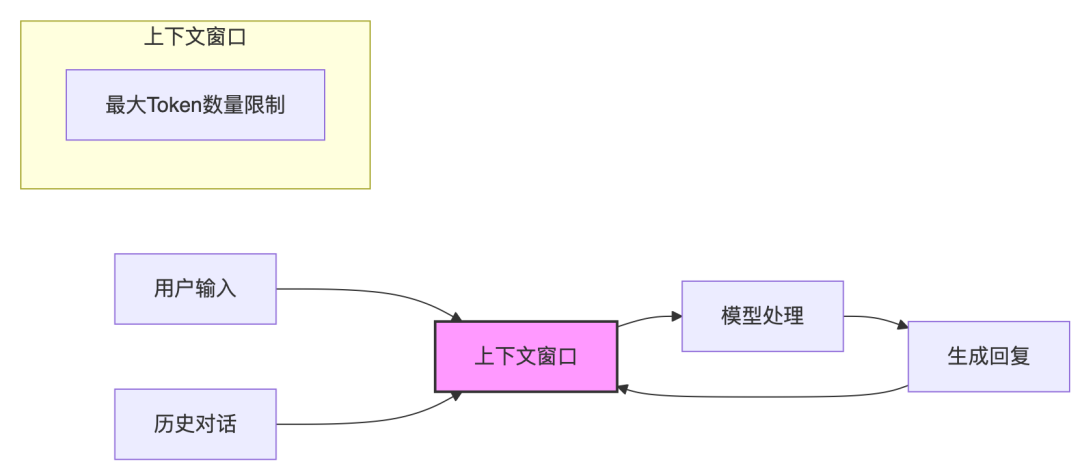

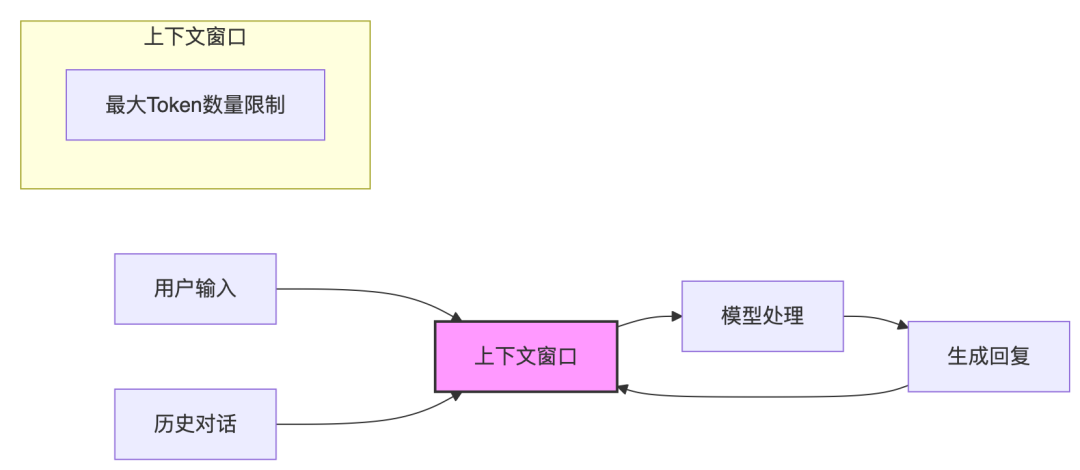

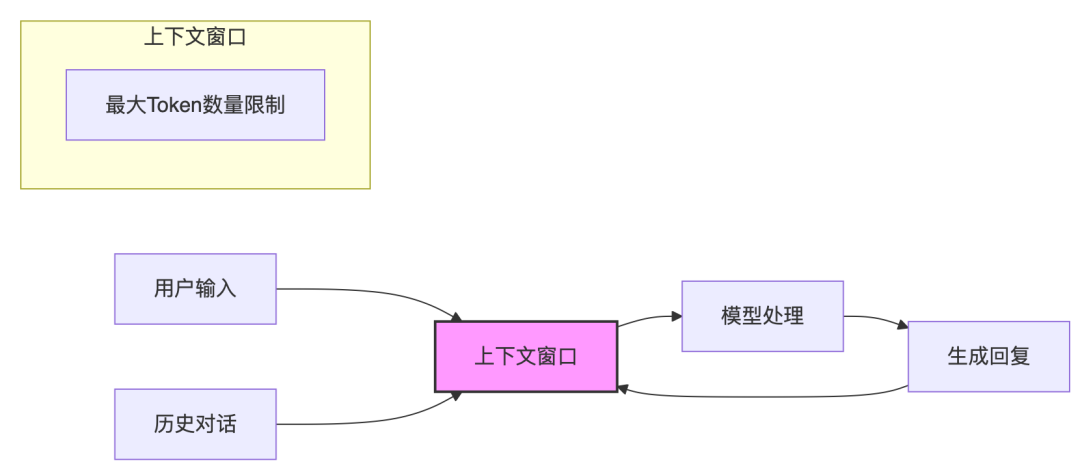

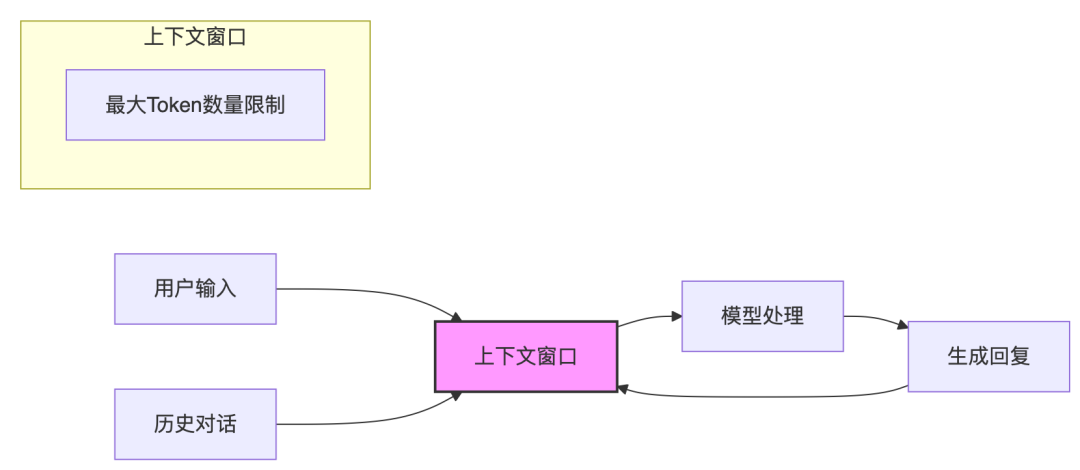

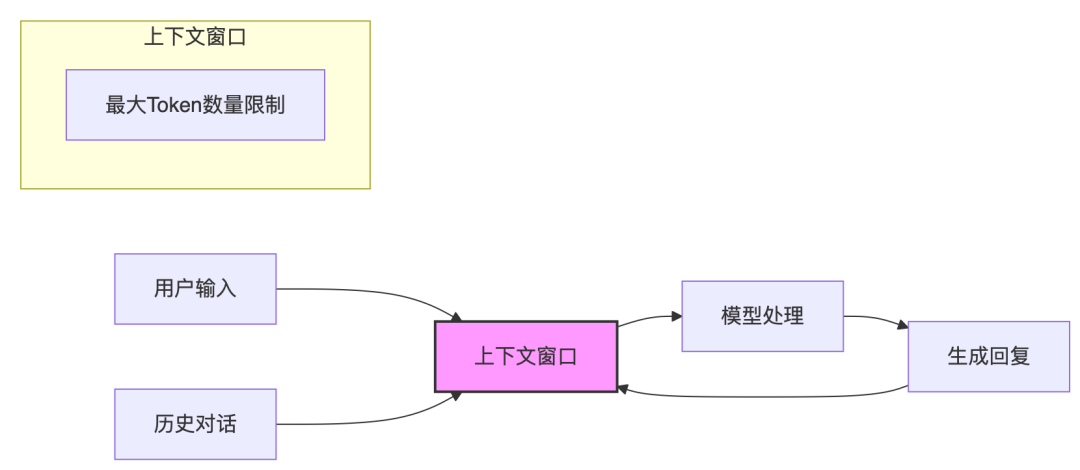

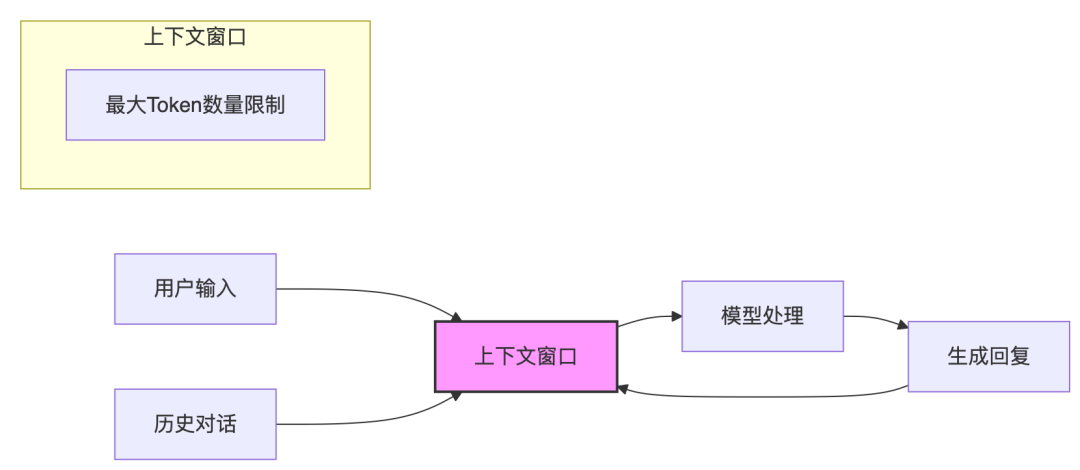

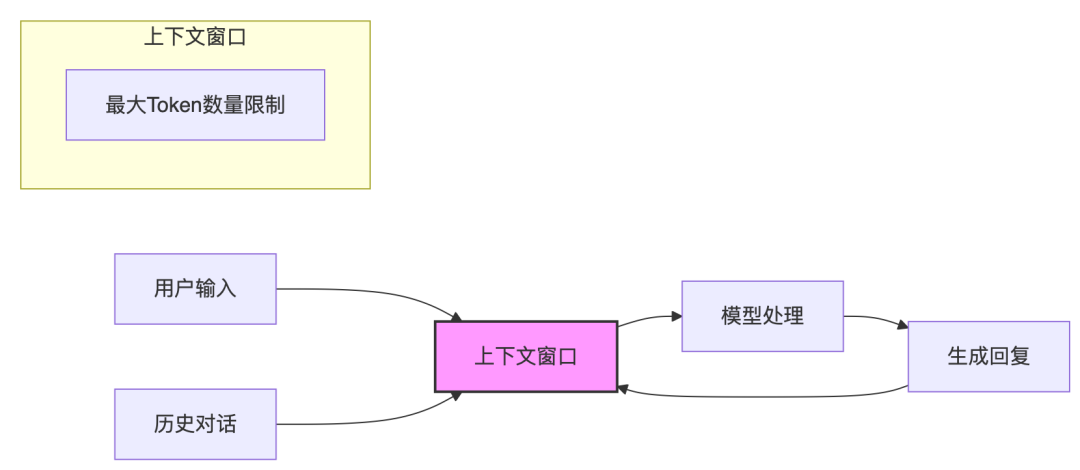

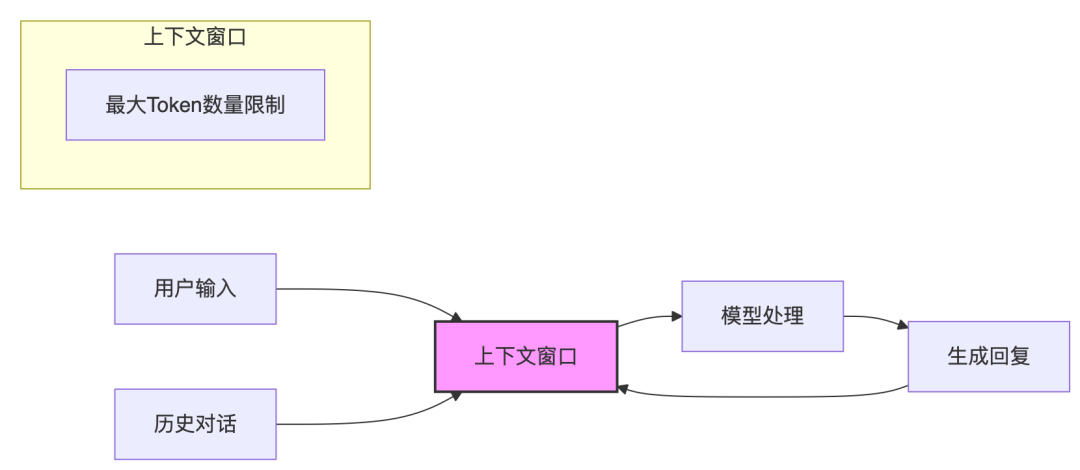

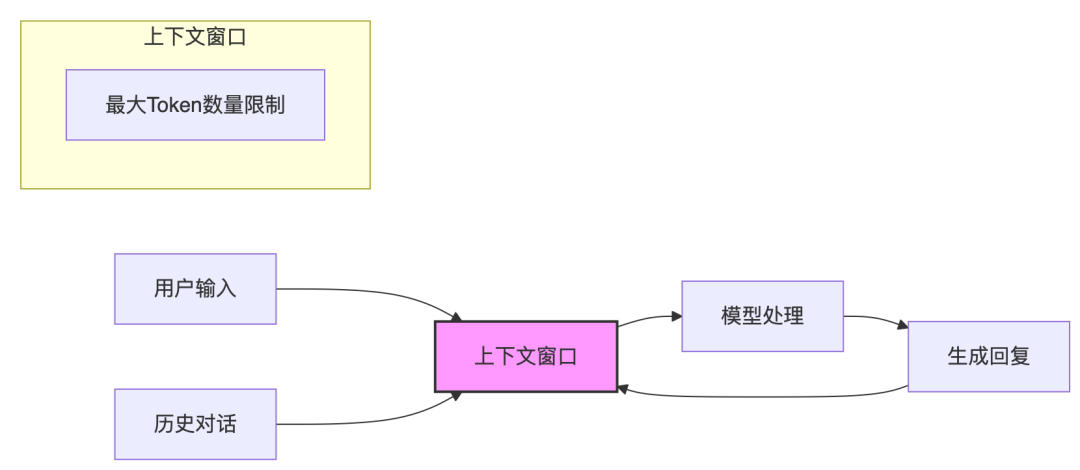

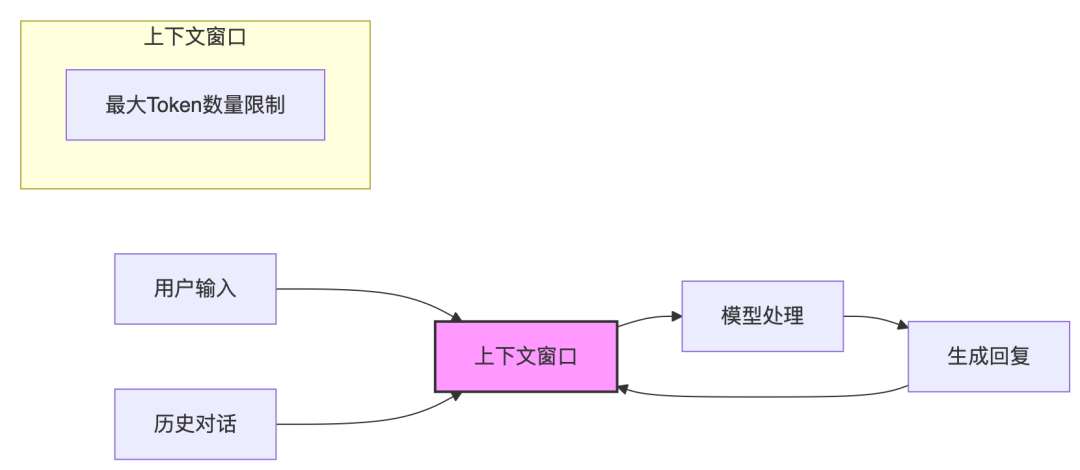

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

用上Cursor就是AI协同研发了?

前言 最近和朋友聊天,发现几乎所有团队都在使用 AI 编辑器,Cursor、Windsurf、Augment、Trae、通义灵码等等,都在讲自己已经开始 AI 协同研发了。 但仅仅一个 AI 编辑器的使用就能叫做 AI 协同研发吗?我感觉,这只能算是开始,甚至只是起点的一小步。 真正的 AI 协同研发应该是整个研发流程和协同模式的重构与升级。 AI 工具为什么难以奏效 瀑布模式是研发流程的经典模式…- 11

- 0

-

给Javaer看的大模型开发指南|得物技术

目录一、概述 二、什么是大模型 三、大模型的特点 1. 无状态 2. 结构化输出 3. 函数调用 四、大模型接口 1. 模型封装 2. 接口输入 3. 接口输出 五、RAG架构 六、MCP协议 七、Spring-AI 1. 模型抽象 2. 聊天会话 3. RAG拓展 4. 代码示例 八、智能体示例 1. 接口骨…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

AI编程工具Comate AI IDE,最全测评来了!

Datawhale测评 实测:王熠明,Datawhale成员 文心快码的独立 AI 原生开发环境工具—— Comate AI IDE 正式发布了。 据官方说:“作为行业首个多模态、多智能体协同的 AI IDE,Comate AI IDE 的发布标志着编程工作方式迎来革命性转变,它在“智能”、“拓展”、“协同”、“灵感”四大方面实现全方位链接,具备多项核心能力:AI 辅助编码全流程、多智能体协…- 10

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

深度解析:知识工程如何让AI警用大模型不再”胡说八道

作为一位知识工程领域的专家,我将从知识工程的基本概念出发,深入探讨其在大模型时代的重要性,特别是在警务行业中的具体应用,以及如何与大模型智能体协同工作以提升警务智能化水平。 警察也能当"程序员"?全球警务低代码革命实战揭秘 知识工程在警务智能化中的应用案例与技术趋势 警务行业的大模型和智能体技术六大颠覆性创新 警务AI模型:全球先进警务犯罪预警案例与趋势(内容有惊喜) 一、知识…- 9

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 9

- 0

-

更多thinking≠更好结果,精准thinking可砍掉一半长度

大模型推理为什么又长又啰嗦? 想象一下让学霸解题:明明第一步就得出答案,却非要反复验算十遍,还写满整张草稿纸——这就是当前大模型(如GPT-4、DeepSeek)的痛点! 论文:Optimizing Length Compression in Large Reasoning Models链接:https://arxiv.org/pdf/2506.14755 论文发现:模型在简单题目上过度推理,生成…- 9

- 0

-

【万字长文】为何当下AI Agent具备变革性影响力 普通人该如何思考

前段时间写了一篇关于如何在iOS设备上实现Agent能力在iOS应用中实现AI Agent模式:思考、执行、观察与反思的实践指南反馈不错,有读者问我如何看待当前的的Agent,是否只是泡沫。以下是我收集相关资料后总结的内容,希望能帮到你,文章比较长,希望能坚持看完,enjoy~ 在当前快速变化的商业和技术环境中,AI智能体正迅速成为一股变革性力量。它们的核心特质在于自主性、主动性和目标导向性,这使…- 8

- 0

-

关于AI大模型技术带来的企业数智化转型工作影响思考

作者 | 范范 自从 2025 年初 DeepSeek 火爆出圈,如同给压抑迷茫的 IT 行业注入一剂强心针,相关从业人员连夜研究技术原理,探索应用场景。我所在的公司及所服务的行业客户,更是迎来一波建设热潮,但凡涉及 AI 大模型的项目基本都绿灯放行。 经过数月的场景验证与探索,各类消息纷至沓来:推进 AI 应用项目的,效果不尽人意者开始质疑大模型的适用性,抱怨数据清洗成本高昂、落地应用者寥寥;取…- 10

- 0

-

当企业部署上百个AI Agent | 硅谷AI Agent创始人圆桌实录

6月25日,在一场由EntreConnect主办的AI Agent主题圆桌中,主持人Silvia Tong与众多AI创业者以及AI投资人进行了一场深度对话。 本次圆桌嘉宾分别是: Tatyana Mamut:Wayfound 联合创始人兼 CEO,该公司构建用于管理和实时监督其他 AI Agent 的 AI Agent。 Puneet Anand:AIMon 联合创始人兼 CEO,该公司为企业提供…- 6

- 0

-

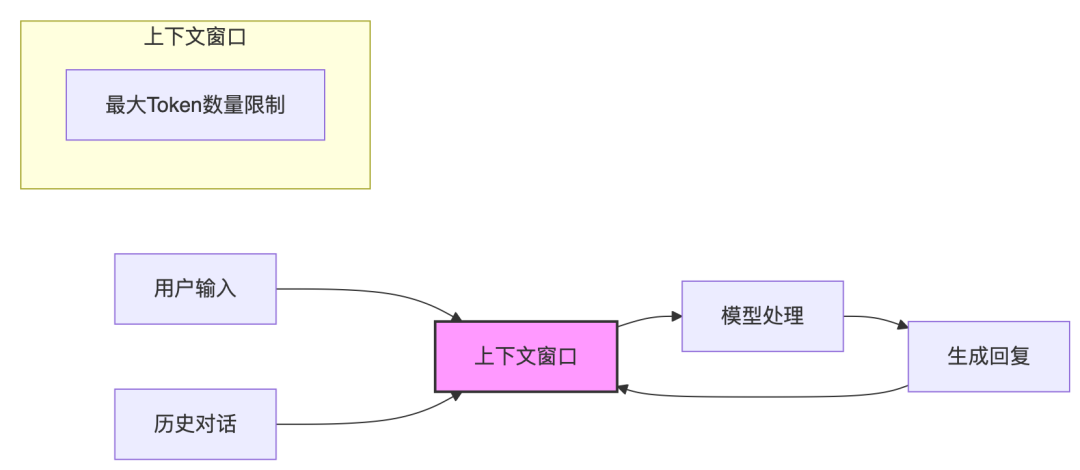

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

MCP协议:让AI秒变超级助手的黑科技

1介绍想象一下,每次买新设备都要发明一个新插头来供电。这就是使用 LLM 之前的情况 —— 每个应用都得自己想办法连接模型、数据、工具和其他系统。Model Context Protocol (MCP) 就是 AI 应用的通用适配器。MCP 是一个开放协议,它统一了大型语言模型 (LLM) 与工具、数据源和工作流的交互方式。就像 AI 界的蓝牙 —— 一种通…- 9

- 0

-

AI 原生应用(AI Native)- 产品设计逻辑变了!

先普及一下概念~ AI Native是指以人工智能技术为核心,能够解决特定问题的产品或服务。它的核心特征是: 依赖AI:产品的主要功能必须依靠AI实现,比如自动生成内容、智能推荐等。 以AI为中心:用户体验围绕AI设计,例如通过自然语言与AI交互完成任务。 深度集成:AI技术深度融入产品开发,而非简单添加功能。 AI Native产品分为三类: AI-by side:AI是可选功能(如PPT的AI…- 20

- 0

-

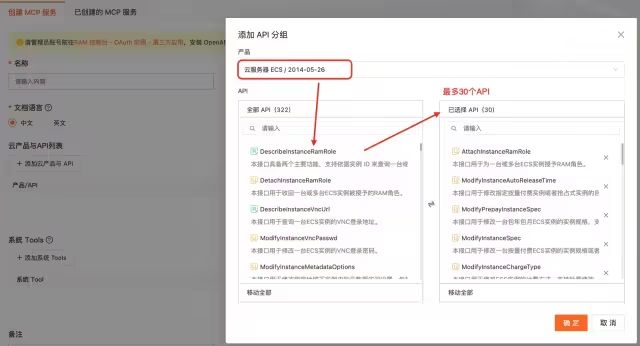

大模型终于能“听懂”云操作了?

前言对于阿里云用户而言,管理云产品通常有几种方式:控制台、OpenAPI SDK、CADT、Terraform 等。虽然形式不同,但本质上这些操作都要依赖于 OpenAPI 来完成。在 MCP 出现之前,如果用户希望通过自然语言来操作云产品,唯一的办法就是对照产品文档,手动编写一条条 FunctionCall 描述,再交给大模型进行调用。这种方式不仅繁琐,而且效率低下。几周前,当得知 OpenAP…- 7

- 0

-

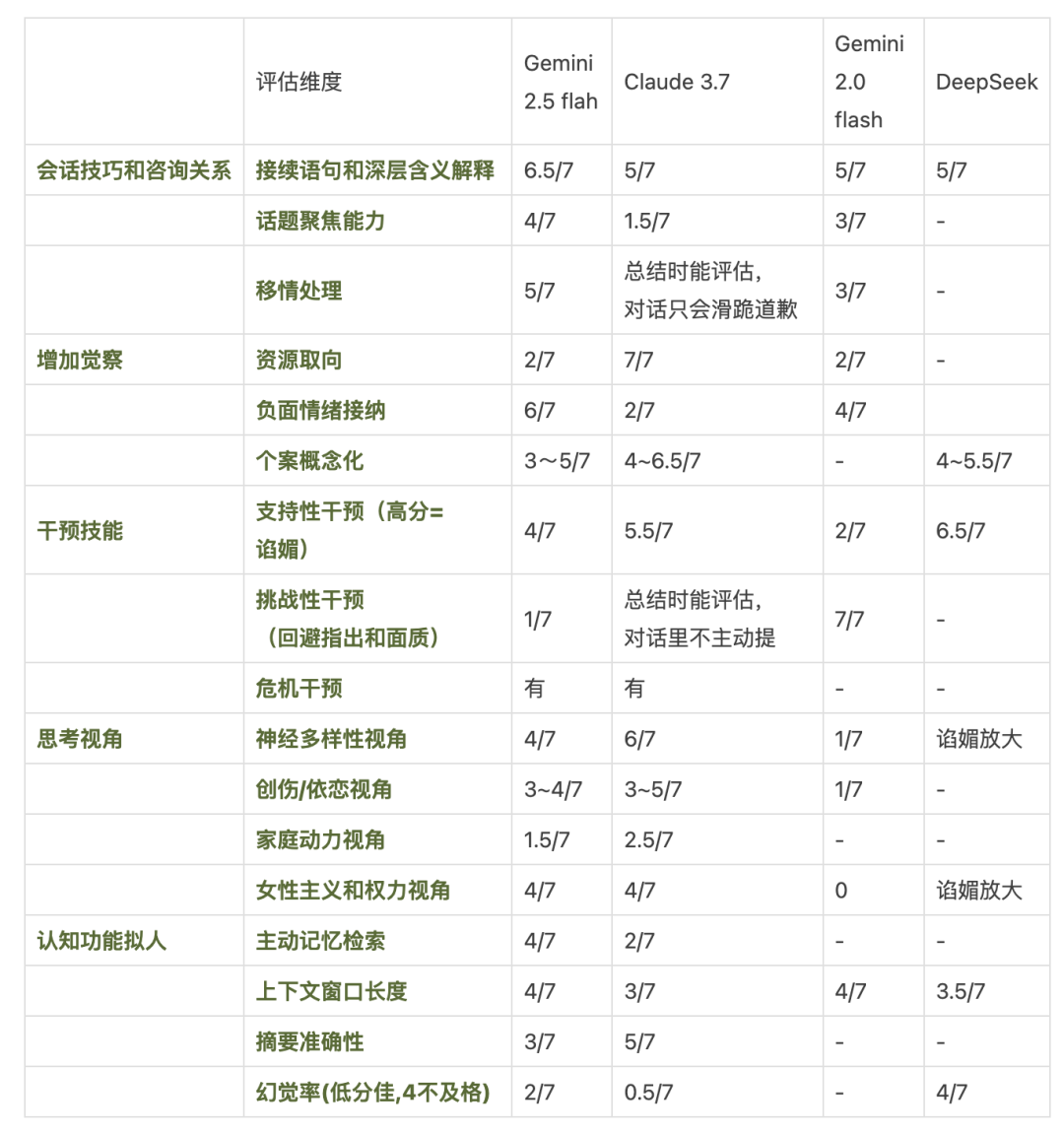

AI做心理咨询师|大模型咨询能力测评

测评对应的项目自定义 • Claude3.7和Gemini2.5分别密集使用1个月以上,平均每天0.5-1h。 • 本测评前提:项目自定义包含很长的项目指令 + 项目文档(1050lines稳定资料+500lines左右浮动的对话摘要)(见上一篇公众号推送《结构化搭建流程》) • 目前个人配置:Gemini2.5 flash对话 + 结束对话前摘取全部输入内容 + 复制给Claude + Cl…- 12

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!