-

编程神器Cursor终于更新到正式版,最新系统提示词来了!

Cursor 在今年6月份终于发布了正式版本! 之前的版本号在 0.5 以下徘徊了一年,6月份版本号直接从 0.5 跳到了 1.0 以上! 这种跨越式的版本升级,背后到底隐藏着什么? 逐字逐句地拆解了Cursor最新的系统提示词之后,我的第一反应是:这TM就是AI工程学的教科书啊! 每一个细节都透露着Cursor团队的深度思考,从结对编程的理念,到工具调用的优化,再到错误处理的人性化设计。 最震撼…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

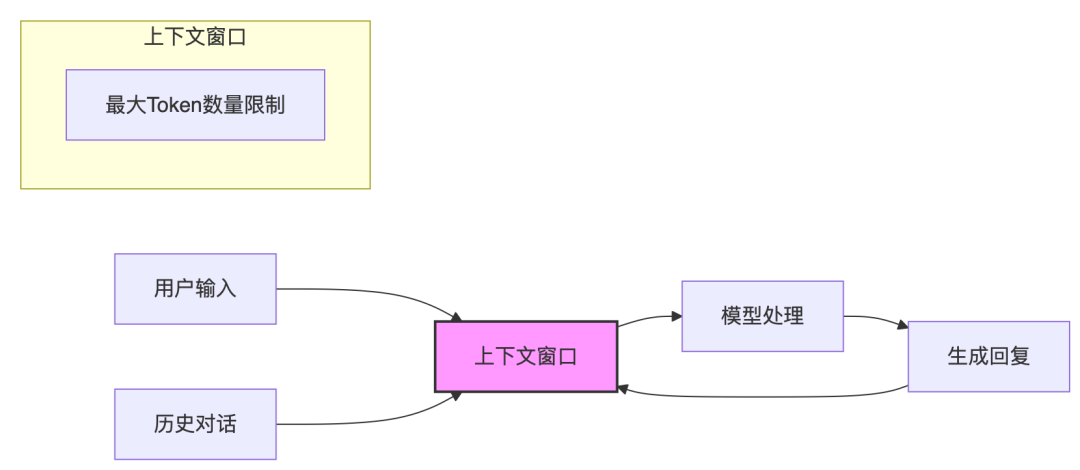

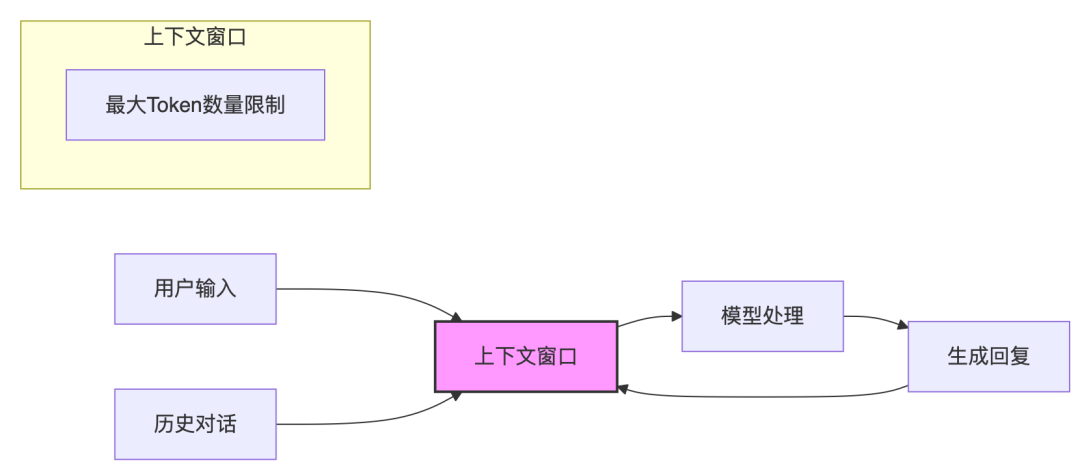

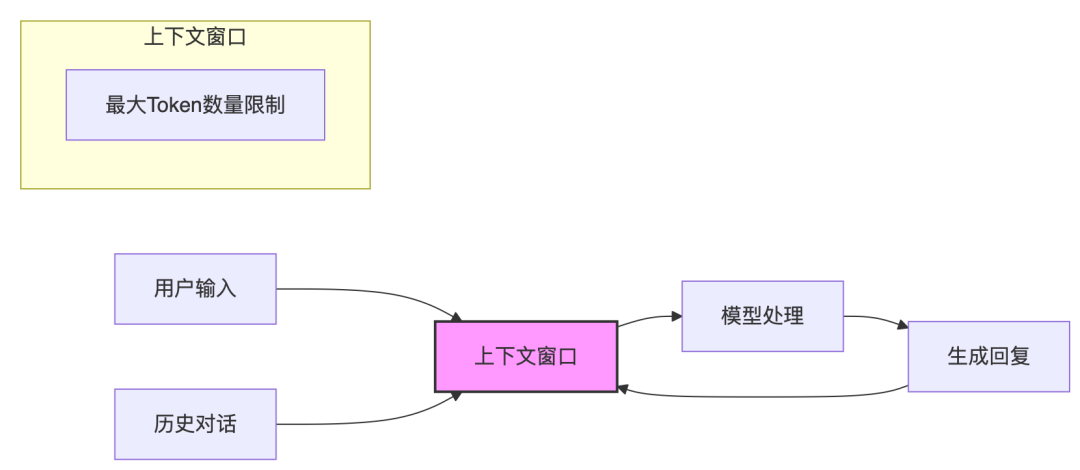

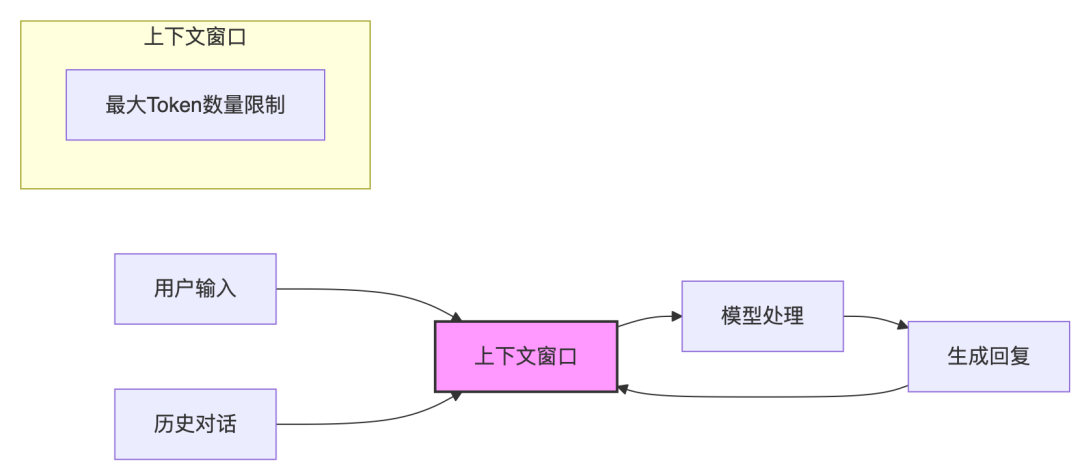

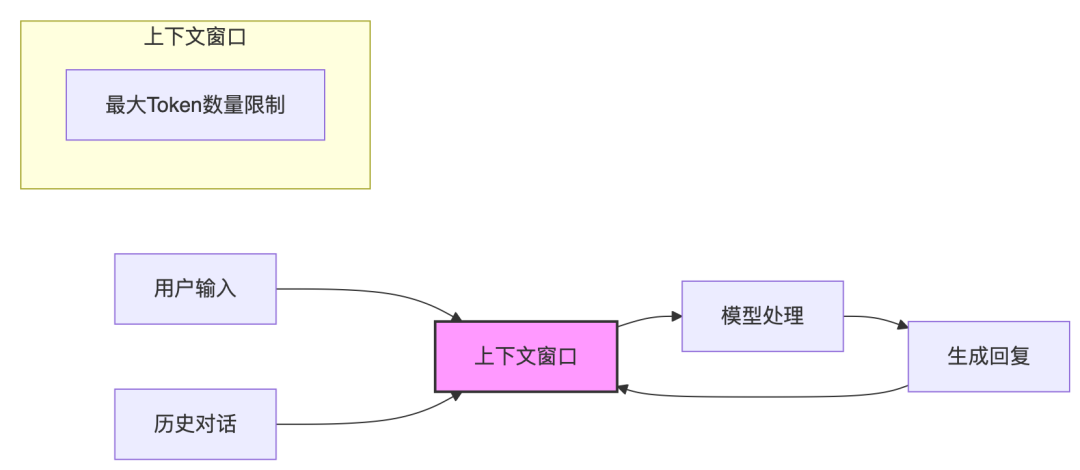

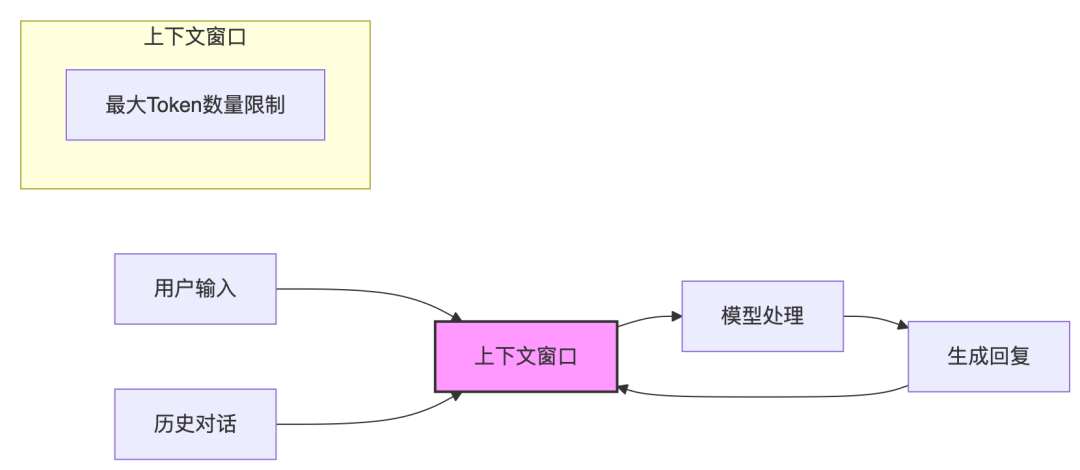

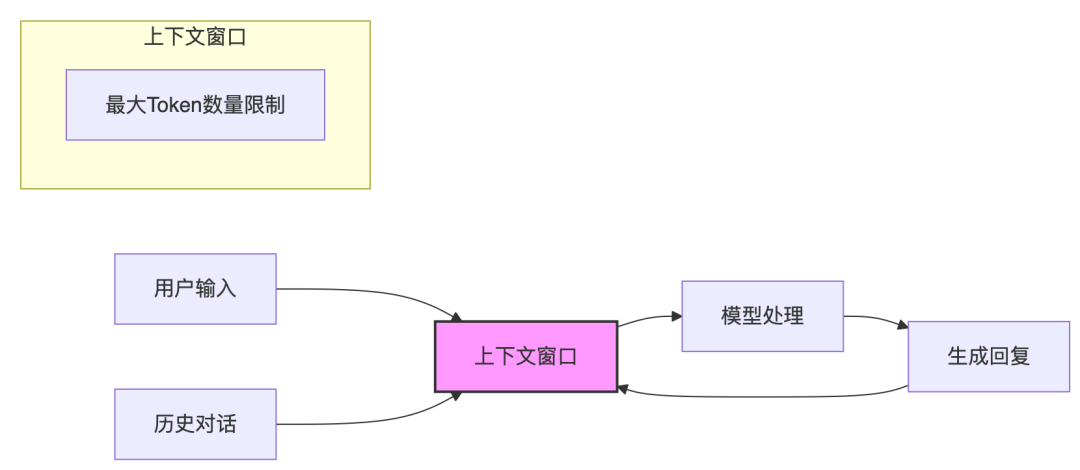

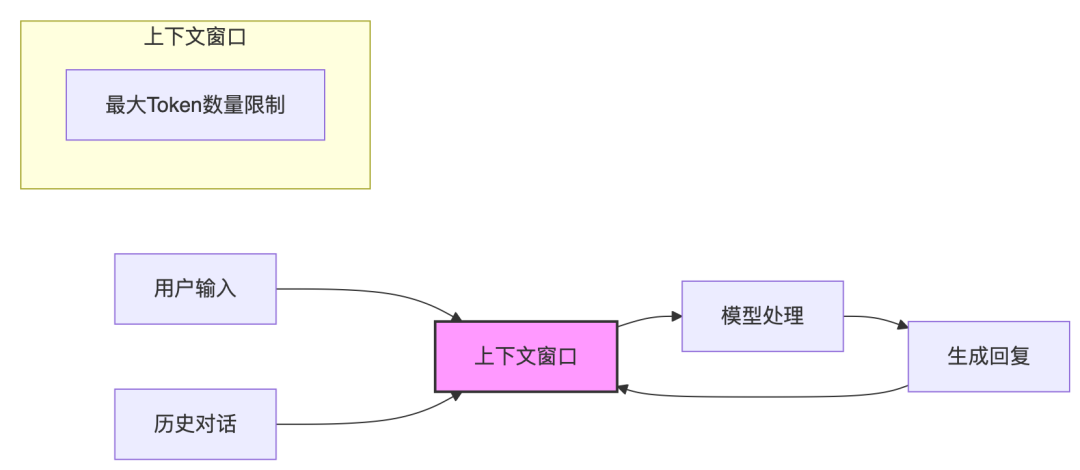

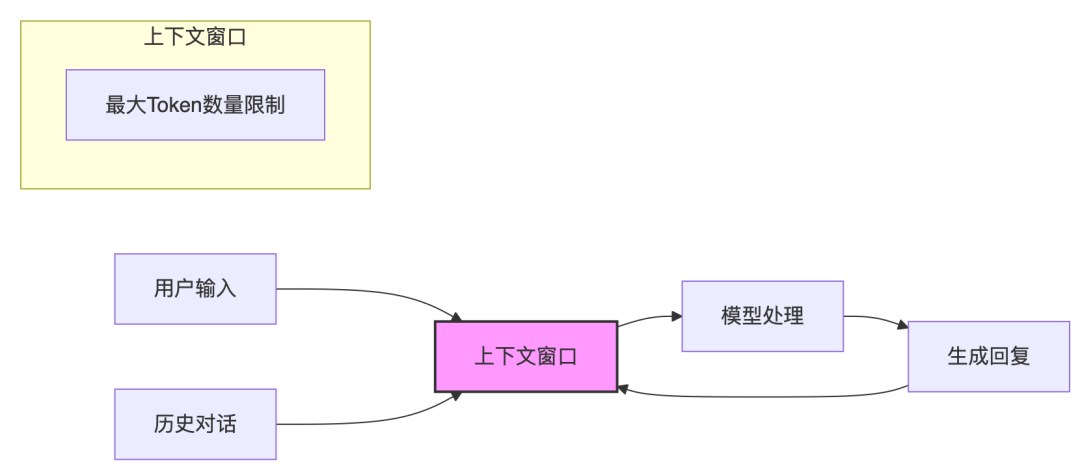

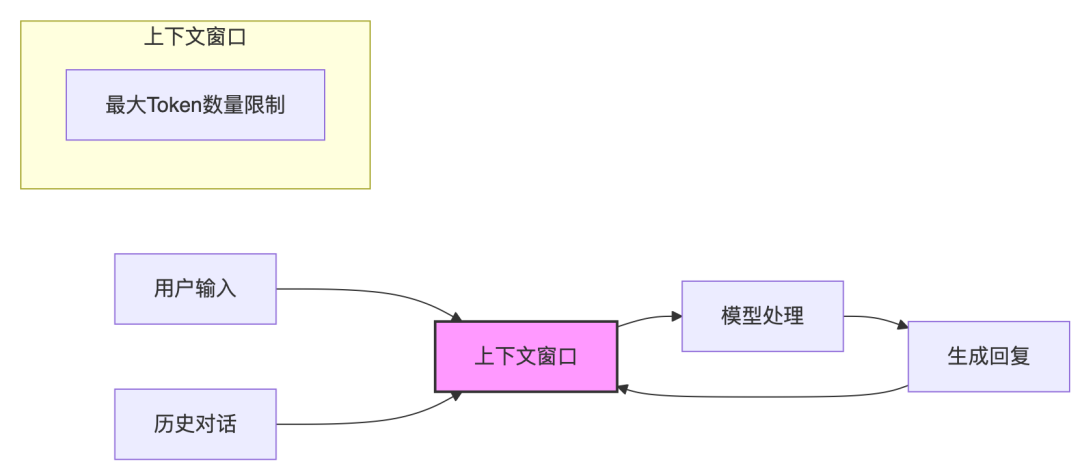

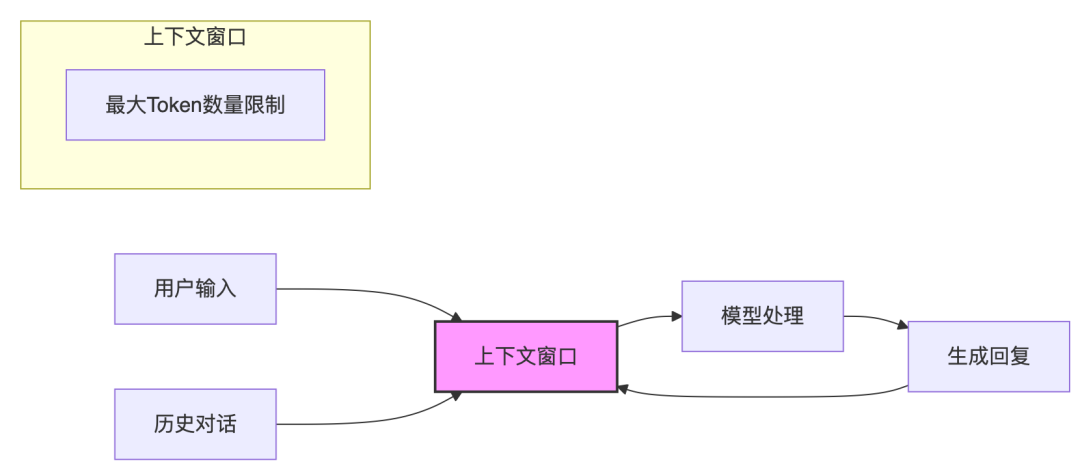

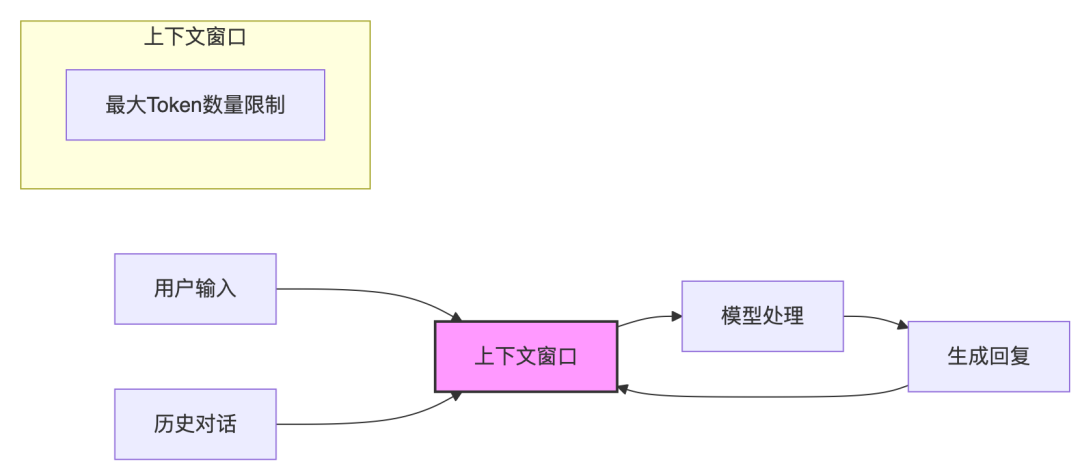

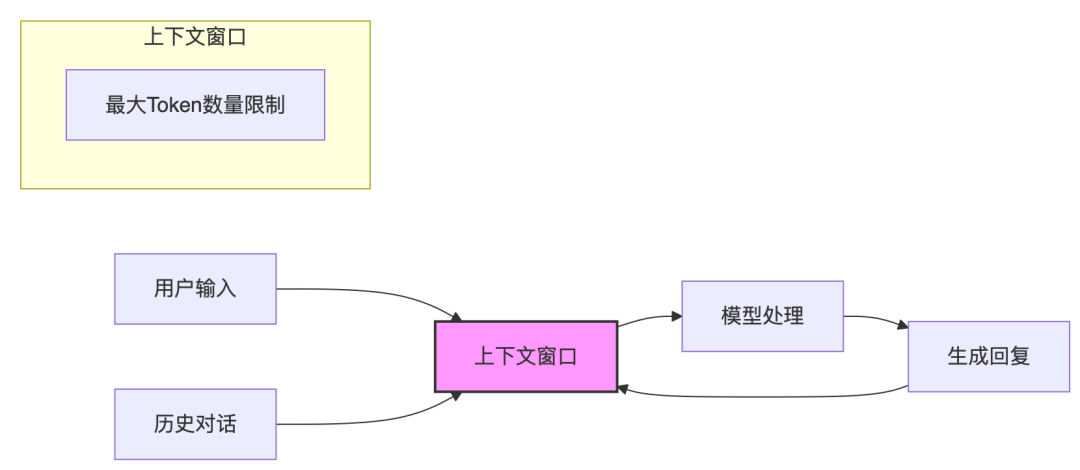

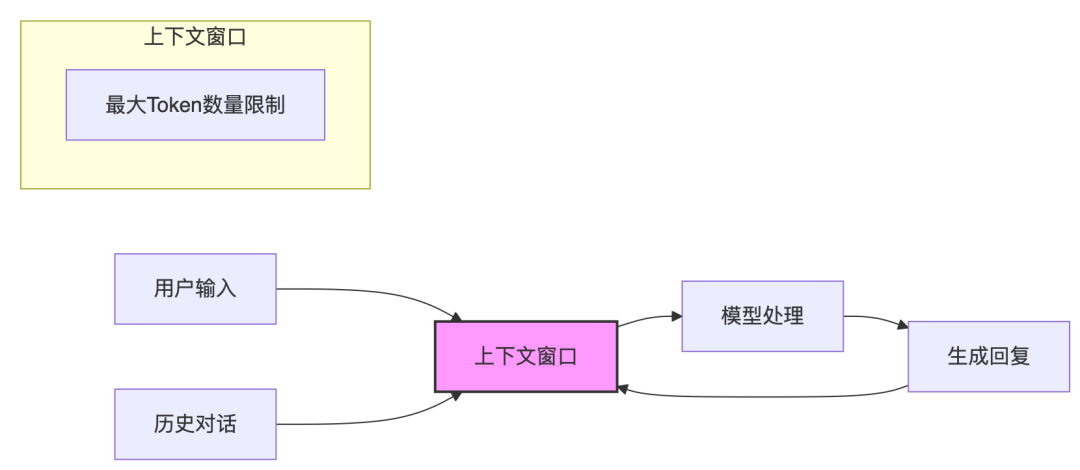

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 9

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 10

- 0

-

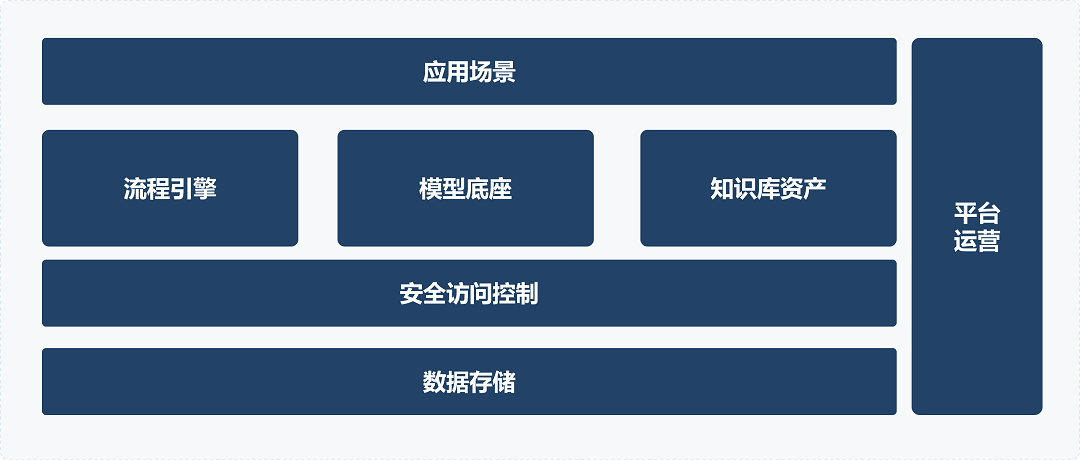

工业大模型定义及技术架构

工业大模型是面向工业领域深度优化的专业人工智能系统,通过整合多模态数据与行业知识实现智能化决策,在工业智能化进程中意义重大。工业大模型技术体系以五层架构为核心框架,涵盖从底层基础设施到顶层应用的完整技术链条。这一架构旨在为工业领域提供高效、稳定、智能的技术支持,推动工业智能化转型。五层架构分别为基础设施层、基座层、模型层、交互层和应用层,各层之间紧密协作,共同构建了工业大模型的技术生态。 基础设施…- 5

- 0

-

AI时代的生存-什么让我们脱颖而出?

为什么想写这个问题? 尽管过去了很多天,我还是觉得Y同学的那句话挺有意义“善用AI的人,将会对不会用AI的人,造成难以逾越的能力鸿沟”。这个问题之所以萦绕几周,这里是有几个问题要思考:(1).在技术平权后,究竟什么才是“出乎其类,拔乎其萃”的关键?这就是我和老婆大人思考闺女如何在内卷的时代,脱颖而出的关键—反正平面设计、写作、翻译等很多工作都可以由AI来干了。并且,大家都有这个工具,那究竟什么是人…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

大模型工程化:从“实验玩具”到“应用落地”的关键突破口

关注我们 了解更多游戏数据技术干货及资讯动态导读丨本文聚焦于大模型工程化落地的关键突破,系统性地从理念到实践深入分析如何将大模型技术从理论转化为实践,并推动其在多变且复杂的行业环境中广泛应用,最终带来实际的业务成果和技术创新。作者:腾讯游戏专家工程师 李飞宏当前,全球游戏产业规模已超过2000亿美元,其背后产生的数据呈指数级增长。随着以DeepSeek、OpenAI为代表的大模型技术迅速崛起,为游…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

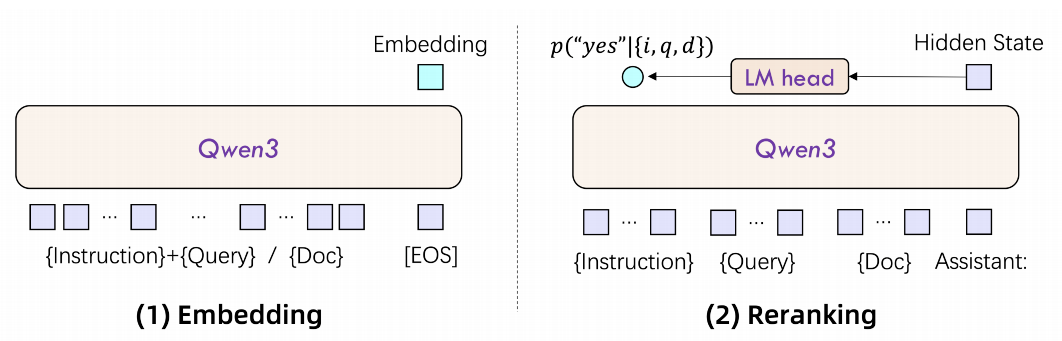

Qwen3 Embedding模型架构、训练方法、数据策略

Embedding和reranker模型的核心思想是通过任务感知的方式评估相关性。给定一个查询和一个文档,模型根据由指令定义的相似性标准评估它们的相关性。训练数据通常组织为,其中表示与查询相关的正文档,表示不相关的负文档。通过在多样化的文本对上训练模型,可以增强其在包括检索、语义文本相似性、分类和聚类等下游任务中的适用性。下面来详细的看下Qwen3 Embedding模型架构、训练方法、数据策略,…- 10

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

别搞通用智能体,落地赚钱才是王道

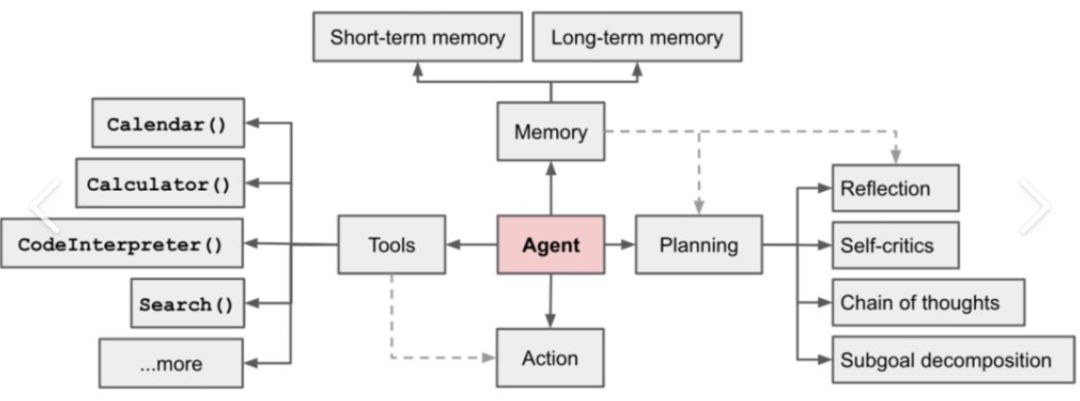

大家好,我是越山,专注于AI应用(智能体)和培训。 最近和朋友们聊到通用型Agent,大家都很好奇:“这些被自媒体吹得天花乱坠的通用Agent,真的有那么神吗?”其实,作为一名一线AI从业者,我也经常亲自上手测试各种智能体产品。今天就想和大家聊聊:通用型Agent到底有啥用?它们目前的真实水平如何?哪些应用场景才是真正值得关注的? 前段时间我写过一篇关于智能体的5种表现形态,主要从应用落地的角…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

AI Agent 在角色扮演场景的研究进展

关注我们 了解更多游戏数据技术干货及资讯动态导读丨从“对话工具”到“任务执行者”,AI Agent 所驱动的技术浪潮正在席卷全球产业,成为众多开发者和企业关注的焦点。在近期举办的 DataFunSummit:AI Agent 技术与应用峰会上,腾讯游戏数据分享了 AI Agent 在角色扮演场景的研究进展,探讨了角色扮演智能体的构建方式和应用场景。作者:腾讯游戏数据应用研究员 王文瑾内容整理:Da…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

MCP技术浪潮中的Agent应用开发新范式

关注我们 了解更多游戏数据技术干货及资讯动态导读丨当下,随着 MCP(模型上下文协议)的迅速发展,AI 开发领域的协作生态正经历重塑,MCP 为数据应用、服务及能力提供方之间的高效协同开辟了新途径。本文聚焦于 MCP 技术及其生态系统,探索如何借助 MCP 汇聚多方能力,释放大模型的巨大潜能,塑造 Agent 应用开发的全新范式。作者:xisheng1MCP 技术1.1 MCP 是什么MCP (M…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

官宣|Zilliz Cloud 建表功能大升级,更多检索类型支持,更低成本

和大家分享一个好消息,最近, Zilliz Cloud 建表功能迎来了一次重要更新。本次更新在用户界面上完整对齐了 SDK 能力,并带来了全新的交互体验,希望大家在构建数据模型时,少些繁琐,多些高效。 这次更新主要包括七个方面,接下来我们来一一介绍。 全面支持全文检索与文本匹配能力 在新版本中,全文检索会通过术语相关性对文档进行排序,显著提升 RAG 和关键词场景的准确性。它直接处理原始文本并自动…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

剖析 LLM Agent 定义及返回结构体定义

先从一段商用代码来开始本次的讨论: from typing import List, Callable, Union, Optionalfrom openai.types.chat import ChatCompletionMessagefrom openai.types.chat.chat_completion_message_tool_call import ( ChatCompleti…- 6

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!