-

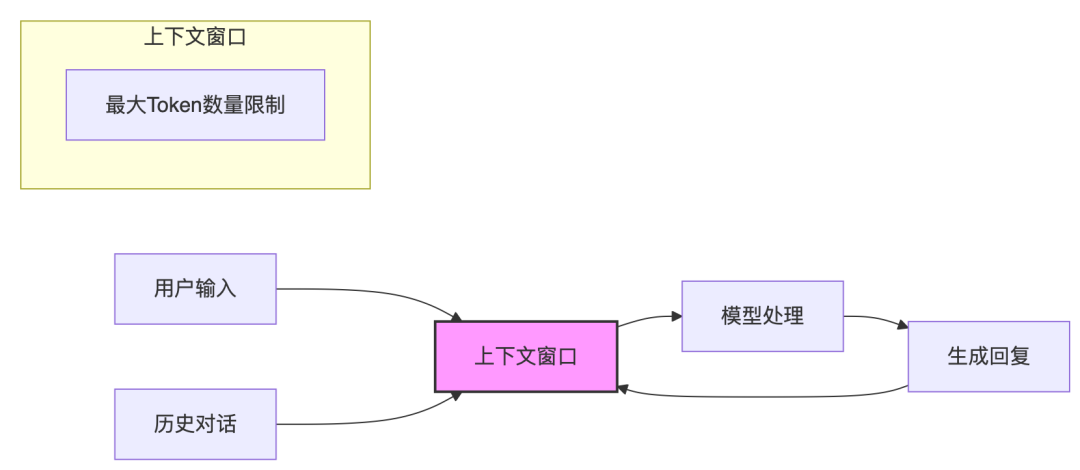

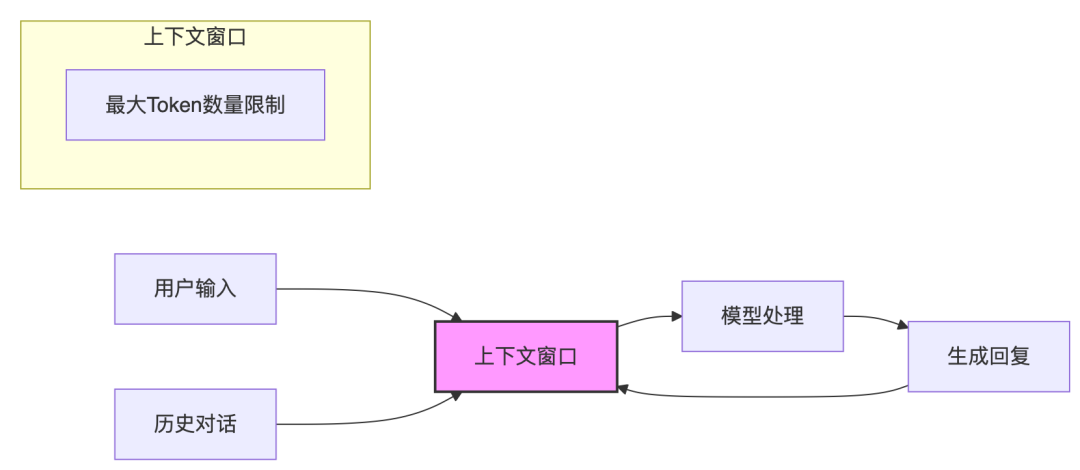

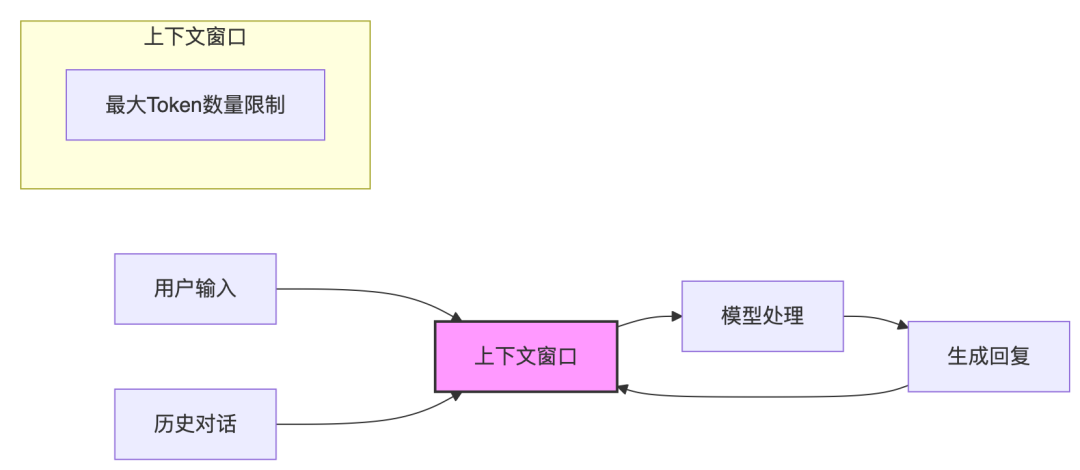

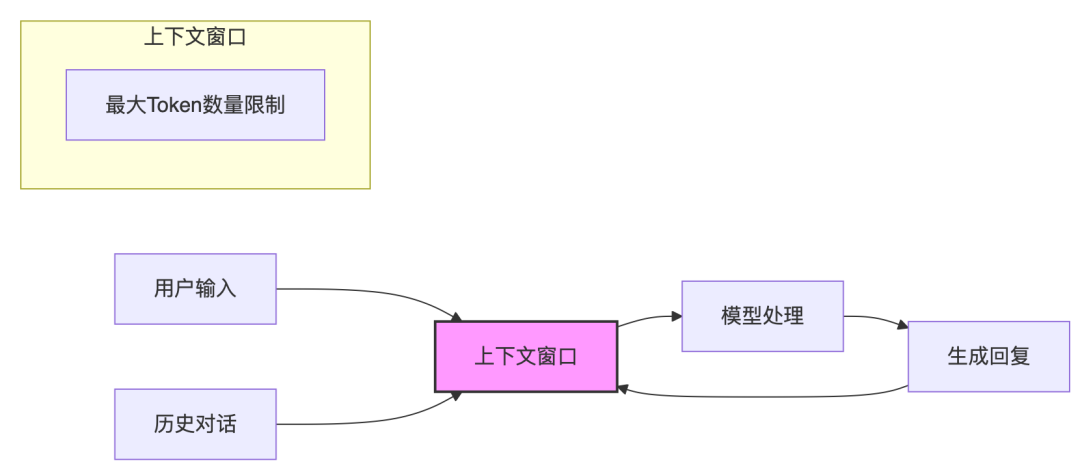

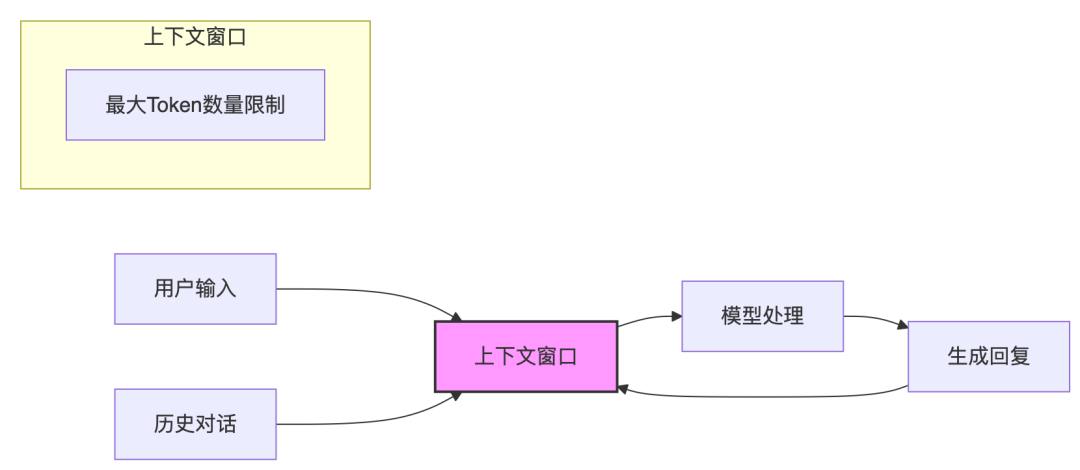

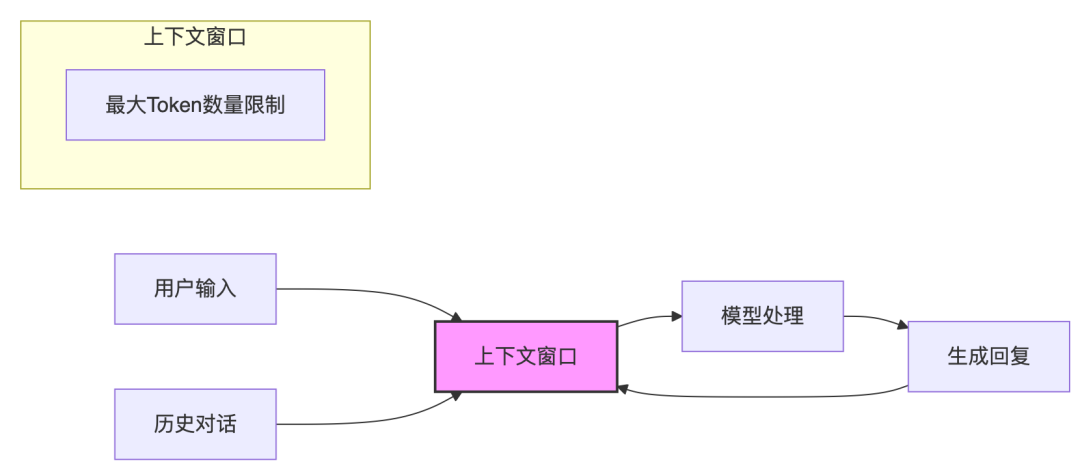

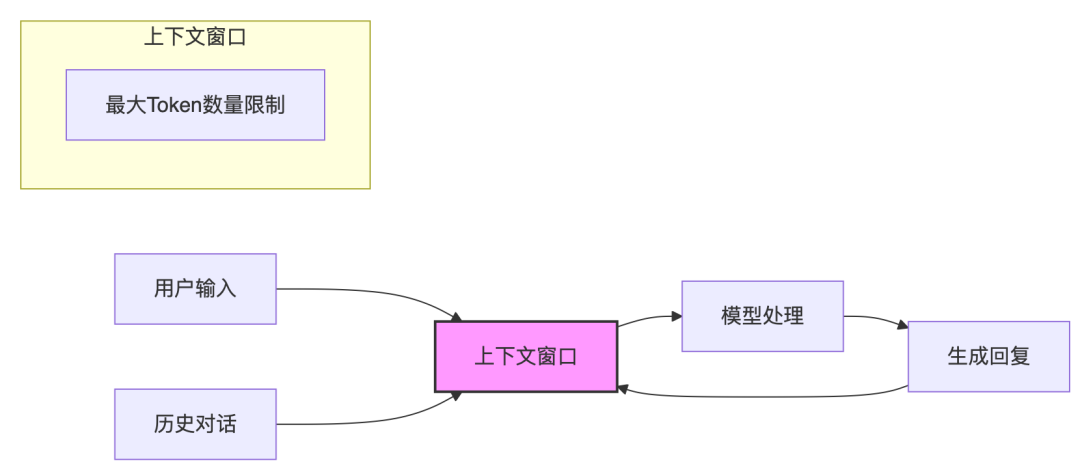

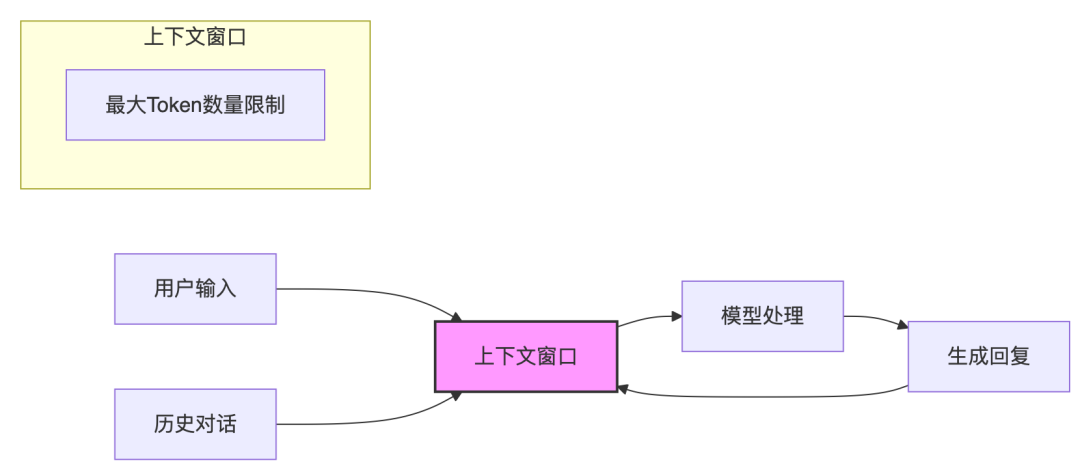

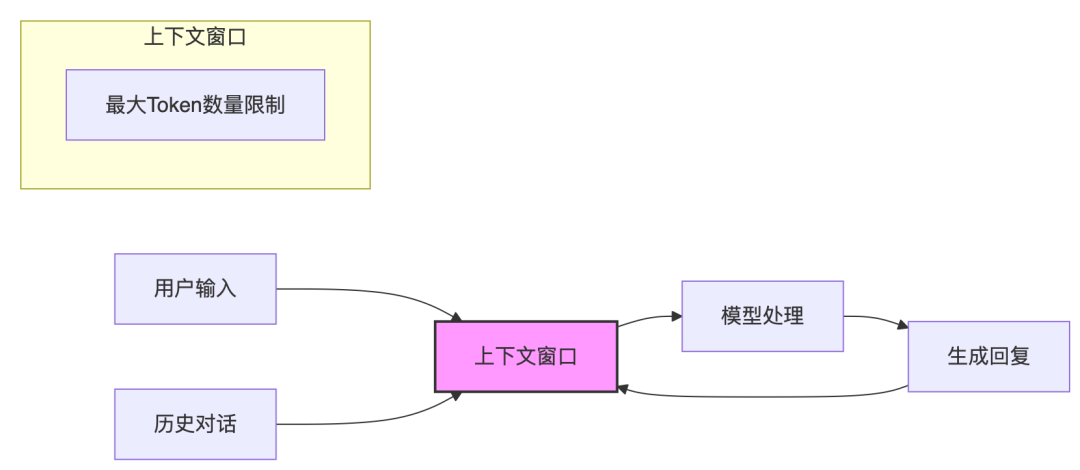

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

PDF文档解析–MinerU

MinerU是一款将PDF转化为机器可读格式的工具(如markdown、json),可以很方便地抽取为任意格式。A high-quality tool for convert PDF to Markdown and JSON.一站式开源高质量数据提取工具,将PDF转换成Markdown和JSON格式。主要功能 删除页眉、页脚、脚注、页码等元素,确保语义连贯 输出符合人类阅读顺序的文本,适用于单栏、…- 13

- 0

-

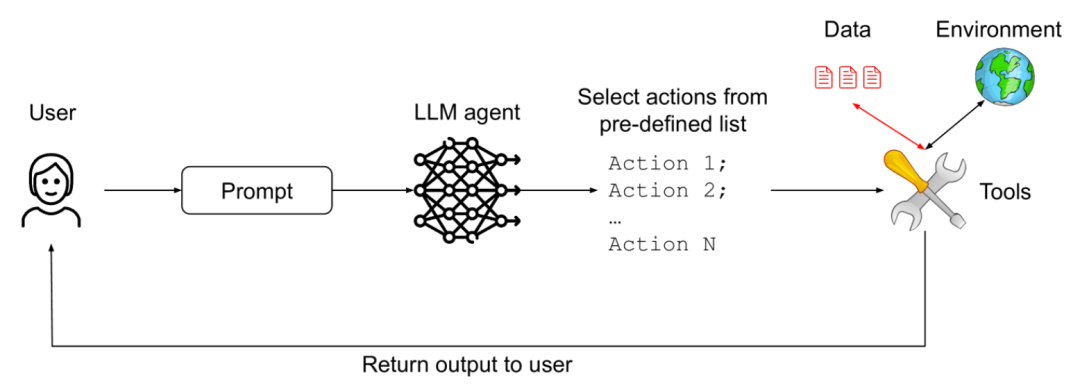

六个安全Agent设计模式:有效防止Prompt注入攻击

Prompt注入是当前大模型安全领域中最令人头痛的挑战之一,尤其对于那些被设计用来与外部环境交互并执行任务的智能体而言。攻击者通过在输入中嵌入恶意指令,试图操纵智能体的行为,可能导致数据泄露、未经授权的操作,甚至服务中断。 ChatGPT爆发“奶奶漏洞”,叫她“奶奶”可以实现你的愿望 最近,一篇由来自IBM、Invariant Labs、ETH Zurich、Google和Microsoft等机构…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

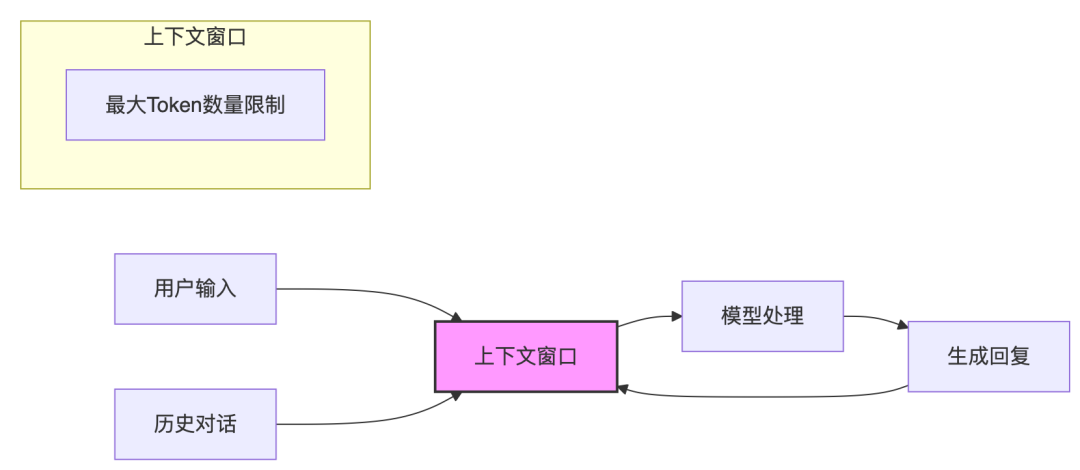

快速理解热门LLM大语言模型

作者:masonpy 本文尽量用最简单的方式, 帮读者理解 LLM, Transformer, Prompt, Function calling, MCP, Agent, A2A 等这些基本概念. 表述时不追求绝对准确, 尽量通俗易懂. 部分内容有个人理解的成份, 内容难免疏漏, 欢迎指正. 注意:本文需要你有基本的代码阅读能力. 当然非开发阅读也不会很困难. 一. LLM (大语言模型) 本质…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

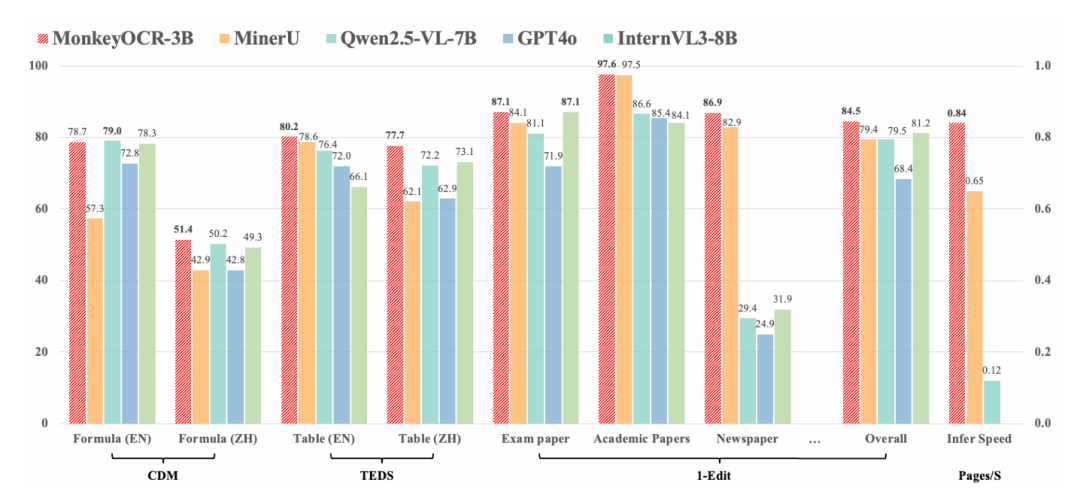

超越Gemini和Qwen!3B小模型横扫中英文文档识别,表格公式识别提升超15%

华中科技大学联合金山办公推出新一代文档解析模型MonkeyOCR!这款基于SRR(结构-识别-关系)三元组范式的创新模型,彻底颠覆了传统OCR技术的处理逻辑——既摆脱了模块化流水线的繁琐步骤,又规避了大模型全页解析的低效问题。在中文、英文及混合文档场景下,其3B轻量化模型展现出惊人实力:不仅以平均5.1%的性能优势超越主流方案MinerU,更在公式识别(+15%)和表格解析(+8.6%)等复杂任务…- 8

- 0

-

MCP很好,但它不是万灵药!真正的技术进步,往往始于祛魅之后的清醒认知

作者:boyang 人人都在聊MCP,但人们口中的MCP往往只是一个拼凑而成的幻影。如今,各大厂商纷纷为它镀金包装,就像硅谷创投圈每隔几年就热炒一次的那个“改变世界”的万能工具。然而,当最初的狂热稍退,我们不得不面对更复杂的问题:MCP真的适用于所有场景吗?它是否被赋予了过高的期待?技术史上从不缺少“神话”,而真正的进步,往往始于祛魅之后的清醒认知。当下AI领域最炙手可热的概念,莫过于MCP。MC…- 7

- 0

-

万字长文深入浅出教你优雅开发复杂AI Agent

作者:walli 在 AI Agent 浪潮席卷行业的当下,高效优雅开发具备复杂推理与协作能力的智能体成为业界焦点。本文将系统梳理 AI Agent 核心理念、主流协议与思考框架,并结合 Golang 生态工程化框架,深入剖析多 Agent 协作系统的设计与落地。QQ 官方 AI 伙伴小 Q 已基于 A2A+MCP 升级 Agent 架构,完成图片清晰化、扩图等能力接入,有效提升开发效率与系统稳…- 6

- 0

-

构建生产级GenAI系统:来自海外500+真实企业级大模型案例研究的经验教训

在生成式AI和大语言模型快速发展的技术浪潮中,一个问题主导着所有技术讨论:"企业究竟是如何在生产环境中实施这些系统的?" 研究论文与生产实际之间的鸿沟依然巨大。虽然关于微调LLM或构建基础RAG应用的教程数不胜数,但很少有资源记录企业如何将这些系统扩展到服务数百万用户、维持高性能并提供可靠结果。为了填补这一知识空白,编译了迄今为止最大的真实GenAI和LLM系统设计案…- 6

- 0

-

刚上线的大模型应用,为什么总是出现报错?

林凯迪 IBM 科技事业部自动化技术专家这是企业在 AI 应用时面临的非常普遍的一个问题。主要问题在于企业的运维是滞后于开发的。虽然企业看到了生成式 AI 的价值,并快速在内部部署了大模型,上线了应用,但是企业团队并没有适应这种新技术,同时也缺少相应的工具去发现问题和解决问题,因此企业在实际使用过程中可能会遇到 API 报错,响应特别慢的情况,导致新应用的实际使用…- 7

- 0

-

Figma 推出官方 MCP,真正做到了所见即所得

前段时间 MCP 爆火,其中一个最热门的服务是 非官方的 Figma MCP ——用户只需复制 Figma 链接到 Cursor,对话即可自动生成页面。 不过,这个服务对复杂页面的还原度不足。之前和该服务作者沟通过,它的处理方式是对 Figma 源文件内容进行压缩处理。一旦页面较复杂,就容易出现上下文丢失,无法高精度还原。 但是Figma官方的MCP会将变量、组件、布局等信息直接导入至 IDE,复…- 9

- 0

-

AI识图,提取标题、点赞等数据,哪家效果好?

前两天,我们团队小伙伴一直在获取蝴蝶号的一些数据。主要用的是传统的一些方法。搞完后我突然想起来,获取数据这件事,能不能用AI识图的功能来做呢?毕竟,目前能展示到屏幕上的数据,都能够被AI看到。获取数据需要下拉、翻页,这不是障碍:要么手动截图,要么录屏之后自动截图,这整个过程也可以自动化。我在前一篇文章《强得怕了!用Kimi批量识图+生成Excel表,3分钟找出这10个被验证的AI商业化项目》里面,…- 9

- 0

-

「LLM企业实战03」三大引擎对决:Ollama、Xinference与VLLM服务框架实测

一、 硬件就位,模型如何高效“跑起来”?上一篇我们详细讨论了 LLM 私有化部署的硬件选型,搞定了算力基础。但光有硬件还不够,我们需要一个“引擎”——也就是 LLM 服务框架——来负责加载模型、管理资源、接收用户请求,并高效地把模型的计算能力转化成实际的服务。市面上这类框架有不少,选择哪个直接关系到你的 LLM 应用的性能、成本和部署维护的复杂度。本篇将重点对比几个我们实践中接触较多或社…- 13

- 0

-

Andrej Karpathy:对于AI Agent的安全风险,我也束手无策

当我们还在想方设法的让 AI Agent 为我们多干活的时候,有人已经看到了下一层。 Agent是否安全。 今天 Andrej Karpathy 在 X 上又发一贴,表明了他对 AI Agent 的态度:不敢用! 他在贴中用了一个比喻来形容现在 AI Agent 的状态。 就像早期的计算机系统一样,充满了各种病毒,但缺乏有效的防御措施。 正因为没有防护,导致他不敢广泛使用 AI Agent。 他还…- 4

- 0

-

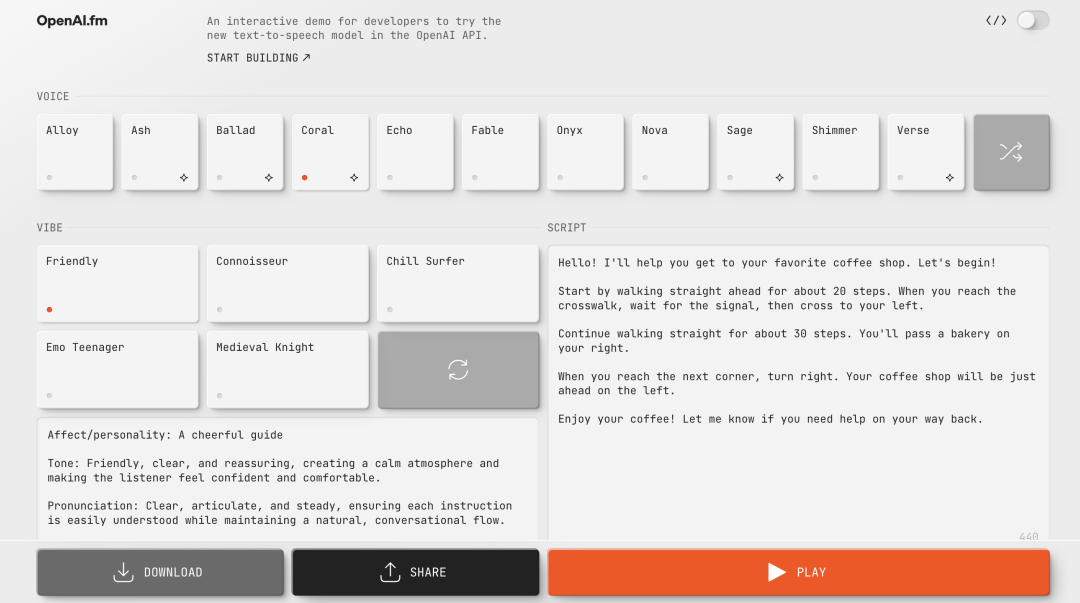

AI的认知象限:浅谈一下我们与AI的边界

最近,无论是工作上的数据分析,还是生活中的菜谱教程,我的第一反应往往不是去翻书或者查搜索引擎,而是习惯性地打开AI对话框,它似乎比我更了解这个世界,甚至比我更了解我自己。但事实真的如此吗?AI的边界究竟在哪里?它知道什么,我们又知道什么?今天聊聊关于AI的“认知象限”,或许能对你有所启发。第一象限:我知道且AI知道 (Known by Me, Known by AI)“我知道且AI知道”是我们最熟…- 5

- 0

-

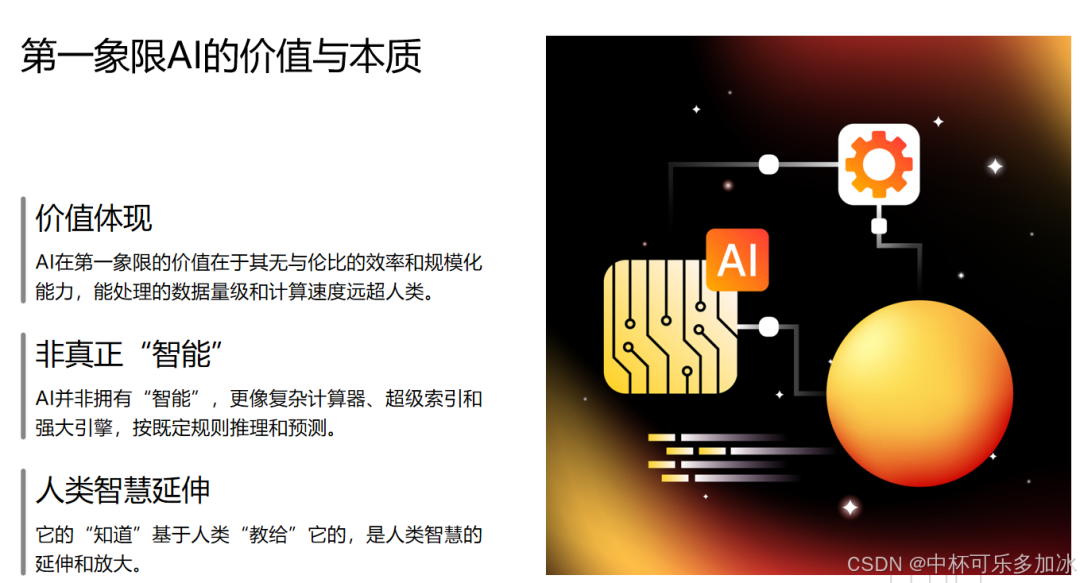

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

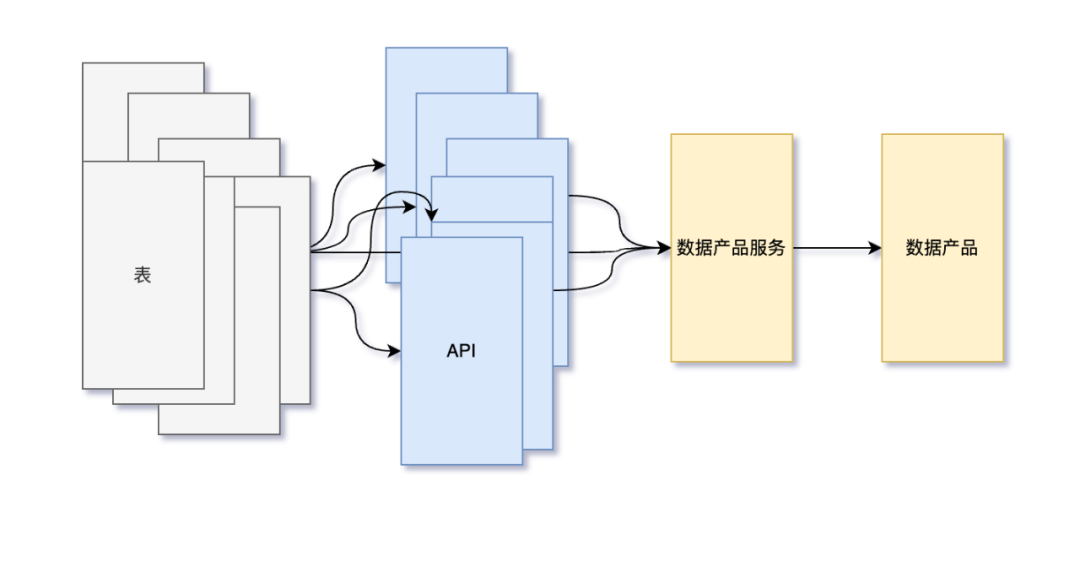

从模板到指标服务:解锁AI时代的数据新可能

一、背景随着公司业务不断地发展,我们推出了众多数据产品以满足商家在各种经营场景下的数据分析需求,然而,这些数据产品在应对复杂用户问题时,仍然缺乏足够的便捷性和灵活性。为此,我们尝试结合大语言模型(LLMs)构建交互式智能问答类的数据产品。然而,当数据产品与AI结合后,传统的烟囱式开发模式,即为满足各自数据产品需求的定制化开发,已无法支持AI灵活的数据查询需求。在这种背景下,指标服务应运而生。&nb…- 6

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!