-

你以为AI理解了,其实没有

最近我读到一项NYU(纽约大学)研究,彻底颠覆了我对大语言模型"智能"的认知。长期以来,我们一直在争论LLMs(大语言模型们)是否真的像人类一样思考,现在终于有人用科学的方法给出了答案——结果可能会让你大吃一惊。这项研究的核心问题很简单却很深刻:大语言模型真的理解概念和意义吗,还是仅仅在进行复杂的统计模式匹配?为了回答这个问题,研究团队使用了认知心理学领域的经典实验…- 5

- 0

-

Ollama发布更新,支持带工具调用的流式响应

实时交互和即时响应是AI应用体验的关键,但阻塞式的工具调用往往会打断内容的流畅性,导致用户在模型与外部工具交互时经历不必要的等待。Ollama 近日推出v0.8更新,带来了带工具调用的流式响应 (Streaming responses with tool calling) 功能,让开发者构建的聊天应用从此能够像流式输出普通文本一样,实时地调用工具并展示结果。这一更新使得所有聊天应用都能够…- 4

- 0

-

对话傅盛:Agent杀死了传统图形界面

两年前的2023年6月,一场关于ChatGPT对创业公司影响的争论在朋友圈爆发。金沙江创投主管合伙人朱啸虎认为,GPT赛道对创业者很不友好,不建议创业者选择这一方向。而猎豹移动董事长兼CEO、猎户星空董事长傅盛则直言朱啸虎“无知无畏”,并称,硅谷一半的创业企业都在围绕GPT。时间拉长一年,这场争论最终以共识收场。朱啸虎后来也解释称,其核心观点是不要再迷信通用大模型,(因为大模型)“明年3.5就成c…- 6

- 0

-

大模型是如何会“思考”的?—— 对 Lilian Weng《Why We Think》的非技术向阅读笔记

对于非技术人员来说,LilianWeng的这篇内容读起来稍微有点困难。除却那些需要一直查询的技术细节,我一直在想,对于一个非技术人员,我最大的 take away是什么?我觉得,如果只带走一个点,那就是——从不同的维度来理解模型是怎样思考的。一、语言层的思考:Thinking in Tokens如果你曾对 ChatGPT 说过:Let's think step&nbs…- 6

- 0

-

大模型稀疏化技术原理:DoubleSparse

近年来,随着Transformer、MOE架构的提出,使得深度学习模型轻松突破上万亿规模参数,从而导致模型变得越来越大,因此,我们需要一些大模型压缩技术来降低模型部署的成本,并提升模型的推理性能。 模型压缩主要分为如下几类:模型稀疏化知识蒸馏模型量化本系列将针对一些常见大模型稀疏化方案(LLM-Pruner、SliceGPT、SparseGPT、Wanda)进行讲述。大模型稀疏化技术原理:概述大模…- 4

- 0

-

企业级人工智能 | 你的企业怎么上智能体

今天,我在一个大型企业跟经理人团队进行了一场企业人工智能应用的研讨会。先说个我准备这个研讨会的小花絮:最近两年我一直在各种不同场合下讲人工智能的企业级应用,感觉人工智能技术迭代太快了——去年还在讲企业如何用生成式AI,今天来看,这些内容几乎都过时了;随着模型推理能力提升和思考模式加强,同时大模型纷纷具有 function calling 能力,智能体应用已经成为企业使用大模型的…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

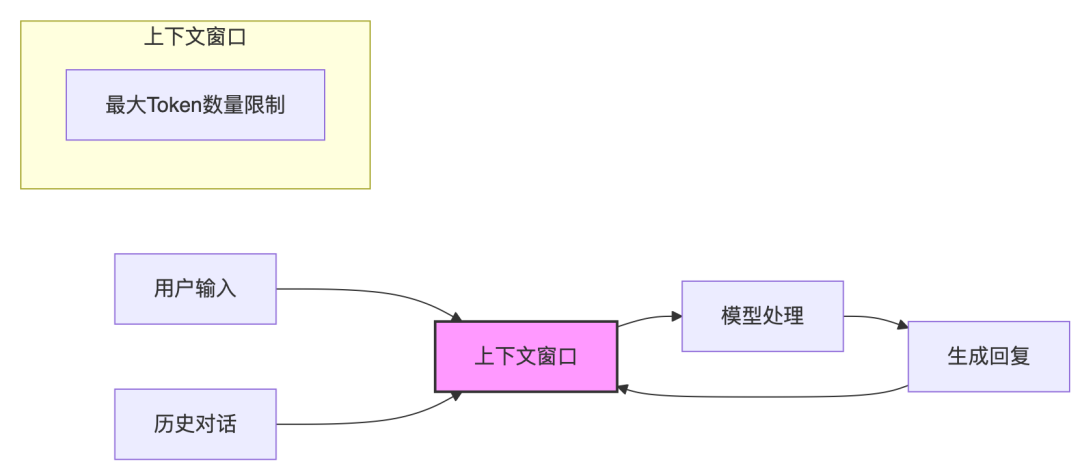

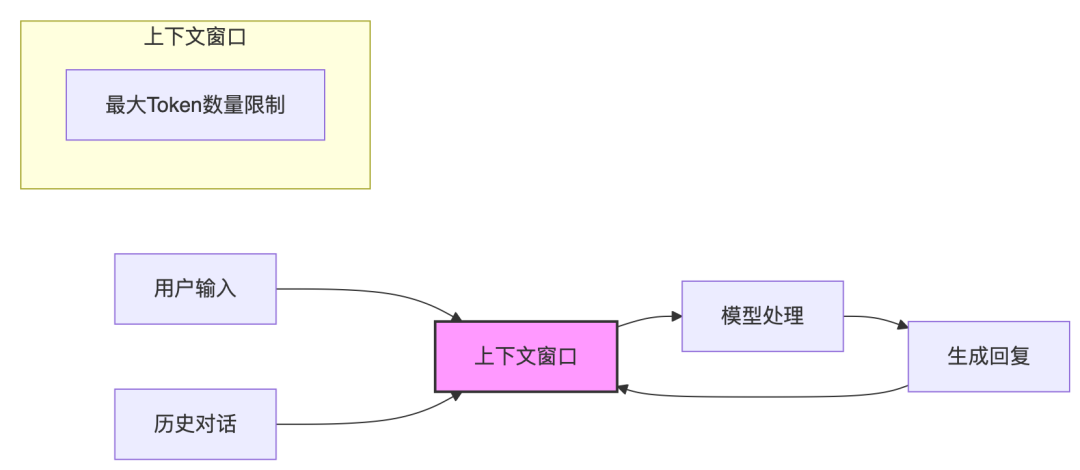

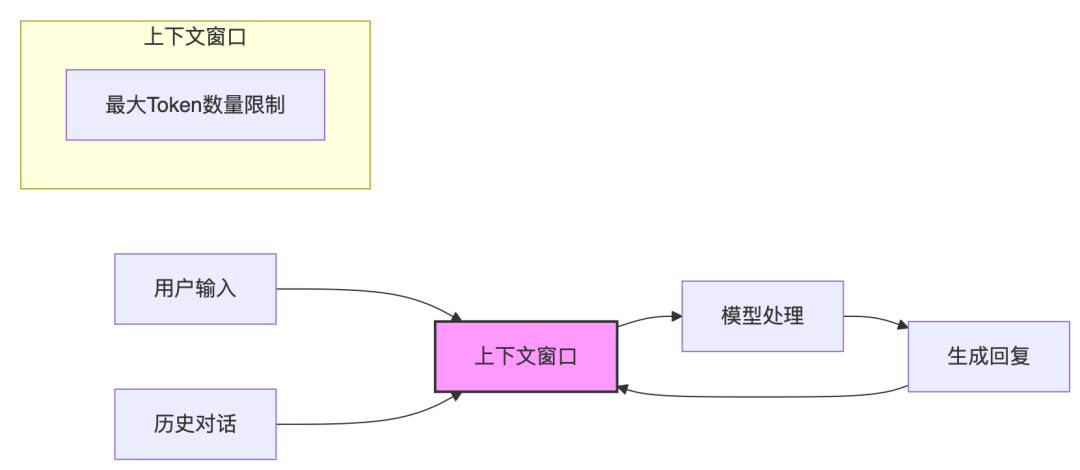

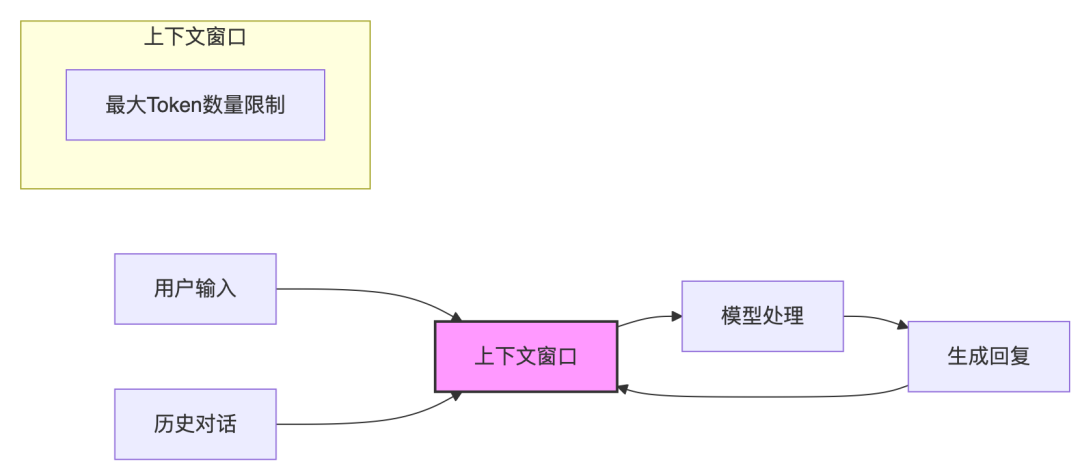

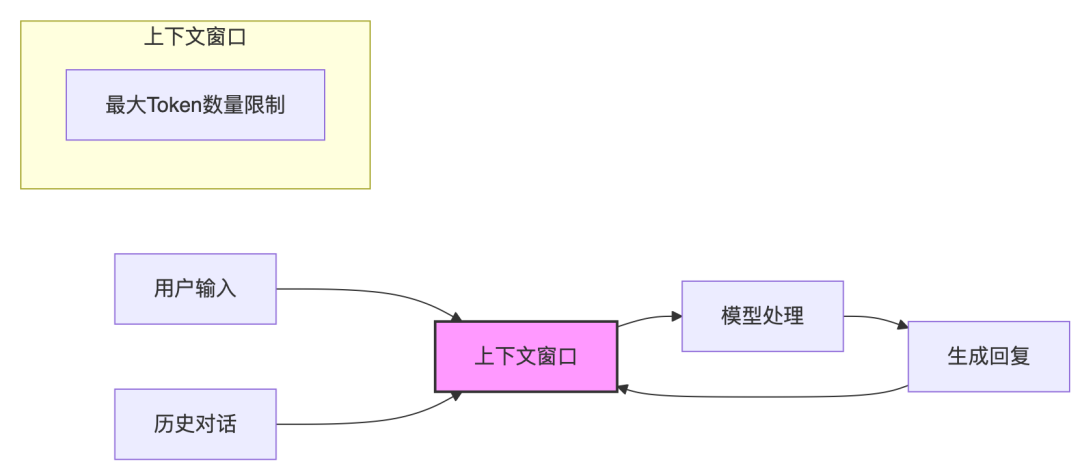

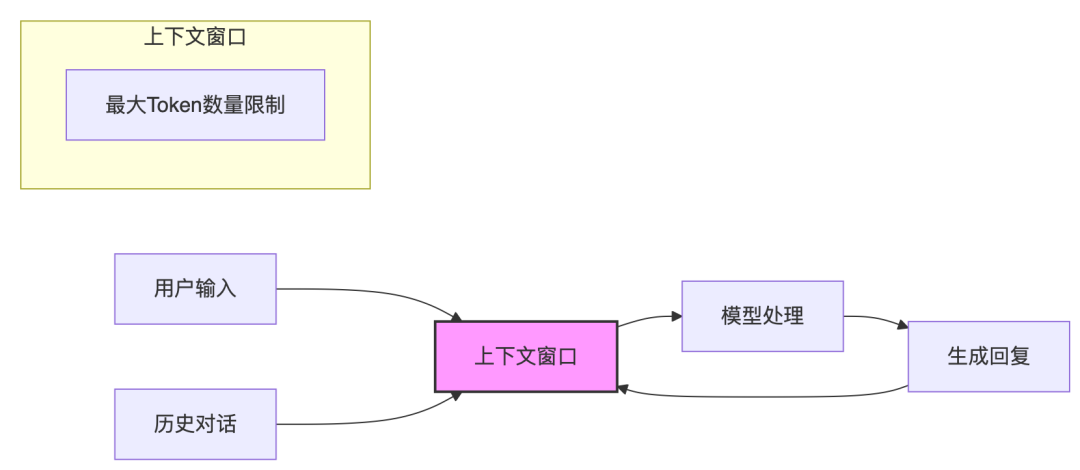

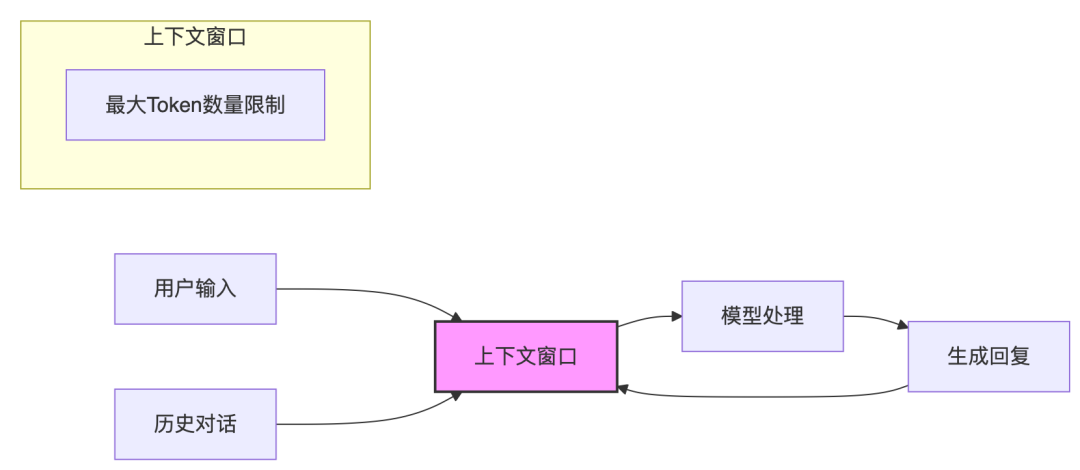

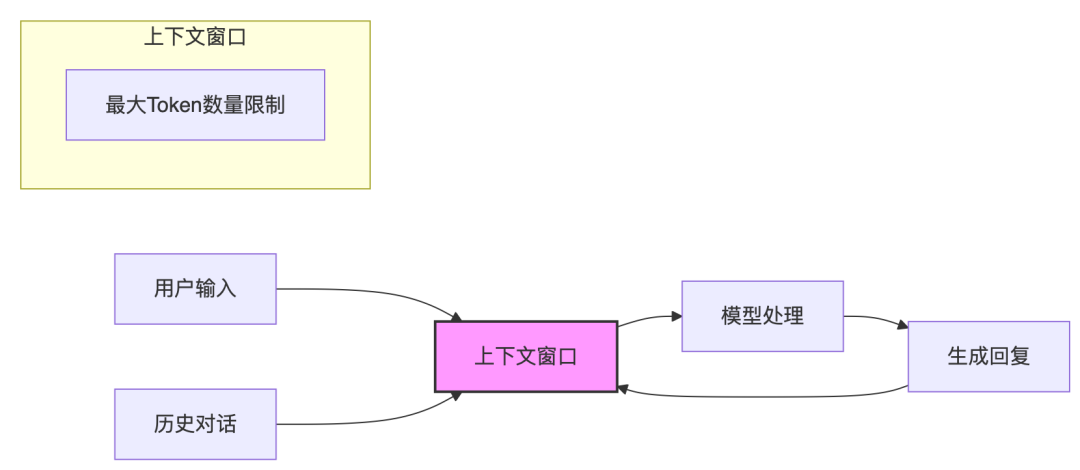

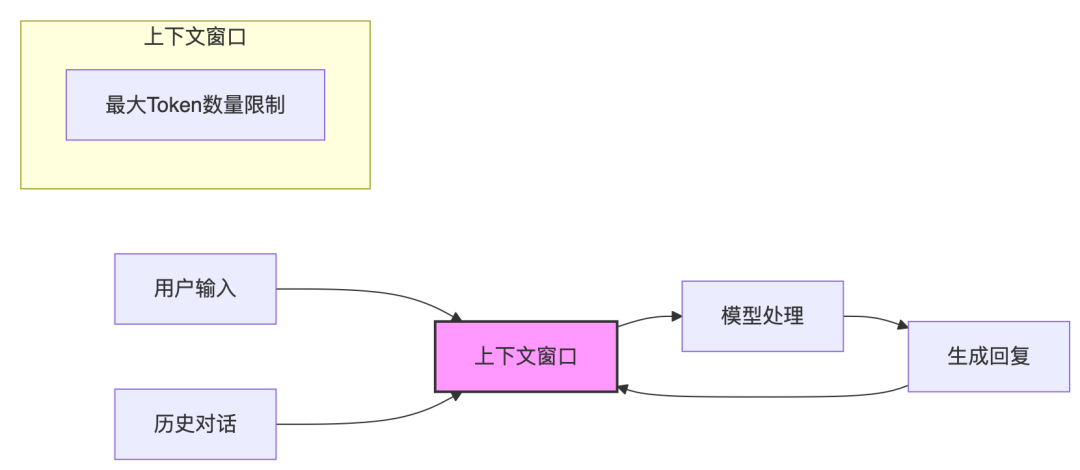

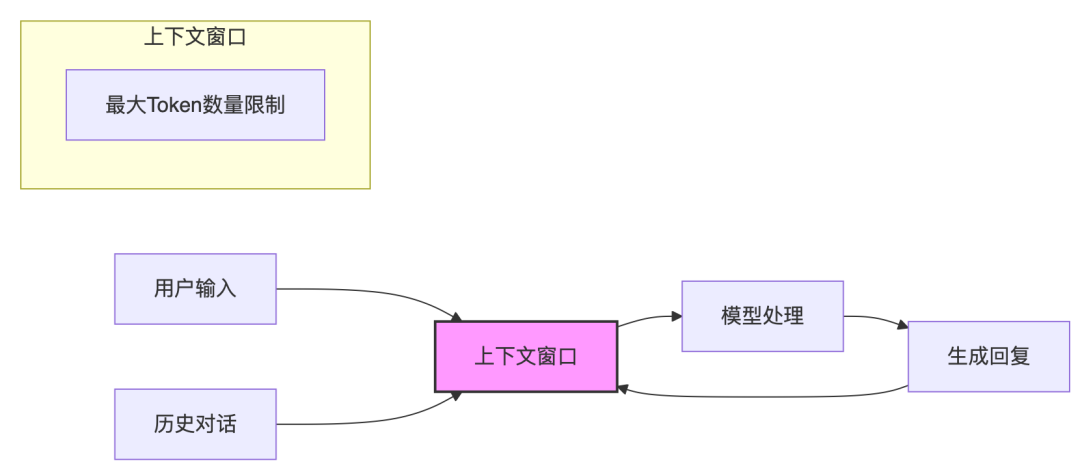

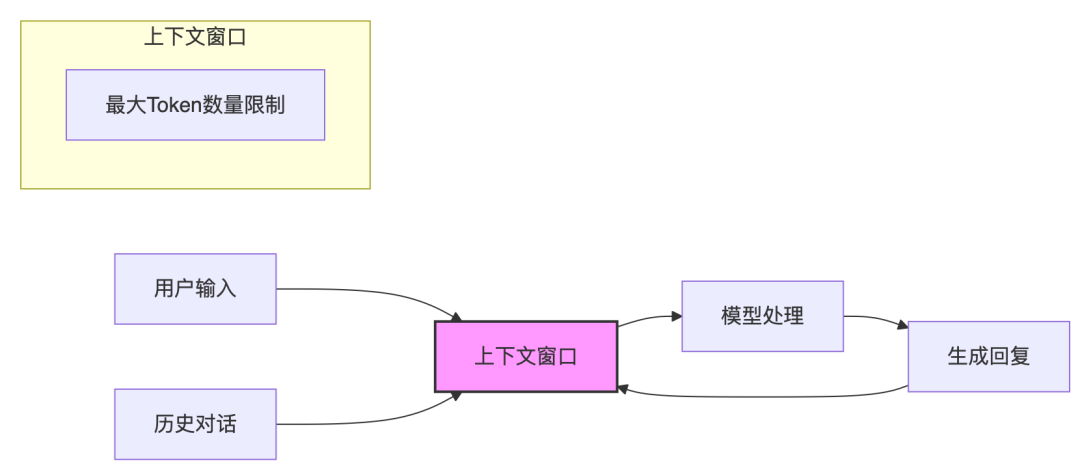

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

6大MCP服务器,让AI开发者从“青铜”秒变“王者”

点击“数字共生” 立即关注我们 最近两个月我沉浸式测试了 100 + 款 MCP 服务器。这类工具就像给 AI 装上"实体操作杆",让 ChatGPT、Claude 等大模型突破纯文本限制,真正触达网页、文件、数据库等物理世界。以下 6 款神器堪称"开发提效王炸组合",每款都附实测代码片段,手把手教你解锁 AI 的"动手能力"。Brigh…- 16

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

基于因果AI的智能投研与智能投顾技术研究及应用示范

课题单位:上海金仕达软件科技股份有限公司 1.课题背景 大数据和人工智能(AI)技术在金融领域中得到广泛的应用。金融领域存在如下特点:数据维度高、信噪比低,且金融从业人员要求AI模型具有稳健性和可解释性。当前流行的深度学习模型是基于“数据关联”模式,缺乏对因果关系的推理,这导致模型泛化能力差和不可解释等问题,限制了传统AI技术在金融业务中的应用。 “如何实现可信可靠可解释人工智能技术路线和方案”是…- 11

- 0

-

基于生成式大模型的复杂内容理解及对话平台智能化应用研究

课题单位:申万宏源证券有限公司、恒生电子股份有限公司 大模型应用赋能团队(北京) 大模型应用赋能团队(上海) 一、研究背景 随着金融领域数据爆炸性增长和客户对智能化服务的不断追求,大型预训练语言模型在证券行业中的应用已成为重要研究方向。大模型在财富管理、合规风控等各业务中具有广泛应用前景,可应用于智能客服、智能投顾和智能投研等场景,提高客户满意度和员工工作效率。 本课题利用证券公司私有专业数据探索…- 8

- 0

-

大模型在智能运维领域的应用研究

课题单位:中国证券登记结算有限责任公司上海分公司、北京理想信息科技有限公司 1 课题背景 金融行业运维领域具有多元化的业务场景和广泛的数字化转型升级需求,具备大模型垂直落地的基础,通过快速、准确的信息整合及自动化任务处理,大模型技术能够推动金融行业运维领域数字化转型。鉴于金融行业对系统的稳定性、数据的安全性有着极高的要求,运维工作不仅涉及日常的系统维护,还包括风险防控、合规检查等多个方面。在此背景…- 6

- 0

-

基于大模型技术的企业知识图谱应用研究

课题单位:中信证券股份有限公司、上海水滴征信服务有限公司 1.课题背景 《金融科技发展规划(2022-2025年)》作为指导金融科技健康有序发展的纲领性文件,明确强调了利用新兴技术加强金融服务实体经济的能力,提升金融风险防控水平,并促进金融资源的高效配置。同时,《证券期货业科技发展“十四五”规划》作为行业专项规划,指出要通过完善金融科技标准体系、深化大数据与人工智能应用等措施,增强证券期货机构的核…- 6

- 0

-

拨云见日:MCP核心概念(Prompt、Resource、Tool)的设计初心与最佳实践思考

摄影作品:《拨云见日》 拍摄于五台山中台 上周末在2025AIGC上海开发者大会(MCP引领Agent互联网新时代)上分享了主题为《大模型、Agent、MCP协同进化趋势的思考》的演讲,分享预测了未来一年大模型、Agent、MCP生态的发展趋势,需要PPT的朋友,可以点击上面卡片关注我,回复关键词(MCP)即可领取。 本文的内容源自于其中一页PPT的深度思考 以下是正文: 01 / 缘起 MCP(…- 4

- 0

-

AI浪潮下的“价值重塑”:从“被定义”到“定义自己”

AI智能体大爆发,为何总感觉“差一点”? 最近,AI Agent产品可谓是迎来了大爆发。各种设计类、自动化任务处理(如Manus、Coze空间等等)的产品层出不穷。我们使用AI的方式,也早已不再仅仅是简单的对话聊天。AI现在能够接受任务、拆分任务,并调用不同能力去执行,最终直接交付结果。 然而,在体验了形形色色的Agent产品后,总感觉还是差了那么一点火候。比如,你给出了大纲,也明确了注意事项,但…- 4

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!