-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

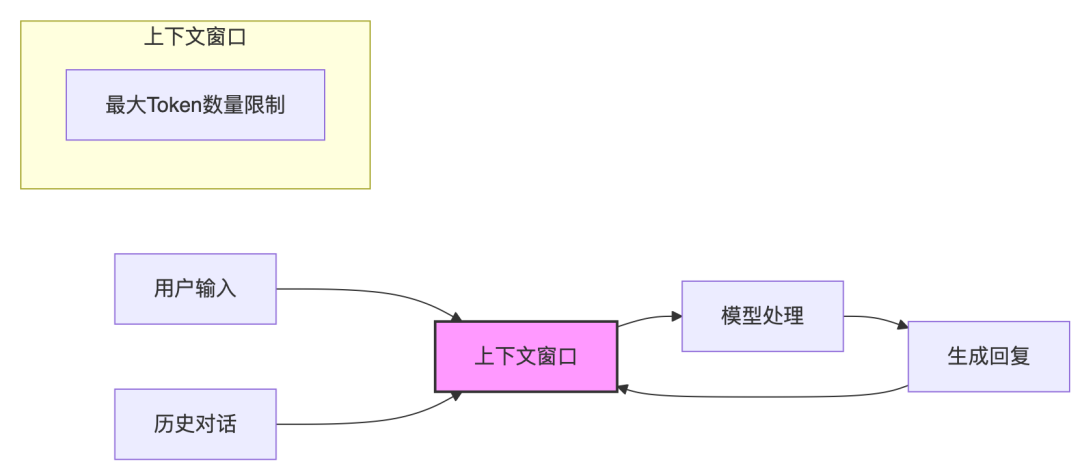

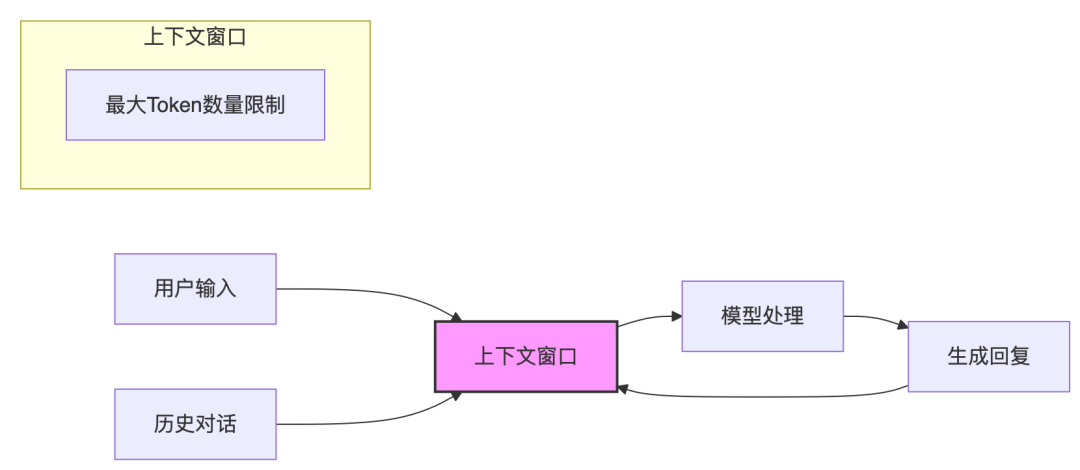

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

货拉拉海豚平台基于LWS实现的大模型分布式部署实践

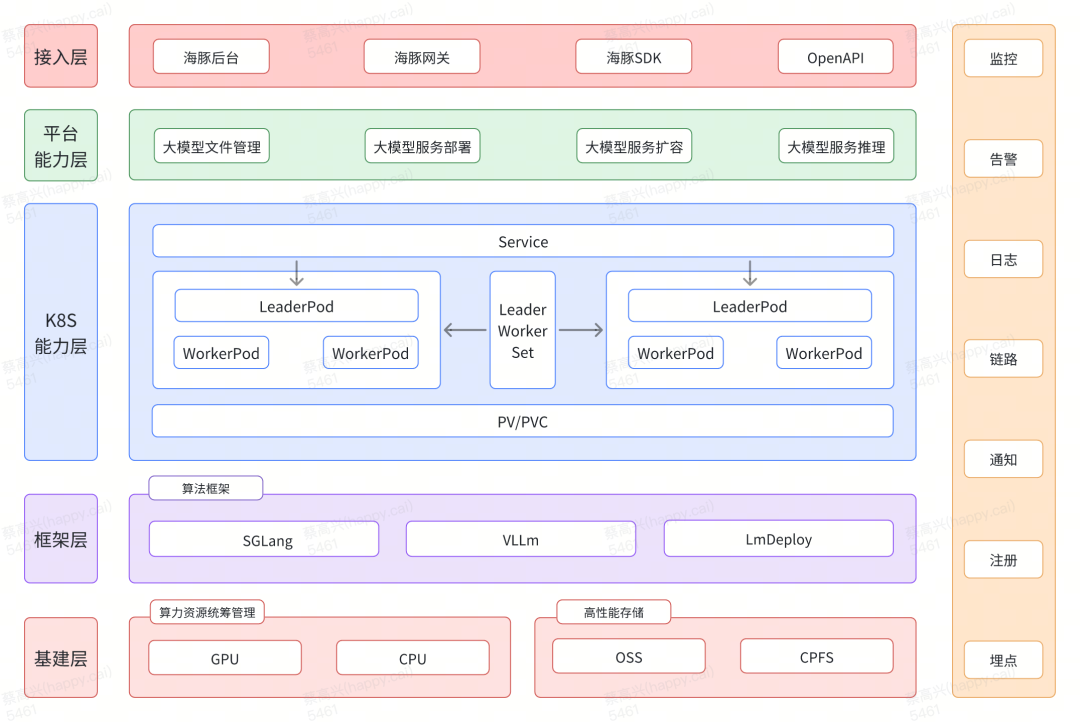

1前言海豚平台是货拉拉自研的一站式云原生AI开发平台,覆盖了从数据处理、镜像构建到模型开发、训练、部署及在线推理的全流程。经过近两年的建设,海豚平台已成为货拉拉AI开发的核心基础平台,显著提升了AI开发人效和算力资源利用率,有力推动了公司AI技术与业务的发展。然而随着大模型技术的快速发展,海豚平台在部署大模型时迎来新的挑战。2海豚平台大模型部署的挑战海豚平台目前使用K8S的Deployment来部…- 3

- 0

-

在本地部署Qwen3大模型与Dify环境中亲测制作“合同审查智能体”应用

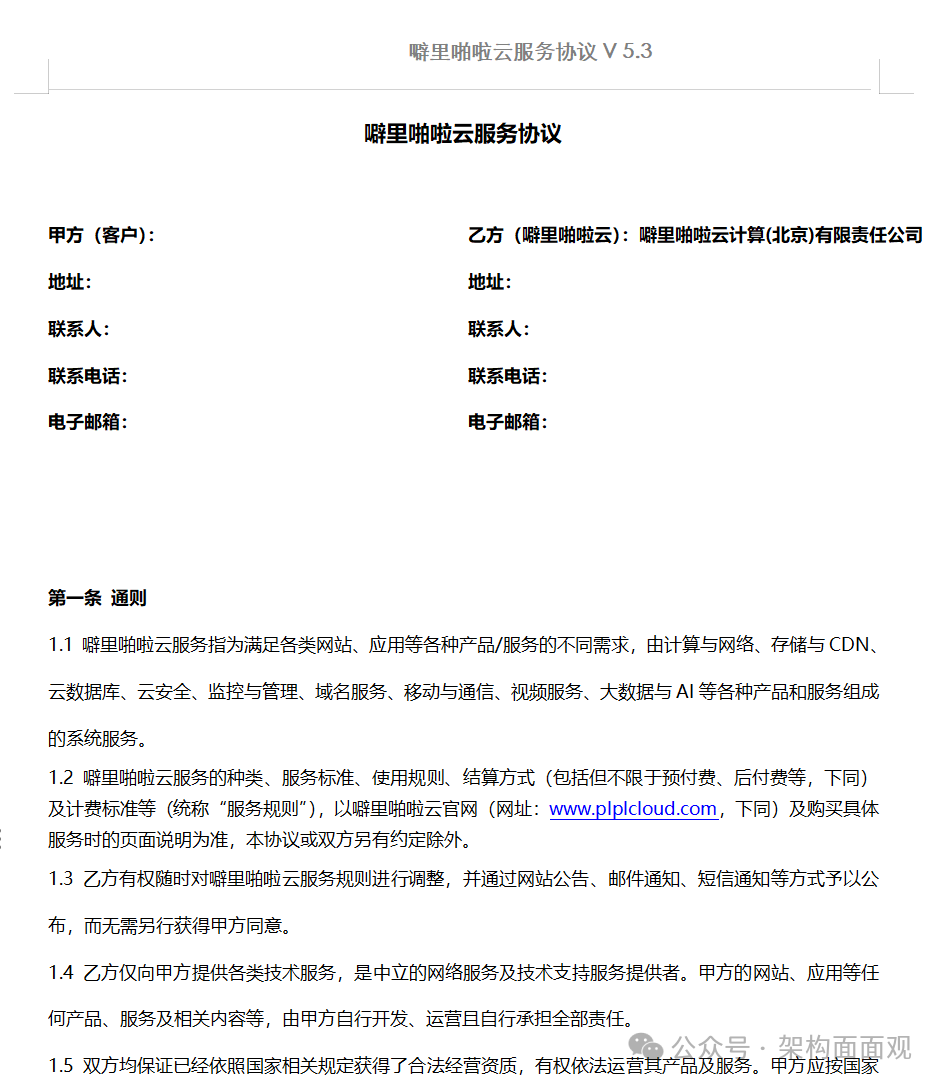

在与多位律师朋友以及自己开公司的老板朋友聊天中发现,他们都有一个迫切的需求:“希望对自己手头的大量合同文本,做一个全面的合同风险评估,提前采取措施规避风险点,或者提前准备以应对风险的爆发,并减少损失。”因此,在私有化部署的大模型与AI应用开发平台中开发本地可用的“合同审查智能体”,就像给企业装了一个既聪明又可靠的“法律秘书”。 想象一下,公司的合同就像家里的贵重物品。如果使用网上的大模型和类似De…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

汉得 x 亚马逊云科技 x Oracle|生态共建,AI企业级落地的全链路实践分享!

近日,由江苏省企业信息化协会主办,上海汉得信息技术股份有限公司、亚马逊云科技和甲骨文(中国)软件系统有限公司联合举办的「生态共建:AI企业级落地的全链路实践分享」论坛在江苏南通圆满举行。 当前,人工智能技术正加速与实体经济深度融合,成为企业降本增效、培育新质生产力的核心驱动力。然而,中小企业在AI技术应用中仍面临场景匹配难、成本高、人才短缺等痛点。 本次活动旨在共同探索战略性新兴产业科技成果,通过…- 3

- 0

-

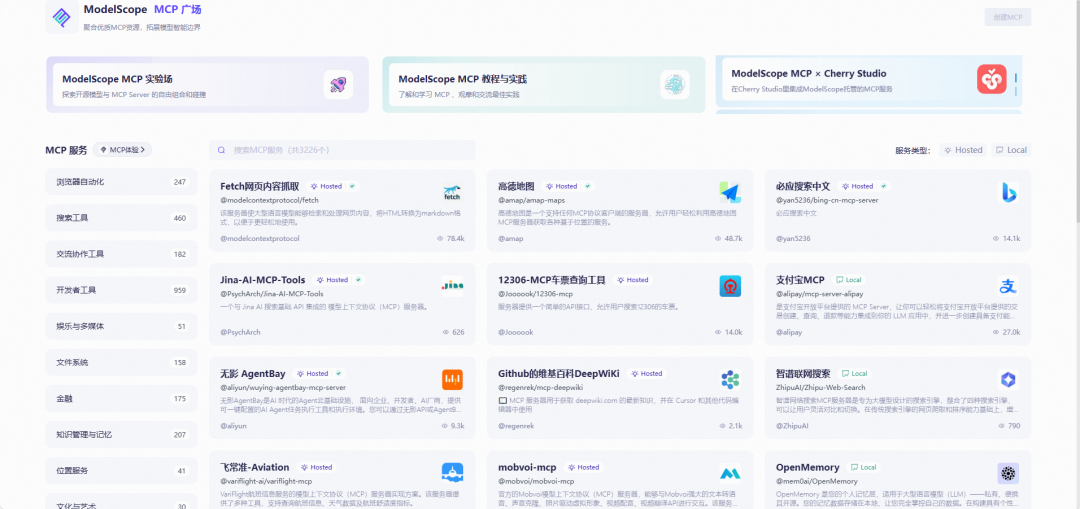

不要手动部署MCP了!魔搭社区一键部署MCP!

大家好,我是莫非,专注于AI,工具,智能体。 关注公众号可领取AI大礼包一份,且文末另有福利。 MCP工具现在的量级已经非常之大了,比如在MCP.so上就已经收录了13000+的MCP。 他们功能各异,但是很多都需要自己部署使用。 对于有技术基础的来讲,或许还好,但是小白就有些困难了。 今天,介绍个方法,可以不用自己部署就可以使用MCP。 有请今天的重磅嘉宾——魔达社区(https://model…- 7

- 0

-

大语言模型真的会“读心术”?揭秘AI理解你的文字背后的数学魔法

大语言模型真的会“读心术”?揭秘AI理解你的文字背后的数学魔法 别再被表象迷惑,它的“理解”本质是概率游戏 每次和ChatGPT对话时,你是否曾为它精准的回应后背发凉?当它写出符合你潜在需求的方案,甚至预判你未言明的意图时,那种“被看穿”的震撼感,几乎让人相信机器拥有了读心术。 但真相远比想象更精妙——也更具数学美感。 结论先行:LLM从不真正“读心”,它只是把你的文字切成向量,在数十亿次概率推演…- 5

- 0

-

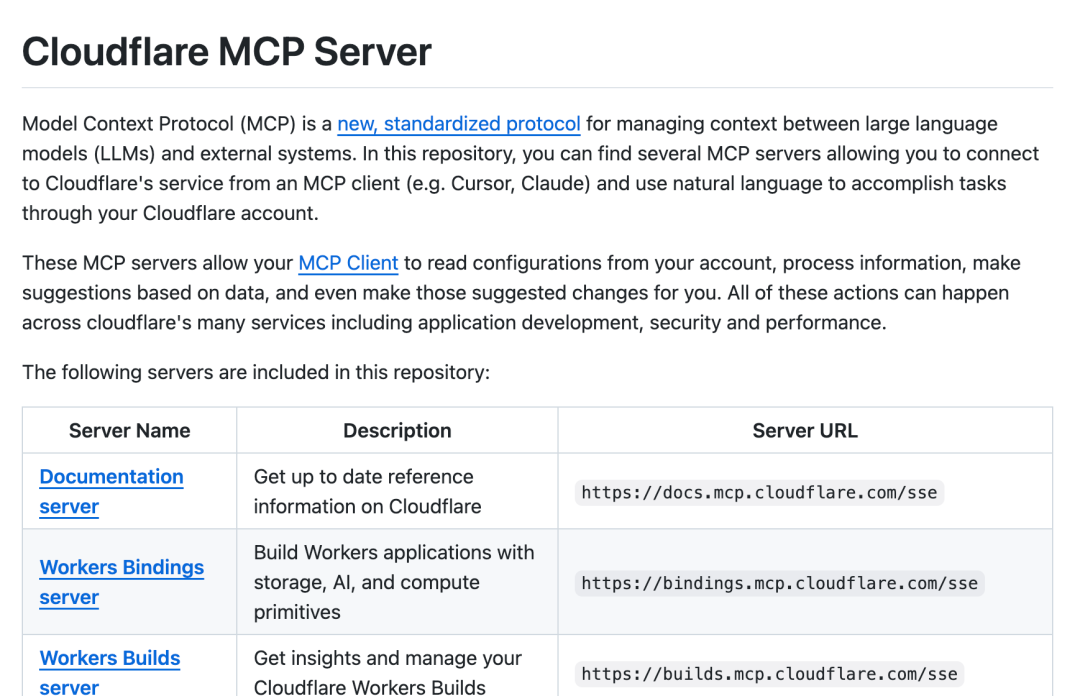

开挂!Claude发布MCP网页版集成和Research

Claude发布MCP网页版本集成和Research,正式开启开挂模式。 全面基于远程 MCP 的集成现已面向所有付费 Claude.ai 方案开放(包括 Pro 版用户),提供将 Claude 连接到各种工具和数据源的能力。 远程 MCP 的集成分两种,一种是官方内置集成,一种是自定义集成。 目前Claude官方内置集成合作伙伴有 Asana、Atlassian、Cloudflare、Inter…- 6

- 0

-

为什么企业AI落地必须从“决策点重构”开始?为什么是基于基于决策点进行重构?

流程解构范式的根本性变革 之前我梳理分享了企业落地AI的五步流程,其中最重要的就是第一步:痛点梳理和流程解构。我们来展开说明这个关键步骤的致命误区和正确思考过程。 Agent落地路径及关键动作详解" data-itemshowtype="0" linktype="text" data-linktype="2">企业AI A…- 6

- 0

-

白话MCP—拆解AI领域又一个爆火概念

你听说过MCP(Model Context Protocol,模型上下文协议)吗?这是我的经历:发现全网都在讨论MCP;搜索教程,被“服务器”、“客户端”等术语淹没;似懂非懂地关闭页面。如果你不关心技术细节,而想了解AI产品发展的现状和方向,欢迎看这篇,了解为什么会有MCP这个东西。我希望做到:尽量避开或充分解释专业名词;不打蹩脚的比方——拿厨房或Type-C来比喻对理解它没帮助;探讨新概念的本质…- 4

- 0

-

深度解读“互联网女皇”最新AI趋势报告,企业与个人何去何从?

在科技日新月异的今天,一份报告再次点燃了我们对未来的想象——“互联网女皇”玛丽·米克(Mary Meeker)的AI趋势报告。这份报告不仅揭示了AI技术当前的惊人进展,更以前瞻性的视角描绘了其未来的发展蓝图。对于我们每一个人和每一家企业而言,这不仅仅是一份数据翔实的分析,更是一份关乎未来生存与发展的战略指南。 我们深入剖析了这份报告,并探讨了如何将这些洞察应用于真实的商业环境中。希望能通过本文,为…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

Cursor核心成员访谈:我们对AI编程的几个关键判断

这两天,我听了一期 Cursor 团队的播客,信息量非常密集,也非常值得一听。 团队几位核心成员围绕 “AI 编程” 这个主题,聊了很多当前他们在产品和研究中的一线观察和思考,涵盖范围从模型训练、工具链设计,到反馈机制、记忆系统、长上下文的处理方式等等,几乎把现在 AI 编程 Agent 遇到的关键问题都过了一遍。 对我来说,这期最有启发的几个点,一个是他们提到目前编程模型的瓶颈不只是模型能力本身…- 3

- 0

-

凡墙皆是门:展示一个从发现问题到解决问题的全过程

起因 昨天想要复现黄老师的一篇公众号文章里的操作: AI产品黄叔:https://mp.weixin.qq.com/s/LbWsik3oh1V1YFgOwNvxfg 复现:https://cpcfxio4kb.feishu.cn/wiki/PAlPwFfbOi0uCukkAUMcR6YPnjg 复现过程遇到了一点问题。 高德MCP添加成功,显示“可使用” 在运行过程中却总是出现(HTTP 504)…- 7

- 0

-

Gemini最新模型,一键把YouTube视频变成精美网页

Gemini最新发布的Gemini 2.5 Pro Preview 05-06模型能力非常强,可以直接把YouTube视频变成好看的网页,既方便学习,又方便分享。方法来自于 卡兹克:https://mp.weixin.qq.com/s/Xi9jOgws46O6EUq_jdaIYA Prompt 帮我将youtube视频生成网页,不要遗漏信息根据上面内容生成一个 HTML 动态网页1. 使用Bent…- 3

- 0

-

OpenAI vs. ByteDance II

五个月前,我写了这个公众号的第一篇文章。主题是字节跳动的火山引擎原动力大会,剖析了字节跳动的AI布局。紧接着的第二篇是OpenAI与ByteDance的对比。当时,我把OpenAI比作一个科学家,始终以引领模型能力为核心目标;把字节跳动比作一个商人,更追求AI在具体应用上的落地。过去的五个月,AI领域新闻不断。在模型端,既有OpenAI、Anthropic、Google等头部公司持续推出新版本模型…- 6

- 0

-

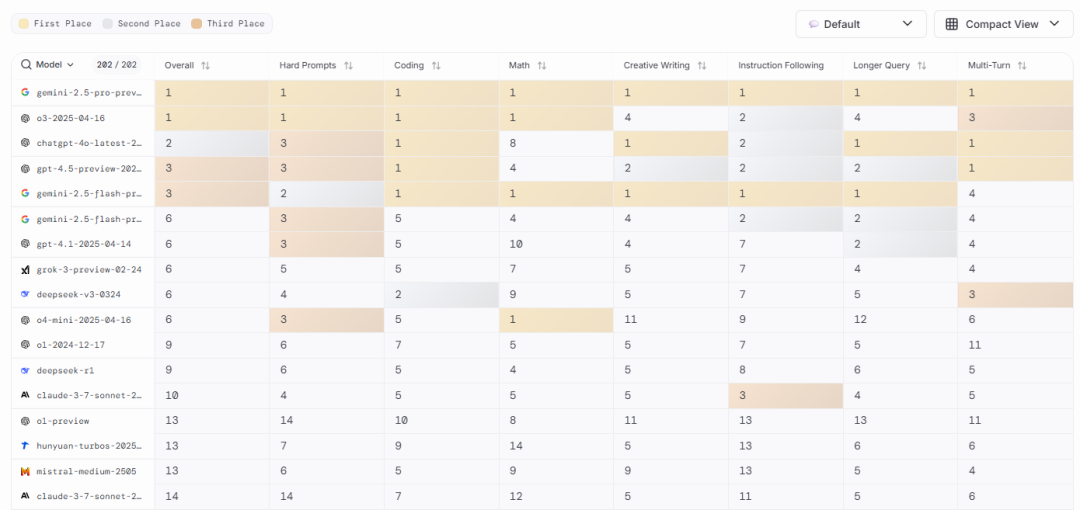

市面上那么多大模型,我们到底该如何选择?(1)

这篇内容只想解决一个问题:现在市面上那么多大模型,在我们的工作场景中该如何选择? 这里分享一个 OpenRouter 的大模型排行榜: https://openrouter.ai/rankings AI爱好者对 OpenRouter 一定都不陌生,它是一个AI大模型聚合平台,汇集了来自OpenAI、Anthropic、Google、DeepSeek等众多厂商的顶尖大模型。 它的排行榜是以每个模型的…- 7

- 0

-

AI 重塑软件工程:穿越中间时代的迷雾,洞见实践的真正革命

自生成式 AI 的浪潮席卷全球,软件工程领域正经历着一场前所未有的范式转移。然而,在这场变革的初期,我们正处于“AI 的中间时代”——一个充满了巨大期望与现实落差的迷惘阶段。许多企业在 AI 上投入了大量资金,但并没有获得期望的收益。这背后揭示了一系列深刻的挑战,需要我们冷静审视。我们必须清醒地认识到几个关键点:AI 中间时代的投资困境:许多组织发现,尽管在AI上投入巨大——包括高昂的算力、模型训…- 6

- 0

-

DeepSeek 赋能纪检监察文字工作:从文书规范到执纪办案的智能写作体系

在全面从严治党向纵深发展的背景下,纪检监察文字材料作为执纪执法的重要载体,其专业性、准确性和规范性要求日益提升。DeepSeek 人工智能技术的引入,为纪检监察系统文字工作者带来了从 "手工撰写" 到 "智能创作" 的革命性突破。本文紧密结合纪检监察工作实际,系统构建适用于监督检查、审查调查、案件审理、综合文稿等全场景的智能写作体系,提炼符合纪检监察文书规范…- 5

- 0

-

不负责任预测一下 AI 大模型(LLM)的未来

一,先来看Gary Marcus在2024年3月11日的预测:到了14个月之后的今天,我逐条分析点评一下:7-10个GPT-4水平的模型预测对了。Google王者归来,Gemini全家桶超越对手。OpenAI 仍然很稳,营收飞增。Anthropic在编程上一骑绝尘, X放出了一个幻觉严重的Grok, Meta掉队在Llama 4丢脸到团队崩盘,中国基本只剩3家 DeepSeek、qwen、豆包,法…- 5

- 0

-

ChatGPT 为什么越来越“懂你”?一文解析它背后的记忆机制

作者 | Eric Hayes编译 | 梦依丹出品丨AI 科技大本营(ID:rgznai100)今年 4 月,OpenAI 对 ChatGPT 的记忆系统进行了重磅升级:它可以参考用户的全部过往对话来提供更个性化的响应。ChatGPT 不再是那个每次都从零开始、记忆如风的“临时陪聊者”,而正在变成一个真正能“记住你是谁、理解你喜好、回忆你曾说过什么”的“长期陪伴者”。 软件工程师 Eric Hay…- 5

- 0

-

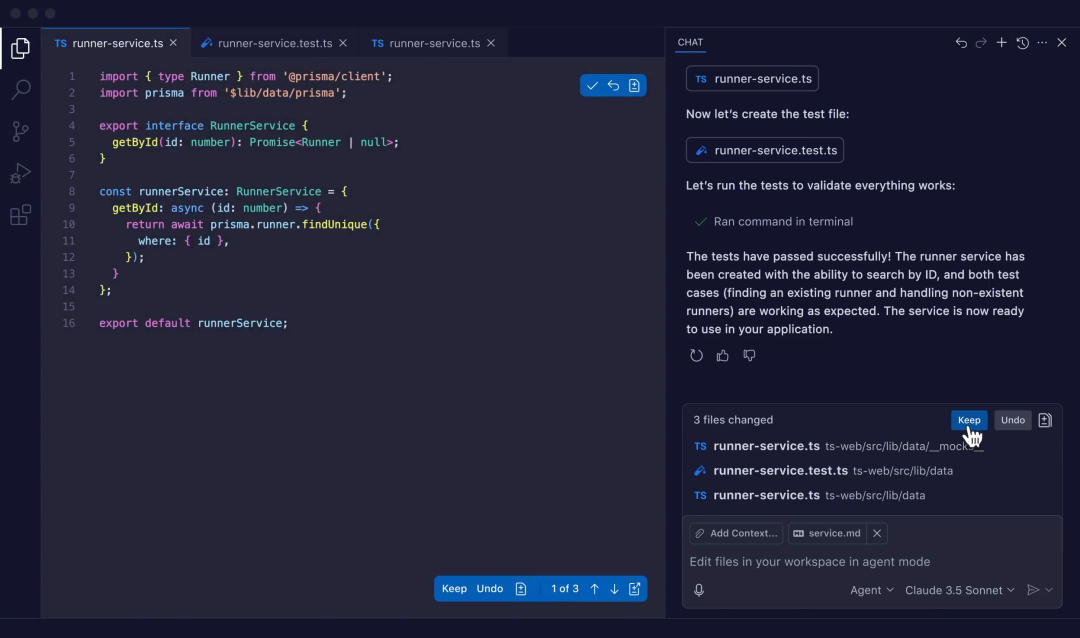

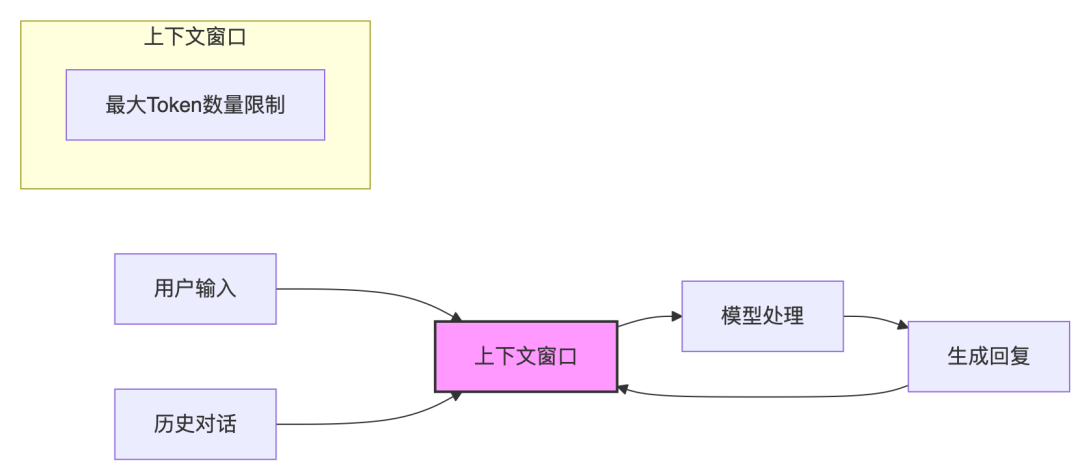

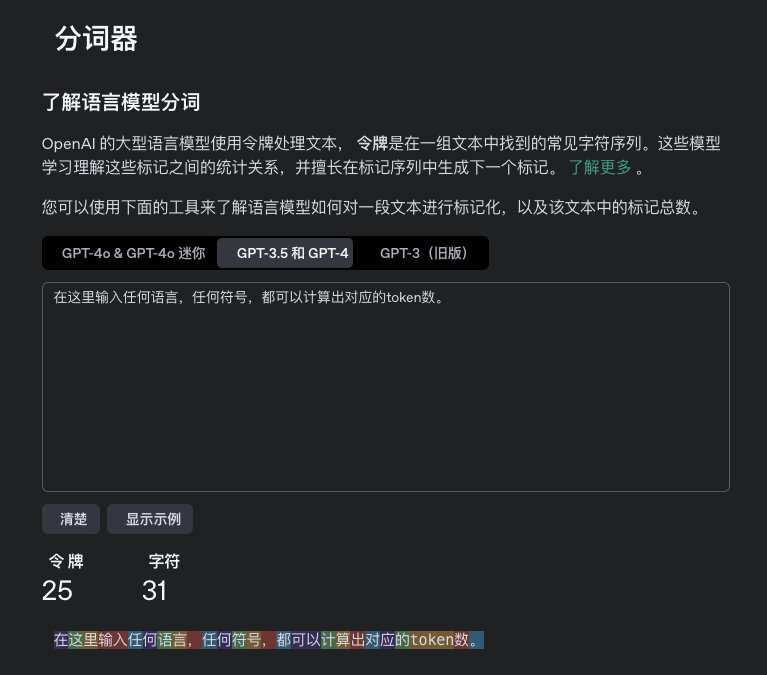

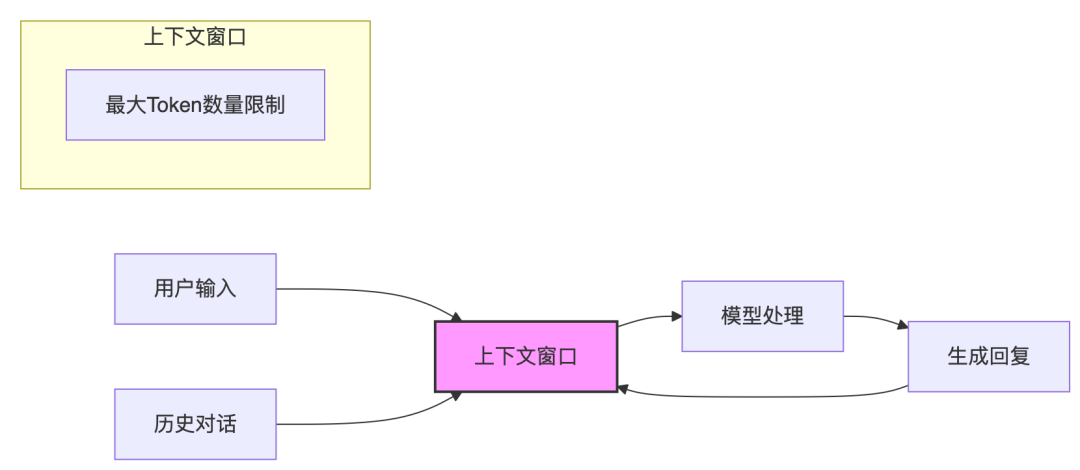

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 12

- 0

-

大神卡帕西这么用ChatGPT:日常4o快又稳,烧脑切o3做后盾,o4只当备胎用

衡宇 发自 凹非寺量子位 | 公众号 QbitAI OpenAI模型命名混乱没规律,以至于打开ChatGPT后,好多人都不知道到底该用哪个模型来完成任务。 不过别慌,现在咱们有救了! 刚刚,大神卡帕西在?上发布了一篇使用ChatGPT时的模型选择指南。 简明扼要,一看就懂——再也不用迷茫了,再也不用在各个模型之间反复横跳试探了。 先简单回顾一下前情提要: 一直以来,OpenAI对自家模型的命名都很…- 8

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!