-

这一夜,中国AI彻底翻身了:DeepSeek R1让全世界刮目相看 | 深度评测

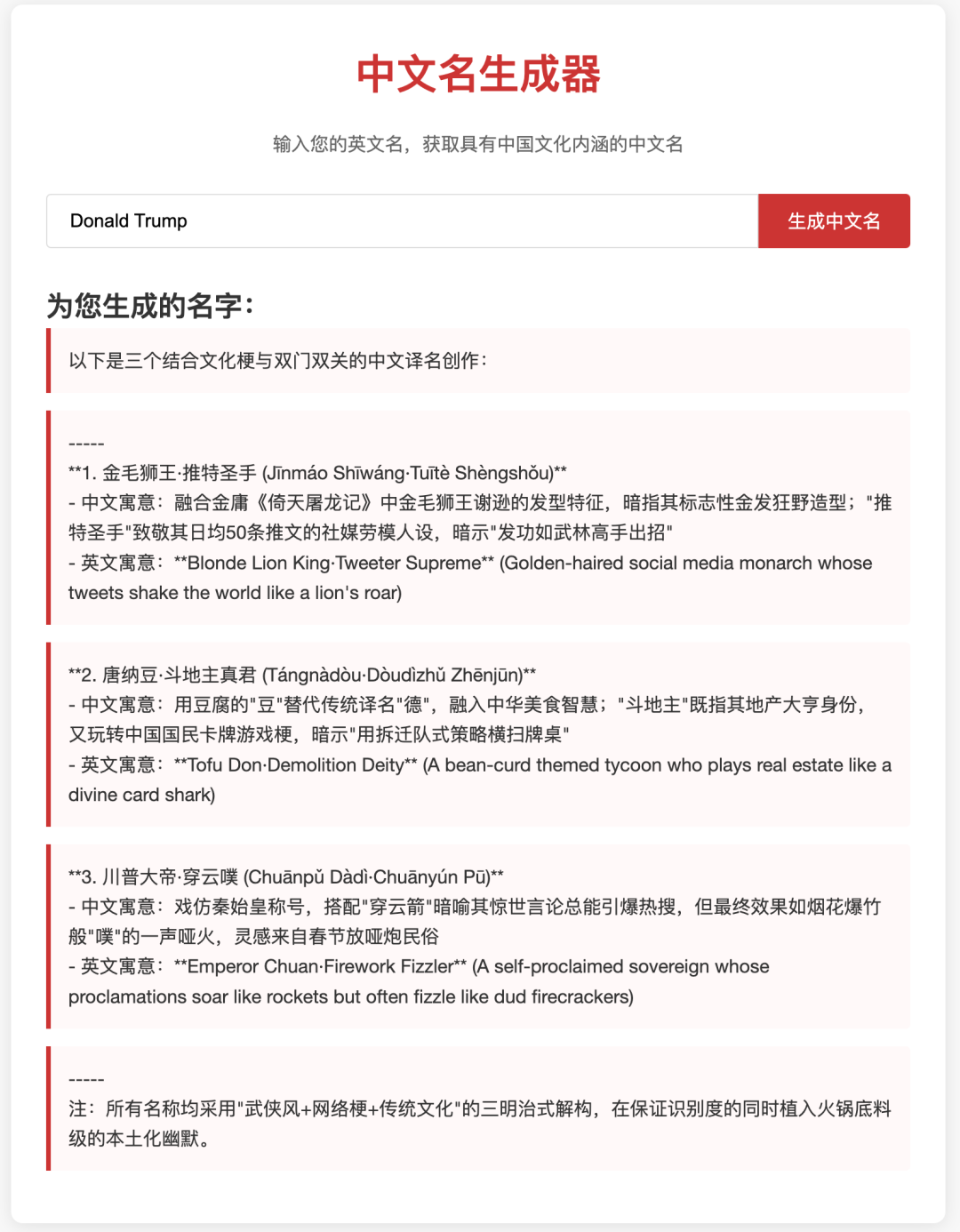

这一张图,改变了中国的历史!经过黄叔深度的测试,新DeepSeek R1在代码生成上>Claude 3.7,前端审美能力和Claude 4有来有回。说句不夸张的话,这可能真的要改变中国AI发展的历史轨迹了!我们先说代码层面,再说前端审美层面,最后聊聊为何改变中国的历史。01 代码生成能力:一次成功,完胜Claude 3.7先说代码层面的表现。熟悉我的朋友都知道,黄叔之前写过一本AI编程蓝皮书…- 4

- 0

-

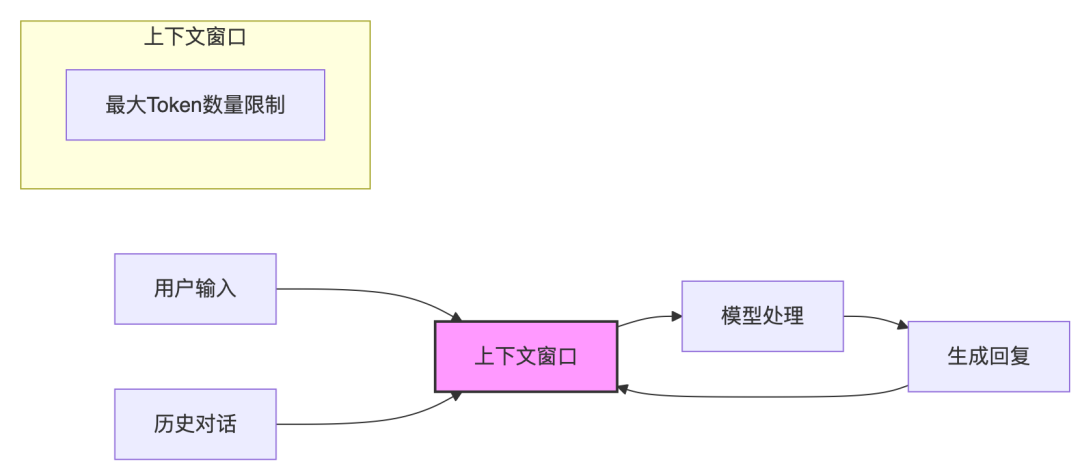

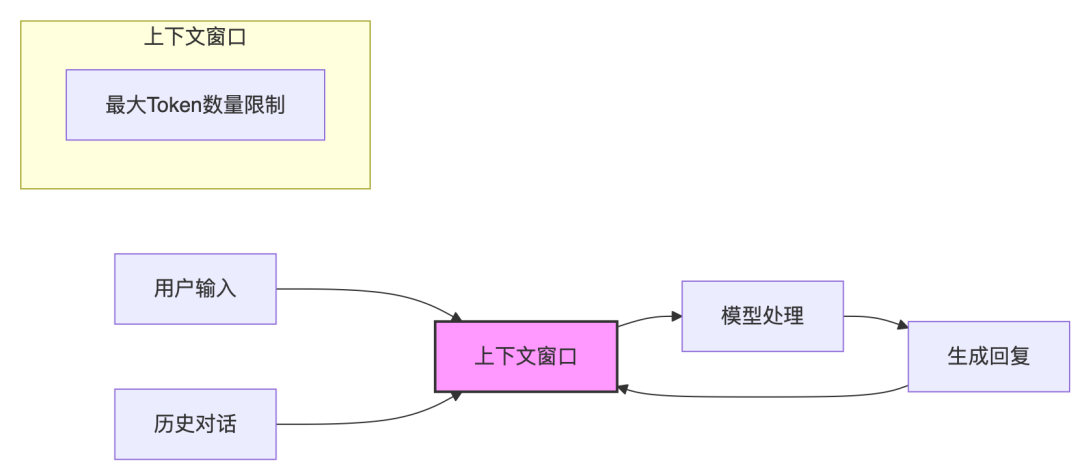

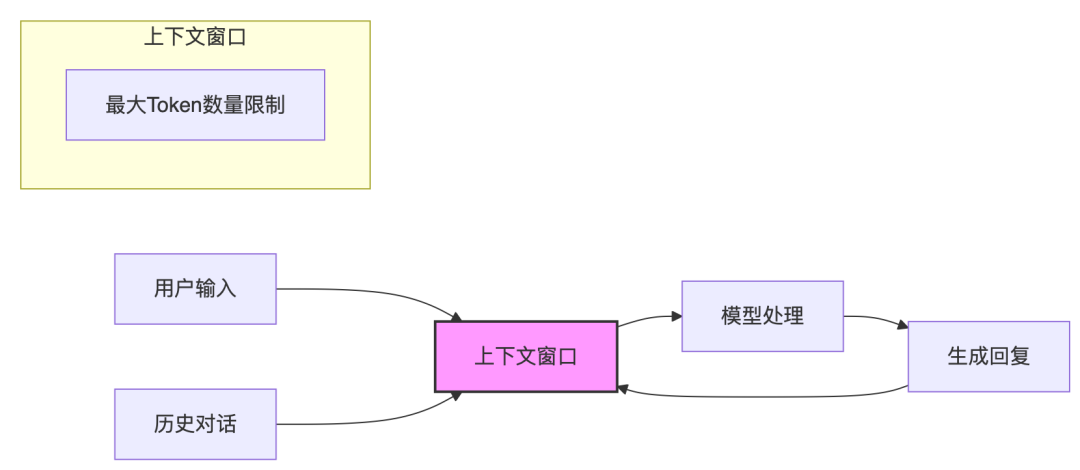

🧠 解码大语言模型的记忆力:上下文长度的前世今生

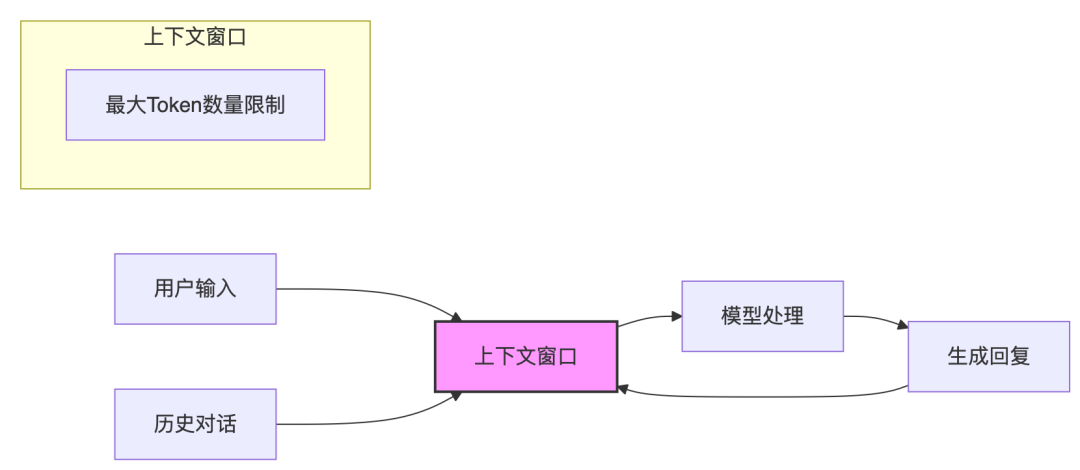

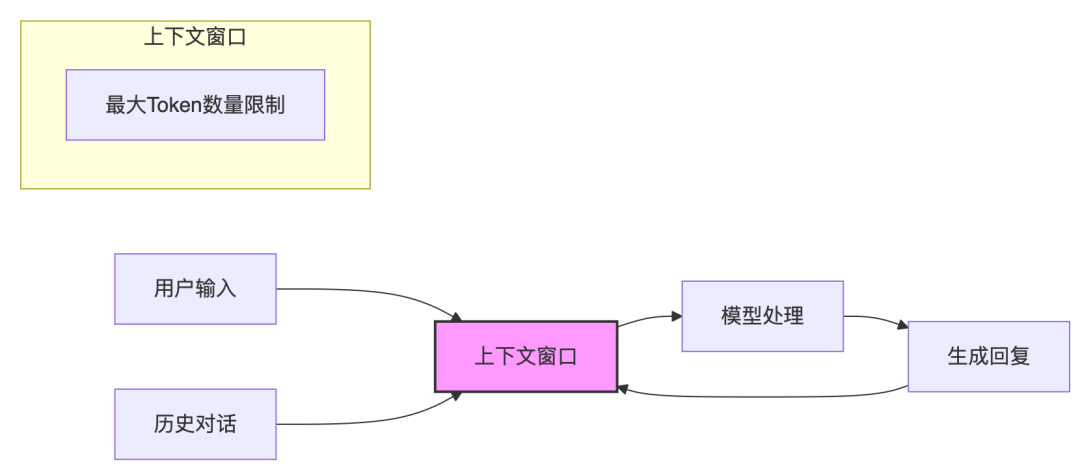

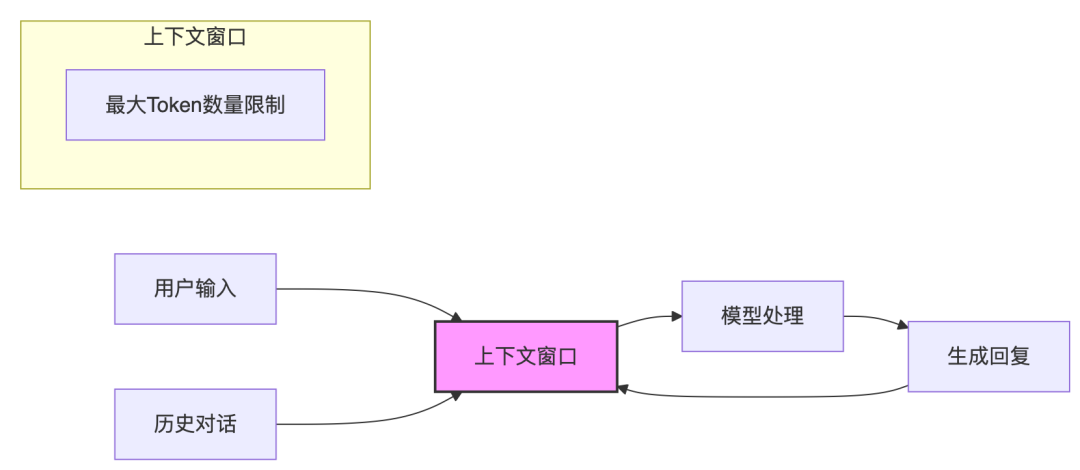

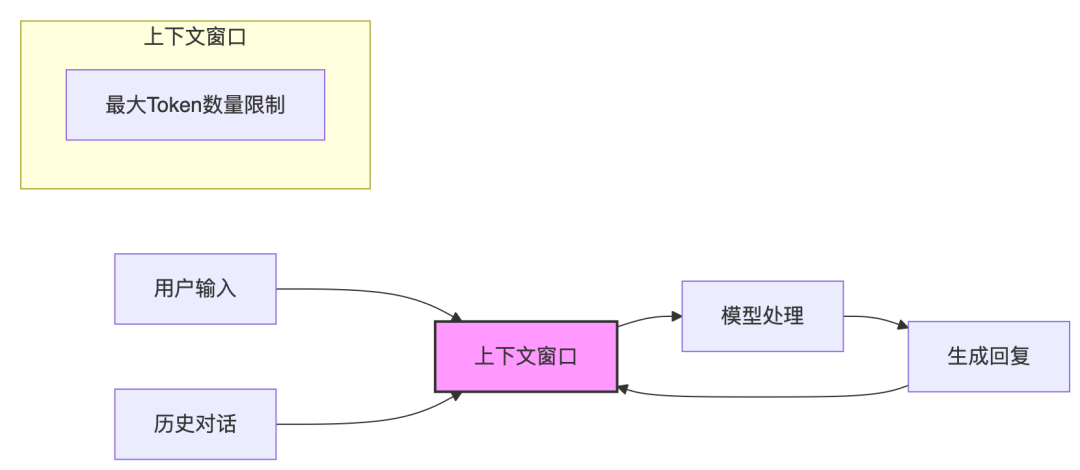

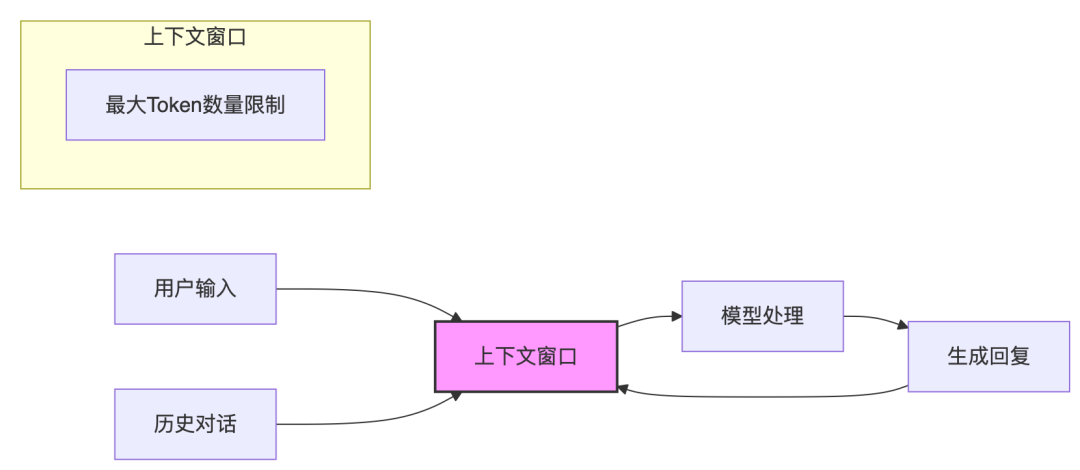

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

我用扣子空间做出超拟人播客Agent,有意思比有意义更有意义

这期强烈建议戴上耳机 上面两篇播客是只基于我写的 claude4 文章,运行几分钟后生成的AI播客,猜猜哪个是NotebookLM,哪个是扣子空间? 作为一个(曾经的)播客爱好者,毕竟现在一个月只听十几小时了,大大小小订阅了50多个优秀的播客,但今天收到四月回顾的时候,发现我主动收藏的播客几乎不会听了。。。 因为长期追踪一线的AI消息,很多时候播客里的信息对我来说是已经重复了。我的日常行为提醒我,…- 7

- 0

-

闭源Prompt的一些特点分析

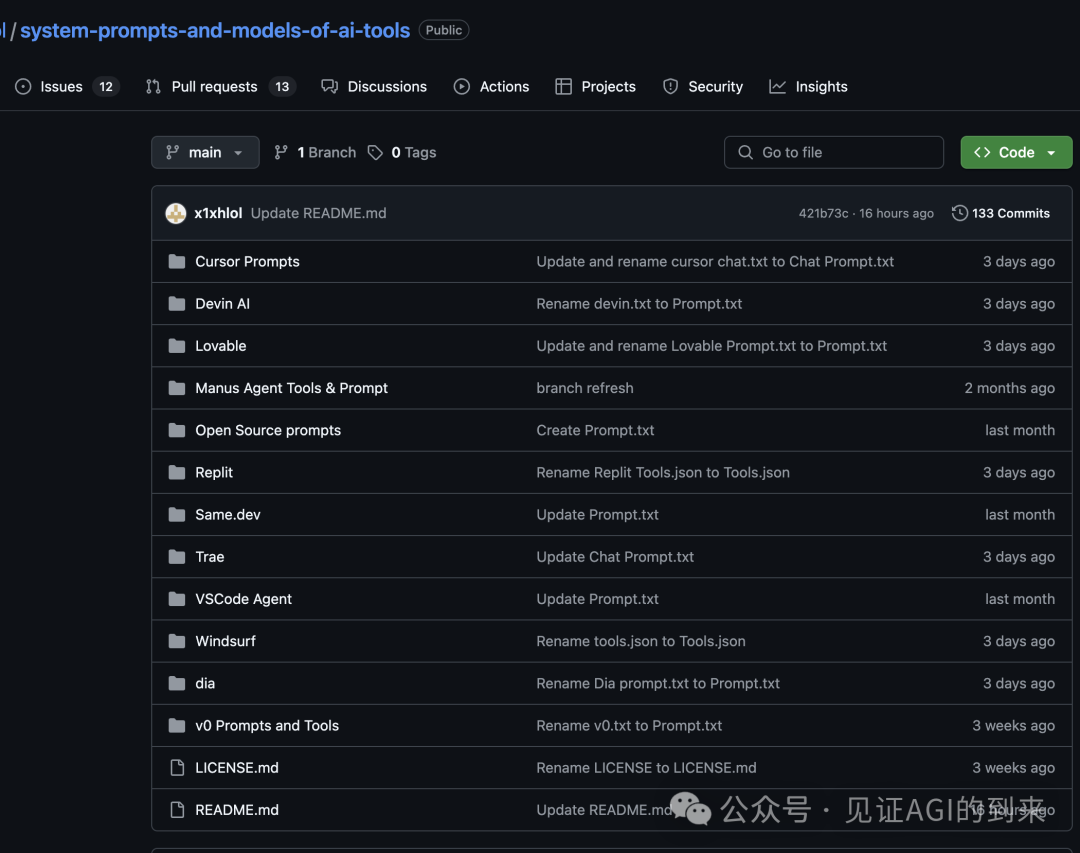

先说结果:闭源Prompt的一些特点分析 这里分析了一些“泄漏”的闭源公司的system prompt,来感悟一下专业prompt的特点。 闭源Prompts对比 特征维度 Anthropic Claude 3.7 Sonnet (通用助手) Cursor IDE Agent (Claude Sonnet 3.7 - 编码助手) Lovable (AI Web 应用编辑器 - React) Man…- 9

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

Context才是AI Native时代的船只

本文约 1200字,首发于公众号 左右机场。最近与不少所谓 AI Native 的产品打交道,最大的感受是:模型越来越强,但真正把体验拉开的,往往不是参数量,而是谁能挖掘到用户头脑里的那一份 Context。一、海平面在涨,别忙着盖“高塔”底层大模型的能力像海水,一天比一天高。今天你用 prompt-hack (或者复杂workflow)造了个“塔”,明天模型原生的功能就把水位抬过塔尖。搜索 是最…- 5

- 0

-

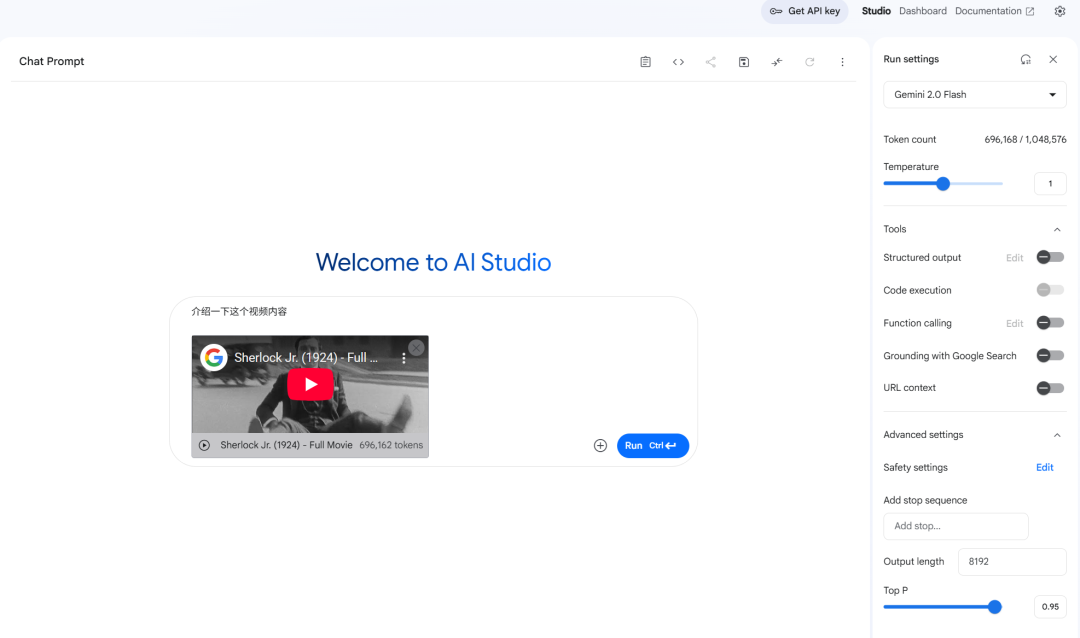

谷歌AI Studio 10分钟开发网页应用,真正的所想所见所得的Vibe Coding!

哈喽,Everybody, I'm 九歌~一个智能体空想家。 今年的新词特别多,AI编程这个叫法都out了,时髦的说法是vibe coding(氛围编程)。 最近上手体验了google aistudio 新上线的build app 功能,不能说十分惊艳,那是相当得惊艳,真正我能想象出的所想所见即所得的编程方式,特别是对我这种靠嘴吃饭,需要设计产品原型的非程序开发人员来说。 Google …- 9

- 0

-

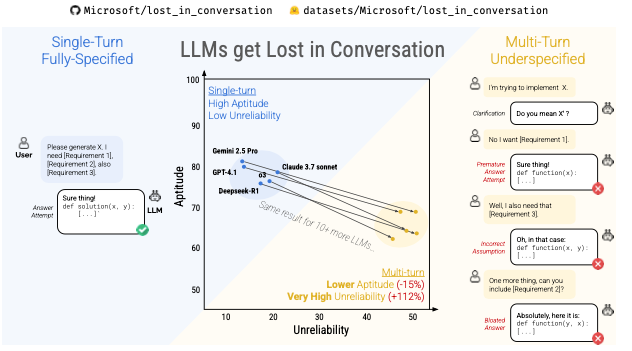

大模型应该怎么用?我们大多数人都错了,微软最新研究:大模型对话次数越多,性能越差

春节在家,恰逢DeepSeek 爆火,村里的小伙伴知道我是搞互联网的,纷纷询问,大模型是个啥,咋用啊。我说你可以把它当成一个知识渊博的小伙伴,有啥问题直接问它就好,如果得不到答案,那就多问几次…甚至后来,我还总结了一套与大模型交流的方法,无论是结构化提示词,还是各种条件设定,其中很重要的一条是,要想更准确,必须要循序渐进,与大模型多轮对话…我把这套方法奉为圭臬,在各种场合,甚为得意的与他人分享,俨…- 5

- 0

-

一文讲透程序编排的核心方式:从表达式语言到并行化实践

阿里妹导读高德的poi数据来源多种多样,处理流程也多种多样,但因流程相对固定,因此使用了流程化配置简化开发,使用表达式语言保证灵活性。为了加深对平台的理解,并帮助大家对编排有一定的了解,本文会以影响范围的视角去总结当前编排的方案。引言在构建复杂的数据处理系统或任务调度平台时,如何将业务逻辑高效、灵活地表达出来,并以可扩展的方式进行执行,是许多工程师和架构师面临的核心挑战之一。本文从“程序编排”的角…- 6

- 0

-

AG-UI:Agent用户交互协议

本文作者系360奇舞团前端开发工程师随着多智能体系统(Multi-Agent Systems)和大语言模型(LLMs)技术的飞速发展,AI Agent 的工作能力越来越强。然而,在落地到真实应用中时,我们却发现一项关键能力仍旧缺失——如何让智能体与用户进行顺畅、高效的交互?CopilotKit 团队提出的 AG-UI 协议(Agent-User Interaction Protocol),正是为此…- 12

- 0

-

快速理解热门LLM大语言模型

作者:masonpy 本文尽量用最简单的方式, 帮读者理解 LLM, Transformer, Prompt, Function calling, MCP, Agent, A2A 等这些基本概念. 表述时不追求绝对准确, 尽量通俗易懂. 部分内容有个人理解的成份, 内容难免疏漏, 欢迎指正. 注意:本文需要你有基本的代码阅读能力. 当然非开发阅读也不会很困难. 一. LLM (大语言模型) 本质…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

具身智能需要从ImageNet做起吗?

导读 如果你的野心在智能,无论你做具身智能、大模型、世界模型,又或者是神经科学,也许都一样的。想认真地聊聊具身智能,文中会概述具身智能的发展线条,以及近期对”智能“的一些感想,但其中的判断、猜测很多缺乏实据,特别欢迎指出问题和讨论。关心具身智能技术问题的朋友可以看前一半,而更关心智能的朋友可以看最后的“具身智能之上”的部分。为什么突然具身智能开始爆发:Move bits, not ato…- 6

- 0

-

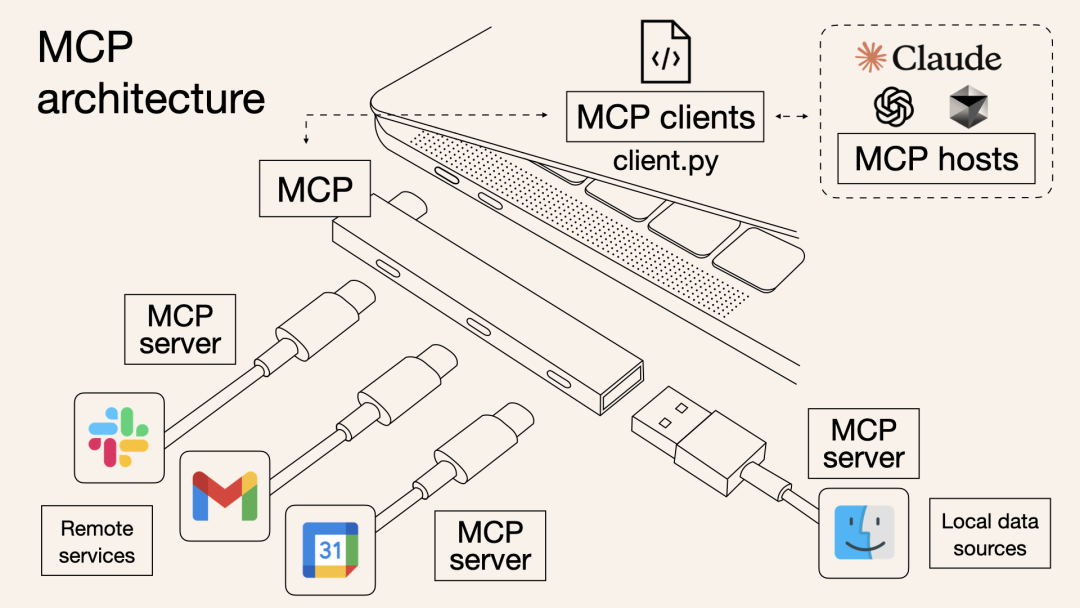

货拉拉MCP(Model Context Protocol)初体验

1. MCP(Model Context Protocol)是什么 模型上下文协议是一种开放标准,可让开发人员在其数据源和 AI 驱动的工具之间建立安全的双向连接。该架构非常简单:开发人员可以通过 MCP 服务器公开其数据,也可以构建连接到这些服务器的 AI 应用程序(MCP 客户端)。https://www.anthropic.com/news/model-context-protocol 以上…- 6

- 0

-

AI不是万能药:技术浪潮下的冷思考

在深入AI自身的问题前,先回顾近年经历的技术浪潮。区块链和元宇宙曾一度被视为革命性概念,引发全民追捧,仿佛能够颠覆传统行业。然而最终我们看到,二者的落地都受限于关键技术瓶颈,并未真正取代原有系统。以区块链为例,它确实在可编程交易闭环(如比特币、DeFi、稳定币)中创造了深远价值。但那些无法独立构建闭环的场景,如供应链溯源、防伪追踪、NFT、数字藏品等,区块链往往只是“不可更改数据库”的替代品,而非…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

这篇AI Agent漫游指南,带你建立全面的科技史观

作者:kong 以OpenAI o1与DeepSeek R1为代表的"类Agent"模型、OpenAI DeepResearch为代表的“真Agent”模型,正在重构AI Agent的技术范式。Agentic Workflow的王座还没坐热,强化学习驱动的端到端Agent模型训练已呼啸而来。未来趋势已指明:模型即产品,工程化Agent的命运将如何?一起来洞察全新的Agent技术…- 11

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

50+ 企业联合支持,Google A2A 协议引领 AI Agent(智能体)互操作新标准

最近(2025-04-10),Google 发布了一个叫 A2A(Agent to Agent Protocol)的东西,听起来很高大上,但其实它解决的是个超级接地气的问题:怎么让不同的 AI Agent(智能体)互相协作。 A2A 开源协议地址:https://github.com/google/A2A 为什么 Agent 之间需要"聊天"? 想象一下这个场景:你用手机上的智…- 6

- 0

-

盘点 Azure AI Foundry 的10大重要更新

2025年被广泛视为 “AI 智能体元年”。微软在过去半年密集发布众多创新技术,构建起从基础设施层、开发工具层到场景应用层的完整技术矩阵,加速推动诸多具备自主决策能力的 “超级助理” 智能体落地,形成完整的 AI 赋能生态,在丰富员工体验、重塑客户参与、优化业务流程、推动创新曲线等四个方面帮助企业全面进行 AI 转型。 在刚刚结束的 Microsoft Build 2025微软开发者大会上,微软发…- 7

- 0

-

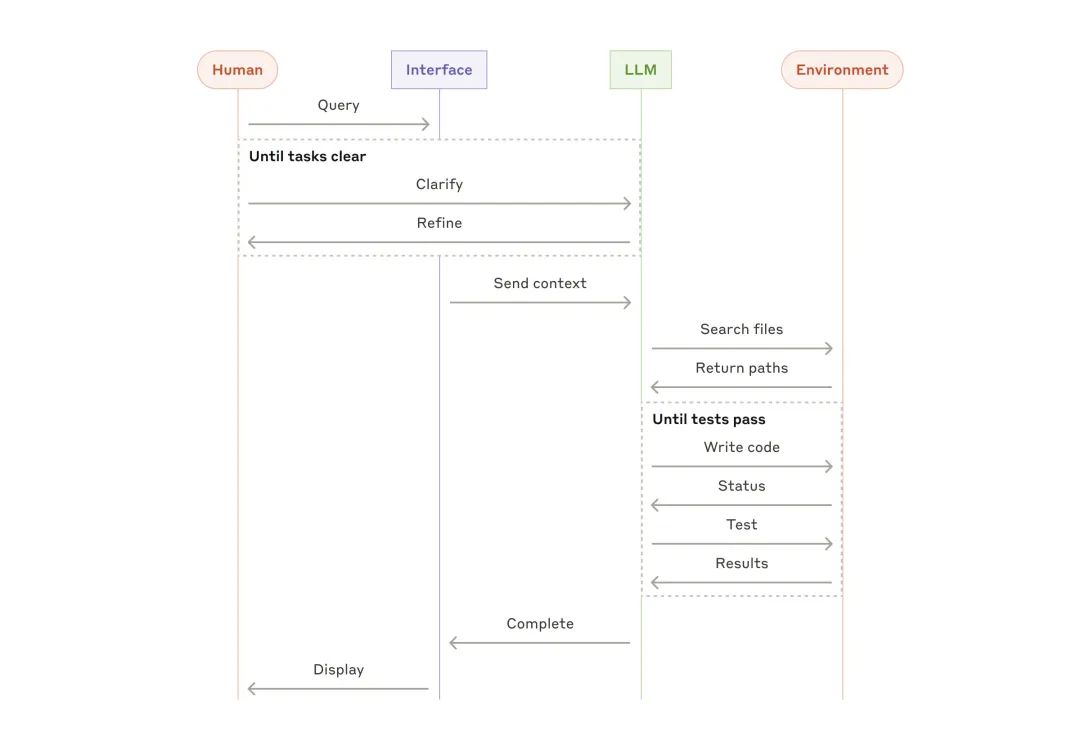

如何构建高效的智能体:Anthropic 官方建议与实用指南

Anthropic 官方发布了一篇《如何构建高效的智能体》。 这篇文章干货满满,非常值得一读。 文章总结了他们和众多跨行业客户合作的经验。分享了他们开发智能体的经验教训和实用建议。 实践证明:真正成功的应用,往往采用简单、可组合的模式,而非复杂的框架。 还总结了 3 大核心原则,以及 6 种常见模式。 以下是我根据原文整理的核心要点。 Agent 和 Workflow 的区别 Agent 和 Wo…- 10

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!