-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

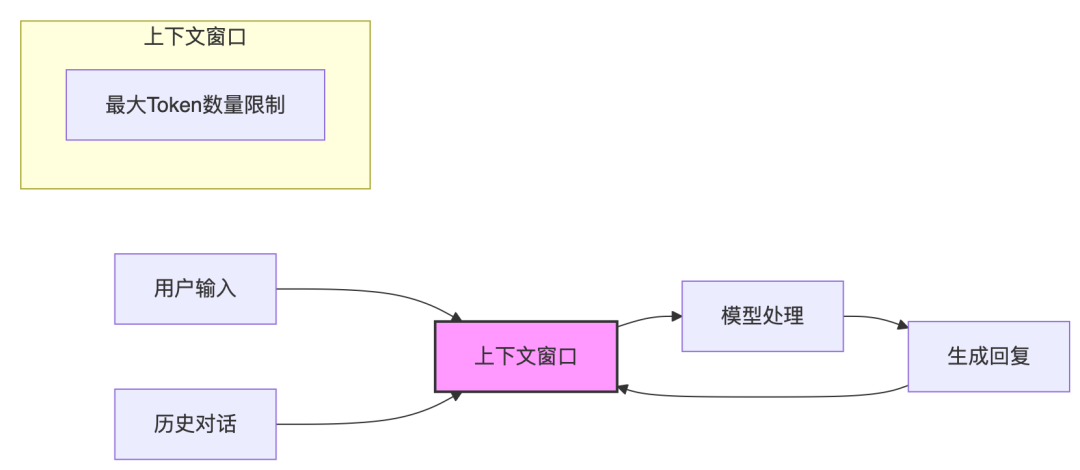

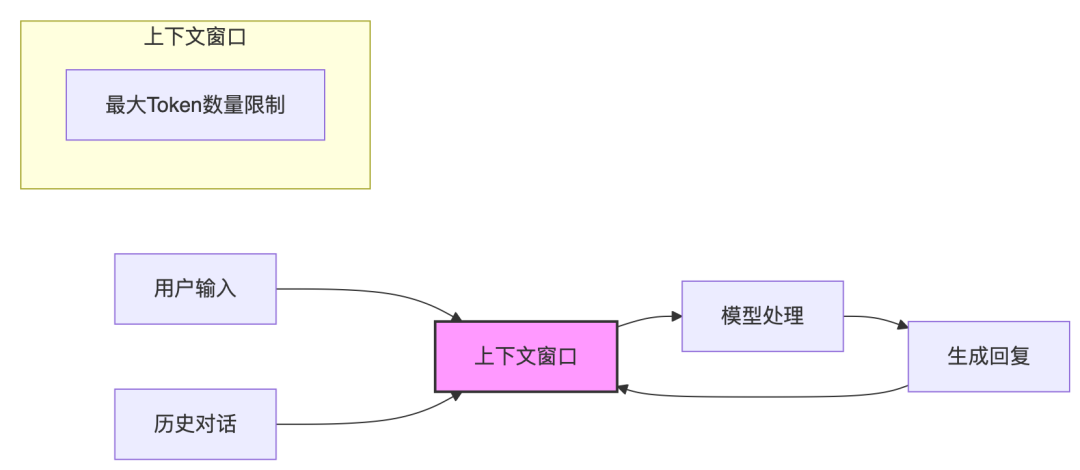

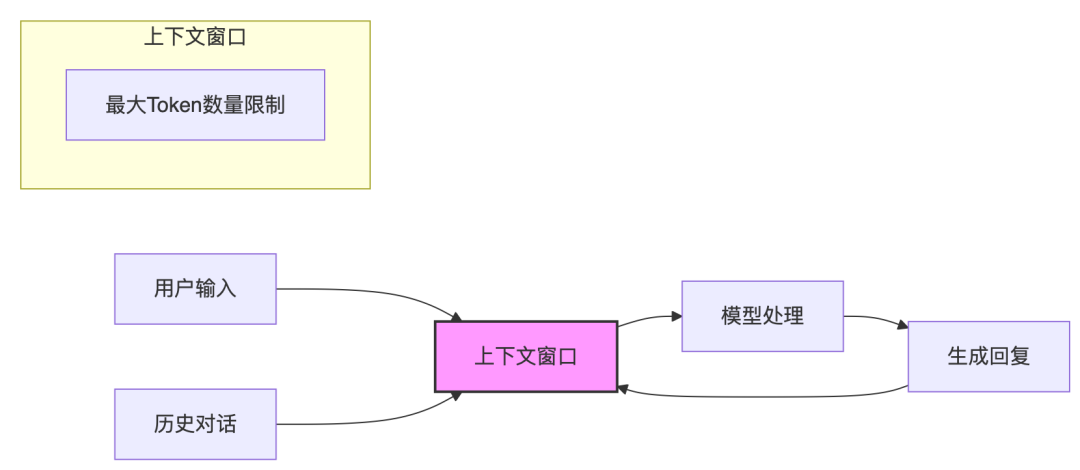

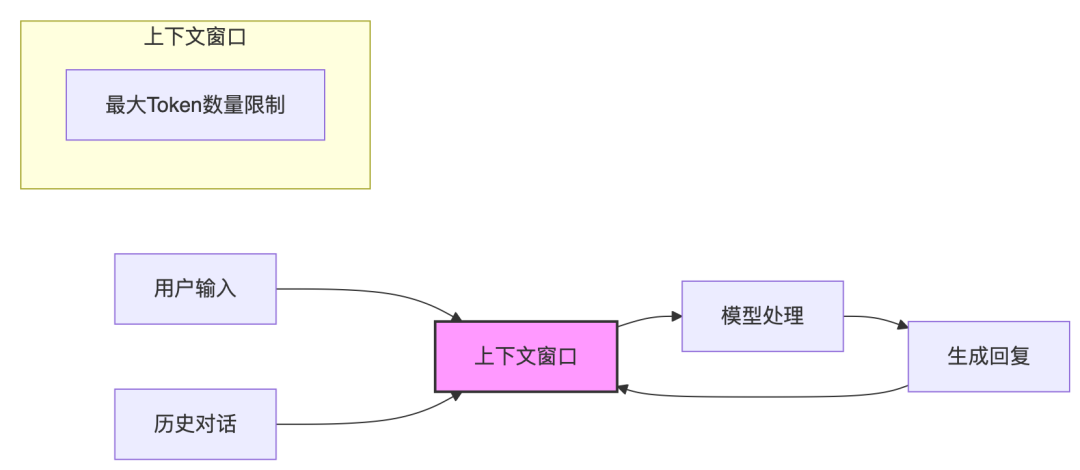

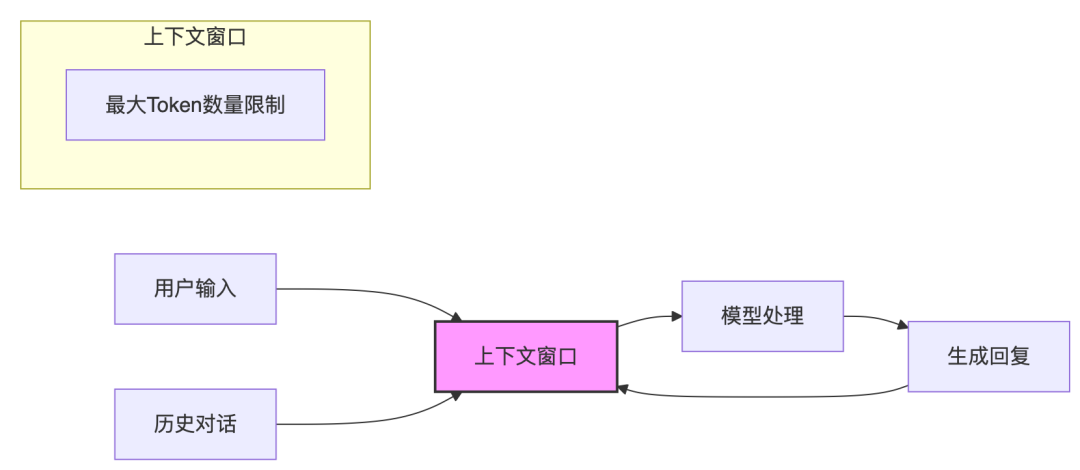

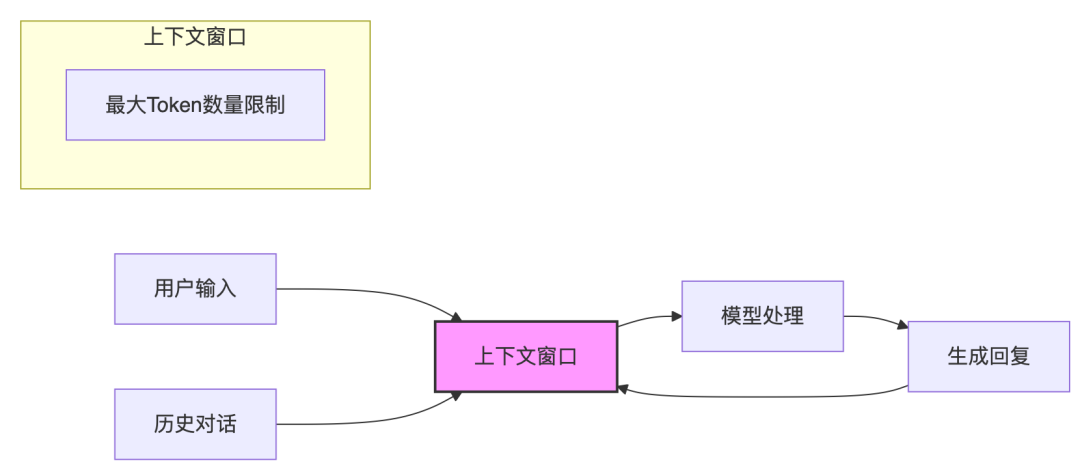

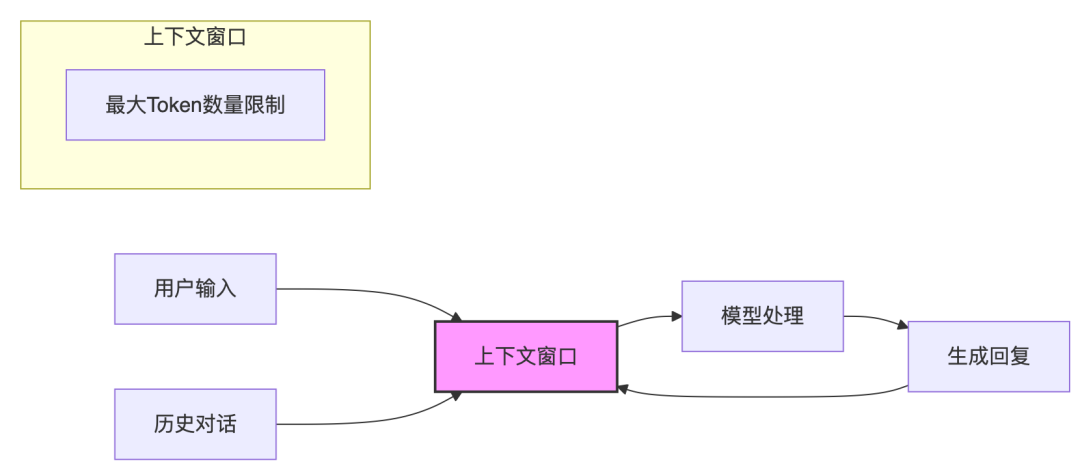

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 22

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

LLM 协作革命:Group Think 如何重塑推理边界 (万字)

点击??可关注,文章来自?♂️ 想加入社群的朋友,可看文末方法,进群交流。 “ 让一个模型拥有多个“智慧大脑”会有多强大?Group Think 现在让单个 LLM 模拟多个并行推理智能体,推理速度提升数倍,资源利用效率更是碾压传统方法!” 大家好,我是肆〇柒。今天和大家聊聊 Group Think。顾名思义,它通过让单个 LLM 模拟多个并行推理智能体,并以 token 级别的细粒度协作,提出…- 4

- 0

-

AI服务架构的范式跃迁:从“模型即服务”到“Agent即服务”

当今数字化时代,人工智能(AI)技术的迅猛发展正在深刻改变着人们的生活和工作方式。从简单的自动化任务处理到复杂的智能决策支持,AI应用场景不断拓展,其服务架构也在经历着前所未有的变革。近年来,“模型即服务”(Model as a Service,MaaS)作为一种创新服务模式,为AI技术的广泛应用奠定了坚实基础。然而,随着技术的不断创新迭代以及市场的多元化和个性化需求迸发,AI服务架构正迎来一场深…- 5

- 0

-

微软CPO: AI时代新产品的成功要素

Aparna Chennapragada 是 Microsoft 的体验和设备首席产品官,负责监督其生产力工具和代理工作的 AI 产品战略。此前,她是 Robinhood 的 CPO,在 Google 工作了 12 年,并且还是 eBay 和 Capital One 的董事会成员。此外,Aparna 业余还说脱口秀,经常去演开放麦。 Some takeaways1. 企业级 AI 需要 two-p…- 5

- 0

-

直播回顾 | 不再“纸上谈兵”,大模型能力如何转化为实际业务价值

作者 | AICon 全球人工智能开发与应用大会 策划 | 李忠良 编辑 | 宇琪 随着技术的快速发展,大模型在各行业的应用潜力日益凸显,但如何将大模型能力高效转化为实际业务价值,仍是企业面临的核心挑战。 近日 InfoQ《极客有约》X AICon 直播栏目特别邀请了 华为云 AI 应用首席架构师郑岩 担任主持人,和 蚂蚁集团高级技术专家杨浩、明略科技高级技术总监吴昊宇 一起,在 AICon全球人…- 5

- 0

-

OpenAI放大招!核心API支持MCP,一夜改变智能体开发

今天凌晨,OpenAI全资收购io的消息占据了大部分头条。同时OpenAI也“悄悄地”放出了另外一个重磅消息,用于开发智能体的核心API——Responses API支持MCP服务。 传统方法,我们在开发智能体需要通过函数调用与外部服务交互,每次操作都涉及从大模型到后端再到外部服务的网络传输,导致多次跳转、延迟会很高,并增加扩展和管理的复杂性。 现在Responses API支持了MCP,开发者无…- 10

- 0

-

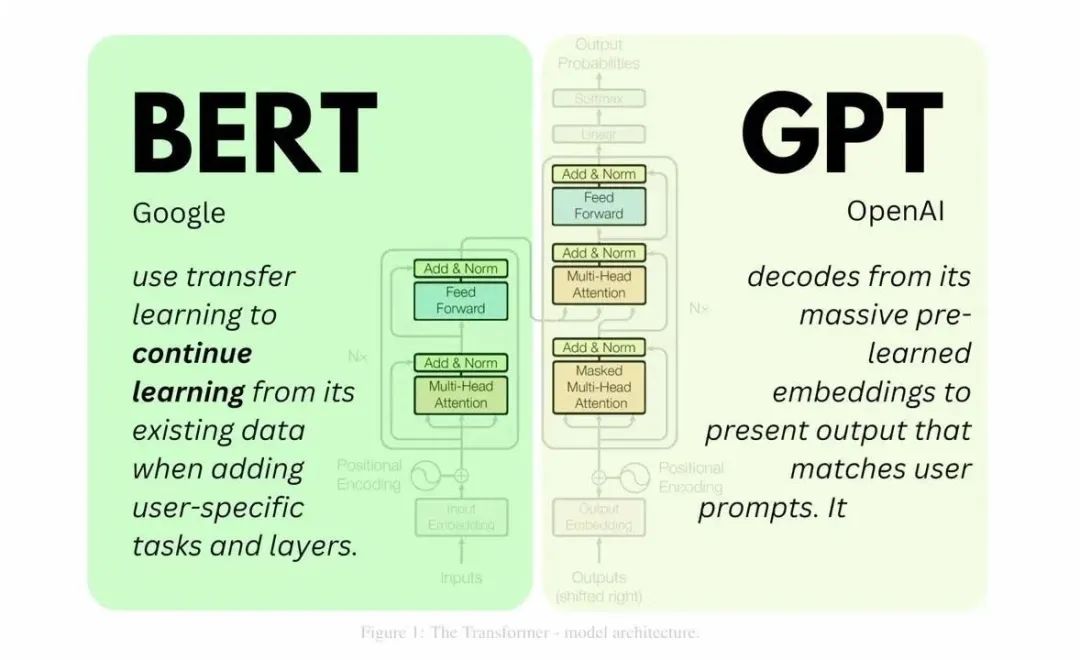

一文搞懂大模型的分词器(Tokenizer)

今天来聊一聊BERT和GPT的分词器,了解大模型的第一步:Tokenizer。Tokenizer(分词器)是大语言模型(如BERT和GPT)预处理文本的核心组件,其作用是将原始文本拆解为子词、单词或字符,同时保留语义和结构信息。一、BERT(WordPiece)BERT的Tokenizer:基于WordPiece的子词分词一、分词工作原理:BERT使用WordPiece算法生成子词(subword…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

用AI重做一切?花两千给Google I/O 更新们去去水分

这合理吗?(熬夜破防版) 今天凌晨更新的 Google 掏出了一大堆好东西, 但是在 CEO 皮查伊精准的刀法下, 分为了free($0)、pro($19.99)、ultra($249.99) 三档的订阅套餐,看了一早上各种盘点,想要试试带原生音效的 AI 视频模型 Veo3,结果要先充1800, 大大小小23+个更新,体验入口、形式都不一致,这我能忍?OpenAI Pro 都不能让我每个月准时充…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

Gemini Diffusion:1500 token/秒,快如闪电!

谷歌推出革命性文本扩散技术! 你可能没注意的是,Google DeepMind 在 I/O 2025 上发布了一个重磅实验性模型——Gemini Diffusion! 一个将扩散(diffusion)技术用于文本生成的全新尝试! 这或许是一个意义重大的技术突破。 扩散模型在图像生成领域已经证明了其强大的能力(如 Stable Diffusion、DALL-E),但将其应用于纯文字生成,这算得上是对…- 5

- 0

-

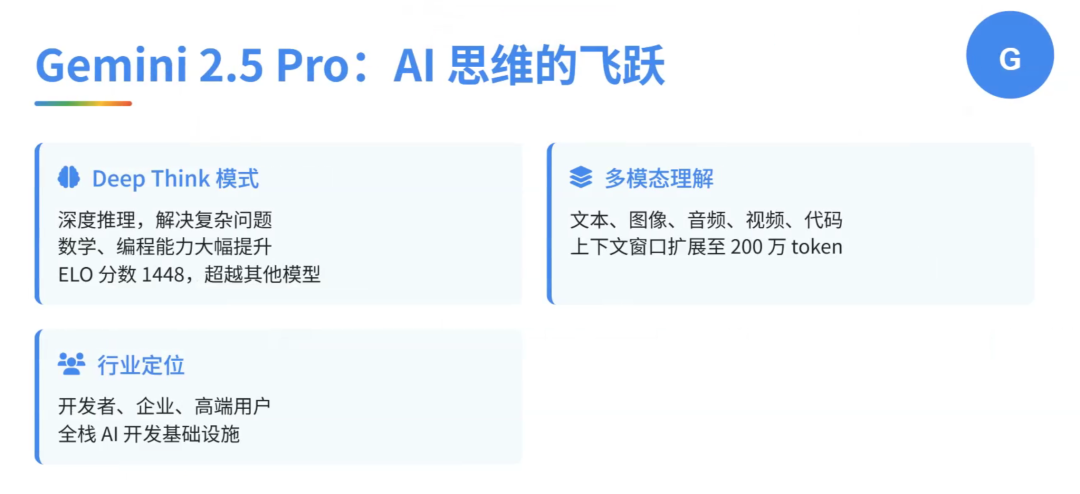

OpenAI最怕的对手来了!Google用「思考预算」重新定义AI生产力

北京时间5月21号凌晨1点,谷歌IO 2025大会准时开场。这次大会的主题聚焦于AI,谷歌携带着其全新的AI技术与产品全面出击。 Gemini 2.5 Pro:超级大脑的升级 此次大会的重头戏是Gemini 2.5 Pro,这不仅仅是简单的升级,而是AI思维的一次大飞跃。它引入了DeepSeek模式,专门处理需要深度思考的复杂问题,如复杂的数学题、编程难题等,准确率高达84%。在LMA Rena测…- 4

- 0

-

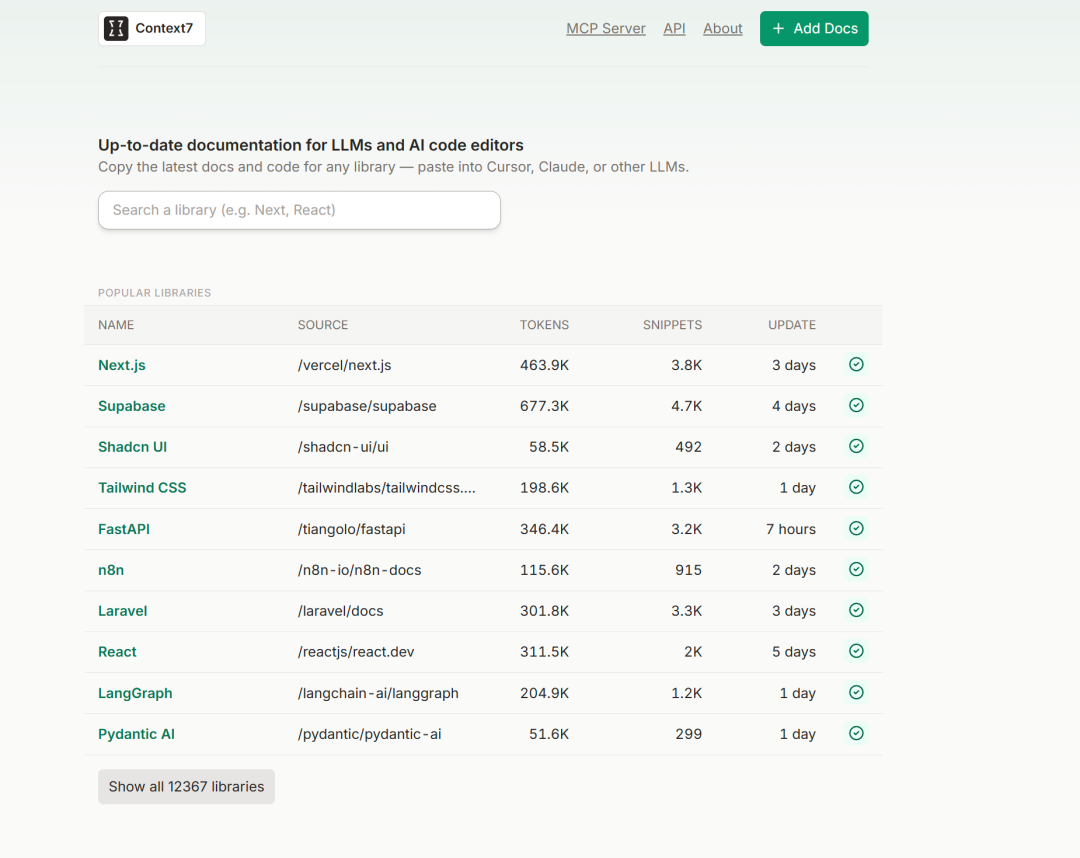

告别过时信息,拥抱精准洞察!Refly 灰度版集成 Context7,革新你的AI知识交互体验!

告别过时信息,拥抱精准洞察!Refly 灰度版集成 Context7,革新你的AI知识交互体验! ? 在这个信息爆炸且飞速迭代的时代,我们每个人都在与日俱增的知识和数据洪流中奋力航行。无论是开发者在浩如烟海的技术文档中求索,研究员在错综复杂的文献中挖掘真知,还是内容创作者在纷繁芜杂的素材中寻找灵感,一个共同的痛点日益尖锐且普遍:我们赖以思考、决策和创造的信息,是否足够准确、新鲜且易于获取? 大…- 8

- 0

-

中厂的AI宿命,快手们不信AGI

作者丨kiki 编辑 | 山核桃 美编丨渔夫 2022年7月,在一场会议上,快手CEO程一笑问高管:”为什么快手的用户规模是抖音一半,但商业化收入只有它的五分之一”? 在移动互联网时代,程一笑的这一「灵魂之问」某种程度上是中厂们的集体困惑,但在AI时代,似乎风向变了。 进入2025年,挤进了盈利大门的中厂开始频繁对外丢出「AI新牌」,在财报中也讲起漂亮的AI商业化故事。 靠着可灵在视频生成赛道卷出…- 6

- 0

-

Qwen这一步,比发大模型更有意义

文:王智远 | ID:Z201440 前几天,阿里Qwen chat上线了Deep Research”(深入研究),号称能把几个小时的复杂任务压缩到几十分钟完成,免费开放给所有用户。 对我这种经常要搜集领域信息的人来说,很有吸引力,所以,第一时间体验了两天。 打开QwenChat界面,在功能选项里就能找到深度研究入口;官方说,一个智能助理系统,综合大量在线信息来源,能规划复杂的任务。 第一次使用时…- 6

- 0

-

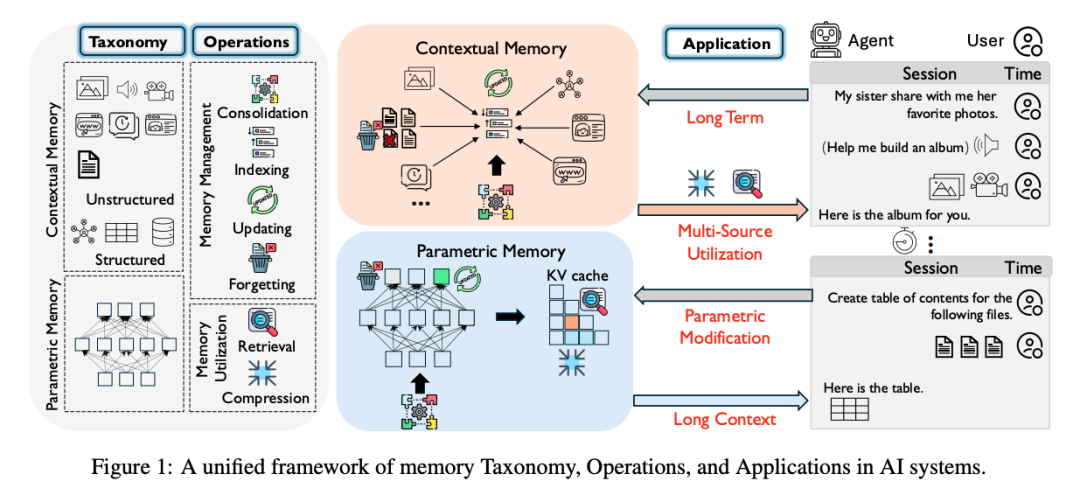

首次全面复盘AI Agents记忆系统:3大类,6种操作!

记忆是AI系统的基本组成部分,尤其是对于基于LLMs的Agents。首次将记忆表示分为三类:参数化记忆、上下文结构化记忆和上下文非结构化记忆,并介绍了六种基本的记忆操作:巩固、更新、索引、遗忘、检索和压缩。盘点了几十种记忆框架、产品、应用!通过将这些操作系统地映射到长期记忆、长上下文记忆、参数修改和多源记忆等最相关的研究主题中,从原子操作和表示类型的视角重新审视记忆系统,为AI中与记忆相关的研究、…- 6

- 0

-

大厂纷纷入局,百度、阿里、字节抢夺Agent话语权

今年大厂们冲刺Agent成了共识,字节扣子“大战”心响、夸克,但Agent还未到“GPT时刻”。 原创ⓒ科技新知 AI新科技组作者丨樱木 编辑丨江篱 2025年5月,红杉资本AI峰会在旧金山落下帷幕,在这场包含Open AI创始人山姆·奥特曼以及谷歌首席科学家Jeff Dean等150位全球顶尖AI公司创始人、科学家以及投资人的大会中,一个共识逐渐被确立下来——即下一轮 AI,卖的不是工具,而…- 4

- 0

-

一文读懂:2025 Google I/O 开发者大会

2025年5月21日,Google I/O开发者大会如期而至,这场备受瞩目的科技盛会再次为全球观众带来了诸多惊喜。从全新的AI模型到创新的产品应用,从视觉生成技术的突破到搜索体验的重塑。Google在本次大会上全方位展示了其在人工智能领域的最新成果与战略布局。一、Google AI Ultra会员:战略布局发力在本次大会上,Google推出了一项重磅举措——249.99美元每月的Google AI…- 6

- 0

-

“AI实验时代结束”:IBM重构企业级AI的未来蓝图

“AI 实验的时代已经结束。”在2025年Think大会的开场致辞中,IBM董事长兼首席执行官Arvind Krishna抛出这一句有力的宣言。这不仅是对企业AI发展阶段的判断,也昭示了AI技术从试验走向核心业务重构的新起点。 这一转折点由两大因素驱动:一是技术的持续进步推动AI更容易、更高效地落地;二是企业的现实需求——降本增效——推动AI真正服务于核心业务流程。从“试验AI”到“重塑业务”,企…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!