-

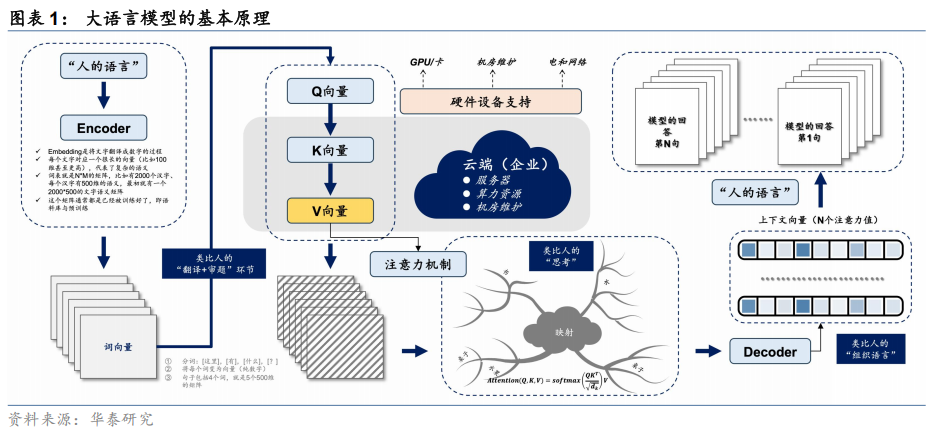

【华泰固收】债市研究智能体:“Prompt+”与多Agent协同——固收量化系列报告

核心观点核心观点大语言模型(LLM)的出现为二级市场投研工作带来了更大的拓展空间。但简单的“提问+聊天互动”还远远无法满足复杂的工作需求,如何更好地使用大模型正在成为更值得研究的问题。优化提示词(Prompt)是引导大模型生成高质量内容的基础,我们建议使用思维链和完整框架进行强化。而后,还可以继续对大模型进行三项“升级改造”:1、搭建智能体系统,使用多个Agent协同,分步分环节完成复杂任务,类似…- 4

- 0

-

AI 应用还在卷生卷死,微软已经将MCP准入规范写进了操作系统里

本周一的微软开发者大会上,微软宣布了多项举措,以促进MCP协议在Windows系统中的“安全、大规模使用”。私有数据访问授权:微软与 Anthropic 等MCP协议参与方联手设计了一种授权规范,以提高应用程序与 MCP 服务器之间的安全性。新规范允许用户通过 Microsoft Entra ID 等验证登录方法,让智能体和 AI 应用程序能够访问如个人硬盘和订阅数据(日历、邮箱、任务)等私有信息…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

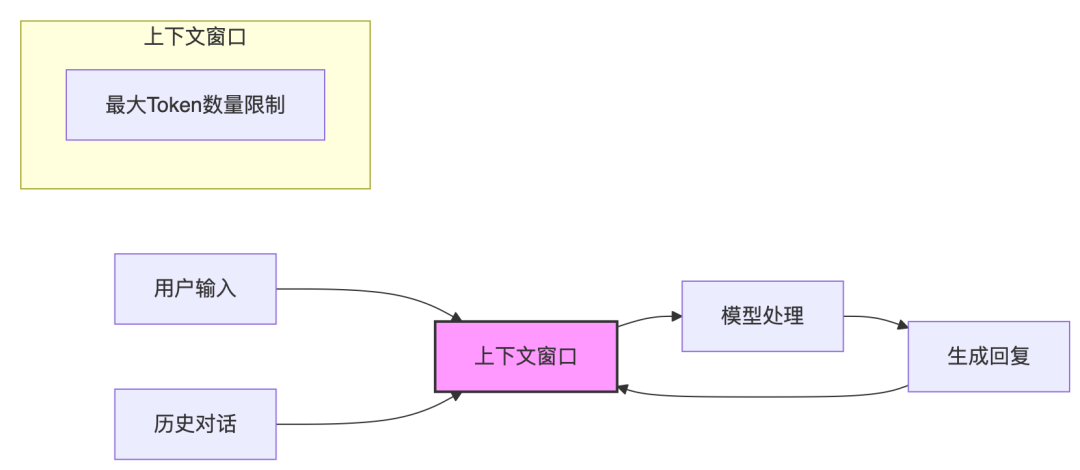

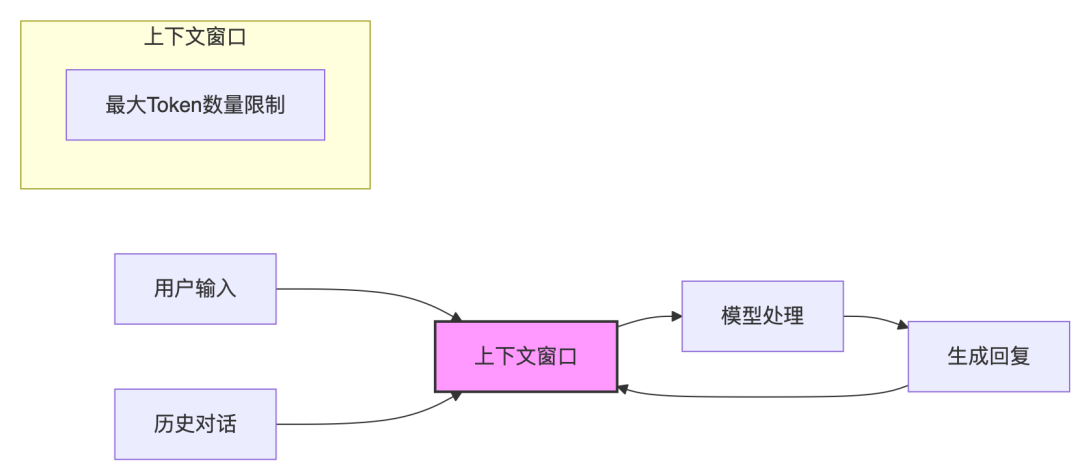

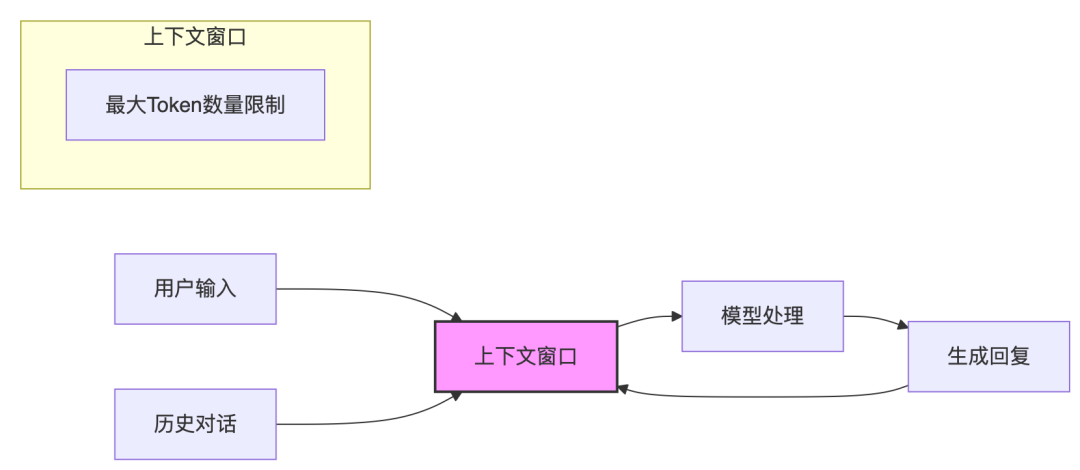

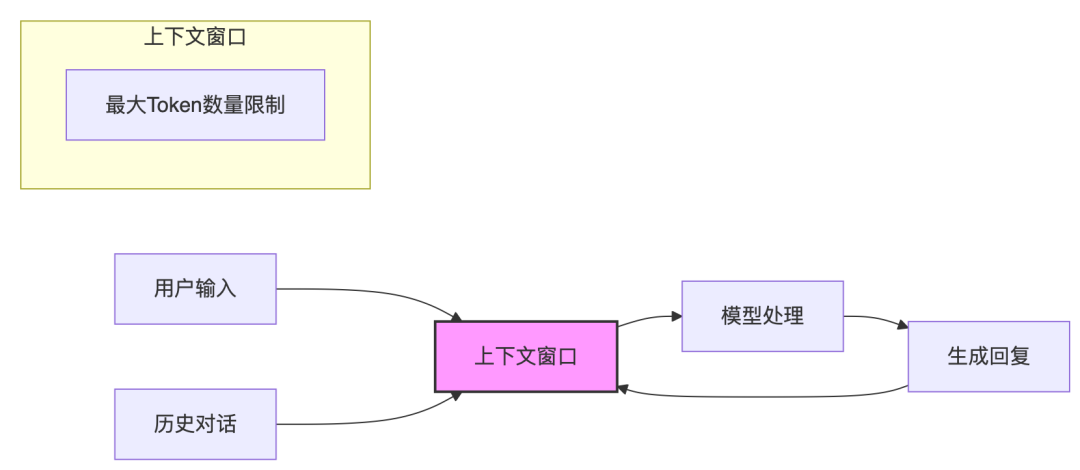

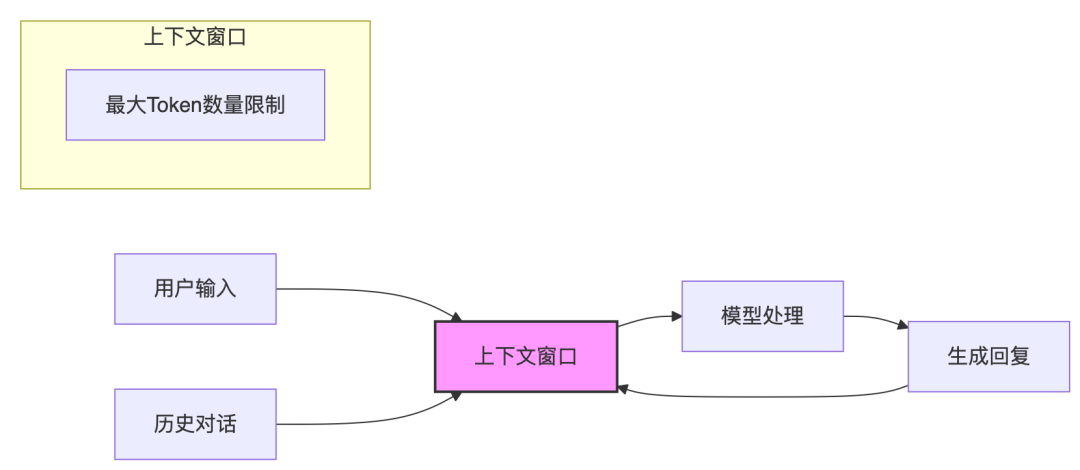

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

Agentic AI:存在主义羊角包

?Agentic AI 的出现颠覆了许多产品的旧秩序。通过自我迭代和自主决策,它们可以一站式地完成我们布置的任务。和传统的自动化不同,Agentic AI 不只在执行预设的任务,而是横向打通了「思考-执行-调整」的工作链路,包括上网搜索资料、调用不同的工具交付各类形式的产出。简而言之,AI Agent 更像一个受雇的「打工人」。Manus:一句话就能写文章、做PPT、敲代码…… | 每日经济新闻&…- 6

- 0

-

大模型多智能体在网络安全领域的应用发展

核心要点 • Anthropic MCP与Google A2A协议代表了AI应用从单体智能走向群体协作的两个关键方向,两者各自解决不同层次的协作问题 • 全球网络安全厂商已开始探索并部署基于MCP/A2A的多智能体协作系统,以提升威胁检测、分析与响应能力 • Gartner和Forrester等咨询机构预测,MCP/A2A类协议是未来3-5年智能安全运营的核心,将推动SOAR、SOC向更自动化…- 7

- 0

-

OpenAI创始人红衫AI峰会最新爆论:AI创业者,想活命就别再跟老子卷大模型了!

最近,第3届红杉资本AI峰会刚刚在旧金山落幕。150位全球最顶尖的AI创始人齐聚红杉资本会场。峰会邀请到了OpenAI的创始人Sam Altman进行访谈,本文分享了本次访谈的核心观点总结和中文完整版逐字稿。 核心观点总结 1、OpenAI的核心业务壁垒与创业建议:奥特曼明确表示OpenAI将专注于“核心AI订阅和模型”,并建议创业者“不要做核心AI订阅,但其他一切都可以做”。这可以被解读为对…- 8

- 0

-

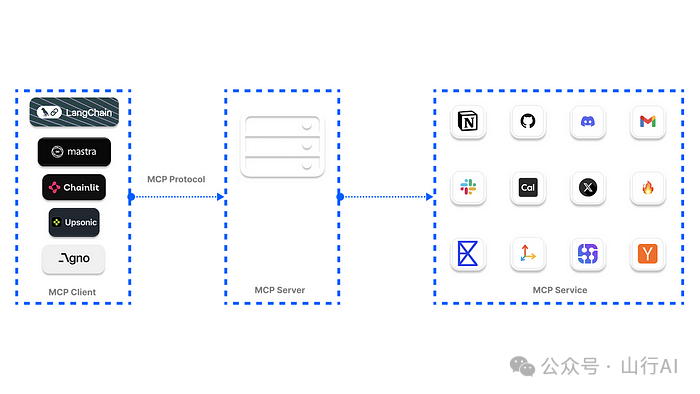

支持 MCP 的七大 AI 框架

使用 Python 和 Typescript 框架创建 AI 应用,这些框架可借助 MCP 服务器为大型语言模型(LLMs)提供上下文。 AI 代理工具包[1]为开发者提供了各种 API,使 AI 解决方案具备执行任务的工具,并确保结果准确,从而提升用户满意度。然而,将这些工具集成进 AI 应用并进行管理可能十分复杂。本文将向你介绍一种为 LLMs 和代理提供上下文的行业标准 —— Model C…- 7

- 0

-

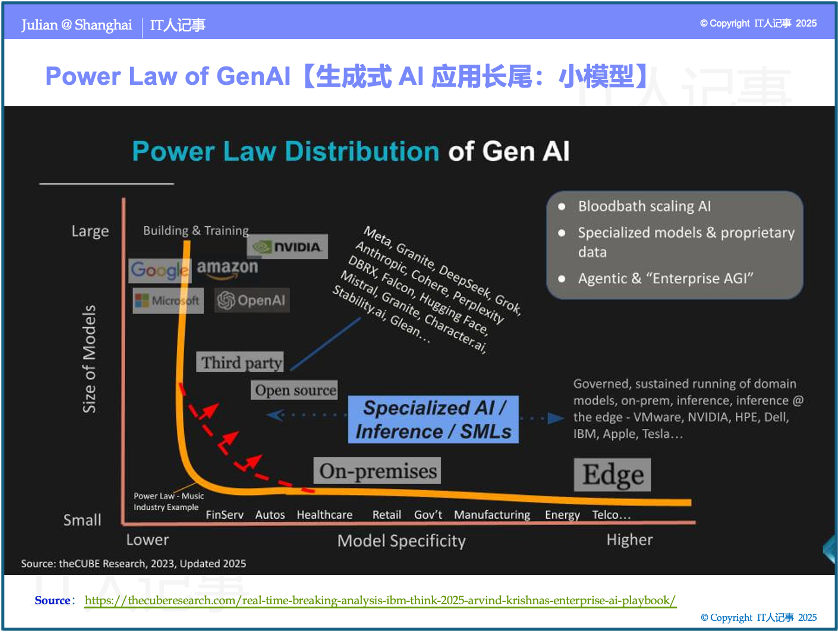

银行大模型应用:“小即是美、一企多模、实用优先“

【说在前面】本文是收集整理公开信息后得出的推测和预判,不涉及任何内部信息源,无法保障正确性与全面性。如有异议,你是对的。 《前文》介绍了头部银行大模型应用的概况。各行在年报中从大模型导入概况、应用场景、研发效率提升和关键成效数据等多个维度讨论了各自的创新,非常优秀且各具特色,令人影响深刻。 中小金融机构因为没有头部银行的资源和团队,企业级AI/大模型的路径很难直接复制这些大行的实践。最近,金融业的…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

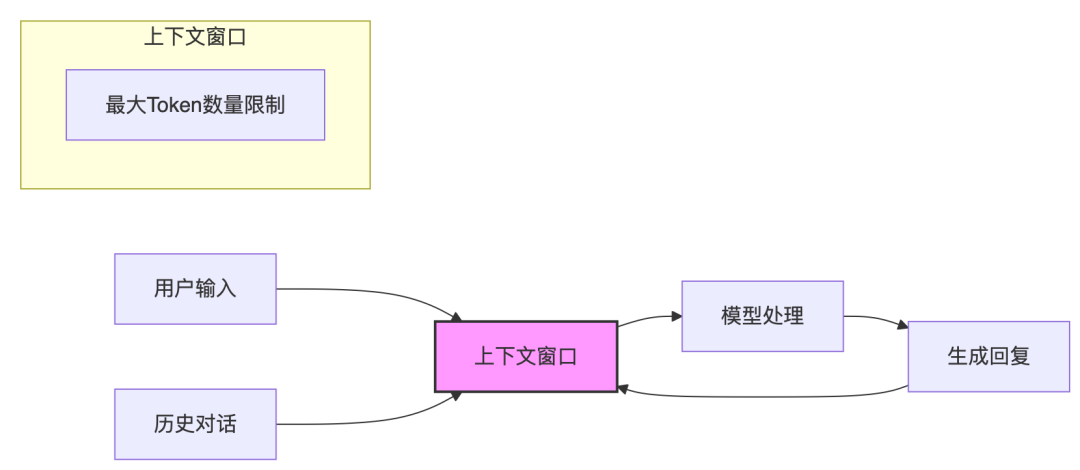

OpenAI Codex:当软件工程遇上「会思考」的云端协作者

点击上方?公众号?关注我✅ 您好,我是小白。见字如面。衷心感谢您的阅读,期待我们的下一次邂逅。 一、从「生成代码」到「理解工程」的技术跃迁2023 年,GitHub Copilot 凭借每月超 1.3 亿行代码生成量(数据来源:GitHub 2023 开发者报告)证明了 AI 编码工具的实用性。但 OpenAI 此次发布的 Codex,却将这场技术革命推向了新维度 —— 它不再仅是代码补全工具,而…- 10

- 0

-

火山引擎发布MCP Servers

近日,火山引擎发布大模型生态广场—— MCP Servers,借助字节跳动生态能力,通过“MCP Market(工具广场)+ 火山方舟(大模型服务)+Trae(应用开发环境)”深度协同,实现工具调用、模型推理到应用部署的全链路开发闭环,助力开发者以“模块化组装”模式告别复杂手动开发流程。 以开发数据分析应用为例:用户在大模型工具广场选择并生成 LAS MCP 的调用方式,随后注册到 Trae,再结…- 6

- 0

-

OpenAI 重磅剧透:GPT-5 即将发布,智能体验即将迎来飞跃!

OpenAI 的下一步大动作终于浮出水面,而这关乎我们未来与 AI 交互的方方面面。 根据最新消息,OpenAI 将继续推进其宏伟蓝图——以 GPT-5 作为核心,打造一个真正统一的 AI 平台。这意味着什么?简单来说,未来的 AI 体验将更加无缝、高效! OpenAI 研究副总裁 Jerry近期在 Reddit 社区的 AMA(Ask Me Anything)环节中透露,GPT-5 将是他们的下…- 7

- 0

-

深度解析大模型技术演进脉络:RAG、Agent与多模态的实战经验与未来图景

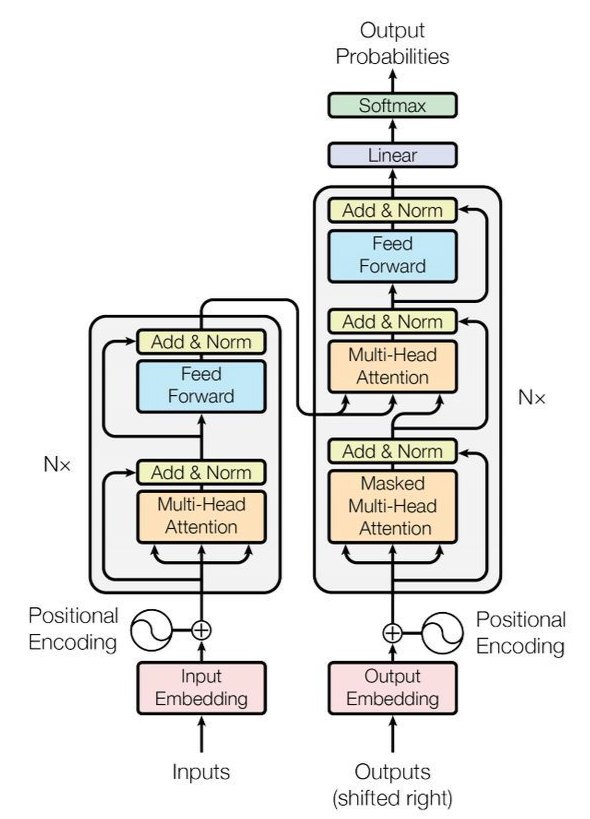

作者:jaymie 大模型作为产业变革的核心引擎。通过RAG、Agent与多模态技术正在重塑AI与现实的交互边界。三者协同演进,不仅攻克了数据时效性、专业适配等核心挑战,更推动行业从效率革新迈向业务重构。本文将解析技术演进脉络、实战经验与未来图景,为读者提供前沿趋势的全局视角与产业升级的实践指引。 大模型技术正加速渗透至产业核心场景,成为驱动数字化转型的智能引擎。全球机器学习大会(ML-Summi…- 7

- 0

-

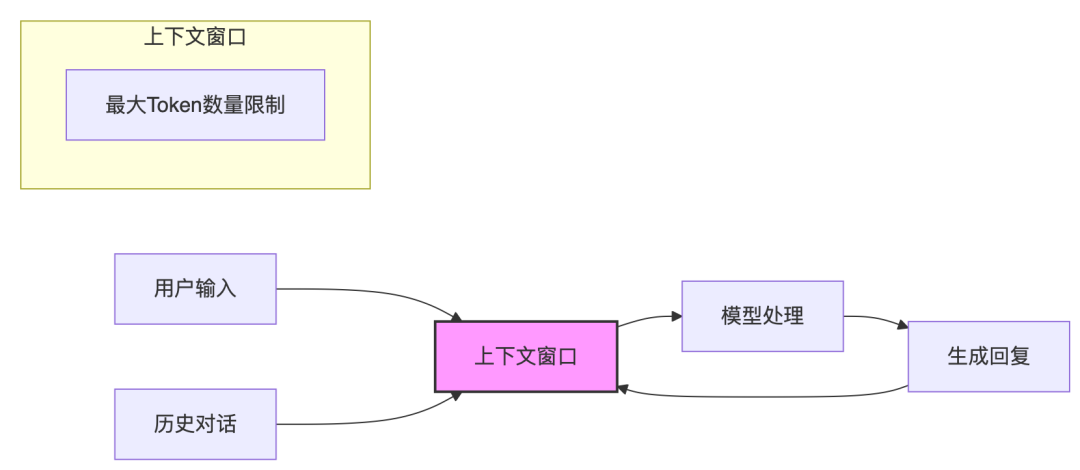

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

AI大厦需要新的地基!

「Scaling Law 即将撞墙。」这一论断的一大主要依据是高质量数据不够用了,正如前 OpenAI 首席科学家 Ilya Sutskever 在 NeurIPS 2024 大会上警告的那样:「我们所知的预训练即将终结。」虽然近几个月由于测试时间计算(test-time compute)范式的快速发展,这个曾经喧嚣一时的观点现在已经少有人提,但数据对 AI 的重要性却不减反增,已然成为当前正在持…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

OpenAI推出Codex — ChatGPT内置的软件工程Agents

OpenAI继续让ChatGPT对开发者更加实用。几天前,他们增加了连接GitHub仓库的支持,可以"Deep Research"并根据你自己的代码提问。今天,该公司在ChatGPT中推出了Codex的研究预览版,这是迄今为止最强大的AI编码Agent。它可以编写代码、修复错误、运行测试,并在安全的云环境中同时管理多个编码任务。让我们来分析Codex公告的详情。什么是Codex…- 7

- 0

-

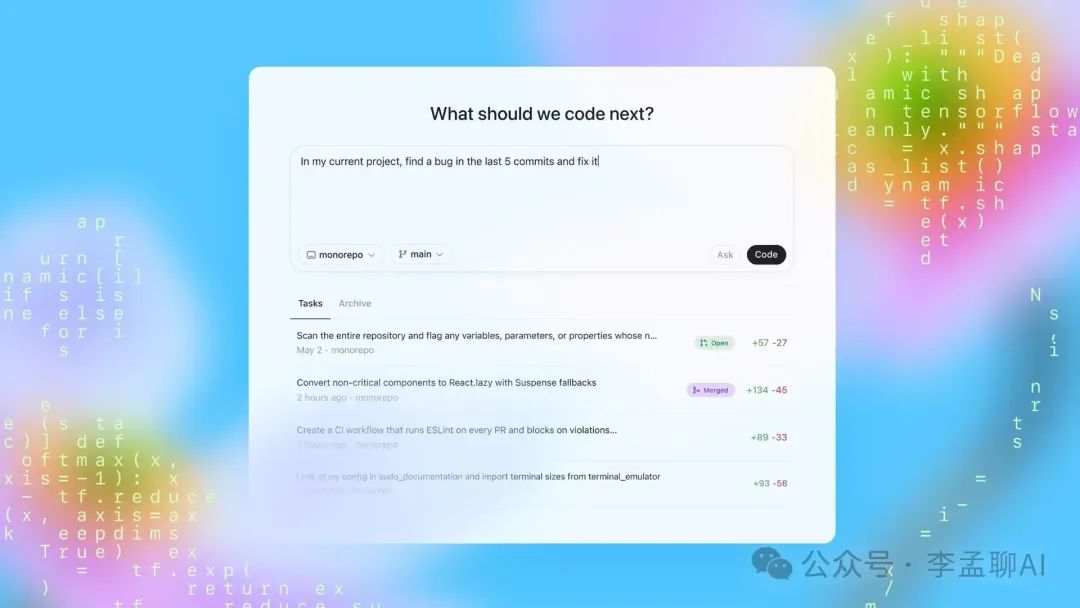

每个有野心的AI浏览器都想成为新的操作系统

你多久没换过主力浏览器了?或者说,你知不知道浏览器其实是可以更换的?对许多人而言,浏览器就像电灯,每天都会打开,却又熟视无睹。几十年来,从开先河的Mosaic到如今几乎垄断市场的Chrome,浏览器那张“脸”,几乎就没怎么变过:地址栏、书签、刷新按钮——一套雷打不动的组合。我们早已习惯,甚至麻木。主流浏览器提供的功能,对绝大多数人来说,已经足够好,但似乎也足够“无聊”了。然后,AI 来了。这个沉寂…- 6

- 0

-

WASP:基于加权多预训练语言模型融合的对比式隐私数据合成

WASP:基于加权多预训练语言模型融合的对比式隐私数据合成摘要:数据规模与质量是构建优质训练数据集的黄金准则,而样本隐私保护同样关键。在确保差分隐私(DP)这一形式化隐私保障的前提下,生成与高质量隐私数据相似的合成样本,具有可扩展性和实用价值。然而,现有基于预训练模型的数据合成方法在数据稀缺场景中表现欠佳,面临样本规模受限、生成噪声难以避免以及预训练模型偏差等问题。为此,我们提出 WASP 框架—…- 5

- 0

-

大模型开发理论与技术——大模型应用体系梳理,对大模型应用整体认识

“ 大模型技术开发是一个复杂的领域,我们需要对其形成基础的认知体系,才能知道我们在做什么以及怎么做。”随着对大模型技术应用的理解加深,以及和身边朋友和同事的交流,最近发现一个问题,很多人对大模型技术和应用并没有一个整体的认识;而且由于大模型属于一个新兴领域,也因此产生了很多新的概念和名词,所以这也间接导致了很多人认为大模型很难很复杂。所以,今天作者就从个人理解的角度对整个大模型体系进行梳…- 8

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

从PMF到TMF:AI产品设计的思考

在互联网时代,我们熟悉一个词叫PMF(Product Market Fit),它指产品与市场达到最佳契合点,你所提供的产品正好满足市场需求,令客户满意,这是创业成功的第一步。随着AI大模型技术的崛起,我们开始听到一个新词汇——TMF(Technology Market Fit),它强调我们需要将技术与最终市场匹配。这一概念凸显了当前技术变革中,对技术理解和认知的重要性。AI大模型技术高速发展数年后…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!