-

字节Trae 大更新,5分钟看懂AI生成的“神秘代码块”

这是我的第224篇Ai笔记,本篇2075字、累计笔记424165引言. 春节前,字节悄咪咪地发布了一个全新的AI编程助手——Trae,目标就是要做“工程级别的编程 AI”。 它跟咱们平时用的 Copilot 那些插件不一样,Trae 可是下了狠功夫,它能深入代码上下文,把业务结构搞得明明白白,还能搞定协作开发任务。 我一开始也是抱着试试看的心态,结果还真是惊喜,几个月下来它不断更新,体验也越来越丝…- 9

- 0

-

字节新出的MCP应用DeepSearch,有点意思。

这是苍何的第 355 篇原创! 大家好,我是苍何。 悄悄告诉你个事,昨天我去杭州参加字节火山方舟举办的开发者见面会了,你别说,还真有点刘姥姥进大观园的感觉? 现场真实体验完这次新发布的产品和模型,激动的忍不住想给大家做一波分享。特别是新出的 MCP 应用 DeepSearch,很有意思。 我的小脑袋瓜子总结下来,一共有四大亮点: 1、发布豆包深度思考模型 Doubao-1.5-thinking-p…- 8

- 0

-

用百度网盘MCP在Cursor中构建私人网盘助手,太香了叭(附搭建教程)

这是苍何的第 359 篇原创! 大家好,我是苍何。 参加完百度 AI 开发者大会,我兴奋的像一只小鸡,跳来跳去。 倒不是因为近距离见了李彦宏(当然这也很兴奋?),而是被这次发布的很多 AI 产品所吸引。 特别是看到百度千帆平台已经全面支持 MCP 并可自定义发布 MCP Server,我更兴奋了。 于是我马不停蹄的用他内置的百度网盘 MCP,在千帆平台,快速搭建了私人网盘助手。他长这个样子。 我可…- 8

- 0

-

实测免费DeepResearch!轻量版深夜上线,基于o4-mini,速度更快/重视脉络梳理

克雷西 发自 凹非寺量子位 | 公众号 QbitAI 终于,免费用户也能用上OpenAI的DeepResearch了,量子位也进行了新鲜实测! OpenAI深夜官宣,基于o4-mini某个版本的轻量版DeepResearch正式上线。 按照官方说法,轻量版的回答会更短,但智能水平将几乎无异于满血版本。 与此同时,轻量版的上线也意味着付费用户可以有更多的使用次数。 具体来说,付费用户的满血版用量不变…- 8

- 0

-

Dify → 问题分类|条件分支

问题分类 通过定义分类描述,问题分类器能够根据用户输入,使用 LLM 推理与之相匹配的分类并输出分类结果,向下游节点提供更加精确的信息。 场景常见的使用情景包括: 客服对话意图分类 产品评价分类 邮件批量分类 在一个典型的产品客服问答场景中,问题分类器可作为知识库检索的前置步骤,对用户输入问题意图进行分类处理,分类后导向下游不同的知识库查询相关的内容,以精确回复用户的问题。 示例工作流模板下图为产…- 19

- 0

-

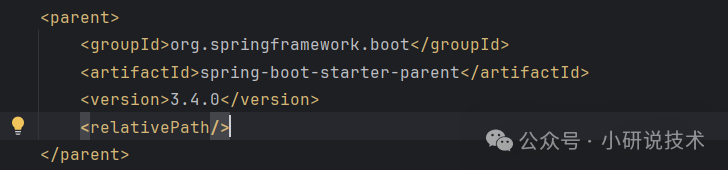

接入SpringAI实现流式对话

前面有讲到Python对接DeepSeek实现对话,但基于现状,从事后端开发,侧重于Java,此次演示以SpringAI技术实现。步骤一:引入依赖一定要引入SpringAI的管理依赖,可以方便的使用其他模型及Client! <dependencyManagement> <dependencies> <!-- Spring AI的管理…- 10

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

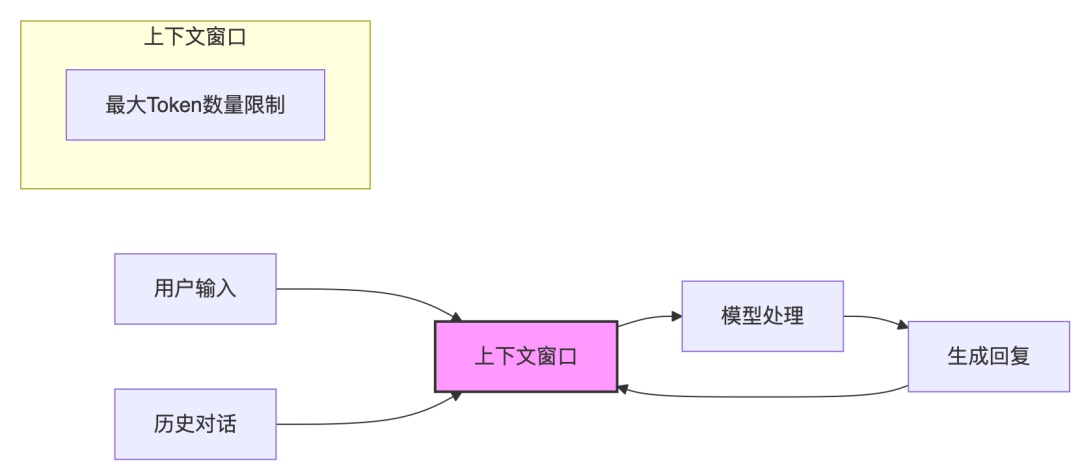

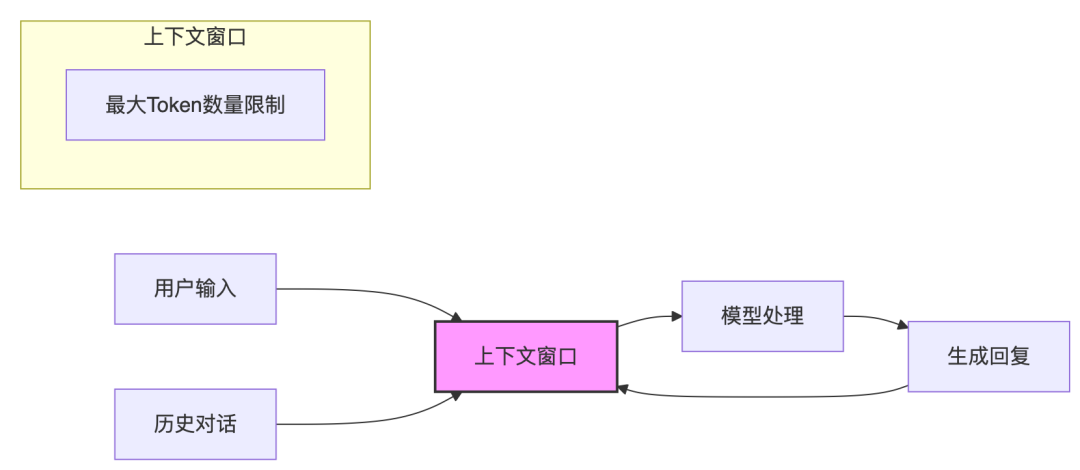

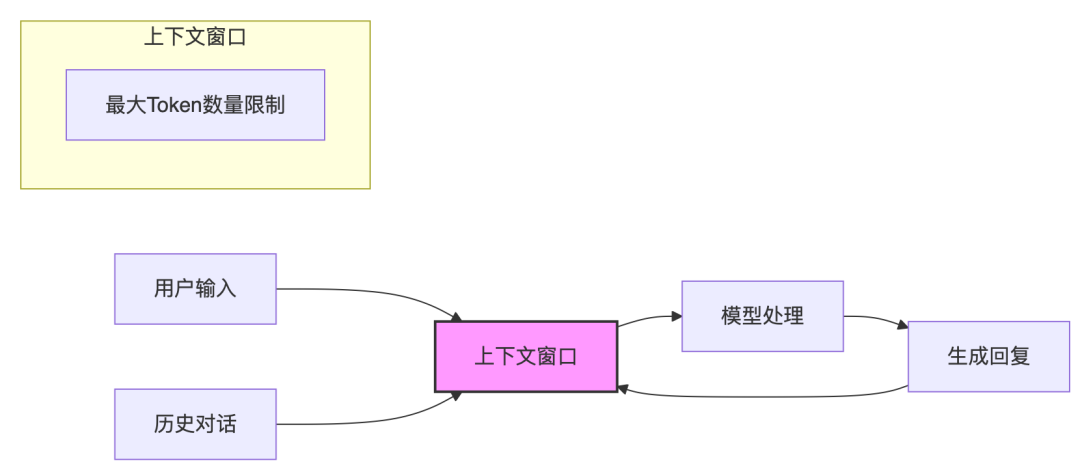

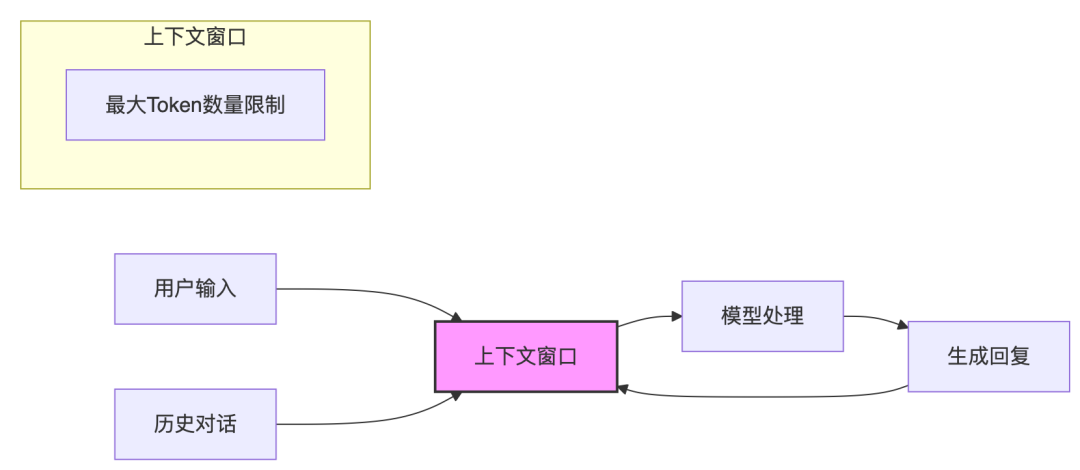

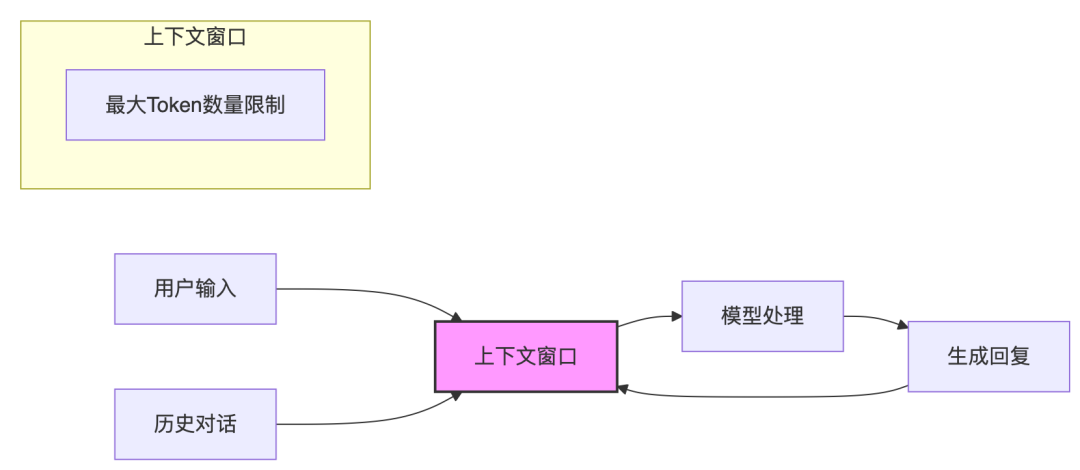

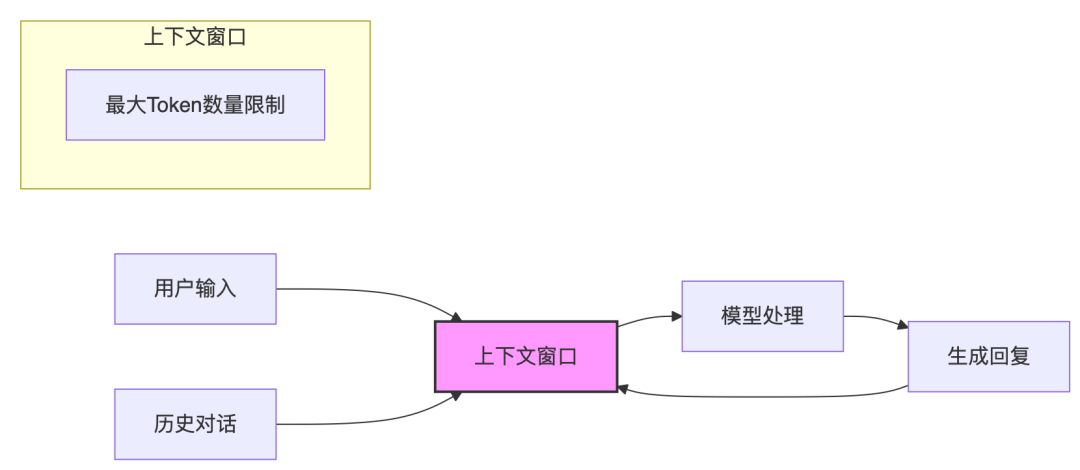

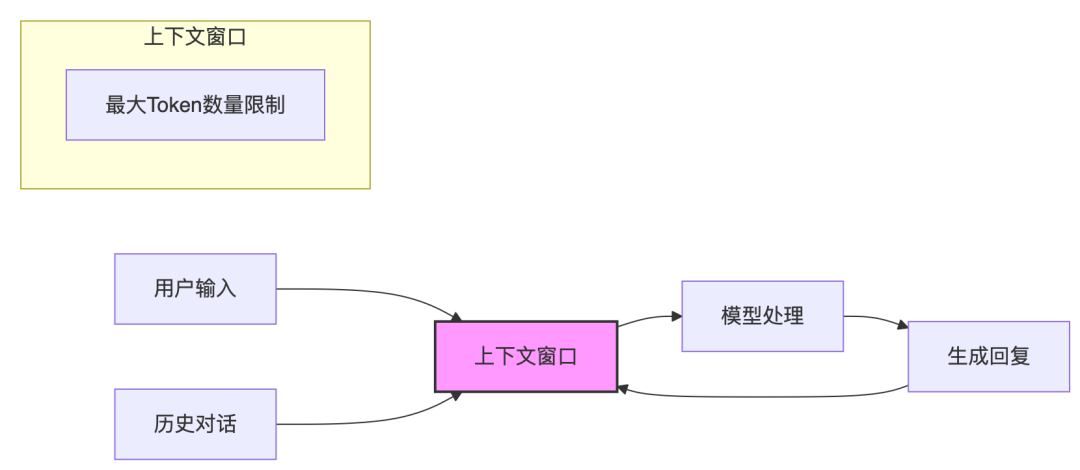

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

MCP超市:百度上线AI开放计划

解决了安装难、不安全、开发慢的问题后, MCP Server 数量暴增后, 马上就会迎来 GPTs 同款的至暗时刻。 一个 MCP Server 里有多个功能,这就意味着 Server 们的重叠程度会很高,光是ai搜索我都快看到十种了。 加上需要 API Key,按次收费让测试变得有成本,搭一个合适自己的 MCP Agent需要的时间更久。 GPTs 当时的解法是根据有效对话次数排名,败笔就是有很…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 6

- 0

-

从Function Call到MCP:大模型如何调用外部工具

在当前的大模型应用中,一个重要能力就是“调用外部工具”——也被称为Function Calling。在实现上,OpenAI 提出的 Function Schema 标准已成为事实上的主流。为了进一步提升接口管理与接入效率,MCP(Model Context Protocol,模型上下文协议)应运而生。01大模型为什么需要调用外部工具?大语言模型虽然拥有强大的生成和理解能力,但它本质上是一个「预训练…- 3

- 0

-

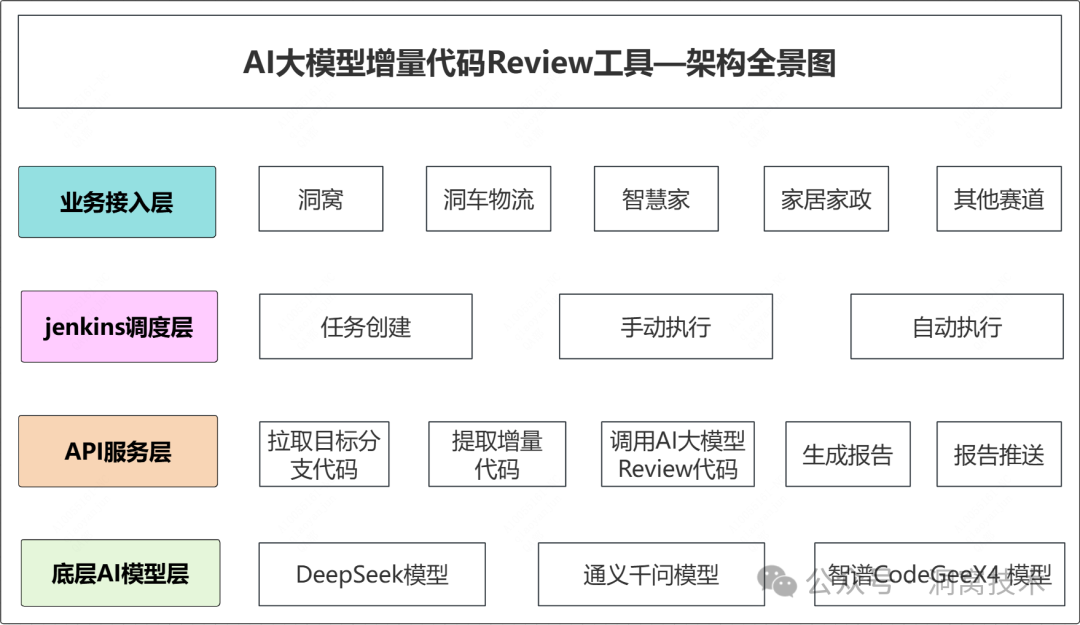

增量代码自动Review工具:洞窝在AI上的探索和实践

一、背景介绍 在传统的软件测试体系中,QA人员主要采用接口测试、ui/功能测试、兼容/易用性测试、性能测试等黑/灰盒测试技术手段来保障软件项目质量,涉及代码层面的质量检查包括单元测试、代码Review环节主要由开发人员负责,QA涉及较少或者基本不参与,因此,针对质量至少存在以下局限性: 1、QA重心在于关注功能实现,对内在的代码质量可能存在盲区 一些隐形bug,对常见的…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 7

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 2

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 10

- 0

-

OpenAI 白送 200 美元的深度研究功能?实测后发现这个「阉割版」不如不用

今天凌晨,OpenAI 宣布推出由 o4-mini 驱动的轻量版深度研究功能。先划重点,Plus、Team、Enterprise 和 Edu 用户都将可以使用这项功能。每月查询次数分别为:Pro 用户 250 次、Plus 用户 25 次、免费用户 5 次。官方表示,这一版本在智能程度上接近完整版深度研究,虽然回复更为简洁,但依然注重内容深度,同时降低了服务成本。Enterprise 和 Edu …- 5

- 0

-

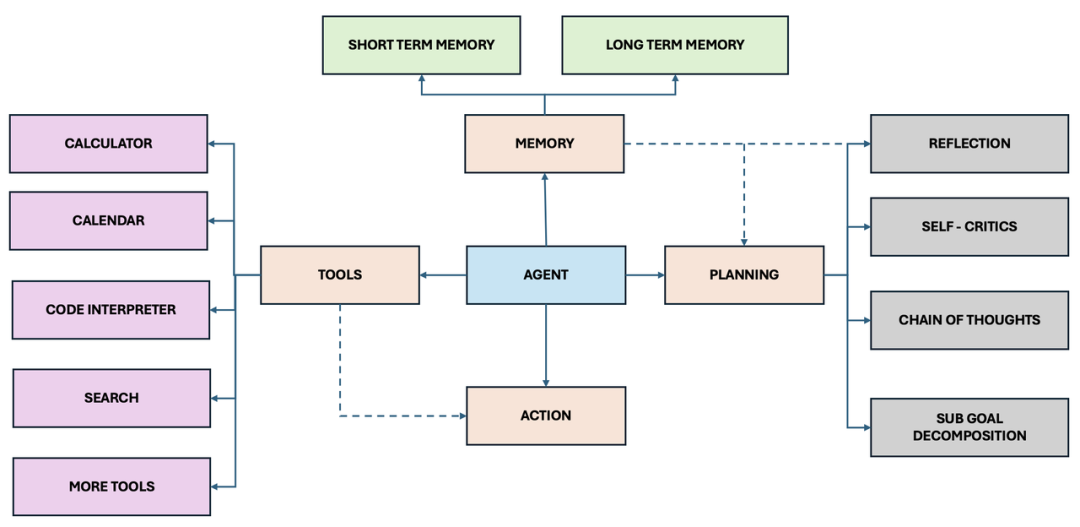

为什么一定要做Agent智能体?

在进行Agent能力落地、推广的过程中,我经常被问到一个问题:为什么一定要做Agent智能体?提出这个问题的人也挺多的,其实逻辑也并不复杂:同样的业务场景,使用Agent无非就是构建了一个基于大模型按多步骤执行的流程,如果通过传统的开发方法,如硬编码(Hard Code)或者低代码的配置化平台(如一些SOP配置平台、流程编排平台等),其实也同样能实现类似Agent的流程功能。说的具体一点,Agen…- 5

- 0

-

哇!首个MCPBench来了,MCP竟然不比Function Calls更有优势? | 最新

【编者按】你是否正在投入大量资源开发基于MCP的Agent,却从未质疑过一个基本假设:MCP真的比传统函数调用更有优势吗? 2025年4月的这项开创性研究直接挑战了这一广泛接受的观点,其执行摘要明确指出:"使用MCPs并不显示出比函数调用有明显改进"。令人震惊的是,研究发现Qwen Web Search函数调用的准确率达到55.52%,实际上超过了包括Exa Sear…- 5

- 0

-

医疗大模型案例分析(一):Google Med-PaLM

Google Med-PaLM是谷歌研发的医疗领域大语言模型,基于PaLM 2架构优化,专为医学知识问答和临床决策支持设计。其核心优势在于:1)专业性强,通过海量医学文献、电子病历及权威指南训练,回答准确率接近医生水平;2)多模态能力,可解析文本、影像和结构化数据;3)安全合规,采用严格的事实核查和伦理过滤机制;4)支持60+种语言,助力全球医疗普惠。目前已在全球超过50家医疗机构进行试点或正式应…- 9

- 0

-

vLLM+Qwen-32B+Open Web UI构建本地私有大模型

目录vLLM简介ModelScope简介Docker环境配置运行vLLM容器Open Web UI部署Tokens与上下文1. vLLM简介vLLM(Vectorized Large Language Model Serving System)是由加州大学伯克利分校团队开发的高性能、易扩展的大语言模型(LLM)推理引擎,专注于通过创新的内存管理和计算优化技术实现高吞吐、低延迟、低成本的模型服务。v…- 13

- 0

-

AI产品经理思考MCP(3):MCP的未来可能

MCP 的进化之路与未来可能随着 OpenAI 等宣布支持,MCP正迅速从一个开放协议概念,加速成为行业事实上的标准,国内外厂商纷纷布局。但这仅仅是开始。当前的 MCP 实现,大多还停留在相对基础的阶段——提供标准化的接口来调用一些简单工具,比如网页内容提取、文件读写等。那么,MCP 的下一步会走向何方?未来将会在两个方向上进化:3.1 MCP Server 的智能化目前的 MCP 工…- 10

- 0

-

AI产品经理思考MCP协议(2):标准化的必要性

现在我们已经知道了标准化的可行性。但这自然引出了一个更深层的问题:标准化,真的有必要吗?我们是不是在重复造轮子?有效扩大模型的能力边界,让Agent成为可能大语言模型本身是一个大脑,它没有“手”与物理世界或复杂的数字系统直接交互。没有外部工具和标准化的接口,LLM 很大程度上只能停留在“聊天机器人”的层面。要实现更强大的 Agent 功能(即能自主规划并执行任务的 AI),模型需要与外部世界互动。…- 9

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!