-

邱泽奇|人机互生:范式革命与知识生产重构

✦✦✦摘要知识创新范式、知识传播范式和知识扩散范式是三重相互关联且机制各异的不同指称。当三重范式组合为一个协同体系时,便是知识生产范式。知识生产与人类历史相伴随,源远流长。当我们用知识生产范式去分析时,会发现范式革命的次数极其稀少,除了古代社会对理性运用的残缺范式,在遇到新一代人工智能之前,也就只有从科学革命开始建立的完整范式。以GPT为代表的人工智能前沿技术正在重构人类的知识生产,形成人类与机器…- 6

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

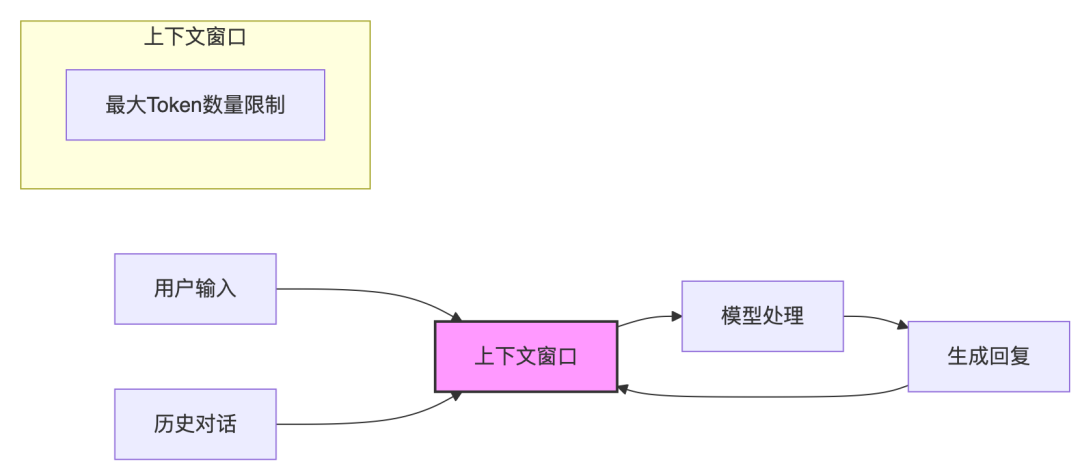

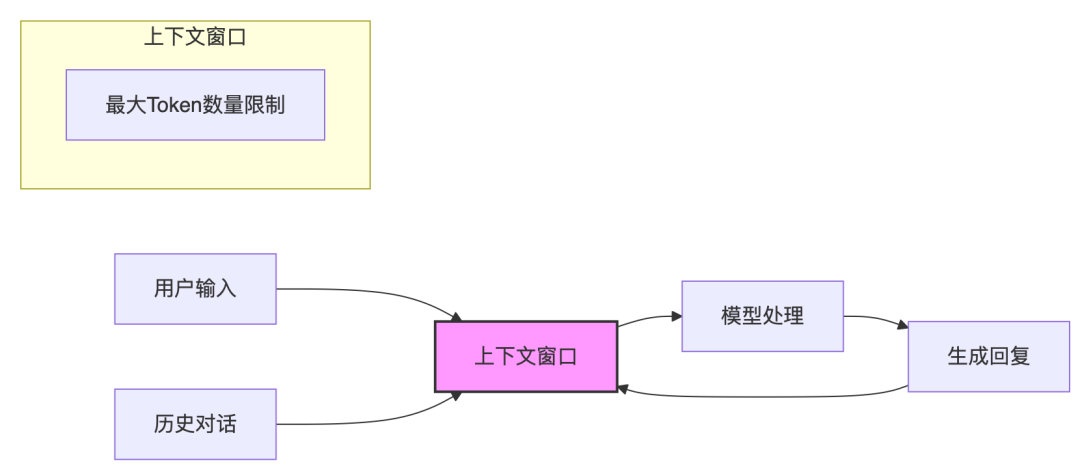

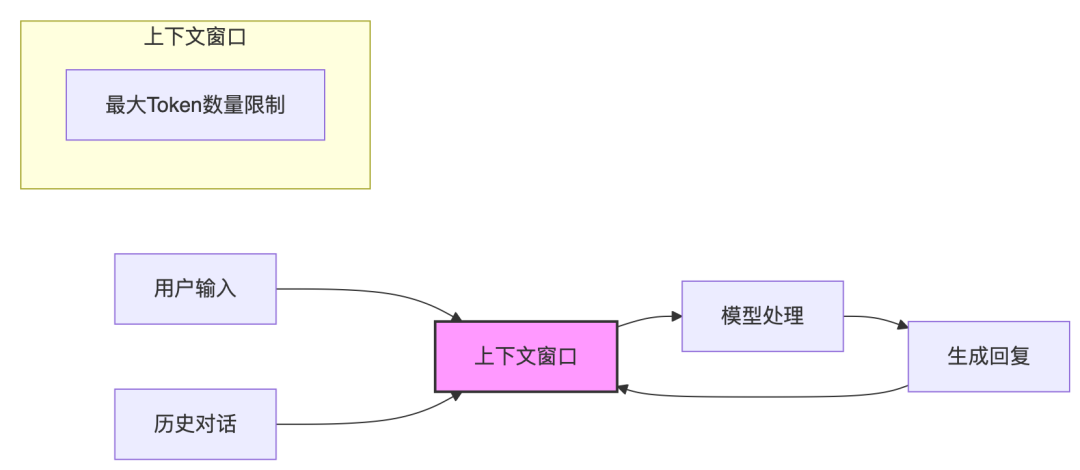

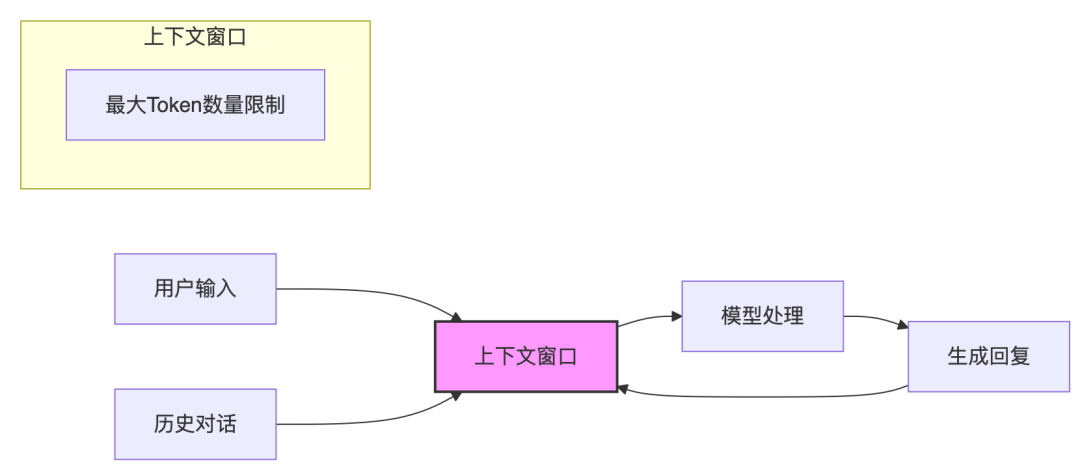

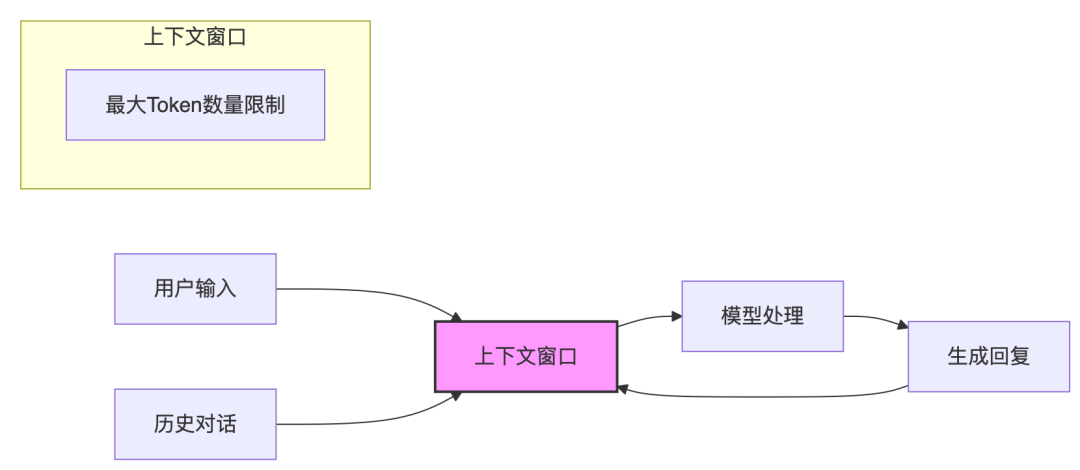

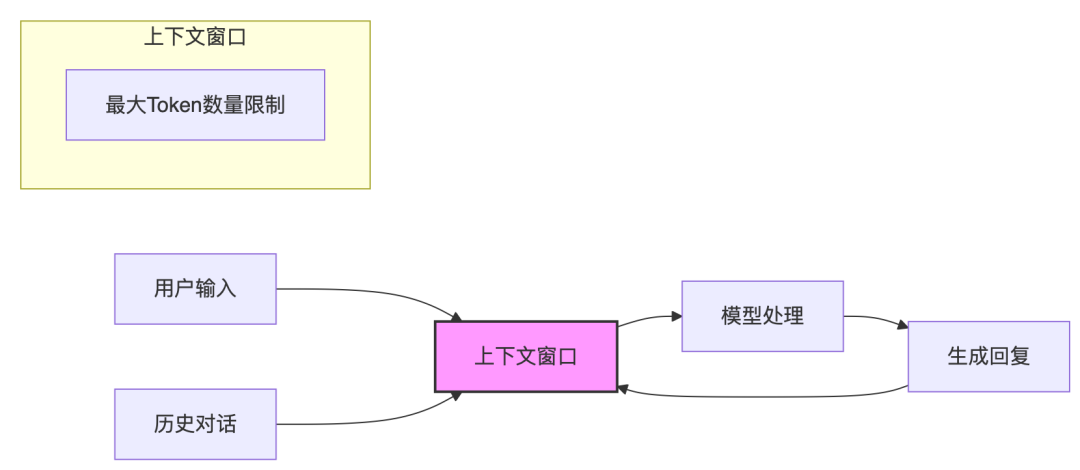

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

王坚对谈黄仁勋,都聊了啥?

作者|张帅 编辑|盖虹达 本文首发于钛媒体APP 7月17日消息,在第三届中国国际供应链促进博览会论坛上,英伟达公司总裁兼首席执行官黄仁勋与阿里云创始人王坚,开展了一场持续20分钟的"炉边谈话"。 从AI基础技术的变革(如深度学习、生成式AI到物理AI)、开源模型的生态价值,到算力革命的十年万倍跃升,两人探讨了AI如何重塑科学创新与人类创造力。 黄仁勋强调开源协作的重要性。他表…- 4

- 0

-

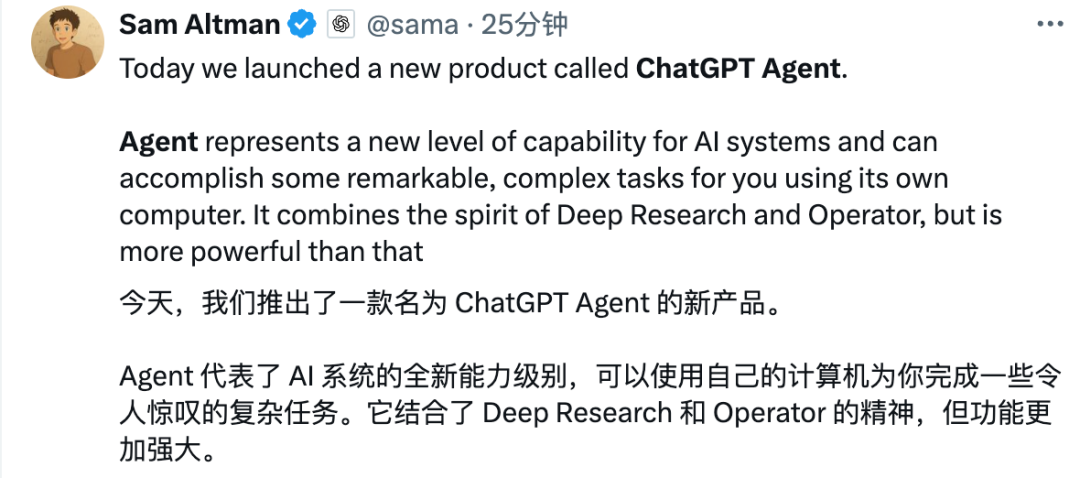

一文读懂ChatGPT Agent:没超越Manus的能力范畴,但看到了端到端的曙光

文|晓静、博阳 编辑|萌萌 Agent是今年AI圈最大的共识,OpenAI自然也不能掉队。 北京时间2025年7月18日凌晨1点,Sam Altman和四位OpenAI 的研究员在直播中正式发布了ChatGPT Agent——一款通用型AIAgent。 前有Manus、Lovart和Flowith,ChatGPT Agent所呈现的功能场景并不算特别惊艳,但它发布的意义,要超越其功能本身。 Cha…- 5

- 0

-

昨晚,OpenAI 推出了自家的 Manus…

想象一下,你有个聪明的AI小伙伴,不仅能和你聊天,还能像真人一样帮你查资料、做分析、下单购物、做PPT、整理表格,甚至能自动登录网站、写代码、跑数据分析——这不就是 Manus?哦不,它是全新的 ChatGPT Agent!1. 它到底能做什么?ChatGPT Agent 不再只是“回答问题”,而是能主动帮你完成一整个复杂任务。比如:“帮我查下日历,结合最近新闻,给我做个客户会议简报”“帮我计划一…- 5

- 0

-

OpenAI AGI来了!ChatGPT Agent 能上手帮你解决 45% 的 excel 表格任务了

点击⬇️图标关注 抓住你的灵感💡瞬间 OpenAI 通用 Agent 发布!ChatGPT 能上手帮你解决 45% 的 excel 表格任务了 朋友们,OpenAI 的通用智能体它来了! 不知道你们有没有经历过这样的崩溃瞬间: 一边在 10 个浏览器标签页里对比酒店价格,一边在微信里和朋友确认着装要求,同时还要在购物 App 里找一件既符合预算又不会撞衫的衣服……最后,大脑 CPU 烧干,只想…- 3

- 0

-

AI应用场景指南:航空航天和国防领域

人工智能 (AI) ——包括生成式 AI(用于创建新设计、内容或数据)和代理式 AI(能够感知和行动的自主代理)——正在改变几乎所有行业的制造业。下文将分析航空航天和国防领域采用 AI 的主要用例、优势、行业案例和挑战。一 用例航空航天和国防领域正在积极运用人工智能来增强飞机/航天器的制造及其周边的复杂操作。主要用例包括:设计优化与生成式设计:人工智能用于设计更轻、更坚固的航空…- 5

- 0

-

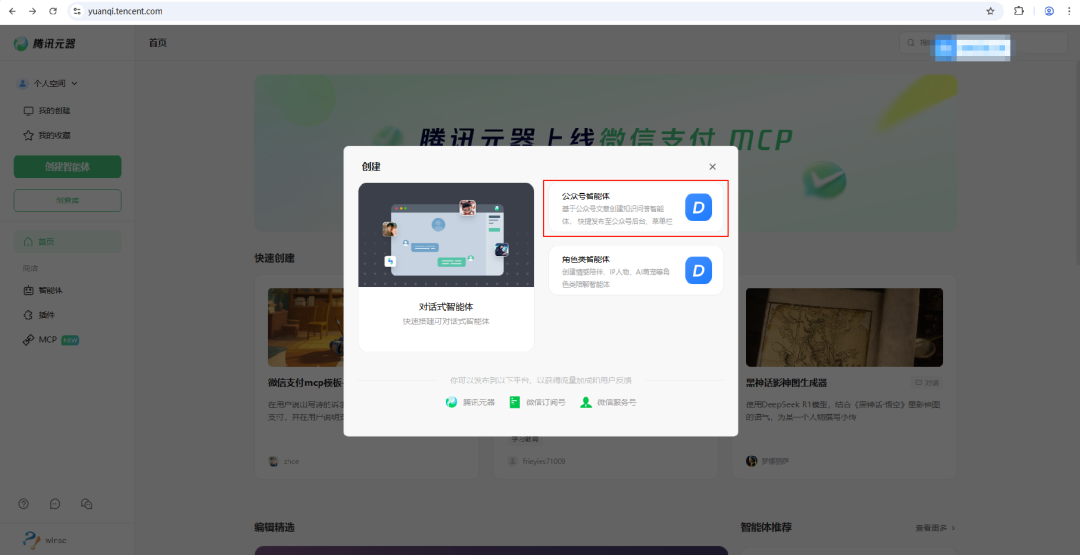

腾讯智能体体验:腾讯AI焊在微信里面了

太牛了,腾讯智能体和微信完全是一体的,无缝融合。 创建的智能体能单独使用,又能以小程序的方式在微信中分享使用,也能接入公众号作为智能运营助理。 公众号文章作为知识库在智能体中使用。主要还可以添加自己的知识库绑定到智能体,来完善知识组成。创建智能体 首先打开元气(腾讯元器) https://yuanqi.tencent.com/ ,创建一个智能体,选择 公众号智能体。 绑定自己的公众号。提示词先…- 6

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

刚刚,OpenAI 发布 ChatGPT 版 Manus!奥特曼:感受 AGI 时刻

过去大半年,Agent(智能体)是 AI 行业最常被提及的概念之一。几乎所有厂商都在讲 Agent,概念不缺,demo 也不少,但真正做到产品级落地,始终缺一套完整的执行系统——既能理解复杂目标,又能调用多种工具串联任务流程,还要随时支持任务中断、修改与恢复,真正贴合任务流。就在刚刚,OpenAI 正式发布 ChatGPT Agent 功能。通过整合 Operator + Deep Researc…- 1

- 0

-

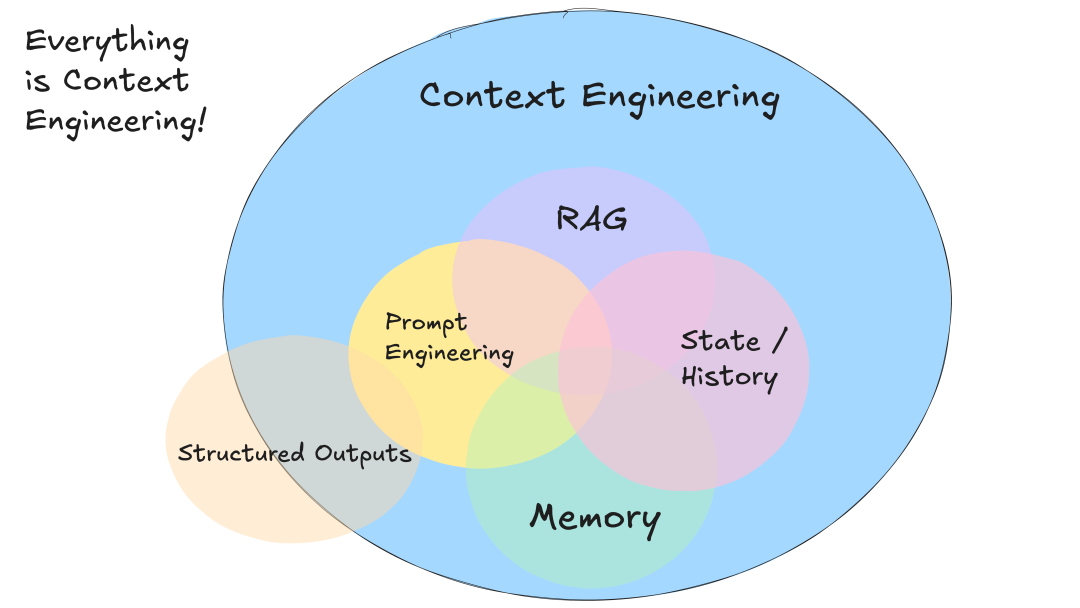

精读 OpenAI 指南:构建 Agent 的最佳实践

引言 大型语言模型(LLM)现在越来越擅长处理复杂、多步骤的任务了。因为 LLM 在推理、多模态能力和工具使用上的进步,诞生了一类新的由 LLM 驱动的系统,叫做 Agents。这份指南是写给那些想尝试构建第一个 Agent 的产品和工程团队看的。里面总结了很多实际部署经验,提供了识别应用场景的框架、设计 Agent 逻辑和编排的清晰模式,以及保证 Agent 安全、可预测、有效运行的最佳实践…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 3

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 2

- 0

-

那些率先实现了 AI 落地的公司,做对了什么?

AI 商业化落地,技术固然重要,生态也举足轻重。作者|苏子华编辑|郑玄过去一年,AI 这个词在企业界几乎无处不在。 有的企业在开年就安排了数十万到百万的 AI 资金预算;有的高管忙着开 AI 战略会;还有的组建了 AI 专项小组…… 从去年的犹豫观望到今年的主动布局,帆软软件战略副总裁沈涛表示:「去年可能花 3 个月都敲不开客户的门,今年春节后客户主动找上门,这是天翻地覆的变化。」 这背后,是 B…- 3

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

精读 12 条构建生产级 AI Agent 的实战指南(上)

引言 我在过去一年里构建了十几个不同类型的 Agent 应用。期间踩了无数坑:Agent "失忆"、工具调用失败、提示词效果不稳定等等问题 直到我看到了 HumanLayer 团队总结的"12 条构建可靠 AI 应用的实践原则",很多困扰我的问题终于有了系统性的解决方案。它们可能会让你的 Agent 能力提升 10 倍。 12 条实践原则 1. 使用自然…- 5

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 5

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

🧠 大模型到底厉害在哪?看完这篇你就懂了!

你有没有想过:我们每天用的 AI 大模型,比如 ChatGPT、文生图的 Stable Diffusion,到底“脑子里”是什么?今天,我们不讲代码、不讲数学,用最通俗的语言带你看懂大模型的“思考空间”到底是什么!⸻🌟 01 | 大模型的大,到底大在哪里?我们说 GPT-3、GPT-4 是“千亿参数的大模型”,这并不只是说“它很复杂”——而是它的“思考空间”特别大。举个例子:人脑里有很多神经元,而…- 2

- 0

-

ES vs Milvus vs PG vector :LLM时代的向量数据库选型指南

互联网时代,关系型数据库为王。相应的,我们的检索方式也是精确匹配查询为主——查找特定的用户ID、商品编号或订单状态。 但AI时代,语义检索成为常态,向量数据库成为搜索推荐系统,大模型RAG落地,自动驾驶数据筛选等场景的关键基础设施。 但一个问题是,不同场景,对向量数据库的需求不同: - RAG(检索增强生成):需要在海量文档中找到与用户问题语义相关的内容。对召回质量要求高,可灵活添加元信息,支持多…- 10

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 4

- 0

-

🧠 解码大语言模型的记忆力:上下文长度的前世今生

在与ChatGPT、Claude等大语言模型对话时,你是否好奇:它们是如何记住我们之前的对话内容的?为什么有时它们能记住很长的对话,有时却会"失忆"?今天,我们就来深入浅出地剖析大语言模型中的一个关键概念——上下文长度(Context Length)。上下文长度是什么?想象你正在和一个朋友聊天。这个朋友有一个特殊的能力:他能记住你们之间交流的最后N个字。如果你们的对话超过了N个…- 2

- 0

-

万亿空间!大模型下半场深度分析!2025

一、大模型下半场: 推动 AI 普惠并抢占战略制高点 在全球数字经济加速向智能化转型的浪潮中,生成式 AI 技术突破、大模型生态爆发与数 据量指数级增长,正重塑企业竞争格局,使得算力需求呈现前所未有的增长态势。企业正 站在从传统 IT 架构向智能决策体系转型的战略窗口。 在这场智能革命中,算力集群的弹 性扩展能力、算法框架的优化及数据资产的跨域融合,共同构成了数字化转型的坚实“数 字底座”。IDC…- 5

- 0

❯

购物车

优惠劵

搜索

扫码打开当前页

联系我们

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!